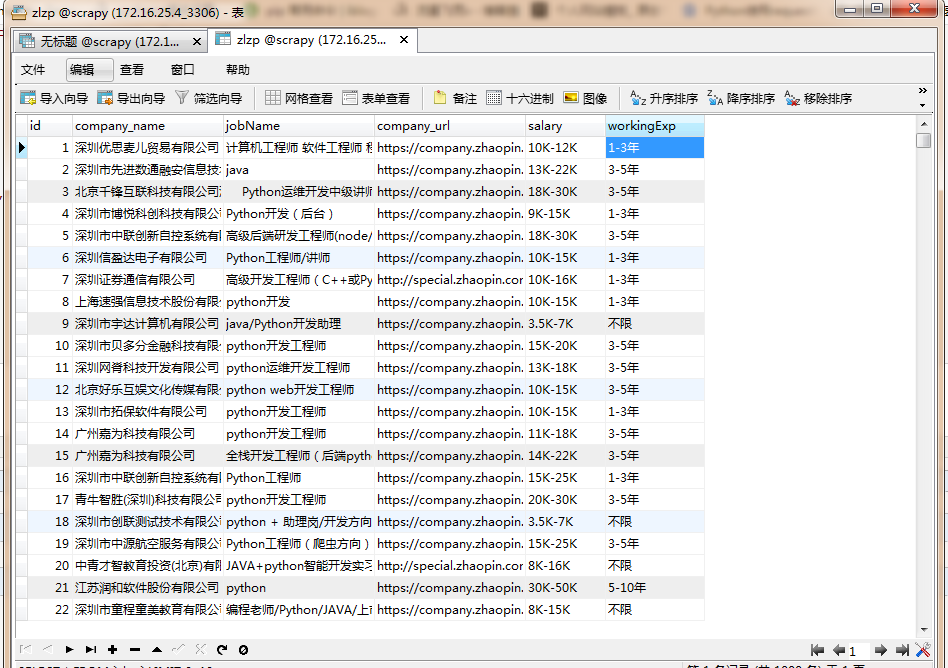

scrapy框架爬取智联招聘网站上深圳地区python岗位信息。

爬取字段,公司名称,职位名称,公司详情的链接,薪资待遇,要求的工作经验年限

1,items中定义爬取字段

import scrapy class ZhilianzhaopinItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

company_name = scrapy.Field()

jobName = scrapy.Field()

company_url = scrapy.Field()

salary = scrapy.Field()

workingExp = scrapy.Field()

2,主程序函数

# -*- coding: utf-8 -*-

import scrapy

from urllib.parse import urlencode

import json

import math

from zhilianzhaopin.items import ZhilianzhaopinItem

class ZlzpSpider(scrapy.Spider):

name = 'zlzp'

# allowed_domains = ['www.zhaopin.com']

start_urls = ['https://fe-api.zhaopin.com/c/i/sou?']

data = {

'start': '',

'pageSize': '',

'cityId': '',

'kw': 'python',

'kt': ''

}

def start_requests(self):

url = self.start_urls[0]+urlencode(self.data)

yield scrapy.Request(url=url,callback=self.parse) def parse(self, response):

response = json.loads(response.text)

sum = int(response['data']['count'])

for res in response['data']['results']:

item = ZhilianzhaopinItem()

item['company_name'] = res['company']['name']

item['jobName'] = res['jobName']

item['company_url'] = res['company']['url']

item['salary'] = res['salary']

item['workingExp'] = res['workingExp']['name']

yield item for url_info in range(90,sum,90):

self.data['start'] = str(url_info)

url_i = self.start_urls[0]+urlencode(self.data)

yield scrapy.Request(url=url_i,callback=self.parse)

3,settings中设置请求头和打开下载管道

USER_AGENT = 'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/39.0.2171.71 Safari/537.36'

ITEM_PIPELINES = {

'zhilianzhaopin.pipelines.ZhilianzhaopinPipeline': 300,

}

4,创建数据库,

5,pipelines.py文件中写入数据库

import pymysql

# 写入mysql数据库

class ZhilianzhaopinPipeline(object):

conn = None

mycursor = None

def open_spider(self, spider):

print('链接数据库...')

self.conn = pymysql.connect(host='172.16.25.4', user='root', password='root', db='scrapy')

self.mycursor = self.conn.cursor()

def process_item(self, item, spider):

print('正在写数据库...')

company_name = item['company_name']

jobName = item['jobName']

company_url = item['company_url']

salary = item['salary']

workingExp = item['workingExp']

sql = 'insert into zlzp VALUES (null,"%s","%s","%s","%s","%s")' % (company_name, jobName, company_url,salary,workingExp)

bool = self.mycursor.execute(sql)

self.conn.commit()

return item def close_spider(self, spider):

print('写入数据库完成...')

self.mycursor.close()

self.conn.close()

6,查看是否写入成功

done。

scrapy框架爬取智联招聘网站上深圳地区python岗位信息。的更多相关文章

- 用Python爬取智联招聘信息做职业规划

上学期在实验室发表时写了一个爬取智联招牌信息的爬虫. 操作流程大致分为:信息爬取——数据结构化——存入数据库——所需技能等分词统计——数据可视化 1.数据爬取 job = "通信工程师&qu ...

- scrapy项目2:爬取智联招聘的金融类高端岗位(spider类)

---恢复内容开始--- 今天我们来爬取一下智联招聘上金融行业薪酬在50-100万的职位. 第一步:解析解析网页 当我们依次点击下边的索引页面是,发现url的规律如下: 第1页:http://www. ...

- node.js 89行爬虫爬取智联招聘信息

写在前面的话, .......写个P,直接上效果图.附上源码地址 github/lonhon ok,正文开始,先列出用到的和require的东西: node.js,这个是必须的 request,然发 ...

- 用生产者消费模型爬取智联招聘python岗位信息

爬取python岗位智联招聘 这里爬取北京地区岗位招聘python岗位,并存入EXECEL文件内,代码如下: import json import xlwt import requests from ...

- Python+selenium爬取智联招聘的职位信息

整个爬虫是基于selenium和Python来运行的,运行需要的包 mysql,matplotlib,selenium 需要安装selenium火狐浏览器驱动,百度的搜寻. 整个爬虫是模块化组织的,不 ...

- python爬取智联招聘职位信息(多进程)

测试了下,采用单进程爬取5000条数据大概需要22分钟,速度太慢了点.我们把脚本改进下,采用多进程. 首先获取所有要爬取的URL,在这里不建议使用集合,字典或列表的数据类型来保存这些URL,因为数据量 ...

- python爬取智联招聘职位信息(单进程)

我们先通过百度搜索智联招聘,进入智联招聘官网,一看,傻眼了,需要登录才能查看招聘信息 没办法,用账号登录进去,登录后的网页如下: 输入职位名称点击搜索,显示如下网页: 把这个URL:https://s ...

- scrapy 爬取智联招聘

准备工作 1. scrapy startproject Jobs 2. cd Jobs 3. scrapy genspider ZhaopinSpider www.zhaopin.com 4. scr ...

- 『Scrapy』爬取腾讯招聘网站

分析爬取对象 初始网址, http://hr.tencent.com/position.php?@start=0&start=0#a (可选)由于含有多页数据,我们可以查看一下这些网址有什么相 ...

随机推荐

- 将博客转成pdf

前些天无意间看到了“birdben”的博客,写的比较详细,但是最新的文章更新时间是“2017-05-07”,时间很是久远,本打算有时间认真学习一下博主所写的文章,但是担心网站会因为某些原因停止服务,于 ...

- Blazor 机制初探以及什么是前后端分离,还不赶紧上车?

标签: Blazor .Net 上一篇文章发了一个 BlazAdmin 的尝鲜版,这一次主要聊聊 Blazor 是如何做到用 C# 来写前端的,传送门:https://www.cnblogs.com/ ...

- C#中各种Lock的速度比较

简单写了个小程序,比较了一下C#中各种Lock的速度(前提是都没有进入wait状态). 各进入离开Lock 1kw次,结果如下: Lock Time (ms) No lock 58 CriticalS ...

- Install Teamviewer on 14.04? [repost]

Ref: http://askubuntu.com/questions/453157/how-to-install-teamviewer-on-14-04 TeamViewer 是一款优秀的跨平台免费 ...

- Echarts的提示(Tooltip)显示额外内容

官方一般都是: 而我们通常是需要显示额外内容的,比如这样 其中Tooltip也是参考了网友的写法 option = { tooltip: { trigger: 'axis', formatter: f ...

- JVM Server与Client运行模式

JVM Server模式与client模式启动,最主要的差别在于:-Server模式启动时,速度较慢,但是一旦运行起来后,性能将会有很大的提升.原因是: 当虚拟机运行在-client模式的时候,使用的 ...

- Linux目录结构(目录结构详解是重点)

1.Linux目录与Windows目录对比 1.Windows目录结构 2.Linux目录结构 深刻理解Linux 树状文件目录是非常重要的,只有记住他们,你才能在命令行中任意切换,想去哪里去哪里 2 ...

- PAT(B) 1030 完美数列 - C语言 - 滑动窗口 & 双指针

题目链接:1030 完美数列 (25 point(s)) 给定一个正整数数列,和正整数 \(p\),设这个数列中的最大值是 \(M\),最小值是 \(m\),如果 \(M≤mp\),则称这个数列是完美 ...

- 安装macOS时遇到Unable to unmount volume for repair异常导致无法完成安装的解决办法

方法一: 使用终端命令行制作完macos安装U盘后,务必将.IAProductInfo文件放到U盘的根目录(非EFI分区的) sudo /Applications/Install\ macOS\ Si ...

- robotframework_酷我音乐_That Girl

*** Settings *** Library Selenium2Library *** Test Cases *** music # 打开浏览器 Open Browser https://www. ...