Openstack+Kubernetes+Docker微服务实践之路--服务发布

结合上文,我们的服务已经可以正常运行了,但它的访问方式只能通过服务器IP加上端口来访问,如何通过域名的方式来访问到我们服务,本来想使用Kubernetes的Ingress来做,折腾一天感觉比较麻烦,Ingress还得搭配Nginx使用,而且目前还是Beta版,就打算另辟蹊径,想到了之前用的Haproxy。

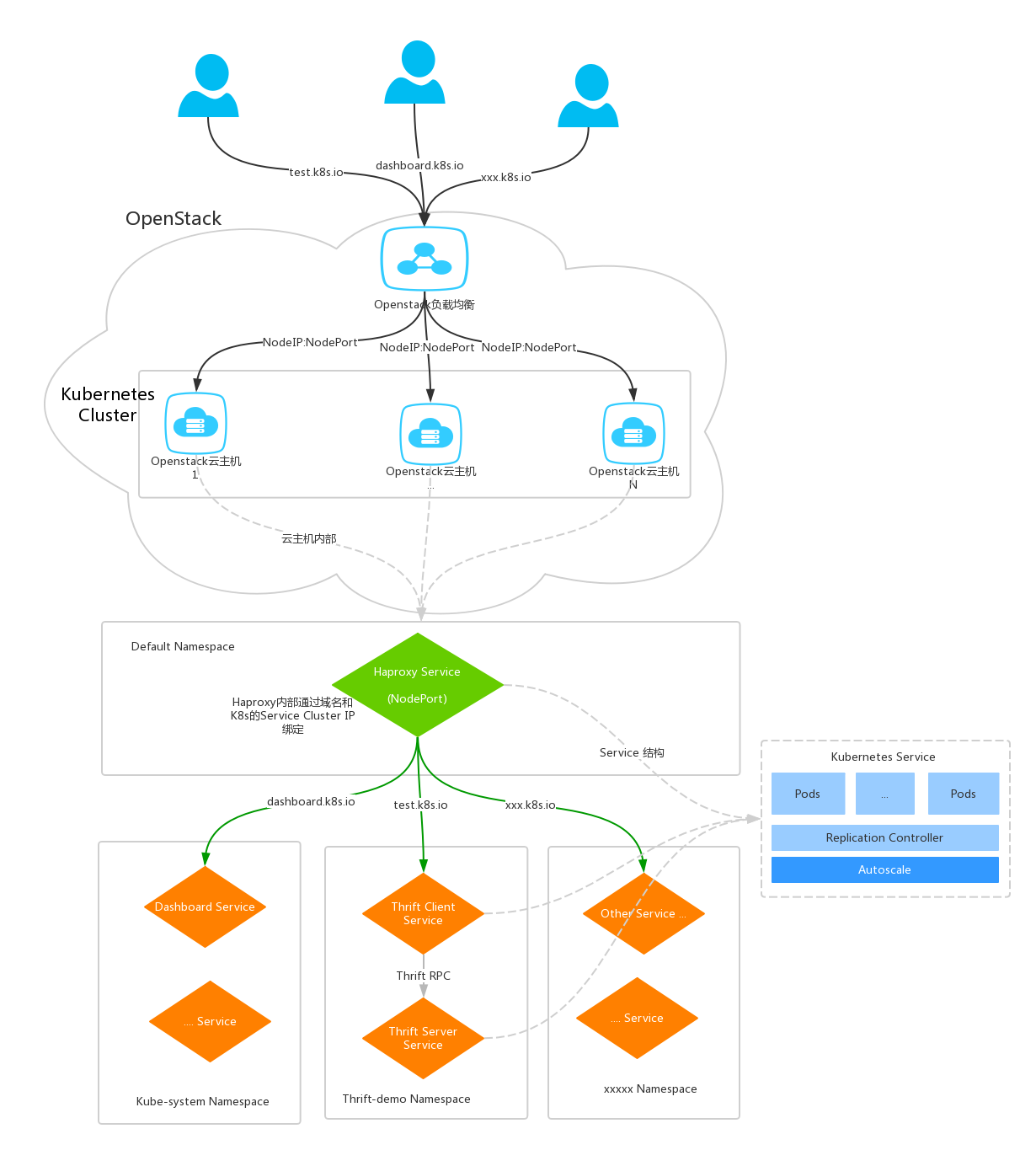

本文就结合OpenStack的负载和Haproxy来实现通过域名的方式访问K8s内部要发布的服务,用到的组件有OpenStack的负载均衡和Haproxy。

OpenStack负载配置到所有的K8s云主机上的一个端口,这个端口由Haproxy的K8s Service来监听,有请求过来时Haproxy根据不同的域名转发到对应的H8s Servie的Cluster IP。

整体拓扑图

具体的配置

OpenStack负载配置:

添加一个负载

注意它的IP地址,需要给它分配一个浮动IP,这样外部才能访问到

负载均衡池

30008 是Haproxy Service配置的NodePort

Haproxy配置

通过Kubernetes来运行Haproxy

haproxy-service.yml

{

"kind": "Service",

"apiVersion": "v1",

"metadata": {

"name": "haproxy-service"

},

"spec": {

"type": "NodePort",

"selector": {

"app": "haproxy"

},

"ports": [

{

"name": "proxy",

"protocol": "TCP",

"port": 80,

"nodePort": 30008,

"targetPort": 80

},

{

"name": "admin",

"protocol": "TCP",

"port": 8888,

"targetPort": 8888,

"nodePort": 30001

}

]

}

}

haproxy.cfg

global

maxconn 51200

chroot /usr/local/haproxy

uid 99

gid 99

daemon

nbproc 1

pidfile /var/run/haproxy-private.pid

defaults

mode http

option redispatch

option abortonclose

timeout connect 5000ms

timeout client 30000ms

timeout server 30000ms

log 127.0.0.1 local0 err

balance roundrobin

listen admin_stats

bind 0.0.0.0:8888

option httplog

stats refresh 30s

stats uri /stats

stats realm Haproxy Manager

stats auth admin:1

frontend thrift-app

bind *:80

option forwardfor

maxconn 1000

acl dashboard hdr(host) -i dashboard.k8s.io

acl scope hdr(host) -i scope.k8s.io

acl thrift_test hdr(host) -i test.k8s.io

use_backend dashboard_app if dashboard

use_backend scope_app if scope

use_backend thrift_app_1 if thrift_test

backend dashboard_app

balance roundrobin

option forwardfor

option httpclose

retries 3

server s1 10.12.48.203:80

backend scope_app

balance roundrobin

option forwardfor

option httpclose

retries 3

server s2 10.1.125.203:80

backend thrift_app_1

balance roundrobin

option forwardfor

option httpclose

retries 3

server s3 10.0.100.1:9091

需要注意的是backend的server后面的ip可以是集群服务的cluster ip也可以通过dns来访问,如thrift-c-app,如果是跨namespace需要完整的domain,如:

thrift-c-app.thrift-demo.svc.cluster.local:9091

Haproxy运行在K8s集群,所以不用担心haproxy的压力,可以随时扩容Pods来解决。这里有一个问题是如何把 haproxy.cfg 配置文件做成动态的,不用每次修改后还要生成Image重新启动服务,解决办法可以参考https://hub.docker.com/_/haproxy/ 的 Reloading config.

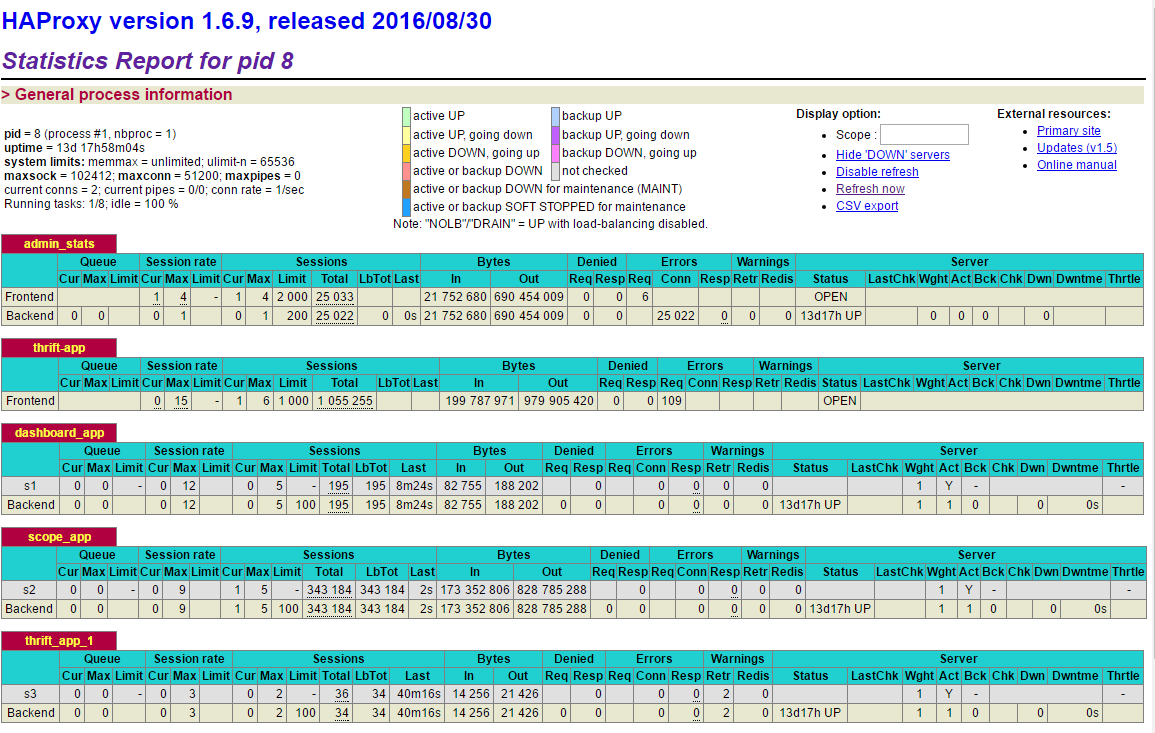

我们来看一下Haproxy的管理界面,访问http://192.196.1.160:30267/stats

测试

先配置本地的Hosts,将所有的域名都指向负载的浮动IP上

192.196.1.156 dashboard.k8s.io

192.196.1.156 scope.k8s.io

192.196.1.156 test.k8s.io

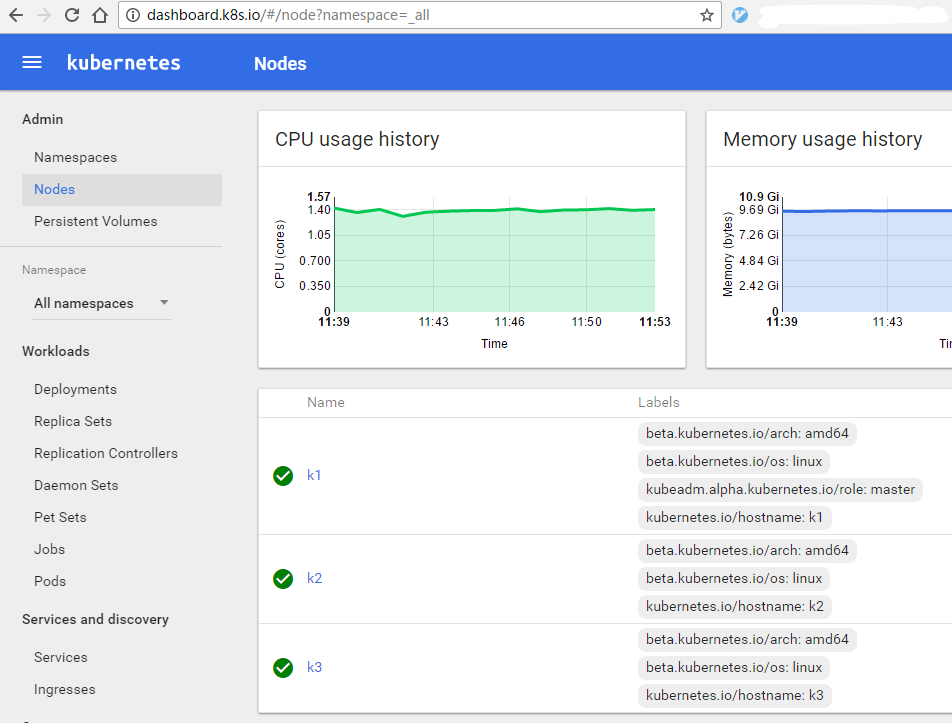

然后访问域名,如dashboard.k8s.io

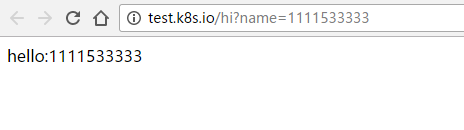

还有我们的测试服务

如预期一样,正常返回。这样所有要发布的WEB应用都通过一个端口来对外提供服务,所有集群里的云主机都可以做为负载资源,而且Haproxy本身可以扩容,目前来看不会有什么瓶颈而且用起来也比较顺手。

现在看起来一切都可以正常使用了,那还差什么呢? 想一想在并发压力大的情况下如何弹性扩容是个问题,这将在下文中讲解。

Openstack+Kubernetes+Docker微服务实践之路--服务发布的更多相关文章

- Openstack+Kubernetes+Docker微服务实践

Openstack+Kubernetes+Docker微服务实践 ..... Openstack+Kubernetes+Docker微服务实践之路--选型 posted @ 2016-11-15 ...

- Openstack+Kubernetes+Docker微服务

Openstack+Kubernetes+Docker微服务 渐入佳境,我们开始比较具体的工作,由于Docker是一个基础组件,所以本文的主题是Docker和Registry2. 底层系统基于Cent ...

- Openstack+Kubernetes+Docker微服务实践之路--基础设施

近两年微服务在网上聊的如此的如火如荼,备受关注,我在去年下半年的一个项目中也用到了阿里云的EDAS.HSF,深有体会,最近时间空闲出于好奇,决定一探究竟打算自建微服务平台,基本实现EDAS.HSF的功 ...

- Openstack+Kubernetes+Docker微服务实践之路--RPC

重点来了,本文全面阐述一下我们的RPC是怎么实现并如何使用的,跟Kubernetes和Openstack怎么结合. 在选型一文中说到我们选定的RPC框架是Apache Thrift,它的用法是在Ma ...

- Openstack+Kubernetes+Docker微服务实践之路--Kubernetes

经过几番折腾终于搞定Kubernetes了,我们要在Openstack上部署Kubernetes集群,使用最新工具Kubeadm来安装,由于不能直接访问Kubernetes的源,我们需要一台可以穿墙的 ...

- Openstack+Kubernetes+Docker微服务实践之路--选型

上一篇博文中我们选定Openstack做为我们的基础设施IAAS平台,本文将明确我们用什么技术做为微服务平台的技术选型. 经过对微服务的特性总结和添加一些个性需求后对微服务平台的基本要求 PRC远程调 ...

- Openstack+Kubernetes+Docker微服务实践之路--Docker和Registry2

渐入佳境,我们开始比较具体的工作,由于Docker是一个基础组件,所以本文的主题是Docker和Registry2. 底层系统基于Centos7,先在一台云主机上安装Docker,Docker的安装非 ...

- Openstack+Kubernetes+Docker微服务实践之路--弹性扩容

服务上线就要顶的住压力.扛的住考验,不然挨说的还是我们这帮做事的兄弟,还记得上图这个场景吗 老办法是服务集群部署,但总归有个上限,之前跟阿里合作的时候他们有个弹性计算可以通过设置CPU的阀值来动态扩展 ...

- 微服务实践之路--RPC

微服务实践之路--RPC 重点来了,本文全面阐述一下我们的RPC是怎么实现并如何使用的,跟Kubernetes和Openstack怎么结合. 在选型一文中说到我们选定的RPC框架是Apache Thr ...

随机推荐

- H5点击事件兼容各种APP浏览器

https://github.com/Clouda-team/touchjs/blob/master/touch.min.js <script src="js/jquery.min.j ...

- PHP使用OPENSSL RSA加密解密数据

加密数据有很多种方法,今天我们来看一下OPENSSL RSA的加密办法. 1.首先得安装php的openssl扩展 php -m | grep openssl 执行以上命令,确保已经安装了openss ...

- ios 配置https

一般来讲如果app用了web service , 我们需要防止数据嗅探来保证数据安全.通常的做法是用ssl来连接以防止数据抓包和嗅探 其实这么做的话还是不够的 . 我们还需要防止中间人攻击(不明白的自 ...

- Windows 服务为宿主的WCF服务,详细图解。

废话不多说,直接进入主题: 1.打开vs2010新建项目,选择Windows服务. 2.选中WindowsService右击,添加WCF服务. 3.添加成功后,为下图.将接口类ITestService ...

- Opennms 问题整理

1.网页时间显示不正确,需要修改:bin/opennms: 添加:MANAGER_OPTIONS="$MANAGER_OPTIONS -Duser.timezone=Asia/Shangha ...

- category用法

1.今天在复习之前的category的时候,遇到一个这样子的问题.查来一下,原来苹果的官方文档中有说明,苹果时不提倡我们在类别中重写原文件的内容,如果要重写,就继承他,然后重写,但是在项目中,有很多前 ...

- Drawable和Bitmap区别

Bitmap - 称作位图,一般位图的文件格式后缀为bmp,当然编码器也有很多如RGB565.RGB888.作为一种逐像素的显示对象执行效率高,但是缺点也很明显存储效率低.我们理解为一种存储对象比较好 ...

- Java程序猿学习的建议(转)

第一部分:对于尚未做过Java工作的同学,包括一些在校生以及刚准备转行Java的同学. 一.Java基础 首先去找一个Java的基础教程学一下,这里可以推荐一个地址,或者你也可以参照这个地址上去找相应 ...

- PB函数大全

PB函数大全 Abs()功能计算绝对值.语法Abs ( n )参数n:要得到绝对值的数值型变量或表达式返回值返回值的数据类型与n的数据类型相同,函数执行成功时返回n的绝对值.如果参数n的值为NULL, ...

- 超简单的JNI——NDK开发教程

不好意思各位,我按照网上一些教程进行JNI开发,折腾了半天也没成功,最后自己瞎搞搞定了,其实超简单的,网上的教程应该过时了,最新版的AS就包含了NDK编译的功能,完全不用手动javah,各种包名路径的 ...