A Statistical Model for Scientific Readability-paper

Authors:

Luo SiCarnegie Mellon University, Pittsburgh, PA

Jamie CallanCarnegie Mellon University, Pittsburgh, PA

Atlanta, Georgia, USA — October 05 - 10, 2001

ACM New York, NY, USA ©2001

数据不公开: educational Web pages ,A total of 91 Web pages。Pages were grouped into three readability levels: KindergartenGrade2, Grade3-Grade5, and Grade6-Grade8

monosyllable 单音节词

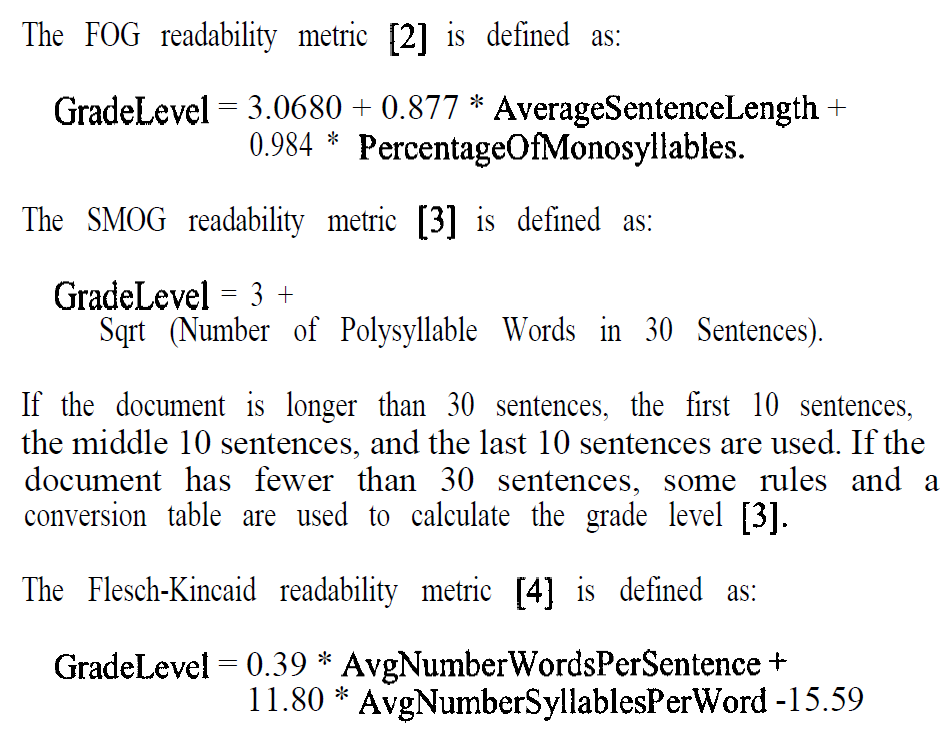

2. READABILITY METRICS

第一个是个初级中级学习者

第二个会比别的给的难度分更高

第三个用的更广

3. STATISTICAL LANGUAGE MODELS

线性模型广泛用于模型的组合,EM算法用来寻找最佳参数

线性插值公式来组合语言模型和句子长度模型:前者用ngram,后者考虑句长

1)unigram语言模型假设生成一个词的概率适合上下文无关的。虽然unigram模型在人类语言上效果不好,但是它们适合很多应用,有可以在小数据上训练的优点。

2)通过看某个特征的值是否和难度成正比或反比,来判断特征重要与否,最后得出句长特征很重要,公式法中单音节不适合该数据集;然后假设符合正态分布

4 实验

KF这种公式法只能得出最终属于哪个等级,但是我们的数据集并不含有这些等级。我们统计的方法可以给出概率这种soft metric。

-------------------------

N-Gram是基于一个假设:

第n个词出现与前n-1个词相关,而与其他任何词不相关。(这也是隐马尔可夫当中的假设。)整个句子出现的概率就等于各个词出现的概率乘积。各个词的概率可以通过语料中统计计算得到。假设句子T是有词序列w1,w2,w3...wn组成,用公式表示N-Gram语言模型如下:

P(T)=P(w1)*p(w2)*p(w3)...p(wn)=p(w1)*p(w2|w1)*p(w3|w1w2)...p(wn|w1w2w3...)

一般常用的N-Gram模型是Bi-Gram和Tri-Gram。分别用公式表示如下:

Bi-Gram:P(T)=p(w1|begin)*p(w2|w1)*p(w3|w2)...p(wn|wn-1)

Tri-Gram:P(T)=p(w1|begin1,begin2)*p(w2|w1,begin1)*p(w3|w2w1)...p(wn|wn-1,wn-2)

https://github.com/lijingpeng/kaggle/blob/master/competitions/Bag_of_Words/bags_of_words.ipynb 包含贝叶斯、回归分类

A Statistical Model for Scientific Readability-paper的更多相关文章

- machine learning model(algorithm model) .vs. statistical model

https://www.analyticsvidhya.com/blog/2015/07/difference-machine-learning-statistical-modeling/ http: ...

- Writing your first academic paper

Writing your first academic paper If you are working in academics (and you are if you are working wi ...

- The Model Complexity Myth

The Model Complexity Myth (or, Yes You Can Fit Models With More Parameters Than Data Points) An oft- ...

- A Statistical View of Deep Learning (II): Auto-encoders and Free Energy

A Statistical View of Deep Learning (II): Auto-encoders and Free Energy With the success of discrimi ...

- [转]NLP Tasks

Natural Language Processing Tasks and Selected References I've been working on several natural langu ...

- Targeted Learning R Packages for Causal Inference and Machine Learning(转)

Targeted learning methods build machine-learning-based estimators of parameters defined as features ...

- 【RNN】资源汇总

wesome Recurrent Neural Networks A curated list of resources dedicated to recurrent neural networks ...

- Lessons Learned from Developing a Data Product

Lessons Learned from Developing a Data Product For an assignment I was asked to develop a visual ‘da ...

- CVPR 2015 papers

CVPR2015 Papers震撼来袭! CVPR 2015的文章可以下载了,如果链接无法下载,可以在Google上通过搜索paper名字下载(友情提示:可以使用filetype:pdf命令). Go ...

随机推荐

- 剑指offer(56)删除链表中重复的节点

一直忘记更新了,把剑指offer更新完吧.... 题目描述 在一个排序的链表中,存在重复的结点,请删除该链表中重复的结点,重复的结点不保留,返回链表头指针. 例如,链表1->2->3-&g ...

- Java基础学习-常用的dos命令

打开控制台(win+R,然后cmd回车) 常用命令: d:回车 盘符切换 dir(directory):列出当前目录下的文件以及文件夹 cd( ...

- 关于乱码(MessyCode)问题

乱码本质:读取二进制时采用的编码和最初将字符转成二进制时的编码不一致 编码时(得二进制数组时)不抛出异常,数据就不会被破坏 Java关于乱码(MessyCode)问题 Java使用的是Unicode编 ...

- Learning-Python【18】:Python常用模块(1)—— time、datetime、randrom

time 模块:与时间相关的功能的模块 在 Python 中,时间分为三种: 1.时间戳:是一个时间的表示,根据不同的语言,可以是整数或浮点数,是从1970年1月1日0时0分0秒到现在经历的秒数 2. ...

- 基于虹软的Android的人脸识别SDK使用测试

现在有很多人脸识别的技术我们可以拿来使用:但是个人认为还是离线端的SDK比较实用:所以个人一直在搜集人脸识别的SDK:原来使用开源的OpenCV:最近有个好友推荐虹软的ArcFace, 闲来无事就下来 ...

- HashMap 和 HashTable差别

代码版本 JDK每一版本都在改进.本文讨论的HashMap和HashTable基于JDK 1.7.0_67.源码见这里 1. 时间 HashTable产生于JDK 1.1,而HashMap产生于JDK ...

- HihoCoder - 1142 ,三分入门

先来说说三分的思想: 从三分法的名字中我们可以猜到,三分法是对于需要逼近的区间做三等分: 我们发现lm这个点比rm要低,那么我们要找的最小点一定在[left,rm]之间.如果最低点在[rm,right ...

- Police Stations CodeForces - 796D (bfs)

大意: 给定树, 有k个黑点, 初始满足条件:所有点到最近黑点距离不超过d, 求最多删除多少条边后, 使得原图仍满足条件. 所有黑点开始bfs, 贪心删边. #include <iostream ...

- SWUST OJ(957)

逆置单链表 #include <stdio.h> #include <stdlib.h> typedef struct LNode { char data; struct LN ...

- weex中css不能使用子元素选择器

weex中css不能使用子元素选择器 刚入手可能会有错误,有误导地方请谅解,不过都是亲身踩坑