recurrent model for visual attention

paper url: https://papers.nips.cc/paper/5542-recurrent-models-of-visual-attention.pdf

year: 2014

abstract

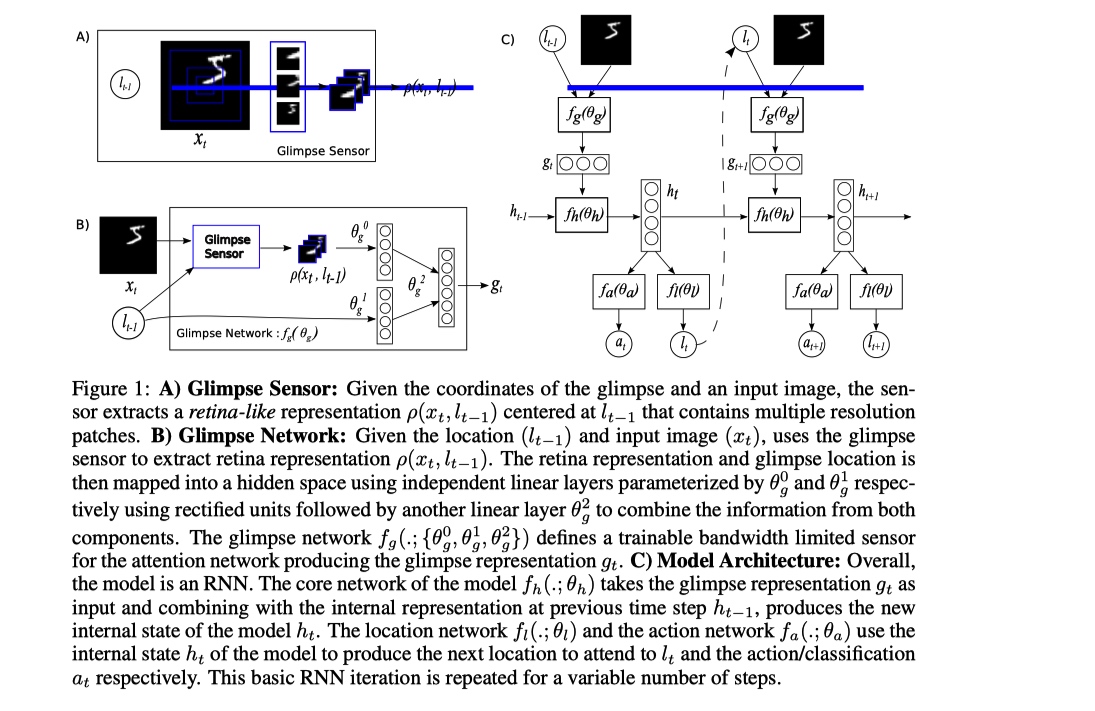

这篇文章出发点是如何减少图像相关任务的计算量, 提出通过使用 attention based RNN 模型建立序列模型(recurrent attention model, RAM), 每次基于上下文和任务来适应性的选择输入的的 image patch, 而不是整张图片, 从而使得计算量独立于图片大小, 从而缓解 CNN 模型中计算量与输入图片的像素数成正比的缺点. 该文通过强化学习的方式来学习任务明确的策略, 从而解决模型是不可微的问题.

RAM 模型在几个图像分类任务上,在处理杂乱图像(cluttered images)时, 它明显优于基于CNN的模型,并且在动态视觉控制问题上,无需明确的训练信号, 它就能学习跟踪一个简单的对象。

introduction

该文将注意力问题视为与视觉环境交互时以目标为导向的序列决策过程。

人类感知的一个重要特性是人们不会倾向于一次完整地处理整个场景。 相反,人们将注意力有选择地集中在视觉空间的某些部分,以便在需要的时间和地点获取信息,并随着时间的推移组合来自不同固定位置(fixation)的信息,以建立场景的内部表示,指导下一步眼睛看下哪里以及决策。 将计算资源聚焦在场景的各部分上节省了“带宽”,因为需要处理的“像素”更少。 但它也大大降低了任务复杂性,因为感兴趣的对象可以置于固定位置(fixation)的中心,并且固定区域外的视觉环境(“混乱”)的不相关特征自然被忽略。

model architecture

thought

这篇论文时间比较早, 在当时 CNN backbone 以及目标检测的发展和现在相比相差太多. 在解决 CNN 的计算量问题上, 通过不输出整张图片, 而是利用 RNN 模型建模, 然后使用 attention+强化算法 来决定序列每一个阶段模型看向图片的哪一个 patch, 从而获取与任务相关的关键信息, 过滤掉了无关信息, 从而使得模型计算量独立于图片的输入尺寸, 减小计算量.

利用 RNN 模型来进行视觉任务特征提取, 对于我个人来说是很新颖的思想. 个人觉得, 就视觉 attention 来说, 我感觉不将整张图片作为输入, 而是每次只送入 image patch 的做法是当时妥协的产物. 我觉的视觉 attention 只有在获取全局信息之后, 然后才能基于相关性, 选择的关注一些相关性高的区域来提升处理效率. 如果一开始就是盲人摸象, 我不知道该如何相信系统的决策, ps:个人不了解强化学习相关知识.

总之, 思想很新, 但是实现过于复杂, 而且这种基于局部信息的 attention 感觉并不可靠.

recurrent model for visual attention的更多相关文章

- 论文笔记之: Recurrent Models of Visual Attention

Recurrent Models of Visual Attention Google DeepMind 模拟人类看东西的方式,我们并非将目光放在整张图像上,尽管有时候会从总体上对目标进行把握,但是也 ...

- A Survey of Visual Attention Mechanisms in Deep Learning

A Survey of Visual Attention Mechanisms in Deep Learning 2019-12-11 15:51:59 Source: Deep Learning o ...

- A Model of Saliency-Based Visual Attention for Rapid Scene Analysis

A Model of Saliency-Based Visual Attention for Rapid Scene Analysis 题目:A Model of Saliency-Based Vis ...

- 图像显著性论文(一)—A Model of saliency Based Visual Attention for Rapid Scene Analysis

这篇文章是图像显著性领域最具代表性的文章,是在1998年Itti等人提出来的,到目前为止引用的次数超过了5000,是多么可怕的数字,在它的基础上发展起来的有关图像显著性论文更是数不胜数,论文的提出主要 ...

- 论文笔记之:Multiple Object Recognition With Visual Attention

Multiple Object Recognition With Visual Attention Google DeepMind ICRL 2015 本文提出了一种基于 attention 的用 ...

- paper 27 :图像/视觉显著性检测技术发展情况梳理(Saliency Detection、Visual Attention)

1. 早期C. Koch与S. Ullman的研究工作. 他们提出了非常有影响力的生物启发模型. C. Koch and S. Ullman . Shifts in selective visual ...

- 论文笔记:Show, Attend and Tell: Neural Image Caption Generation with Visual Attention

Show, Attend and Tell: Neural Image Caption Generation with Visual Attention 2018-08-10 10:15:06 Pap ...

- visual attention

The visual attention mechanism may have at least the following basic components [Tsotsos, et. al. 19 ...

- Paper Reading - Show, Attend and Tell: Neural Image Caption Generation with Visual Attention ( ICML 2015 )

Link of the Paper: https://arxiv.org/pdf/1502.03044.pdf Main Points: Encoder-Decoder Framework: Enco ...

随机推荐

- Neutron Vlan Network 学习

vlan network 是带 tag 的网络,是实际应用最广泛的网络类型. 下图是 vlan100 网络的示例. 1. 三个 instance 通过 TAP 设备连接到名为 brqXXXX ...

- linux系统docker版本升级或安装

如果存在旧版本,则先卸载 最好先将镜像导出保存,以免升级后丢失或者无法使用 如有正在运行的容器,先停止 $ docker ps -q | xargs docker stop 关闭docker服务 $ ...

- tomcat 进程莫名停止

背景: 有一次晚上下班,发完版,刚把电脑合上走到楼下,就接到报警,说是线上有一个tomcat进程不存在了,想着以为是误报,但是还是回去看看了,发现线上确实是刚才发版的项目,进程不存在了,想了想,刚才测 ...

- FJUTOJ-周赛2016-12-16

注:fjutoj基本每周都有一次周赛,欢迎大家都来参加! 网址:http://59.77.139.92/index.jsp A题:来源 POJ 2773 题意:给两个数m和k,问第k 个和m 互素的数 ...

- git bash 连接github并提交项目工程

借鉴博客:https://www.cnblogs.com/flora5/p/7152556.html https://blog.csdn.net/heng_yan/article/details/79 ...

- Flask--偏函数, 线程安全, 请求上下文

一 . 偏函数 from functools import partial def func(a, b): return a + b new_func = partial(func, 3, 4) # ...

- axios delete请求 参数

内容转载作者:https://www.cnblogs.com/pangguoming/p/8994742.html 如果服务端将参数当做 java对象来封装接收则 参数格式为:{data: param ...

- maven使用中的问题

1.修改maven的settings.xml后,idea中配置文件指向发生了变化,指向了默认.如果maven配置文件中不是默认的,则需要根据配置文件进行修改.最好在File-Other Setting ...

- Spring MVC 使用介绍(十三)数据验证 (一)基本介绍

一.消息处理功能 Spring提供MessageSource接口用于提供消息处理功能: public interface MessageSource { String getMessage(Strin ...

- linux软连接文件的copy

最近在做项目的时候遇到过一个问题:当copy一个工程模块时发现里面的目录文件有重复定义的情况. 最后查看源文件目录发现是存在软连接造成的. 出现这种情况的原因是:当直接copy文件目录时遇到软连接会把 ...