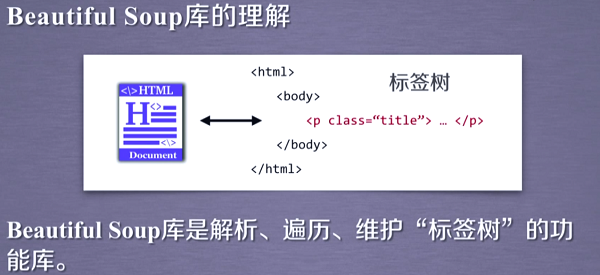

网络爬虫BeautifulSoup库的使用

使用BeautifulSoup库提取HTML页面信息

#!/usr/bin/python3

import requests

from bs4 import BeautifulSoup url='http://python123.io/ws/demo.html'

r=requests.get(url)

if r.status_code==:

print('网络请求成功') demo=r.text

soup=BeautifulSoup(demo,'html.parser')

print(soup.prettify())

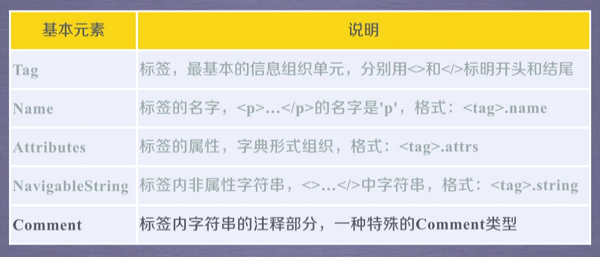

BeautifulSoup类的基本属性

#!/usr/bin/python3

import requests

from bs4 import BeautifulSoup url='http://python123.io/ws/demo.html'

r=requests.get(url)

if r.status_code==:

print('网络请求成功') demo=r.text

soup=BeautifulSoup(demo,'html.parser')

tag_title=soup.title

print(tag_title)

tag_a_attrs=soup.a.attrs

print(soup.p.string)

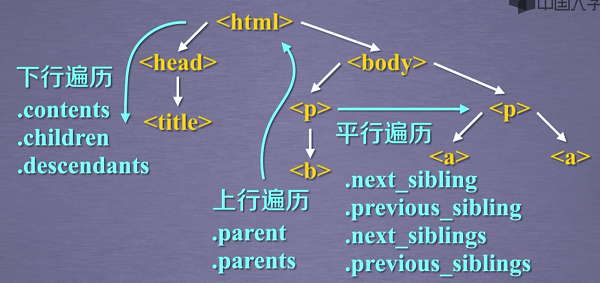

标签树的下行遍历

#!/usr/bin/python3

import requests

from bs4 import BeautifulSoup url='http://python123.io/ws/demo.html'

r=requests.get(url)

if r.status_code==200:

print('网络请求成功') demo=r.text

soup=BeautifulSoup(demo,'html.parser') print(soup.prettify())

print('我是分割线'.center(80,'-'))

#遍历子节点 for child in soup.body.children:

print(child)

#遍历子孙节点

for descendant in soup.body.descendants:

print(descendant)

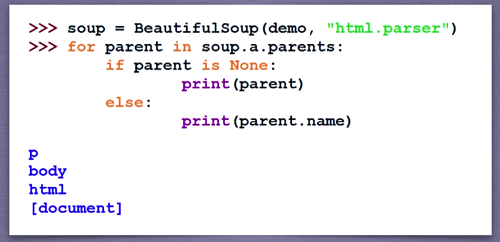

标签树的上行遍历

遍历title标签的上一级标签

print(soup.title.parent)

#a标签的下一标签

print(soup.a.next_sibling)

遍历a标签的所有前序节点以及后续节点

#遍历a标签的前序节点

for sibling in soup.a.next_siblings:

print(sibling)

#遍历a标签的前序节点

for sibling in soup.a.previous_siblings:

print(sibling)

soup标签的上一级标签为空,所以要进行判断

网络爬虫BeautifulSoup库的使用的更多相关文章

- Python爬虫-- BeautifulSoup库

BeautifulSoup库 beautifulsoup就是一个非常强大的工具,爬虫利器.一个灵活又方便的网页解析库,处理高效,支持多种解析器.利用它就不用编写正则表达式也能方便的实现网页信息的抓取 ...

- 2.03_01_Python网络爬虫urllib2库

一:urllib2库的基本使用 所谓网页抓取,就是把URL地址中指定的网络资源从网络流中抓取出来.在Python中有很多库可以用来抓取网页,我们先学习urllib2. urllib2 是 Python ...

- Python网络爬虫——BeautifulSoup4库的使用

使用requests库获取html页面并将其转换成字符串之后,需要进一步解析html页面格式,提取有用信息. BeautifulSoup4库,也被成为bs4库(后皆采用简写)用于解析和处理html和x ...

- [爬虫] BeautifulSoup库

Beautiful Soup库基础知识 Beautiful Soup库是解析xml和html的功能库.html.xml大都是一对一对的标签构成,所以Beautiful Soup库是解析.遍历.维护“标 ...

- python爬虫BeautifulSoup库class_

因为class是python的关键字,所以在写过滤的时候,应该是这样写: r = requests.get(web_url, headers=headers) # 向目标url地址发送get请求,返回 ...

- 网络爬虫--requests库中两个重要的对象

当我们使用resquests.get()时,返回的时response的对象,他包含服务器返回的所有信息,也包含请求的request的信息. 首先: response对象的属性有以下几个, r.stat ...

- 网络爬虫必备知识之urllib库

就库的范围,个人认为网络爬虫必备库知识包括urllib.requests.re.BeautifulSoup.concurrent.futures,接下来将结合爬虫示例分别对urllib库的使用方法进行 ...

- 网络爬虫必备知识之requests库

就库的范围,个人认为网络爬虫必备库知识包括urllib.requests.re.BeautifulSoup.concurrent.futures,接下来将结对requests库的使用方法进行总结 1. ...

- 网络爬虫必备知识之concurrent.futures库

就库的范围,个人认为网络爬虫必备库知识包括urllib.requests.re.BeautifulSoup.concurrent.futures,接下来将结对concurrent.futures库的使 ...

随机推荐

- [PHP] sys_get_temp_dir()和tempnam()函数报错与环境变量的配置问题

1.项目运行过程中遇到个问题,保存临时文件时,一直返回false 2.根据经验这个是在/tmp目录下建立临时文件,所以检查了一遍权限问题,发现权限没有问题 3.查出sys_get_temp_dir() ...

- 1.JAVA-Hello World

1.Java开发介绍 J2SE:Java 2 Platform Standard Edition(2005年之后更名为JAVA SE). 包含构成Java语言核心的类.比如:数据库连接.接口定义.数据 ...

- weblogic816 bug list

weblogic816在aix下的补丁汇总: 严重 Patch 8173326,weblogic server挂起,threaddump显示SERVER HANGS TRYING TO CALL LO ...

- Andorid之页面布局优化

文章大纲 一.为什么要进行页面布局优化二.页面布局优化实操三.项目源码下载四.参考文章 一.为什么要进行页面布局优化 在开发Android时,会遇到某些是通用的布局,我们常将一些通用的视图提取到一 ...

- win7下建立超级隐藏账户

win7下建立超级隐藏账户 实验目的: 隐藏用户,不让管理员简单的发现 隐藏方法: 1.命令提示符中创建隐藏账户这种方法只能将账户在"命令提示符"中进行隐藏,而对于"计算 ...

- Visual Studio Code快速删除空行及几个常用快捷键总结

在使用notepad++工具的时候,很多情况下我们会遇到批量替换空行的操作,之前的操作方法是快捷键Crtl+h调出窗口选择替换栏,在查找目标栏中输入\r\n\r\n,替换为 栏中输入\r\n并选择全部 ...

- Windows Server 2016-Hyper-V HNV 新增功能

本内容主要介绍了Hyper-V 网络虚拟化 (HNV) 功能在 Windows Server 2016 中的新增或更改内容,具体信息如下: HNV更新 功能中的功能 新的或改进 描述 可编程 Hype ...

- 快速构建H5单页面切换应用

在Web App和Hybrid App横行的时代,为了拥有更好的用户体验,单页面应用顺势而生,单页面应用简称`SPA`,即Single Page Application,就是只有一个HTML页面的应用 ...

- Java三种方式实现栈和队列

栈:LIFO(后进先出) 队列:FIFO(先进先出) 1.栈:LIFO(后进先出) 1.1.栈的顺序存储结构实现: /** * 基于数组实现的顺序栈 * @param <E> */ pub ...

- 八问WebSocket协议:为你快速解答WebSocket热门疑问

一.引言 WebSocket是一种比较新的协议,它是伴随着html5规范而生的,虽然还比较年轻,但大多主流浏览器都已经支持.它使用方面.应用广泛,已经渗透到前后端开发的各种场景中. 对http一问一答 ...