Apache Flink 简单安装

流计算这两年很火了,可能对数据的实时性要求高。现在用的hadoop框架,对流计算的支持,主要还是微批(spark),也不支持“Exactly Once”语义(可以使用外接的数据库解决),公司项目可能会用所以就下载了个Flink试试。

1. 下载解压

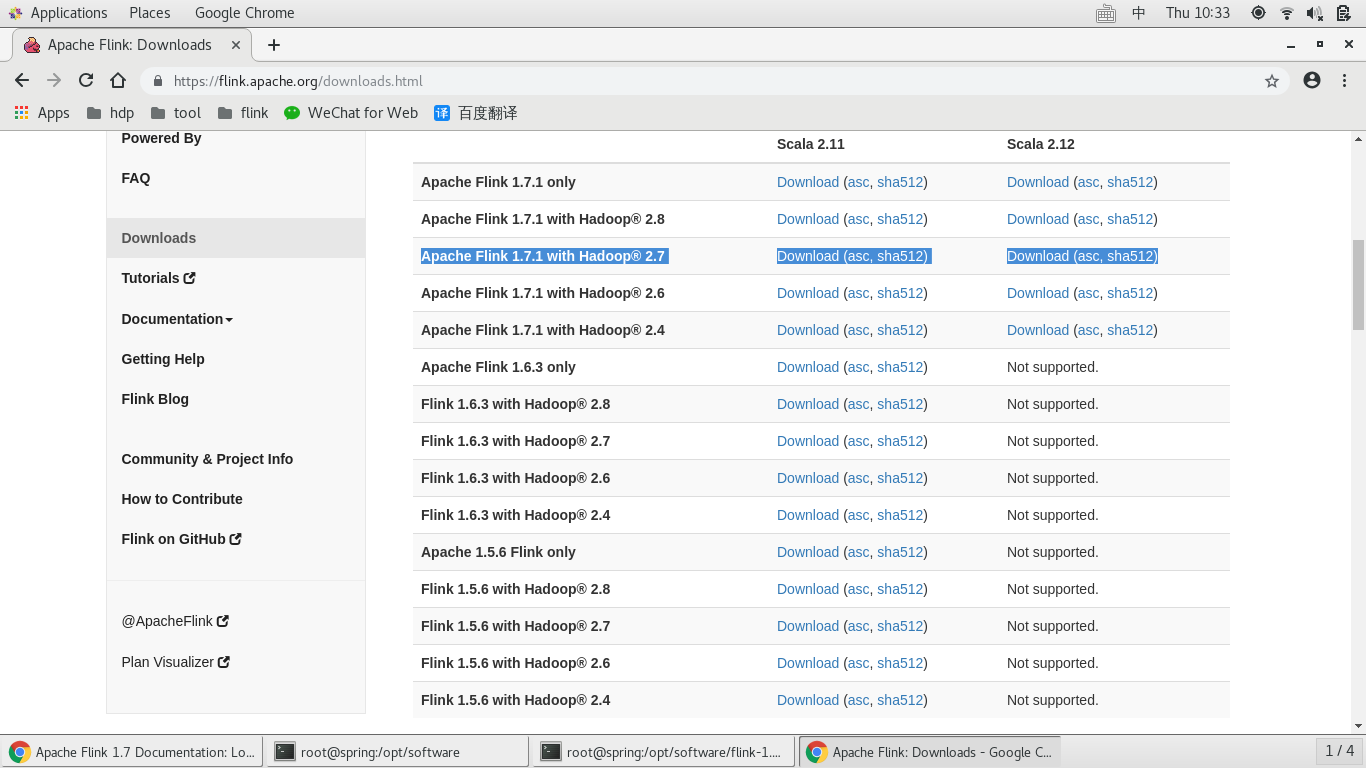

打开官网:https://flink.apache.org/, “DOWNLOAD”,下载对应 hadoop 和scala 版本。Flink以来JDK和HADOOP,提前下载。

[root@spring software]# wget http://mirrors.tuna.tsinghua.edu.cn/apache/flink/flink-1.7.1/flink-1.7.1-bin-hadoop27-scala_2.12.tgz

[root@spring software]# tar -zxvf flink-1.7.-bin-hadoop27-scala_2..tgz

[root@spring software]# ll

total

drwxrwxrwx venn venn Dec : flink-1.7.

-rw-r--r-- root root Dec : flink-1.7.-bin-hadoop27-scala_2..tgz

drwxr-xr-x. Apr jdk1.

-rw-r--r--. root root Dec : jdk-8u91-linux-x64.tar.gz

2. 配置

官网教程: https://ci.apache.org/projects/flink/flink-docs-release-1.7/tutorials/local_setup.html

在bin/config.sh 是Flink 的配置文件,但是不需要配置,只需要有配置JAVA_HOME, HADOOP_HOME ( 或者HADOOP_CONF_DIR)

export JAVA_HOME=/opt/software/jdk1.

export CLASSPATH=.:$JAVA_HOME/lib

export PATH=$JAVA_HOME/bin:$PATH

export HADOOP_HOME=/etc/hadoop

export HADOOP_CONF_DIR=/etc/hadoop/conf [root@spring bin]# source /etc/profile

[root@spring bin]# echo $HADOOP_CONF_DIR

/etc/hadoop/conf

[root@spring bin]# echo $HADOOP_HOME

/etc/hadoop

[root@spring bin]# echo $JAVA_HOME

/opt/software/jdk1.

config.sh

KEY_ENV_JAVA_HOME="env.java.home" # java使用环境变量 # Check if deprecated HADOOP_HOME is set, and specify config path to HADOOP_CONF_DIR if it's empty. # 读取环境变量 HADOOP_HOME HADOOP_CONF_DIR

if [ -z "$HADOOP_CONF_DIR" ]; then

if [ -n "$HADOOP_HOME" ]; then

# HADOOP_HOME is set. Check if its a Hadoop .x or .x HADOOP_HOME path

if [ -d "$HADOOP_HOME/conf" ]; then

# its a Hadoop .x

HADOOP_CONF_DIR="$HADOOP_HOME/conf"

fi

if [ -d "$HADOOP_HOME/etc/hadoop" ]; then

# Its Hadoop 2.2+

HADOOP_CONF_DIR="$HADOOP_HOME/etc/hadoop"

fi

fi

fi # try and set HADOOP_CONF_DIR to some common default if it's not set

if [ -z "$HADOOP_CONF_DIR" ]; then

if [ -d "/etc/hadoop/conf" ]; then

echo "Setting HADOOP_CONF_DIR=/etc/hadoop/conf because no HADOOP_CONF_DIR was set."

HADOOP_CONF_DIR="/etc/hadoop/conf"

fi

fi

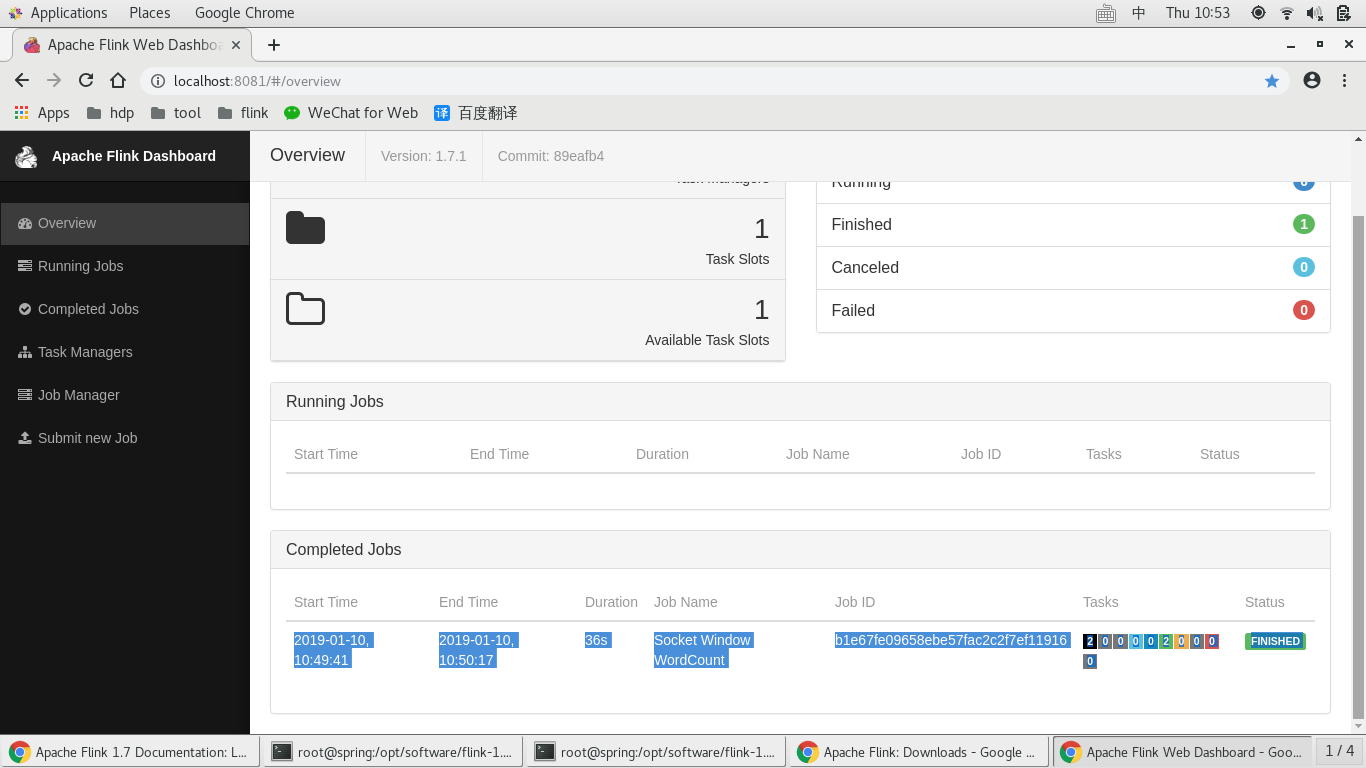

4. 流计算demo wordcount

使用nc 模拟输入流,输入数据

[root@spring log]# nc -l ...

启动wordcount demo

[root@spring flink-1.7.]# ./bin/flink run examples/streaming/SocketWindowWordCount.jar --port

Starting execution of program

nc输入继续输入数据。。。

"ctrl + C" 关闭nc,wordcount demo 随之关闭。

trewt

re

w

^C # kill nc

[root@spring log]# # wordcount 完成

[root@spring flink-1.7.]# ./bin/flink run examples/streaming/SocketWindowWordCount.jar --port

Starting execution of program

Program execution finished

Job with JobID b1e67fe09658ebe57fac2c2f7ef11916 has finished.

Job Runtime: ms

查看统计结果:

[root@spring flink-1.7.]# more -f log/flink-root-taskexecutor-2-spring.hadoop.out # 第一次执行是 0

:

qq :

:

tyr :

tre :

o :

i :

u :

y :

t :

r :

e :

w :

q :

:

:

:

:

:

:

:

:

:

rew :

:

:

:

trew :

fds :

:

其 :

rfd :

其q :

fdsgfd :

trewtg :

raq :

dfs :

eh :

r :

wyht :

re :

rds :

g :

fgrd :

ygtre :

fretg :

trewt :

erw :

wtg :

gre :

ds :

fv :

:

gfr :

t :

ghrw :

s :

gvdf :

d :

wg :

er :

wt :

re :

rewt :

redwg :

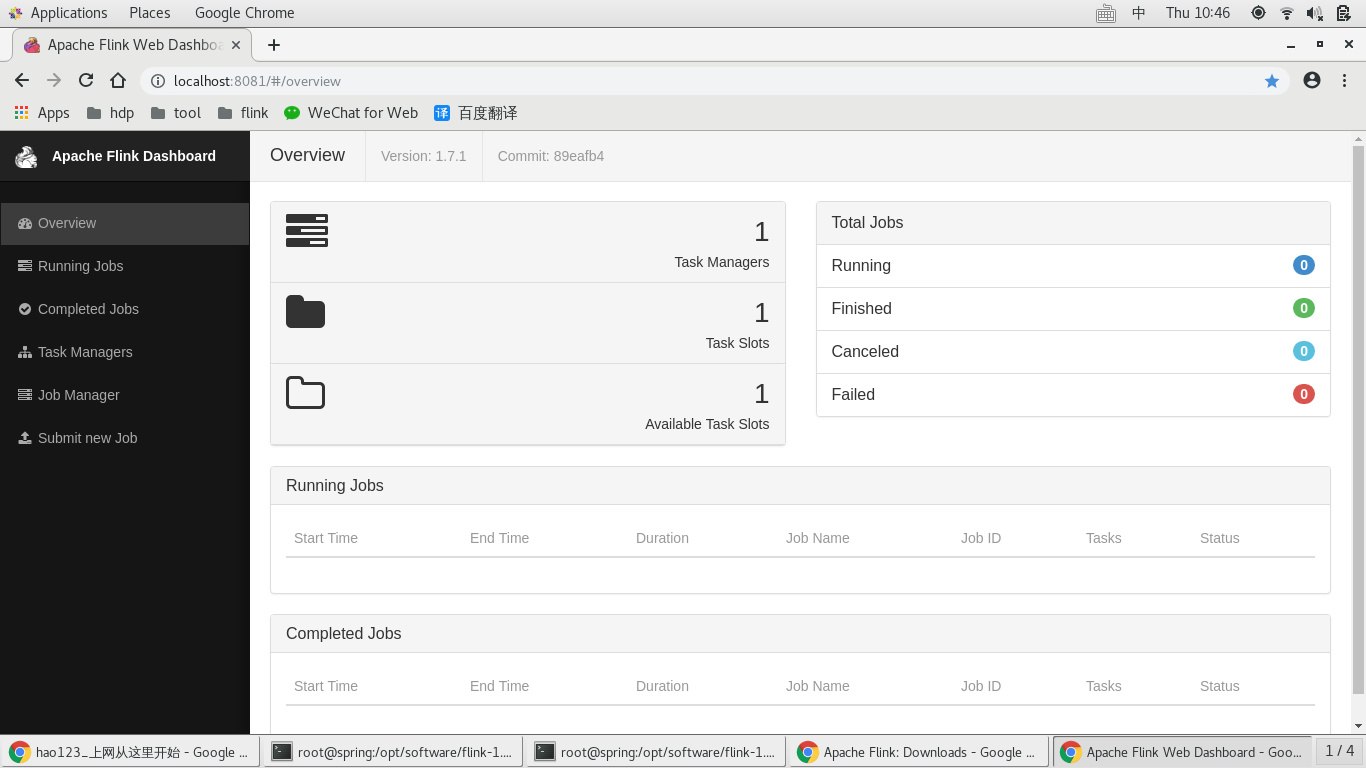

查看管理控制台

本文所有内容来自官网教程,本地执行,https://ci.apache.org/projects/flink/flink-docs-release-1.7/tutorials/local_setup.html

搞定

Apache Flink 简单安装的更多相关文章

- Apache Flink教程----安装初体验

1.window 版本安装 https://flink.apache.org/downloads.html#apache-flink-164 D:\flink-1.6.2-bin-scala_2\fl ...

- redhat 7.6 apache 服务简单安装-01

rpm -qa | grep httpd //该命令查看apache是否安装,下面图片是已安装,未安装不会显示任何内容 yum install httpd -y ...

- Apache Spark简单介绍、安装及使用

Apache Spark简介 Apache Spark是一个高速的通用型计算引擎,用来实现分布式的大规模数据的处理任务. 分布式的处理方式可以使以前单台计算机面对大规模数据时处理不了的情况成为可能. ...

- web服务的简单介绍及apache服务的安装

一,web服务的作用: 是指驻留于因特网上某种类型计算机的程序,可以向浏览器等Web客户端提供文档.可以放置网站文件,让全世界浏览: 可以放置数据让全世界下载.目前最主流的三个Web服务器是Ap ...

- centos7.2安装apache比较简单,直接上代码

centos7.2安装apache比较简单,直接上代码 1.安装 yum install httpd 2.启动apache systemctl start httpd.service 3. ...

- Apache Flink

Flink 剖析 1.概述 在如今数据爆炸的时代,企业的数据量与日俱增,大数据产品层出不穷.今天给大家分享一款产品—— Apache Flink,目前,已是 Apache 顶级项目之一.那么,接下来, ...

- 新一代大数据处理引擎 Apache Flink

https://www.ibm.com/developerworks/cn/opensource/os-cn-apache-flink/index.html 大数据计算引擎的发展 这几年大数据的飞速发 ...

- Apache Flink系列(1)-概述

一.设计思想及介绍 基本思想:“一切数据都是流,批是流的特例” 1.Micro Batching 模式 在Micro-Batching模式的架构实现上就有一个自然流数据流入系统进行攒批的过程,这在一定 ...

- 深入理解Apache Flink

Apache Flink(下简称Flink)项目是大数据处理领域最近冉冉升起的一颗新星,其不同于其他大数据项目的诸多特性吸引了越来越多人的关注.本文将深入分析Flink的一些关键技术与特性,希望能够帮 ...

随机推荐

- VC使用双缓冲制作绘图控件

最近用VC做了一个画图的控件.控件在使用的时候遇到点问题.在控件里画了图之后切换到其他页面,等再切换回来的时候,发现控件里画的图都不见了.这是因为VC里面,当缩小.遮挡页面后客户区域就会失效,当再次显 ...

- JS里的<!-- //--> 注释有什么作用

早期浏览器有很多种(目前很少了),对HTML的解释也不同.有种纯文本浏览器,只“翻译”文本内容,并只支持少量HTML标签.对交互式的代码视同纯文本.因此,我们称其为不支持javascript的浏览器( ...

- Laravel 5.3 单用户登录的简单实现

需求 一个用户不能重复登录. 后登录者可以踢掉前者. 设计思路: 核心概念 用户ID: 是用户表主键 singleToken 算法: singleToken = md5(用户IP + 用户ID + 登 ...

- Redis读超时排查

现象:STORM UI中发现bolt中有failed,异常日志抛异常read time out 业务场景:storm读写redis. 查看redis日志发现,正常情况下 每隔2小时都会有超时的异常抛出 ...

- 这可能是史上最全的windows10装ubuntu双系统教程

一. 先搞清楚自己电脑的类型: A MBR传统bios+单硬盘 B MBR传统bios+双硬盘(SSD固态硬盘+机械硬盘) C UEFI新式bios+单硬盘 D UEFI新式bios+双硬盘( ...

- Win10 远程桌面连接出现“要求的函数不受支持”的解决办法之修改注册表

问题起因 笔者自己在阿里云上搞服务器,有一台 Windows Server 必须通过远程桌面连接来管理,由于没能完全关掉 Win10 自带的烦人的系统更新,导致昨天安装完更新后出现了连接远程桌面时“要 ...

- jquery cdn bootstrap静态资源库问题

使用微软静态资源库 <script src="http://ajax.aspnetcdn.com/ajax/jquery/jquery-1.9.0.min.js">&l ...

- pip安装scrapy出错解决措施

安装报错提示: building 'twisted.test.raiser' extensionerror: Microsoft Visual C++ 14.0 is required. Get it ...

- 设计模式之jdk动态代理模式、责任链模式-java实现

设计模式之JDK动态代理模式.责任链模式 需求场景 当我们的代码中的类随着业务量的增大而不断增大仿佛没有尽头时,我们可以考虑使用动态代理设计模式,代理类的代码量被固定下来,不会随着业务量的增大而增大. ...

- Git冲突标记介绍

<<<<<<< head 是指你本地的分支的 <<<<<<< HEADb789=======b45678910> ...