BS4爬取豆瓣电影

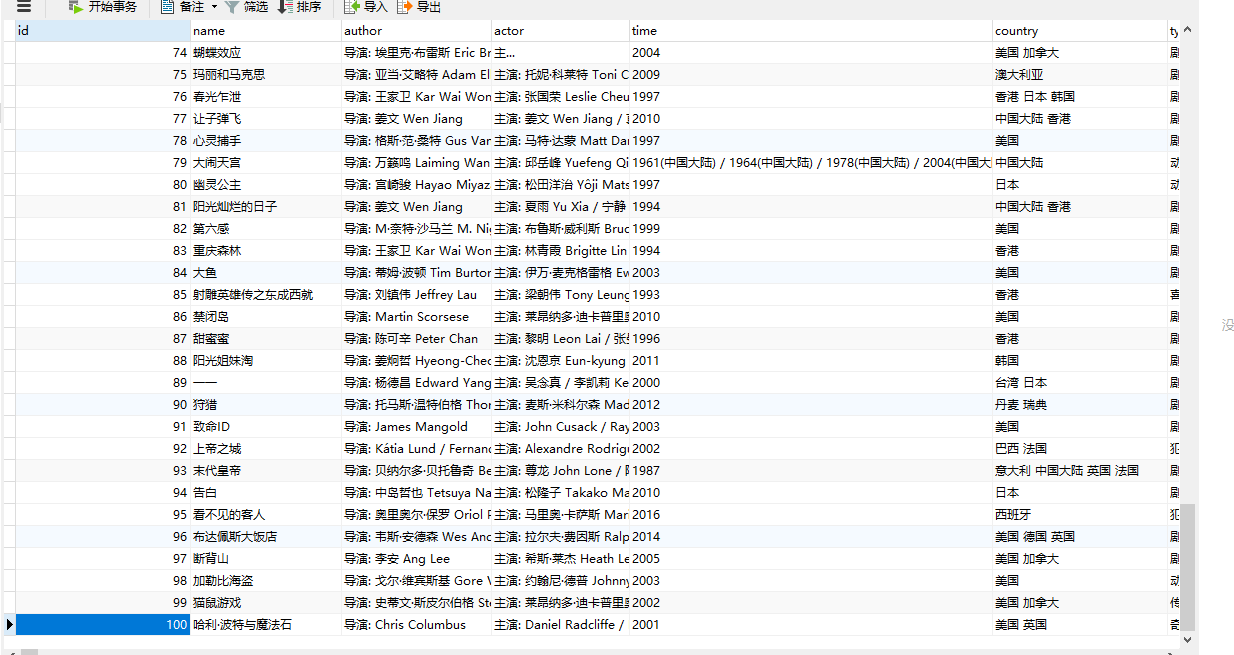

爬取豆瓣top250部电影

####创建表:

#connect.py

from sqlalchemy import create_engine

# HOSTNAME='localhost'

# PORT='3306'

# USERNAME='root'

# PASSWORD='123456'

# DATABASE='douban'

db_url='mysql+pymysql://root:123456@localhost:3306/douban?charset=utf8'

engine=create_engine(db_url)

#创建映像

from sqlalchemy.ext.declarative import declarative_base

Base=declarative_base(engine)

#创建会话

from sqlalchemy.orm import sessionmaker

Session=sessionmaker(engine)

session=Session()

##################创建表

from sqlalchemy import Column,String,Integer,DateTime

from datetime import datetime

class Douban(Base):

__tablename__='douban'

id=Column(Integer,primary_key=True,autoincrement=True)

name=Column(String(50))

author=Column(String(100),nullable=True)

actor=Column(String(100))

time=Column(String(50))

country=Column(String(100))

type=Column(String(100))

createtime=Column(DateTime,default=datetime.now)

def __repr__(self):

return '<Douban(id=%s,name=%s,author=%s,actor=%s,time=%s,country=%s,type=%s,createtime=%s)>'%(

self.id,

self.name,

self.author,

self.actor,

self.time,

self.country,

self.type,

self.creatime

)

if __name__=='__main__':

Base.metadata.create_all()

# user=Douban()

# user.type='你好'

# user.country='你'

# user.author='666'

# user.actor='你好啊'

# session.add(user)

# session.commit()

###爬取数据并保存到数据库:

#douban.py

import requests,re

from bs4 import BeautifulSoup

import time,datetime

# import pymysql

# conn=pymysql.connect(host='127.0.0.1',user='root',passwd='123456',db='mysql',charset='utf8')

# cur=conn.cursor()

# cur.execute('use douban;')

# cur.execute("insert into douban.douban(author,actor,country) VALUES('aa','bb','bb')")

# conn.commit()

#导入sqlalchemy

from connect import Douban,session

headers={'Referer':'https://movie.douban.com/explore',

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; '

'WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/55.0.2883.87 Safari/537.36'}

def get_html(x):

num = 0

for n in range(x+1):

url='https://movie.douban.com/top250?start=%s&filter='%(n*25)

html=requests.get(url,headers=headers).text

soup=BeautifulSoup(html,'lxml')

# print(type(soup))

content_all=soup.select('div[class="item"]')

for m in content_all:

num+=1

title=m.select('span[class="title"]')[0].string

print(title)

content=m.select('div[class="bd"] > p[class=""]')[0]

#返回字符串迭代器

text=content.stripped_strings

li = []

for i in text:

i=str(i)

# print(i)

li.append(i)

print(li)

#获取演员和国家列表

author_list=li[0].split('\xa0\xa0\xa0')

country_list=li[1].split('\xa0/\xa0')

# print(author_list)

# print(country_list)

#从列表取出数据

author=author_list[0]

actor=author_list[1]

time=country_list[0]

country=country_list[1]

type=country_list[2]

print(author)

print(actor)

print(time)

print(country,type+'\n\n')

print('总共获取%s' % num)

#第一种插入方式特别注意,此处用单双引号来区分内容,且%s要加引号,否则会报错

# sql="insert into douban(name,author,actor,time,country,type) VALUES('%s','%s','%s','%s','%s','%s')"%(

# title,

# author,

# actor,

# time,

# country,

# type

# )

# cur.execute(sql)

# conn.commit()

### 第二种插入方法,使用sqlalchemy插入

data=Douban(name=title,

author=author,

actor=actor,

#字符串格式需转换成日期格式

time=time,

# time=datetime.strptime(time,'%Y')

country=country,

type=type,

)

session.add(data)

session.commit()

if __name__=='__main__':

x=input('输入数字:')

x=int(x)

get_html(x)

# conn.close()

BS4爬取豆瓣电影的更多相关文章

- urllib+BeautifulSoup无登录模式爬取豆瓣电影Top250

对于简单的爬虫任务,尤其对于初学者,urllib+BeautifulSoup足以满足大部分的任务. 1.urllib是Python3自带的库,不需要安装,但是BeautifulSoup却是需要安装的. ...

- python2.7爬取豆瓣电影top250并写入到TXT,Excel,MySQL数据库

python2.7爬取豆瓣电影top250并分别写入到TXT,Excel,MySQL数据库 1.任务 爬取豆瓣电影top250 以txt文件保存 以Excel文档保存 将数据录入数据库 2.分析 电影 ...

- Python开发爬虫之静态网页抓取篇:爬取“豆瓣电影 Top 250”电影数据

所谓静态页面是指纯粹的HTML格式的页面,这样的页面在浏览器中展示的内容都在HTML源码中. 目标:爬取豆瓣电影TOP250的所有电影名称,网址为:https://movie.douban.com/t ...

- 爬取豆瓣电影排行top250

功能描述V1.0: 爬取豆瓣电影排行top250 功能分析: 使用的库 1.time 2.json 3.requests 4.BuautifulSoup 5.RequestException 上机实验 ...

- Python爬虫入门:爬取豆瓣电影TOP250

一个很简单的爬虫. 从这里学习的,解释的挺好的:https://xlzd.me/2015/12/16/python-crawler-03 分享写这个代码用到了的学习的链接: BeautifulSoup ...

- python 爬取豆瓣电影评论,并进行词云展示及出现的问题解决办法

本文旨在提供爬取豆瓣电影<我不是药神>评论和词云展示的代码样例 1.分析URL 2.爬取前10页评论 3.进行词云展示 1.分析URL 我不是药神 短评 第一页url https://mo ...

- Python爬取豆瓣电影top

Python爬取豆瓣电影top250 下面以四种方法去解析数据,前面三种以插件库来解析,第四种以正则表达式去解析. xpath pyquery beaufifulsoup re 爬取信息:名称 评分 ...

- python 爬取豆瓣电影短评并wordcloud生成词云图

最近学到数据可视化到了词云图,正好学到爬虫,各种爬网站 [实验名称] 爬取豆瓣电影<千与千寻>的评论并生成词云 1. 利用爬虫获得电影评论的文本数据 2. 处理文本数据生成词云图 第一步, ...

- scrapy爬虫框架教程(二)-- 爬取豆瓣电影TOP250

scrapy爬虫框架教程(二)-- 爬取豆瓣电影TOP250 前言 经过上一篇教程我们已经大致了解了Scrapy的基本情况,并写了一个简单的小demo.这次我会以爬取豆瓣电影TOP250为例进一步为大 ...

随机推荐

- Pandas 数据结构Dataframe:基本概念及创建

"二维数组"Dataframe:是一个表格型的数据结构,包含一组有序的列,其列的值类型可以是数值.字符串.布尔值等. Dataframe中的数据以一个或多个二维块存放,不是列表.字 ...

- POJ:2236-Wireless Network

Wireless Network Time Limit: 10000MS Memory Limit: 65536K Total Submissions: 34265 Accepted: 14222 D ...

- urllib使用一

urllib.urlopen()方法: 参数: 1.url(要访问的网页链接http:或者是本地文件file:) 2.data(如果有,就会由GET方法变为POST方法,提交的数据格式必须是appli ...

- python 发送 get post请求

GET请求: python2.7: import urllib,urllib2 url='http://192.168.199.1:8000/mainsugar/loginGET/' textmod ...

- hadoop中节点上的nodemanager一直启动不起来

当我们启动Hadoop集群的时候,发现有一台机器的nodemanager启动后自动关闭, 查看日志的时候发现有错误:yarn-root-nodemanager-log 解决办法: netstat a ...

- dynamic基元类型与隐式类型的局部变量var

dynamic代码示例 using System; using System.Collections.Generic; using System.Linq; using System.Text; na ...

- 【Python】python内置函数、列表生成式、生成器

一.内置函数 1 print(all([1,2,3,4]))#判断可迭代的对象里面的值是否都为真 2 print(any([0,1,2,3,4]))#判断可迭代的对象里面的值是否有一个为真 3 pri ...

- glance上传镜像

glance image-create --name "centos68-test" --file centos68.dsk \ --disk-format raw --conta ...

- python 由递归的dict构建树的画图代码

createPlot(mytree)方法实现. 其中myTree是一个字典,调用retrieveTree(0)可以获得一个字典的样式. Last login: Thu Feb 23 19:07:53 ...

- ci重写 配置文件

server { listen 80; #listen [::]:80; server_name wangyongshun.xyz www.wangyongshun.xyz; index index. ...