Hive(笔记)

(2015.07.22Hive笔记)

一、Hive的安装

1.1Hive的安装过程

下载hive源文件(apache-hive-0.14.0-bin.tar.gz )

解压hive文件

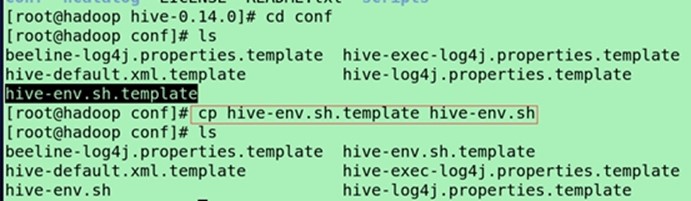

进入$HIVE_HOME/conf/修改文件

cp hive-env.sh.template hive-env.sh

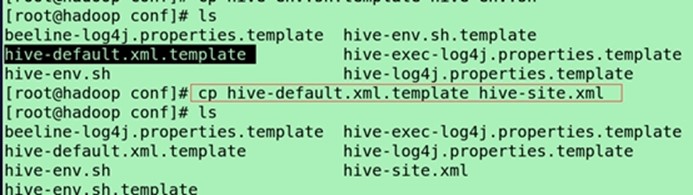

cp hive-default.xml.template(模板文档,提供了hive很多参数) hive-site.xml

修改$HIVE_HOME/conf的hive-env.sh,增加以下三行

export JAVA_HOME=/usr/local/jdk1.7.0_45

export HIVE_HOME=/usr/local/hive-0.14.0

export HADOOP_HOME=/usr/local/hadoop-2.6.0

配置MySQL的metastore

修改$HIVE_HOME/conf/hive-site.xml

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://192.168.1.101:3306/hive?

createDatabaseIfNotExist=true</value>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>(lib目录下默认没有驱动,需要自己下载mysql-connector-java-5.1.10.jar,因为自带了derby-10.10.1.1.jar,能启动derby数据库)

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>hive</value>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>hive</value>

</property>

<property>

<name>hive.querylog.location</name>

<value>/usr/local/hive-0.14.0/tmp</value>

</property>

<property>

<name>hive.exec.local.scratchdir</name>

<value>/usr/local/hive-0.14.0/tmp</value>

</property>

<property>

<name>hive.downloaded.resources.dir</name>

<value>/usr/local/hive-0.14.0/tmp</value>

</property>

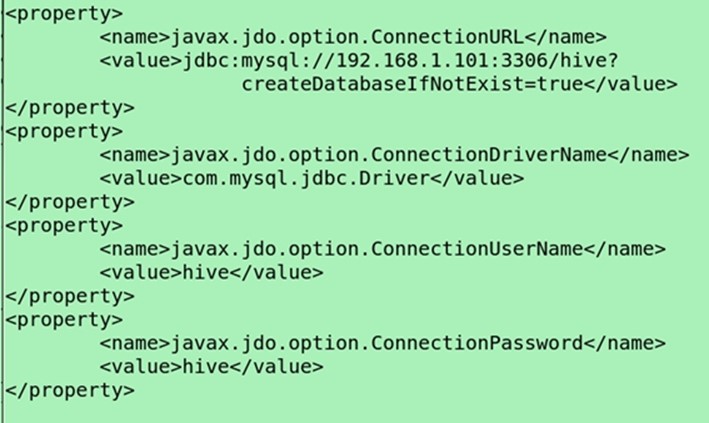

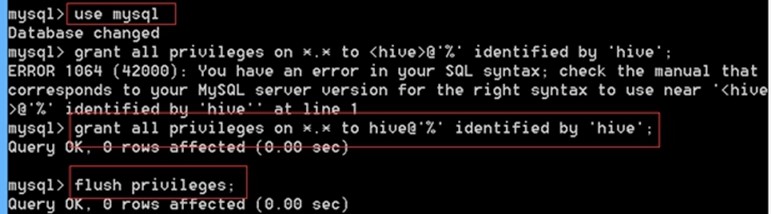

连接本地Mysql解决办法(感谢为我提供帮助的国柱、其国、世昌师兄们和老师)

1.首先登陆到mysql

mysql -uroot -pmysql

2.创建远程登陆用户并授权

grant all PRIVILEGES on test_db.* to root@'192.168.1.101' identified by 'root';

3.执行了上面的语句后,再执行下面的语句,方可立即生效。

flush privileges;

如果不行

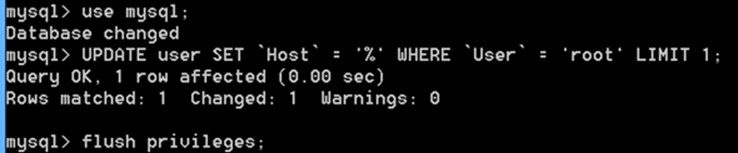

先use mysql;

然后UPDATE user SET `Host` = '%' WHERE `User` = 'root' LIMIT 1;

flush privileges;

我还是有一些疑问1:现在不能用root用户登录,只能用其他用户登录对吗?其他用户的权限少了些什么?2配置文件连接的是192.168.1.101,在qlyog127.0.0.1新建一个hive数据库才能用(hive新建的表的元数据都保存在那里,而不是192.168.1.101)

新创建一个用户,不要用root,估计root串了。

use mysql;

grant all privileges on *.* to <用户名>@'%' identified by '密码';

flush privilege;

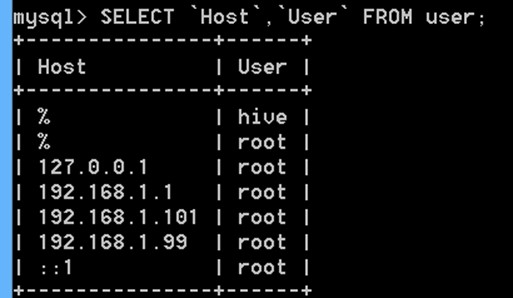

SELECT `Host`,`User` FROM user;

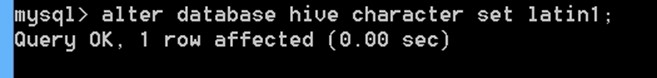

alter database hive character set latin1;

成功连接mysql启动hive

因为$HIVE_HOME/lib目录下有derby的jar包所以使用derby作为默认的metastore。

Hive1.2版本中的jline-2.12.jar包与hadoop2.6.0(jline-0.9.94.jar版本)不兼容,解决办法,将这个jar包复制到hadoop的lib目录下。

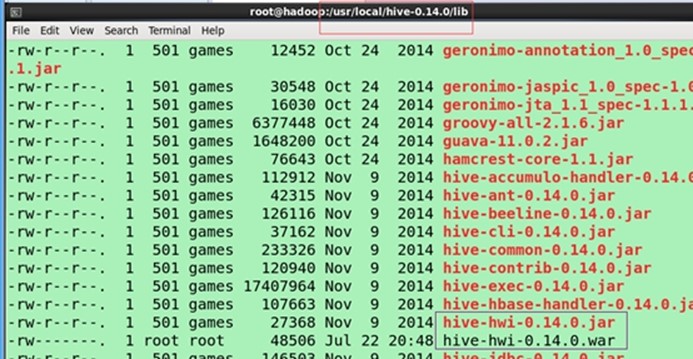

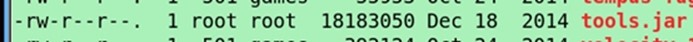

1.2hive web界面模式

web界面安装:

下载apache-hive-0.14.0-src.tar.gz(版本需要对应)

制作war包放在HIVE_HOME/lib/ : (apache-hive-0.14.0-src.tar\apache-hive-0.14.0-src\hwi将web解压出来,里面的jsp文件就是hwi的显示界面 )hwi/web/*里面所有的文件打成war包(压缩文件,并重命名为hive-hwi-0.14.0.war)

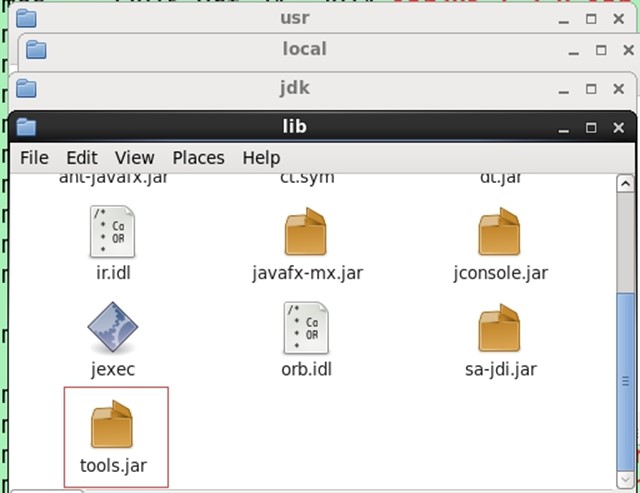

复制tool.jar(jdk的lib包下面的tool.jar包)到HIVE_HOME/lib下

修改hive-site.xml(HIVE_HOME/conf)

<property>

<name>hive.hwi.listen.host</name>

<value>0.0.0.0</value>

</property>

<property>

<name>hive.hwi.listen.port</name>

<value>9999</value>

</property>

<property>

<name>hive.hwi.war.file</name>

<value>lib/hive-hwi-0.14.0.war</value>

</property>

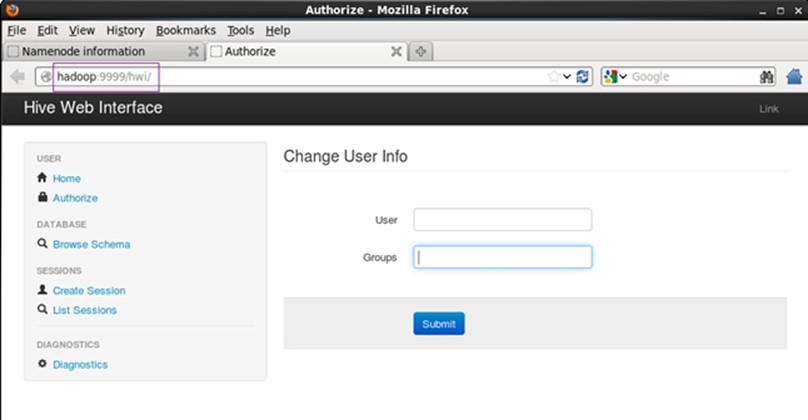

hive web界面的 (端口号9999) 启动方式

#hive --service hwi &(&表示后台显示)

用于通过浏览器来访问hive

可以查看hive的系统信息,hadoop日志路径信息等

1.3set命令使用

hive控制台set命令:

set hive.cli.print.current.db=true;

set hive.cli.print.header=true;

set hive.metastore.warehouse.dir=/hive;

hive参数初始化配置set命令:

~/.hiverc(存放在每个用户的主目录下面,可以创建一个.hiverc,将set命令的参数复制进去,重新启动执行hive,就可以将set命令执行起来)

补充:

hive历史操作命令集(more .hivehistory查看一下)

~/.hivehistory

直接查看(执行set),查看hadoop定义的全部变量,hive底层依赖的hadoop环境变量配置信息(set -v)

设置name变量并初始化(set hivevar:name=crxy;)显示(set hivevar:name;),传值(create table t2(name string,${hivevar:name} string);)

- 基本数据类型

String和int在创建表,时间戳(hive与Hbase结合时,底层的映射结构,是自动完成,如果没有,hive与Hbase结合有困难)

2.1复合数据类型

创建学生表

hive>CREATE TABLE student(

id INT,

name STRING,

favors ARRAY<STRING>,

scores MAP<STRING, FLOAT>

);

2.2hive记录中默认分隔符

分隔符 描述 语句

\n 分隔行 LINES TERMINATED BY '\t'

^A 分隔字段(列),显示编码使用\001 FIELDS TERMINATED BY '\001'

^B 分隔复合类型中的元素,显示编码使用\002 COLLECTION ITEMS TERMINATED BY '\002'

^C 分隔map元素的key和value,显示编码使用\003 MAP KEYS TERMINATED BY '\003'

Hdfs存储表时用的是分隔符

原始数据组织方式(导入hive表前的数据)

1001\001zhangsan\001AA\002\BB\001key\003value 1002\001lisi

在hdfs数组存放方式

1001^Azhangsan^AAA^BBB^Akey^Cvalue\n1002^Alisi

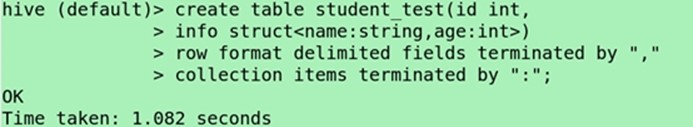

2.3复合类型—Struct使用

structs内部的数据可以通过DOT(.)来存取,例如,表中一列c的类型为STRUCT{a INT; b INT},我们可以通过c.a来访问域a

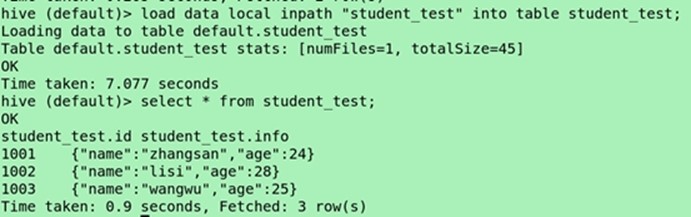

hive> create table student_test(id INT, info struct<name:STRING, age:INT>) ROW FORMAT DELIMITED(限定) FIELDS TERMINATED(终止) BY ',' COLLECTION(集合) ITEMS TERMINATED BY ':'; (第一个是字段id与struct结构体的分隔符逗号或者tab(\t)都可以,第二个是struct分割)

vi student_test

1001,zhangsan:24

1002,lisi:28

1003,wangwu:25

(local inpath,应该就是为什么可以将/root/student_test传进去)

(导入数据)load data local inpath"student_test" into table student_test;

Select * from student_test;

(查询id)select id from student_test;

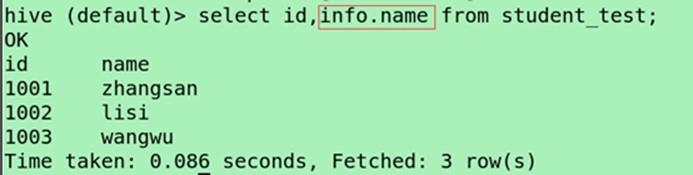

(查询structs内部数据,通过点的方式)

select id,info.name from student_test;

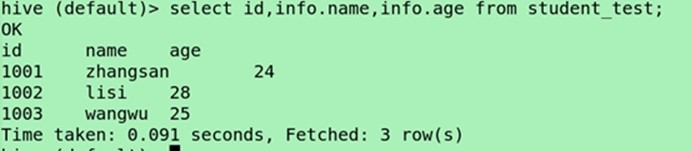

Select id,info.name,info.age from student_test;

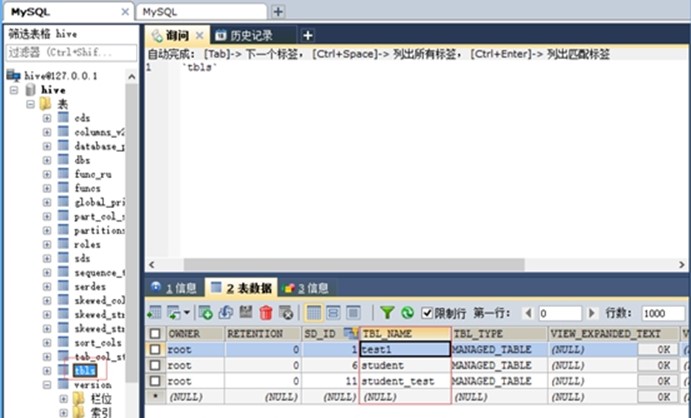

可以直接在MySQL(储存的是元数据)查看创建的表

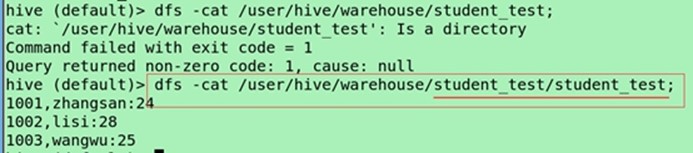

也可以在hdfs(储存的是表的实际信息)上查看

dfs -cat /usr/hive/warehouse/student_test/student_test;

第一个是表名没有内容,第二个才是表的内容,除了默认格式不一样,指定格式显示就会一样的。

2.4复合类型—Array使用

array中的数据为相同类型,例如,假如array A中元素['a','b','c'],则A[1]的值为'b'

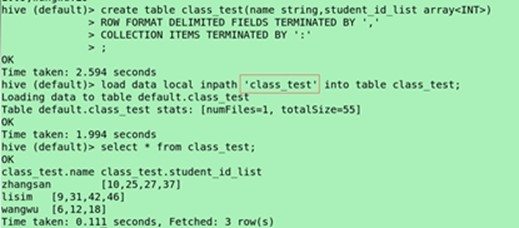

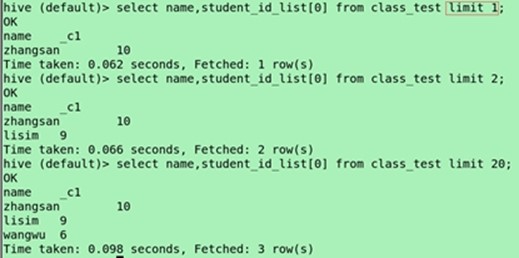

create table class_test(name string, student_id_list array<INT>) ROW FORMAT DELIMITED FIELDS TERMINATED BY ',' COLLECTION ITEMS TERMINATED BY ':';

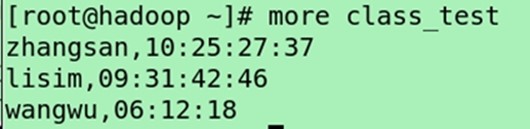

vi class_test

zhangsan,10:25:27:37

lisim,09:31:42:46

wangwu,06:12:18

(导入表)load data local inpath "class_test" into table class_test;

select * from class_test;

(查询名字)select name from class_test;

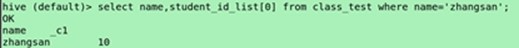

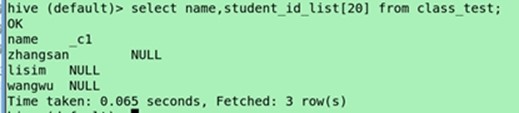

(集合类型的角标查询)select name,student_id_list[0] from class_test;

select name,lstudent_id_list[0] from class_test where name='zhangsan';

角标超出范围会显示NULL

按照列解析的

2.5复合类型—Map使用

访问指定域可以通过["指定域名称"]进行,例如,一个Map M包含了一个group-》gid的kv对,gid的值可以通过M['group']来获取

create table employee(id string, perf map<string, int>) ROW FORMAT DELIMITED FIELDS TERMINATED BY '\t' COLLECTION ITEMS TERMINATED BY ',' MAP KEYS TERMINATED BY ':';

(字段之间使用的是\t(Tab键),集合(多个map就会是集合)之间的用,号,map之间用:分割)

vi employee(在~目录下面)

1001 job:80,team:60,person:70

1002 job:60,team:80,person:80

1003 job:90,team:70,person:100

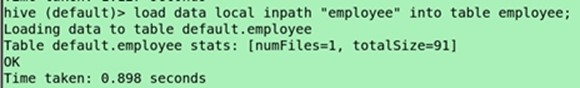

Load data local inpath "employee" into table employee;(备注;使用双引号和单引号也是可以的。)

(查询)Select *from employee;

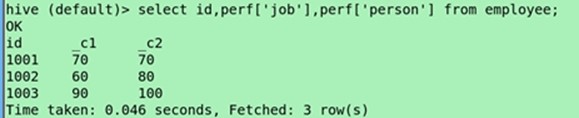

Select id,perf['job'] from employee;

Select id,perf['job'],perf['person'] from employee;

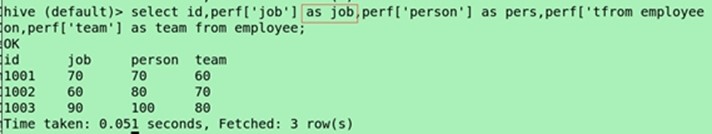

(设置别名,显示表头)select id,perf['job'] as job,perf['team'] as team,perf['person'] as person from employee;

三、数据定义

3.1数据库定义

默认数据库"default"

使用#hive命令后,不使用hive>use <数据库名>,系统默认的数据库。可以显式使用hive> use default;

创建一个新库

hive>CREATE DATABASE

[IF NOT EXISTS] mydb

[LOCATION] '/.......'

[COMMENT] '....';

hive>SHOW DATABASES;

hive>DESCRIBE DATABASE [extended] mydb;

hive>DROP DATABASE [IF EXISTS] mydb [CASCADE];

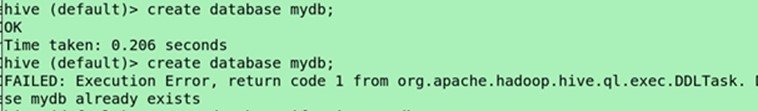

Create database mydb;

在hdfs创建mydb.db目录会存放mydb数据里面的内容

消除不必要的提示(干扰我们的判断)

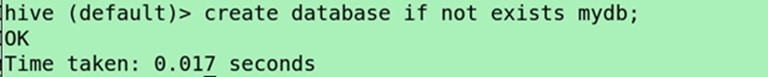

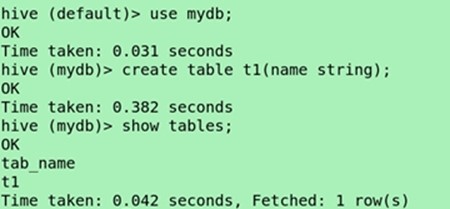

Create database if not exists mydb;

Use mydb;

Create table t1(name string);

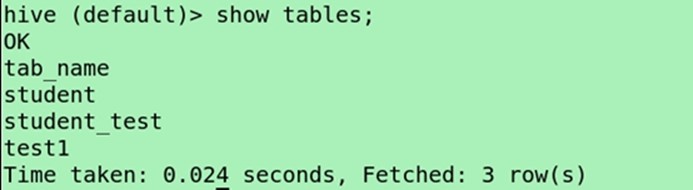

Show tables;

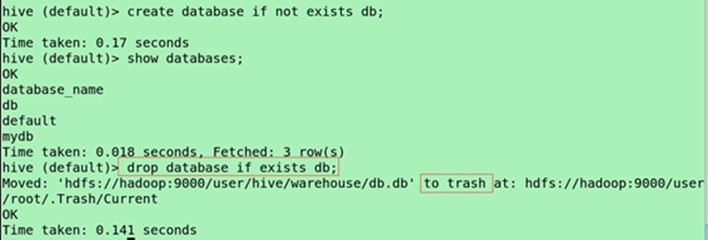

Create database bd;

Show databases;

Drop database if exists db;

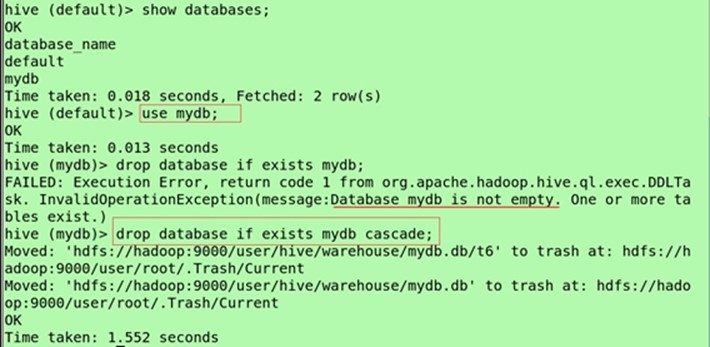

(级联删除)

drop database if exists mydb cascade;

3.2 表定义

hive>CREATE TABLE IF NOT EXISTS t1(...)

[COMMENT '....']

[LOCATION '...']

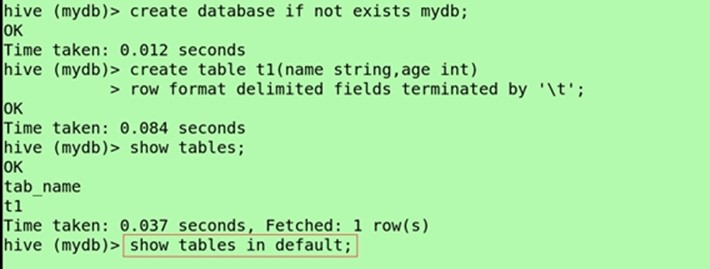

(当前数据库显示其他数据库的表)hive>SHOW TABLES in mydb;

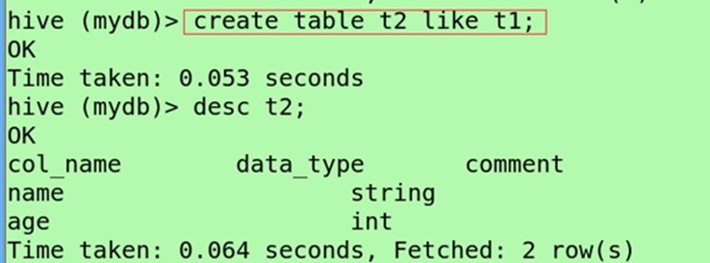

hive>CREATE TABLE t2 LIKE t1;

hive>DESCRIBE t2;

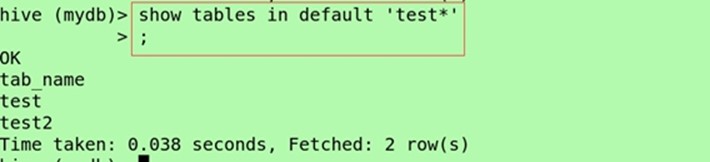

(寻找某个关键字的表)show tables in default 'class*';

(显示表的结构)desc t1;

(显示表的结构,原来的)describe t1;

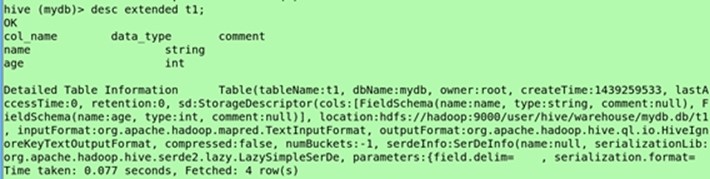

(显示拓展信息)desc extended t1;

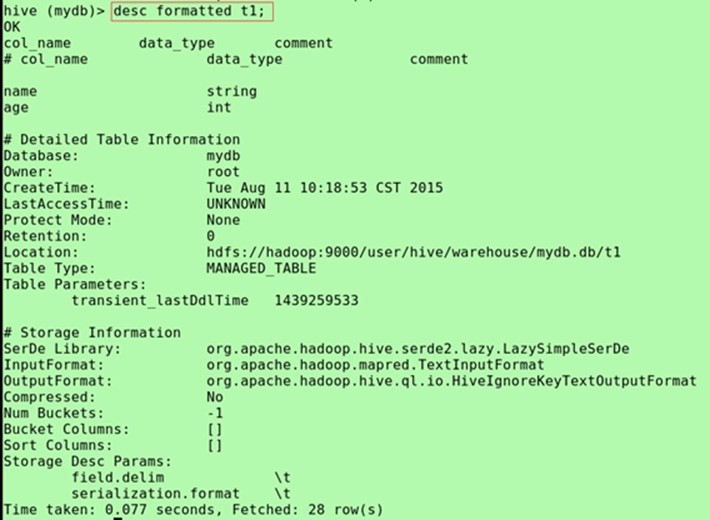

(显示拓展信息更加有结构,查看分隔符)desc formatted t1;

(创建另一个表进行测试,防止操作不当对原表造成伤害)create table t2 like t1;

(复制其他数据库的表的结构)Create table t3 like default.employee;

Hive(笔记)的更多相关文章

- Hive笔记--sql语法详解及JavaAPI

Hive SQL 语法详解:http://blog.csdn.net/hguisu/article/details/7256833Hive SQL 学习笔记(常用):http://blog.sina. ...

- Hive 笔记

DESCRIBE EXTENDED mydb.employees DESCRIBE EXTENDED mydb.employees DESCRIBE EXTENDED mydb.employees ...

- hive笔记(自学整理的)

第一部分:用户管理 创建用户:CREATE DATABASE XXX 查看用户:SHOW DATABASES; 关键查看用户:show databases like 'de.*' 讲解:创建一个用 ...

- Hive笔记--配置以及遇到的问题

ubuntu安装mysql http://www.2cto.com/database/201401/273423.html Hive安装: http://www.aboutyun.com/forum ...

- Hive笔记——技术点汇总

目录 · 概况 · 手工安装 · 引言 · 创建HDFS目录 · 创建元数据库 · 配置文件 · 测试 · 原理 · 架构 · 与关系型数据库对比 · API · WordCount · 命令 · 数 ...

- hive笔记:复杂数据类型-map结构

map 结构 1. 语法:map(k1,v1,k2,v2,…) 操作类型:map ,map类型的数据可以通过'列名['key']的方式访问 案例: select deductions['Feder ...

- hive笔记

cast cast(number as string), 可以将整数转成字符串 lpad rpad lpad(target, 10, '0') 表示在target字符串前面补0,构成一个长度为 ...

- hive笔记:时间格式的统一

一.string类型,年月日部分包含的时间统一格式: 原数据格式(时间字段为string类型) 取数时间和格式的语法 2018-11-01 00:12:49.0 substr(regexp_repl ...

- hive笔记:转义字符的使用

hive中的转义符 Hadoop和Hive都是用UTF-8编码的,所以, 所有中文必须是UTF-8编码, 才能正常使用 备注:中文数据load到表里面, 如果字符集不同,很有可能全是乱码需要做转码的, ...

- hive笔记:复杂数据类型-array结构

array 结构 (1)语法:array(val1,val2,val3,…) 操作类型:array array类型的数据可以通过'数组名[index]'的方式访问,index从0开始: (2)建表: ...

随机推荐

- 蓝桥网试题 java 基础练习 查找整数

--------------------------------------------------------------------- 注意看清楚条件 别漏了 -1 -1 -1 --------- ...

- 笑谈ArcToolbox (1) ArcToolbox 的发展方向

笑谈ArcToolbox (1) ArcToolbox 的发展方向 by 李远祥 ArcGIS工具箱ArcToolbox具有非常多的工具,相信用过的人都非常惊叹,其功能完备并且强大,种类繁多,总能找到 ...

- 记录UITextField删除状态

self.testTextField.leftView = [[UIView alloc] initWithFrame:CGRectMake(, , , )]; self.testTextField. ...

- hadoop系列二:HDFS文件系统的命令及JAVA客户端API

转载请在页首明显处注明作者与出处 一:说明 此为大数据系列的一些博文,有空的话会陆续更新,包含大数据的一些内容,如hadoop,spark,storm,机器学习等. 当前使用的hadoop版本为2.6 ...

- 无限二等分[0,1]这个区间之后还剩下啥?what's left after dividing an unit interval [0,1] infinitely many times?

Dividing an unit interval \([0,1]\) into two equal subintervals by the midpoint \(\dfrac {0+1} {2}=\ ...

- iOS 启动页后广告Demo

重点! 对于启动页后的广告,相信大家也都看到过很多很多的,比如我自己常看到的有 QQ音乐,爱奇艺了.你点击了APP,它会启动就会随之启动..其实这些APP的启动页是没有消失的,你去认真的观察一下!所以 ...

- Java Collection 接口、Set 接口、List 接口基本操作 练习

//////// One package Chp11; import java.util.ArrayList; import java.util.List; public class TestList ...

- Ant学习总结1

一.Ant简介 Ant是用来编译/运行/测试java程序,构建.包装和发布过程中几乎每一件事都可以由Ant的任务来处理. 二.Ant管理项目 当开始一个新的项目时,首先应该编写Ant的构建文件, ...

- Angular2 Service实践——实现简单音乐播放服务

引言: 如果说组件系统(Component)是ng2应用的躯体,那把服务(Service)认为是流通于组件之间并为其带来生机的血液再合适不过了.组件间通信的其中一种优等选择就是使用服务,在ng1里就有 ...

- 包装一个php的验证码类

验证码是我们开发的时候经验到的功能,所以在此本人包装了一个验证码类,应该可以作为php的类插件用,在此分享给各位博客园的读友. 实现的原理也是很简单,就是利用画布的几个元素,再加上一些字符串的获取,东 ...