TF-IDF_MapReduceJava代码实现思路

TF-IDF

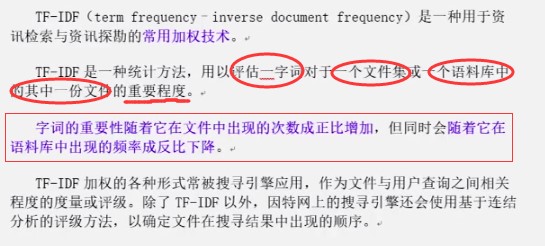

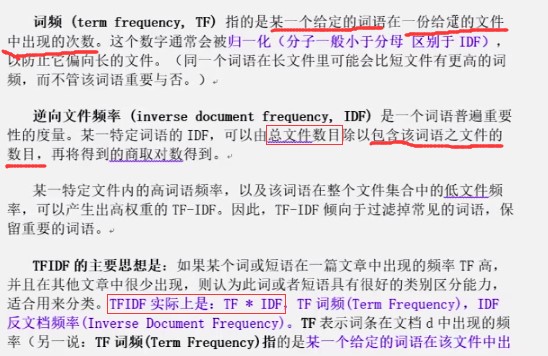

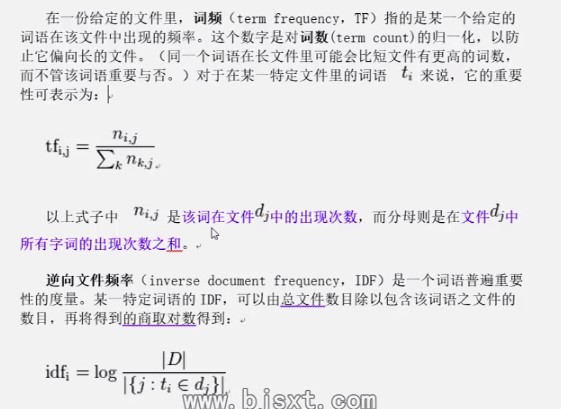

1. 概念

2. 原理

3. java代码实现思路

// 把微博总数加载到内存job.addCacheFile(newPath("/user/tfidf/output/weibo1/part-r-00003").toUri());// 把df加载到内存job.addCacheFile(newPath("/user/tfidf/output/weibo2/part-r-00000").toUri());

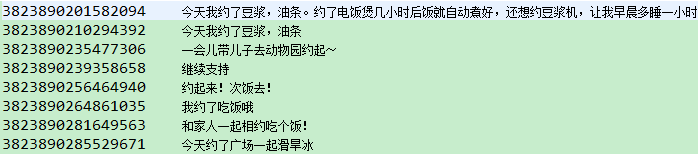

4. 商家如何做到精准营销?

TF-IDF_MapReduceJava代码实现思路的更多相关文章

- ItemCF_基于物品的协同过滤_MapReduceJava代码实现思路

ItemCF_基于物品的协同过滤 1. 概念 2. 原理 如何给用户推荐? 给用户推荐他没有买过的物品--103 3. java代码实现思路 数据集: 第一步:构建物品的同现矩阵 第 ...

- PageRank_网页排名_MapReduceJava代码实现思路

PageRank 1. 概念 2. 原理 3. java代码实现思路 1.定义收敛标准 每次算出新的pr-oldpr=差值 ,所有页面的差值累加 ,除以pagecou ...

- iOS开发:代码通用性以及其规范 第一篇(附带,自定义UITextView\进度条\双表显示\瀑布流 代码设计思路)

在iOS团队开发中,我见过一些人的代码,也修改过他们的代码.有的人的代码写的非常之规范.通用,几乎不用交流,就可以知道如何修改以及在它基础上扩展延生.有的人的代码写的很垃圾,一眼看过去,简直会怀疑自己 ...

- Android版网易云音乐唱片机唱片磁盘旋转及唱片机机械臂动画关键代码实现思路

Android版网易云音乐唱片机唱片磁盘旋转及唱片机机械臂动画关键代码实现思路 先看一看我的代码运行结果. 代码运行起来初始化状态: 点击开始按钮,唱片机的机械臂匀速接近唱片磁盘,同时唱片磁盘也 ...

- PAT 1034 有理数四则运算(20)(代码框架+思路+测试点错误分析)

1034 有理数四则运算(20)(20 分)提问 本题要求编写程序,计算2个有理数的和.差.积.商. 输入格式: 输入在一行中按照"a1/b1 a2/b2"的格式给出两个分数形式的 ...

- JS初学之-代码精简思路

1.差不多的代码,观察其不一样的地方,使用变量存起来,方便替代. 2.将其存入函数之中方便调用.

- 「赛后补题」HBCPC2018题目代码与思路简析

这次比赛(2018年第二届河北省大学生程序设计竞赛)虽然没有打,但是题目还是要写的.未完成的题目(还差比较硬核的四题)和思路分析会陆续更新完. Problem A 2011 Mex Query /* ...

- PAT1080 MOOC期终成绩 (25分) ——同样参考了柳婼大神的代码及思路,在自己的代码上做了修改,还是很复杂

1080 MOOC期终成绩 (25分) 对于在中国大学MOOC(http://www.icourse163.org/ )学习“数据结构”课程的学生,想要获得一张合格证书,必须首先获得不少于200分 ...

- JS实现登陆验证的主要代码及思路

window.onload = function(){ // 获取input标签 var alInput = document.getElementsByTagName("input&quo ...

随机推荐

- 转 - .net/c# 使用RabbitMQ

背景 最近需要用C#写一个Adapter来做数据传输,合作方使用的是RabbitMQ,所以我这边也要跟着写写... 在网上搜索了一些,发现园子里的这篇写的还是非常好的.虽然有点老了,我自己用的是最新的 ...

- Xamarin.Android AlertDialog中的EditText打上去字为什么不显示?也没有光标闪烁

AlertDialog.Builder builder = new AlertDialog.Builder(this); builder.SetTitle("请您输入管 ...

- SQL server Error Number

描述 HY000 所有绑定列都是只读的. 必须是可升级的列,以使用 SQLSetPos 或 SQLBulkOperations 更改或插入行. HY000 已检测到一个旧 netlib (%s).请删 ...

- zabbix 3.0.4 中文字体替换

zabbix 对中文支持不是很好,会出现乱码: 从windows系统里 找到字体包:如图: 拷贝到zabbix-server里面,注意,把文件名改成小写: 我linux 是centos7.2版本 [r ...

- java基础之关键字static

在java当中有很多关键字,static便是其中一个,它很普通但我们经常需要运用到它,所以要了解static是非常有必要的. 鉴于本人知识结构有限,若有错误忘不吝赐教,甚为感谢. 一. ...

- Python模块学习------ 多线程threading(1)

# Method 1: 创建一个Thread实例,传给它一个函数:import threading from time import sleep, ctime loops = [4,2] def lo ...

- 魔方 NewLife.Cube

魔方 是一个基于 ASP.NET MVC 的 用户权限管理平台,可作为各种信息管理系统的基础框架. 演示:http://cube.newlifex.com 源码 演示账号:admin/admin 源码 ...

- SQLServer 创建服务器和数据库级别审计

概述 在上一篇文章中已经介绍了审计的概念:本篇文章主要介绍如何创建审计,以及该收集哪些审核规范. 一.常用的审核对象 1.1.服务器审核对象 1.FAILED_LOGIN_GROUP( Audit L ...

- SQLAlchemy表操作和增删改查

一.SQLAlchemy介绍 SQLAlchemy是一个基于Python实现的ORM框架.该框架建立在 DB API之上,使用关系对象映射进行数据库操作,简言之便是:将类和对象转换成SQL,然后使用数 ...

- 前端基于react,后端基于.net core2.0的开发之路(番外篇) 后端使用T4模板,生成某些类

1.介绍 因为开发过程中,有部分类是你加一个模型,就需要去改动的,每次加非常的烦,或者有些类,你只用到了他基类的方法,但是你还必须建一个文件才能调用他基类的方法,也很烦. 这个时候,T4就非常有用了. ...