ML笔记:Gradient Descent

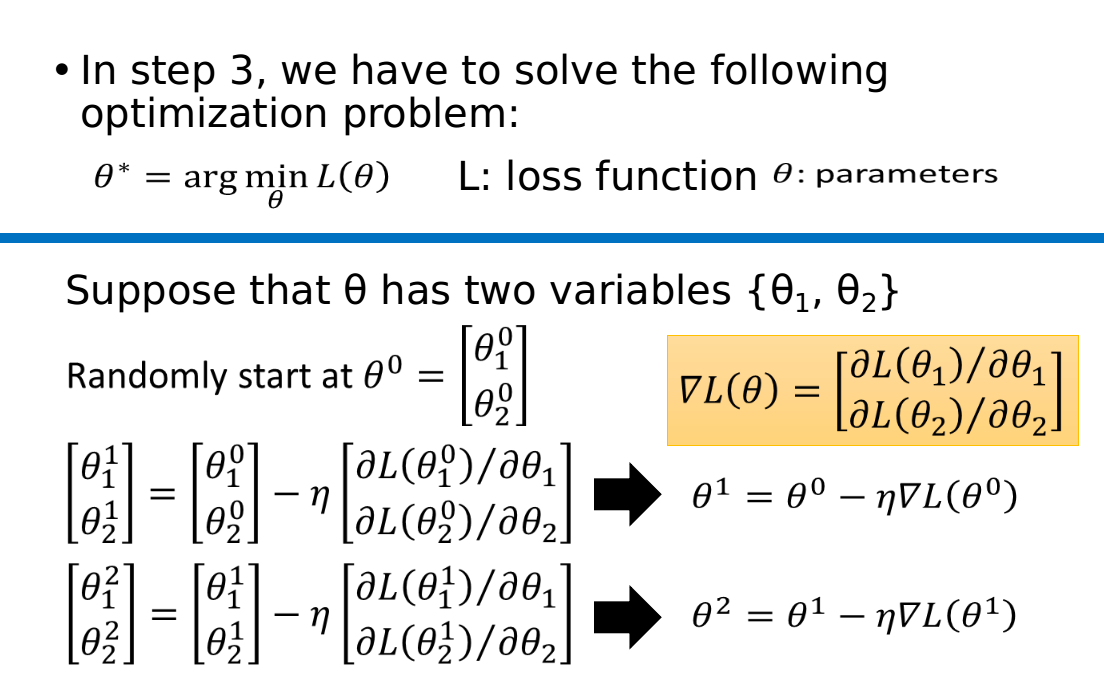

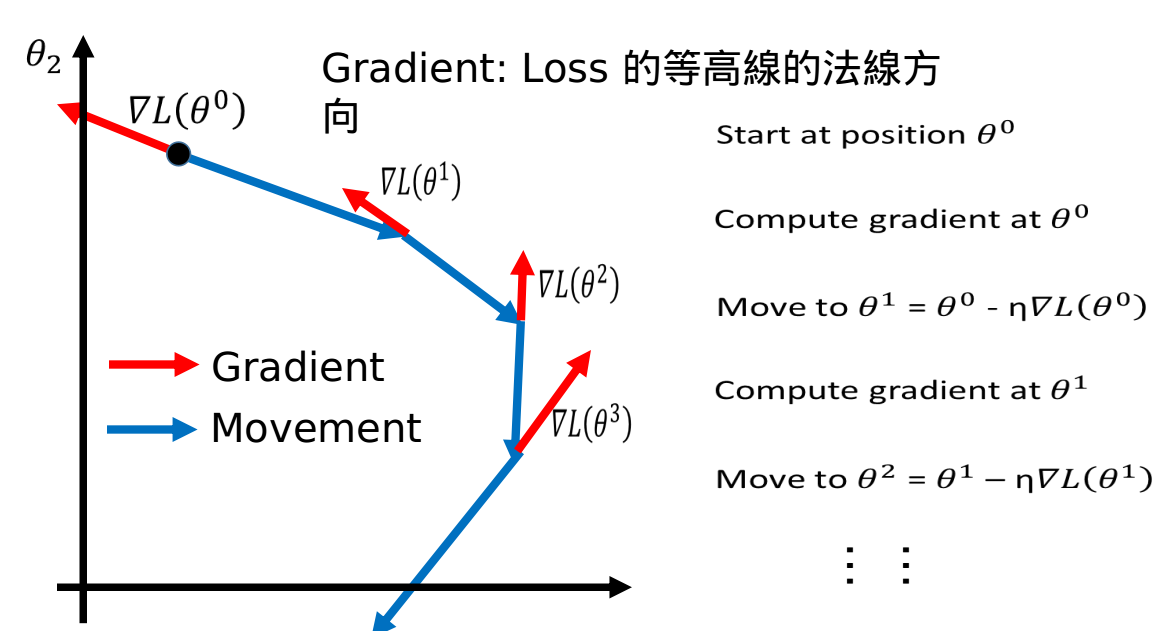

Review: Gradient Descent

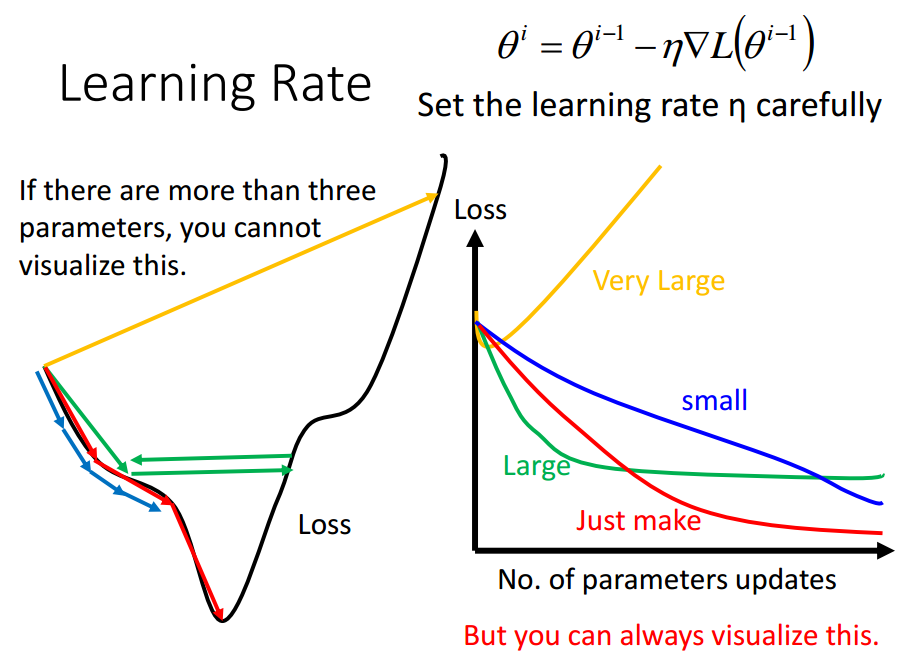

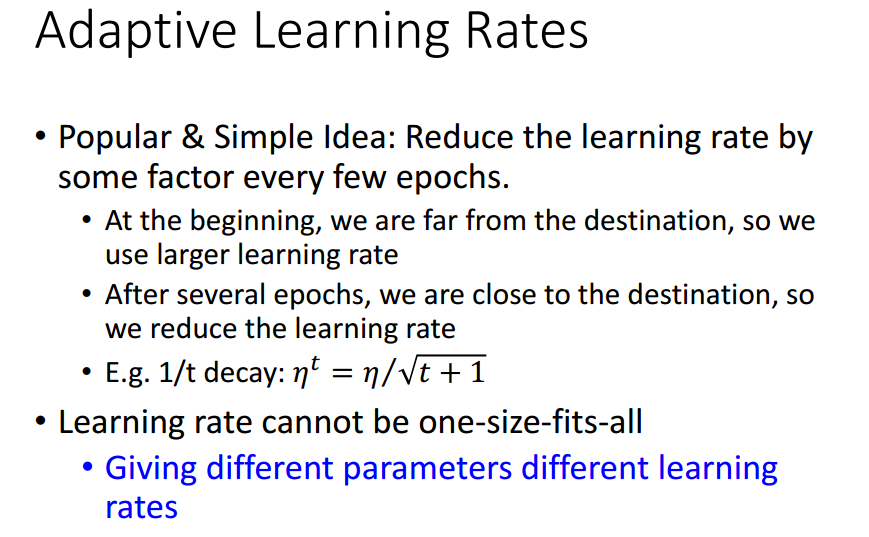

Tip 1: Tuning your learning rates

eta恰好,可以走到局部最小值点;

eta太小,走得太慢,也可以走到局部最小值点;

eta太大,很可能走不到局部最小值点,卡在某处上;

eta太太大,很可能走出去.

可以自动调节eta,

大原则是eta随更新次数的增长而减小,---time dependent

同时也要针对不同的参数设置不同的eta.---parameter dependent

有很多这样的自动调节eta的梯度下降方法,名称常以Ada开头,

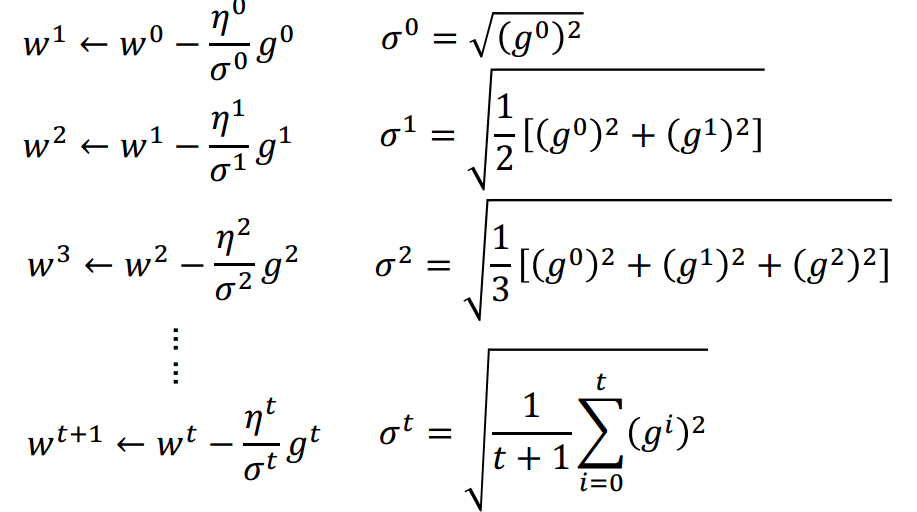

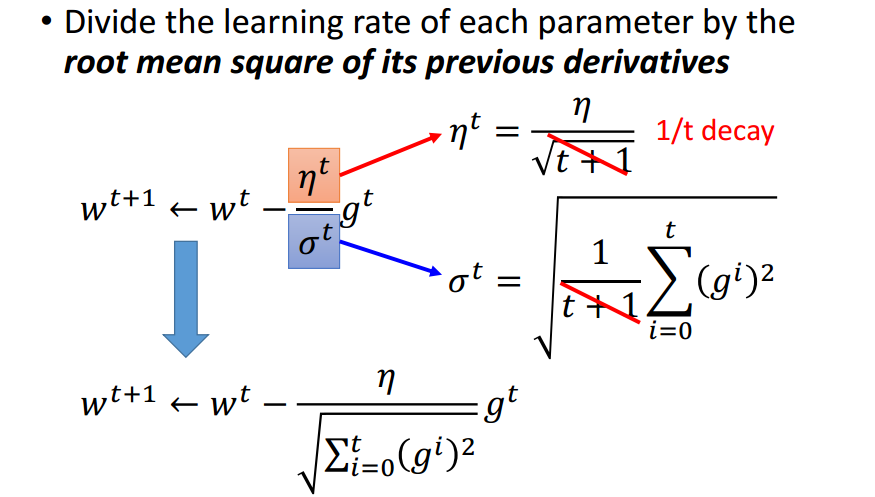

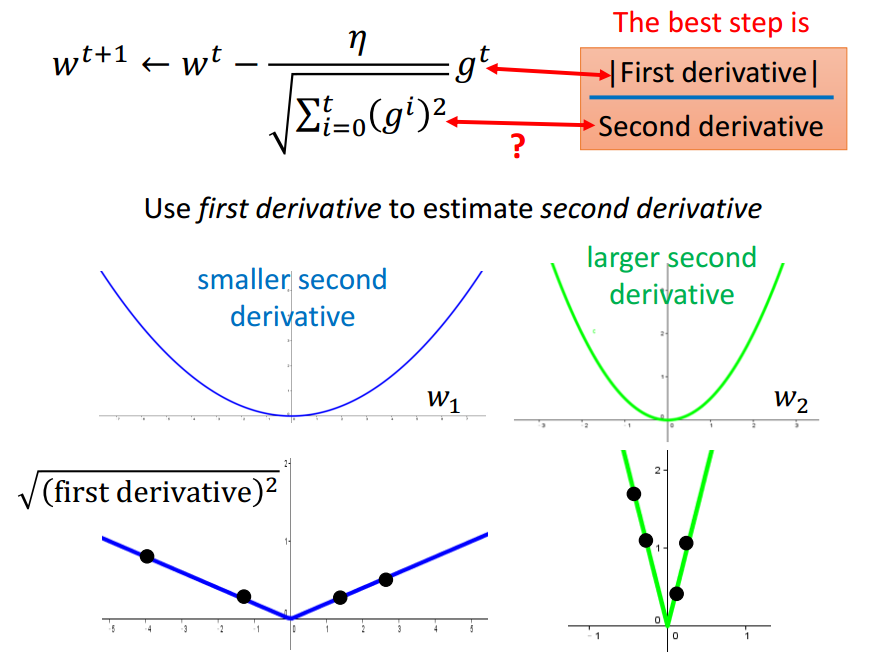

其中较为简单的Adagrad:

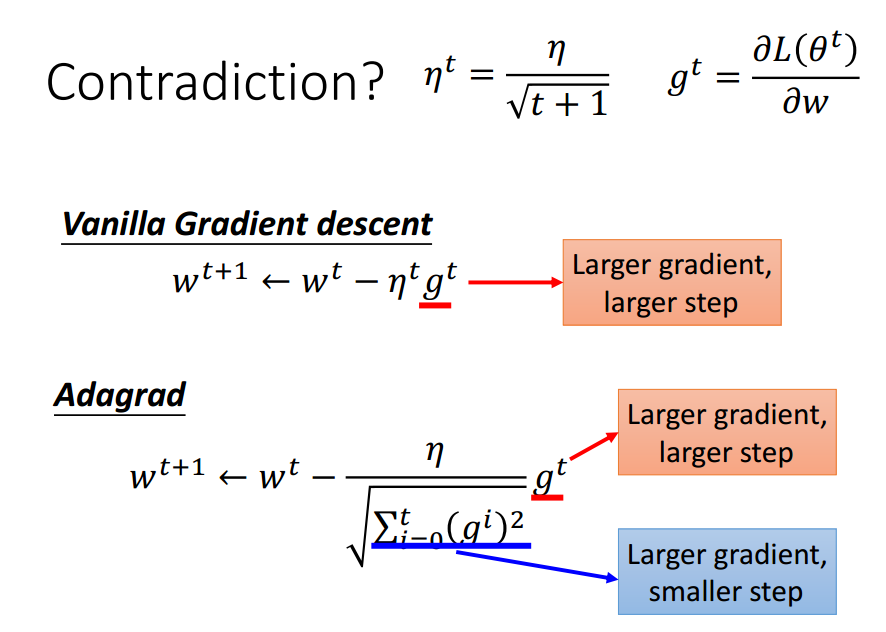

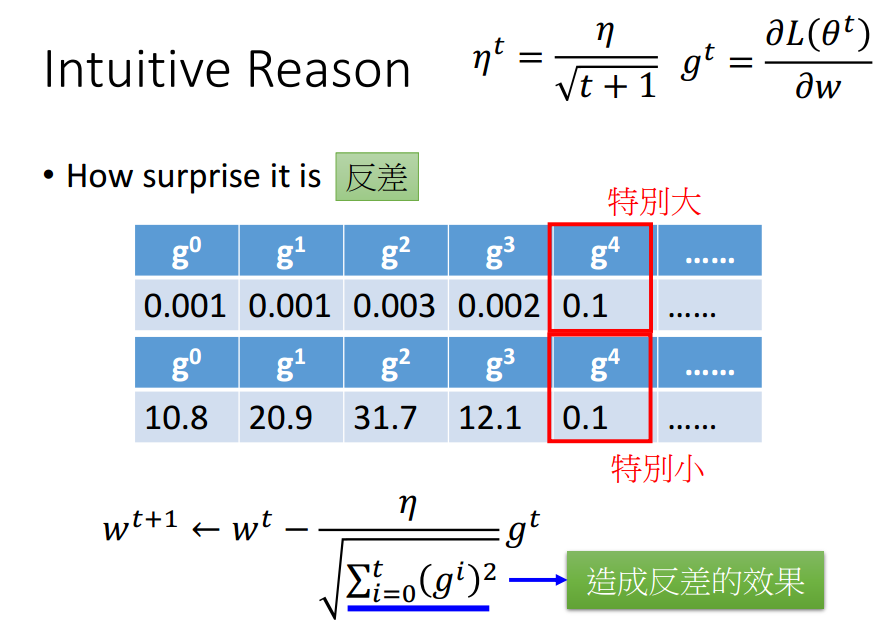

Adagrad强化反差.

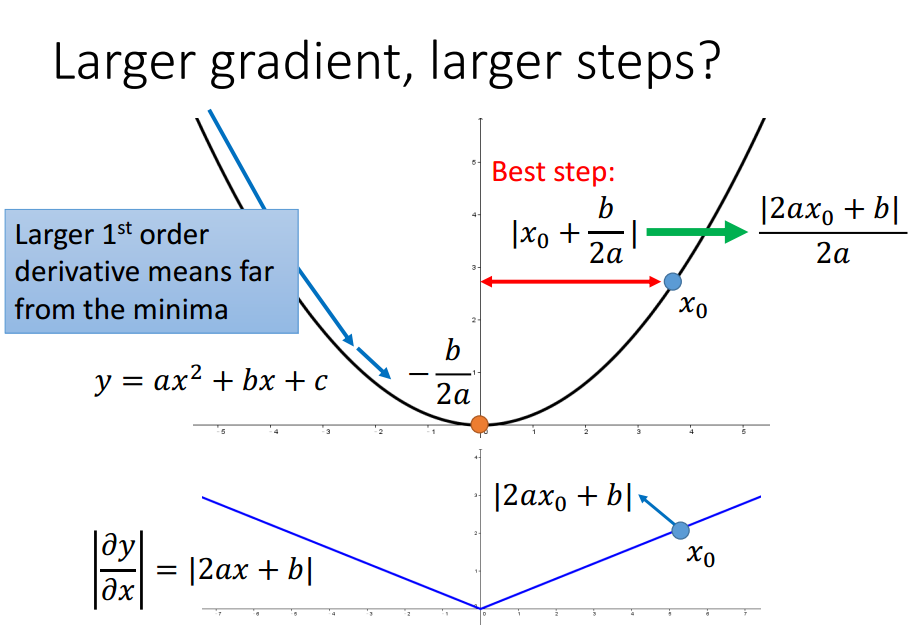

只考虑一个参数时,当前点与局部最优值点的距离与导数成正比,

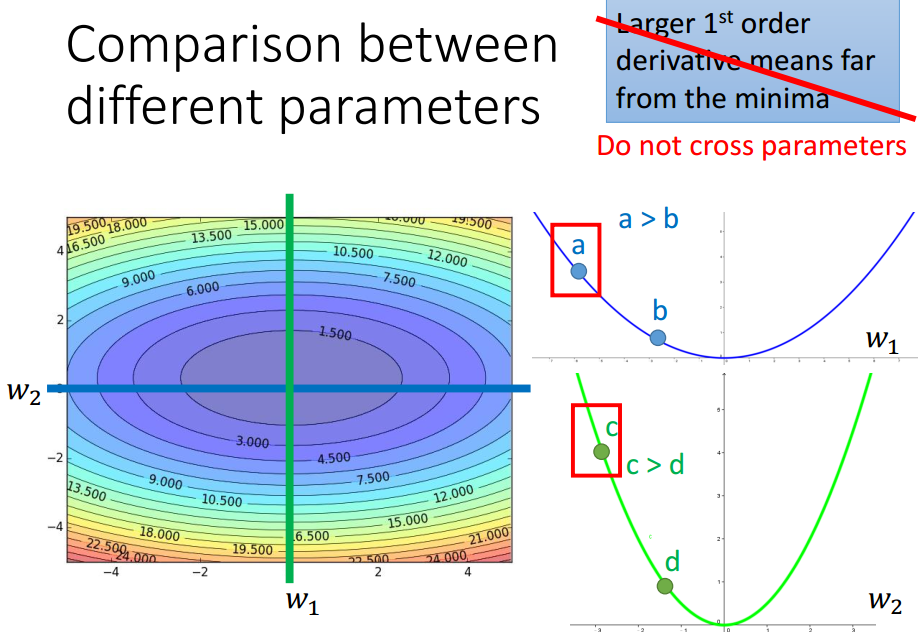

考虑多个参数时,该结论不一定成立.

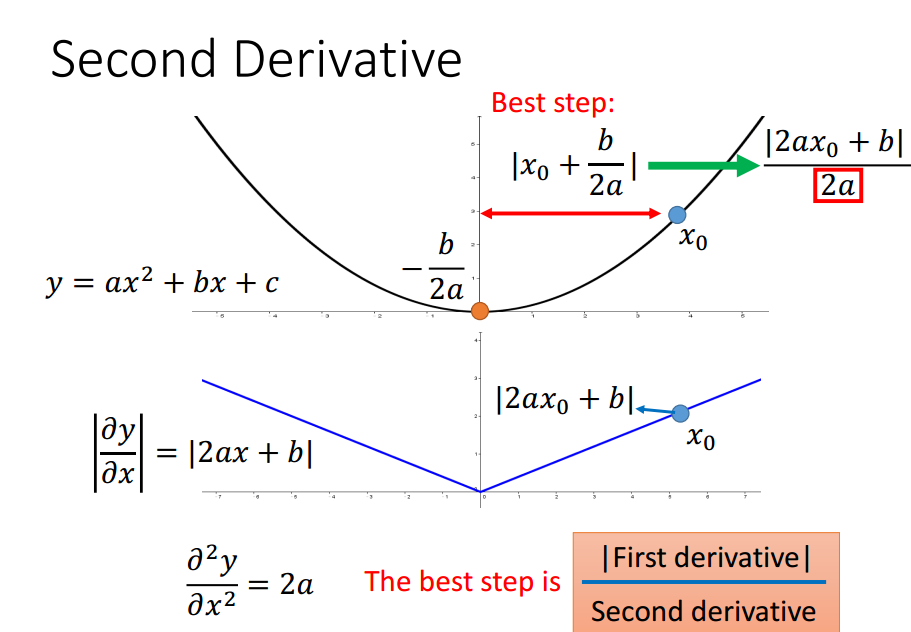

还需要考虑2阶导数来反映当前位置与局部最小值点的距离.

Adagrad的分母计算近似了2阶导数的计算.

没有增加额外的花费来估计2阶导数.

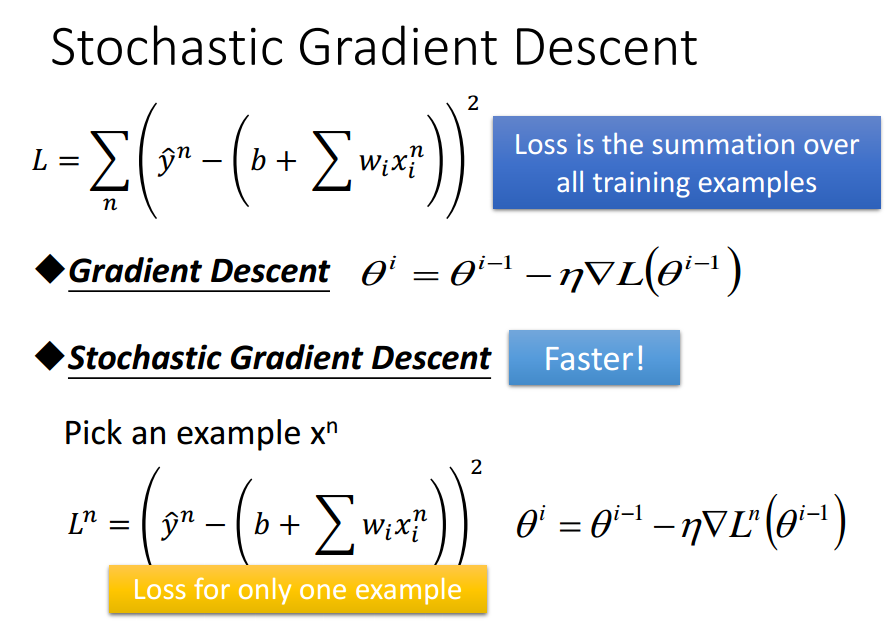

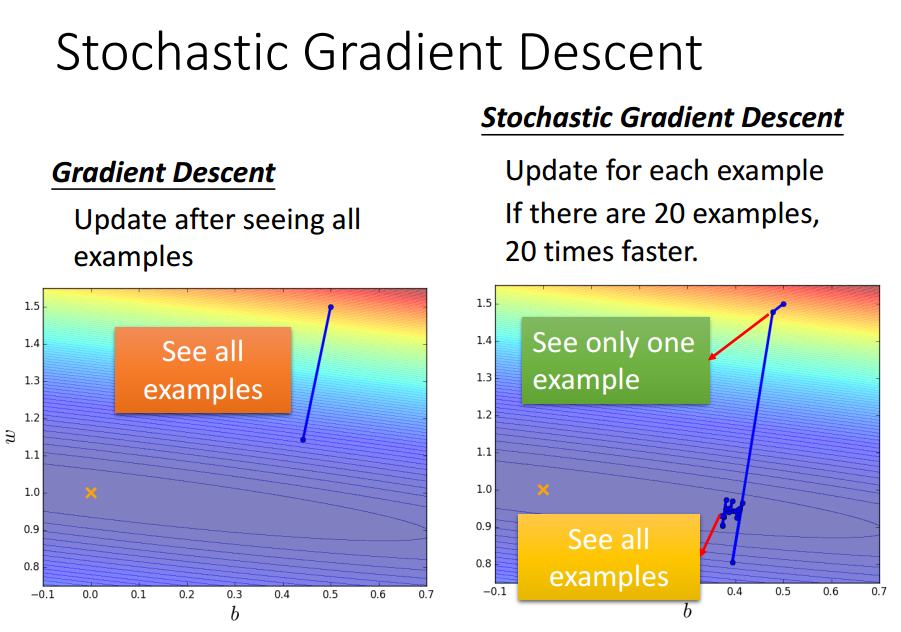

Tip 2: Stochastic Gradient Descent

梯度下降一次使用所有训练数据,

随机梯度下降一次使用单个训练数据.

SGD可能步伐小和散乱,但走得更快.

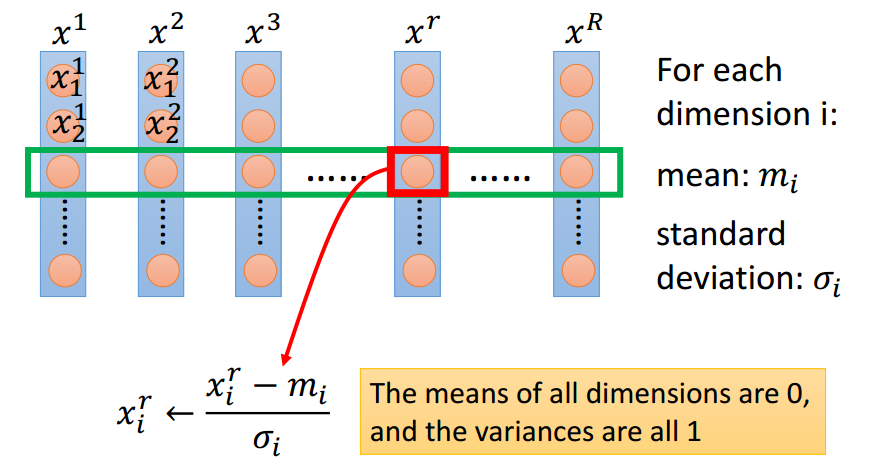

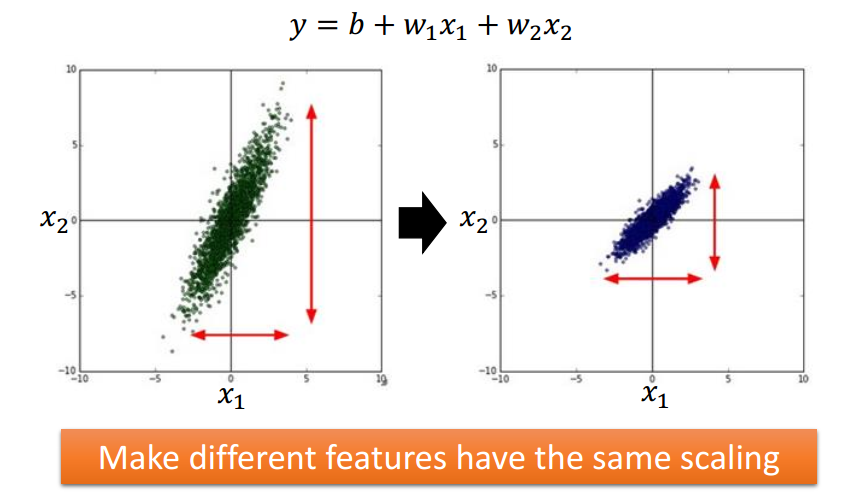

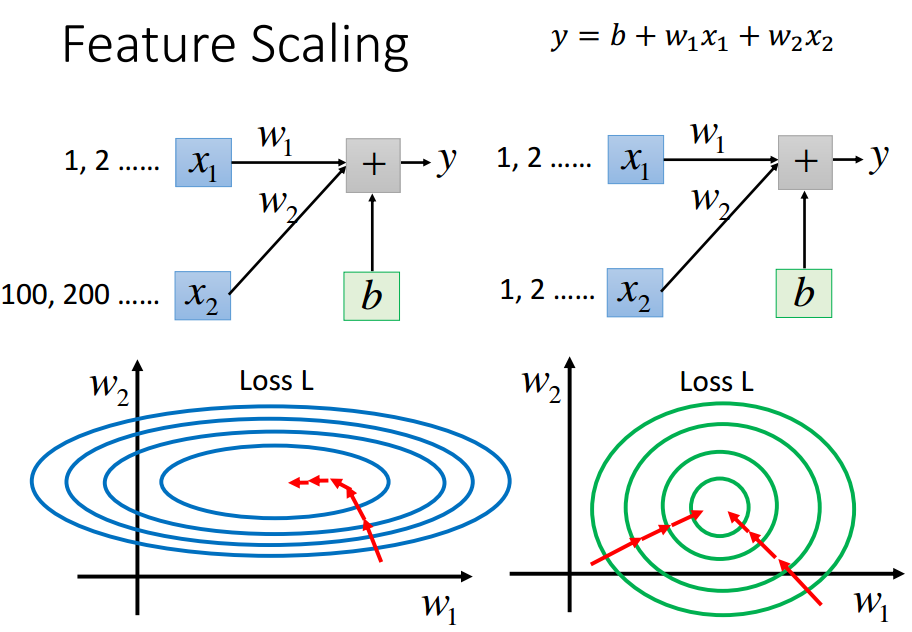

Tip 3: Feature Scaling

w1变化,y变化小;---w1对loss影响小

w2变化,y变化大.---w2对loss影响大

一般来说,椭圆形中不同方向的eta需求不一样,需要Ada梯度下降;

圆形中更新次数较少,因为无论椭圆形还是圆形,更新时都是沿着等高线的法线方向,

而圆形直接向着圆心走.

通过将特征归一化(均值0,方差1)实现特征缩放.

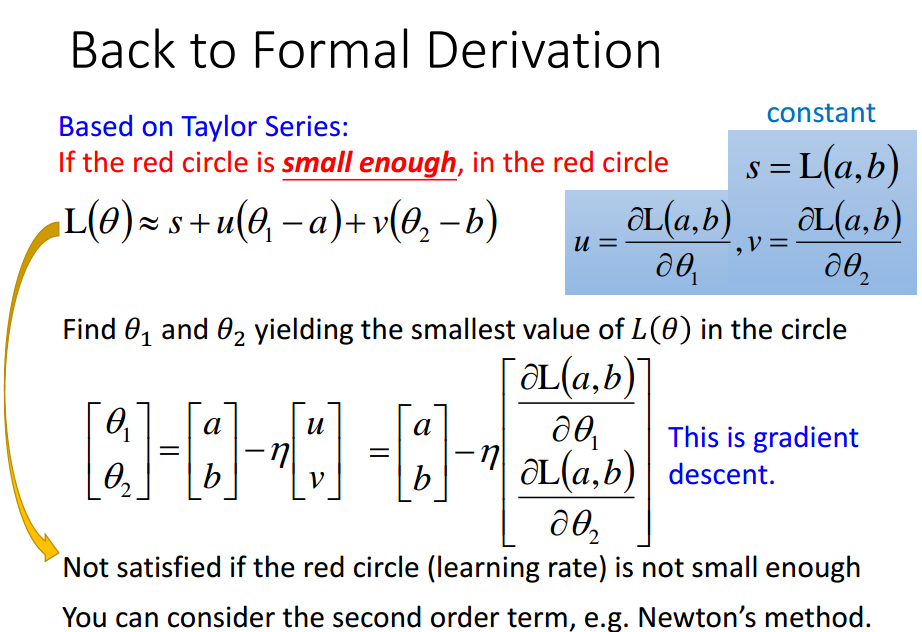

Theory

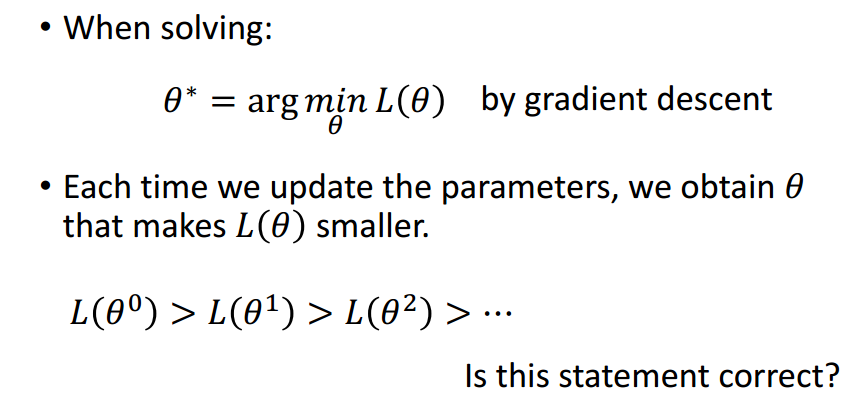

问题:

答案当然是不正确.

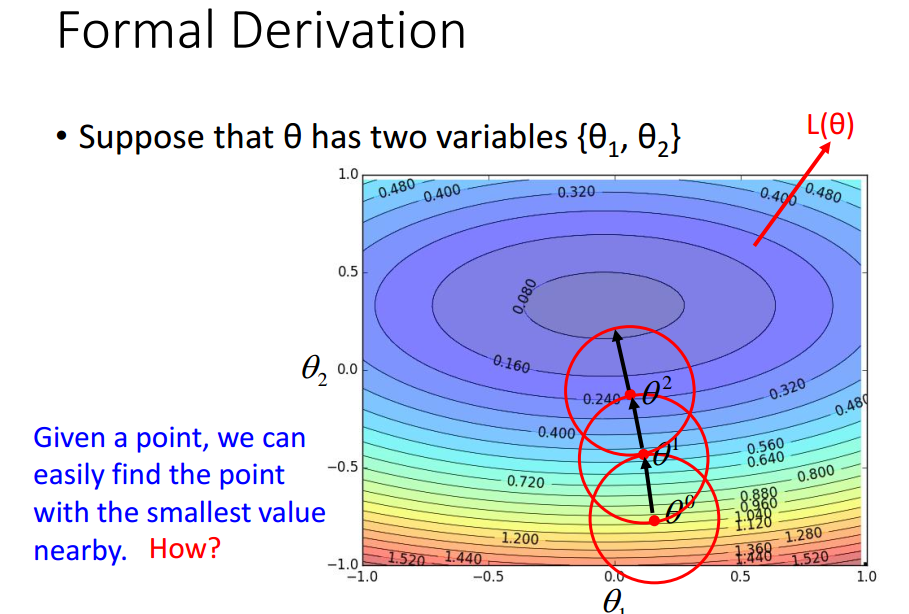

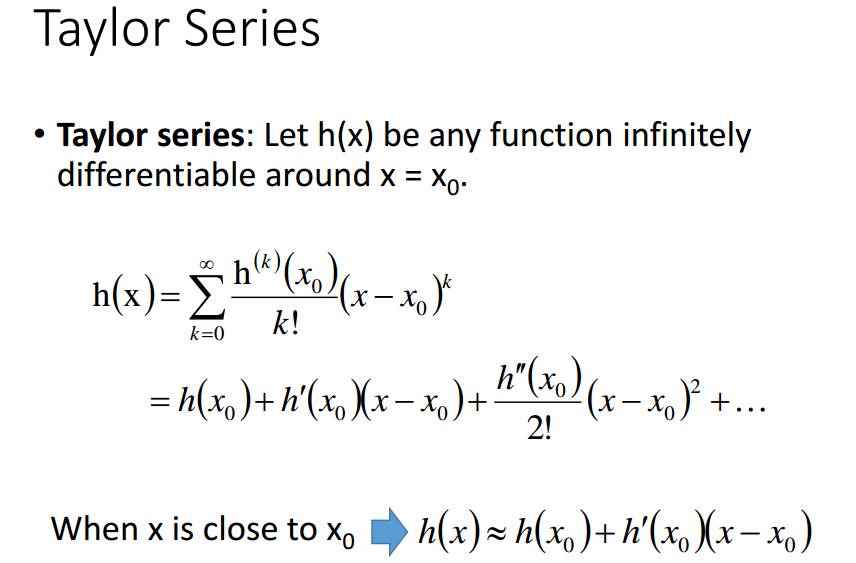

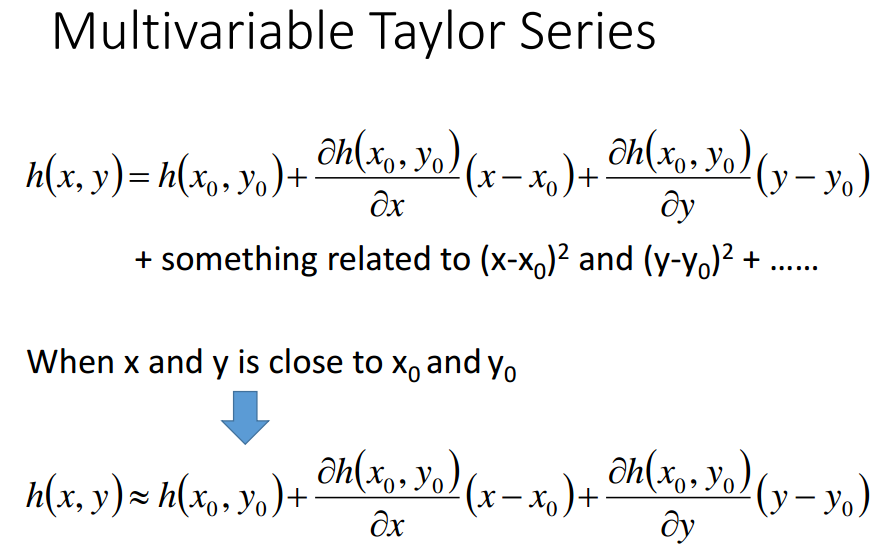

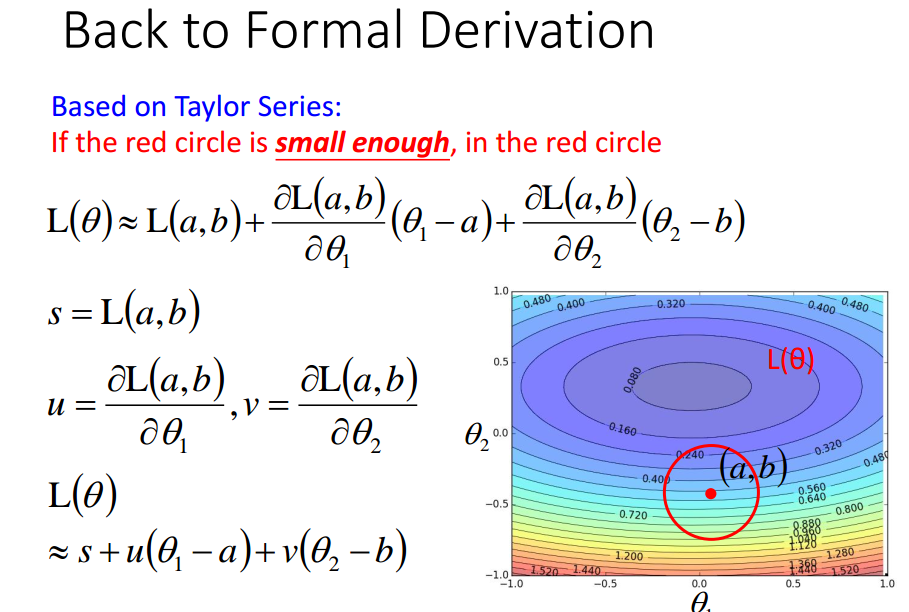

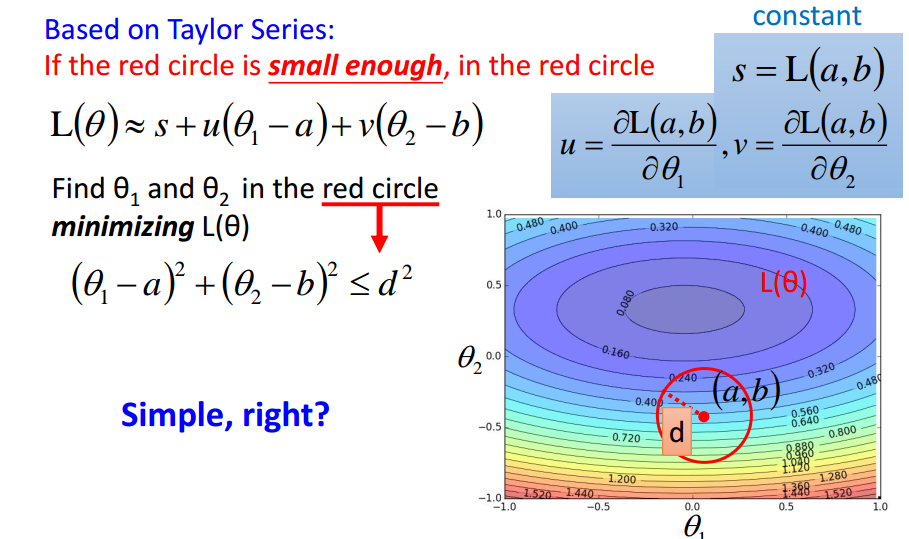

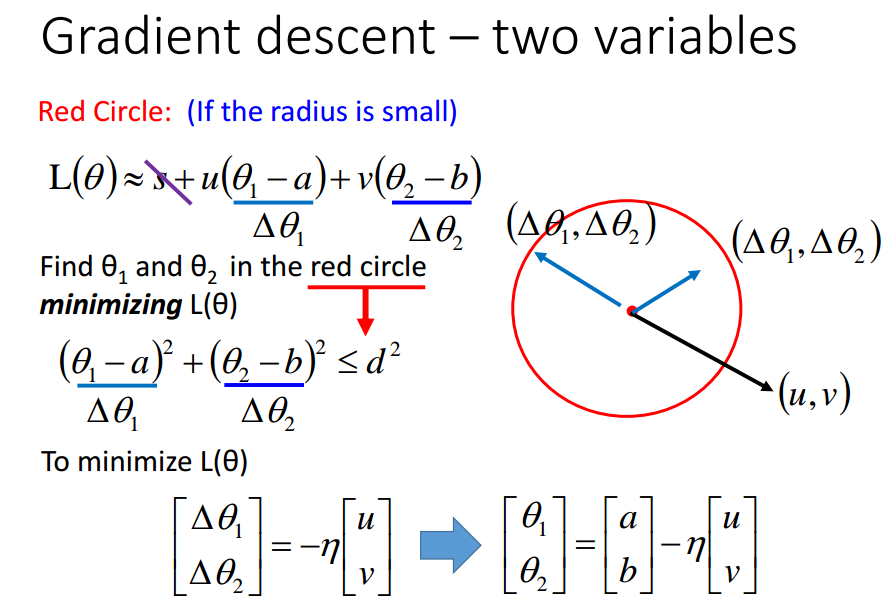

正式推导梯度下降能到达局部最小值点.

注意:

eta与红色半径成正比,

理论上,eta要充分小才能保证能到达局部最优值点,

实际上,eta只要小就行.

考虑泰勒二阶式的话,理论上eta值可以设得大点.---这种方式在deep learning中不见得那么普及

因为考虑二阶式会多出很多运算,deep learning中认为这样不划算.

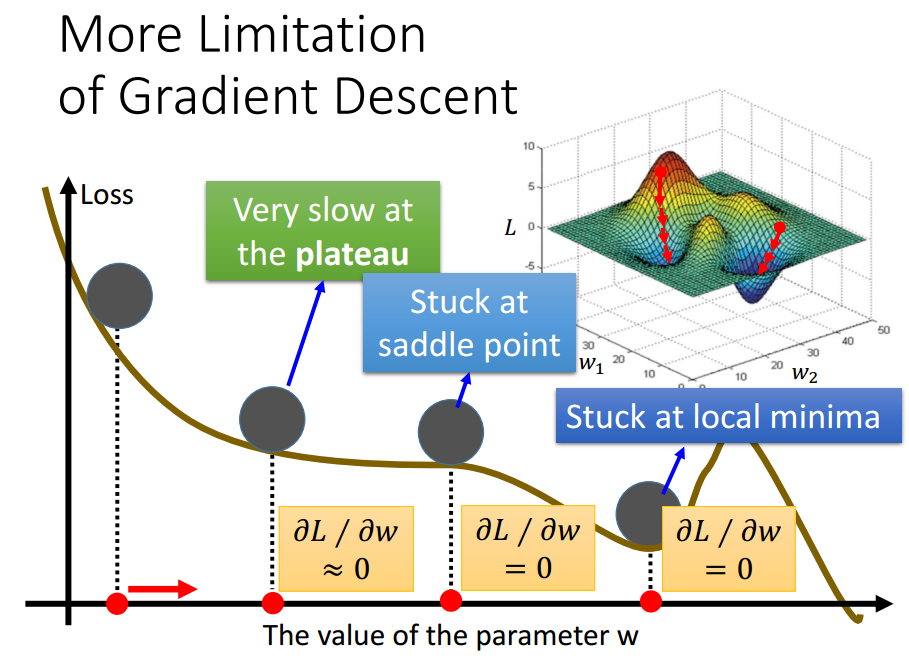

Limitation

实际操作中,很少情况下导数会exactly为0.

所以,真正问题是,该点实际在高原处,但导数小于阈值,

停下,但此时离局部最优值点还很远.

ML笔记:Gradient Descent的更多相关文章

- 李宏毅机器学习笔记2:Gradient Descent(附带详细的原理推导过程)

李宏毅老师的机器学习课程和吴恩达老师的机器学习课程都是都是ML和DL非常好的入门资料,在YouTube.网易云课堂.B站都能观看到相应的课程视频,接下来这一系列的博客我都将记录老师上课的笔记以及自己对 ...

- [机器学习] ML重要概念:梯度(Gradient)与梯度下降法(Gradient Descent)

引言 机器学习栏目记录我在学习Machine Learning过程的一些心得笔记,涵盖线性回归.逻辑回归.Softmax回归.神经网络和SVM等等,主要学习资料来自网上的免费课程和一些经典书籍,免费课 ...

- 机器学习笔记:Gradient Descent

机器学习笔记:Gradient Descent http://www.cnblogs.com/uchihaitachi/archive/2012/08/16/2642720.html

- 斯坦福机器学习视频笔记 Week1 Linear Regression and Gradient Descent

最近开始学习Coursera上的斯坦福机器学习视频,我是刚刚接触机器学习,对此比较感兴趣:准备将我的学习笔记写下来, 作为我每天学习的签到吧,也希望和各位朋友交流学习. 这一系列的博客,我会不定期的更 ...

- 深度学习课程笔记(四)Gradient Descent 梯度下降算法

深度学习课程笔记(四)Gradient Descent 梯度下降算法 2017.10.06 材料来自:http://speech.ee.ntu.edu.tw/~tlkagk/courses_MLDS1 ...

- 斯坦福机器学习视频笔记 Week1 线性回归和梯度下降 Linear Regression and Gradient Descent

最近开始学习Coursera上的斯坦福机器学习视频,我是刚刚接触机器学习,对此比较感兴趣:准备将我的学习笔记写下来, 作为我每天学习的签到吧,也希望和各位朋友交流学习. 这一系列的博客,我会不定期的更 ...

- ML:梯度下降(Gradient Descent)

现在我们有了假设函数和评价假设准确性的方法,现在我们需要确定假设函数中的参数了,这就是梯度下降(gradient descent)的用武之地. 梯度下降算法 不断重复以下步骤,直到收敛(repeat ...

- # ML学习小笔记—Gradien Descent

关于本课程的相关资料http://speech.ee.ntu.edu.tw/~tlkagk/courses_ML17.html 根据前面所为,当我们得到Loss方程的时候,我们希望求得最优的Loss方 ...

- 【笔记】机器学习 - 李宏毅 - 4 - Gradient Descent

梯度下降 Gradient Descent 梯度下降是一种迭代法(与最小二乘法不同),目标是解决最优化问题:\({\theta}^* = arg min_{\theta} L({\theta})\), ...

随机推荐

- C#方法中参数ref和out的解析

一.C#方法中参数类型 有4种参数类型,有时候很难记住它们的不同特征,下图对它们做一个总结,使之更容易比较和对照. 二.C#方法中的参数 1.值参数 使用值参数,通过复制实参的值到形参的方式把数据传递 ...

- JAVA基础知识总结:一

一.软件开发的常识 1.什么是软件? 一系列按照特定顺序组织起来的计算机数据或者指令 常见的软件: 系统软件:Windows\Mac OS \Linux 应用软件:QQ,一系列的播放器(爱奇艺,乐视, ...

- Yii2之mailer的使用

Mailer组件是yii框架自带的用于收发邮件的组件,无需安装,只需做一些配置即可使用,非常便捷.本文就mailer组件从配置到使用进行简单讲解. 首先在config/main.php配置如下: ...

- python 使用小结

使用Python 已经一段时间了 ,现将python 中可能用到的技巧和一些知识点分享如下. 1.lambda使用. Lambda函数,是一个匿名函数,创建语法: lambda parameters: ...

- Catch him

Problem Description 在美式足球中,四分卫负责指挥整只球队的进攻战术和跑位,以及给接球员传球的任务.四分卫是一只球队进攻组最重要的球员,而且一般身体都相对比较弱小,所以通常球队会安排 ...

- ssh密钥创建分发(端口号非22)&脚本实现自动创建分发密钥

1.1 服务端端口号变化了,如何基于秘钥连接 1.1.1 环境准备 实验环境: [root@test ~]# cat /etc/redhat-release CentOS release 6.9 (F ...

- 网络基础四 DNS DHCP 路由 FTP

第1章 网络基础 1.1 IP地址分类 IP地址的类别-按IP地址数值范围划分 IP地址的类别-按IP地址用途分类 IP地址的类别-按网络通信方式划分 1.2 局域网上网原理过程 DHCP原理过程详情 ...

- 前端的UI设计与交互之色彩篇

一.颜色Red热情.警示 Green成功.通过.安全 Blue专业.科技 Pink典雅.明快.女性 Orange醒目.温暖 Purple高雅.浪漫 Yellow活力.提示 Cyan清新.冷静.结构化 ...

- js和jquery实现监听键盘事件

一.使用javascript实现 <!DOCTYPE html> <html> <head> <meta charset="utf-8"& ...

- day4--老Word模板使用指南

Word常用快捷键 Ctrl + 1 一级标题 Ctrl + 2 二级标题 Ctrl + 3 三级标题 Ctrl + 5 代码块输入 Ctrl + 6 正文输入 专业的排版,一定要规范,目录,生成目录