lec-4-Introduction to Reinforcement Learning

模仿学习imitation learning与RL的不同

- 模仿学习中需要有专家指导的信息

- RL不需要访问专家信息

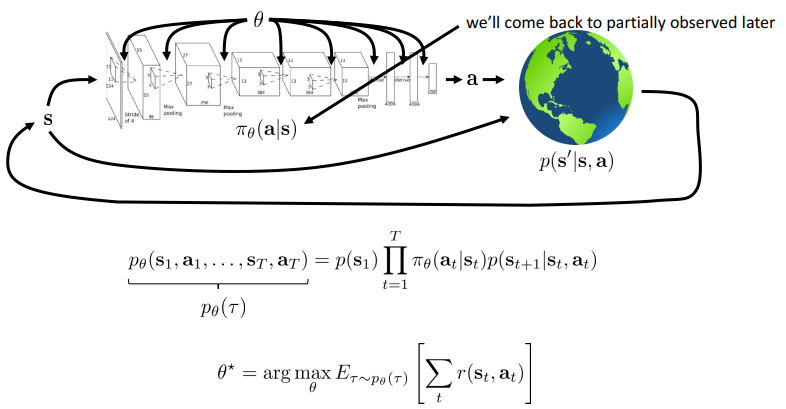

RL Definitions

- 奖励函数

- 马尔科夫决策链

- 只与上一个状态有关

- 目的

- 空间

- 有限

- 可找到最优参数

- 无限

- 证明p的概率分布是个平稳分布stationary distribution

- 有限

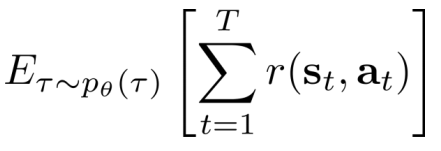

- 期望

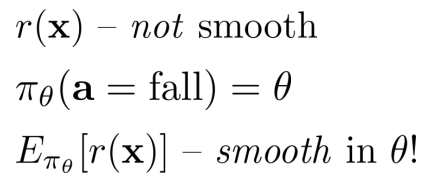

- 由于奖励函数是不平滑的

- 转换: 但是可以优化 看似不平滑甚至稀疏的奖励功能(不平滑or不可微的期望) 在可微且平稳的概率下的函数

- 转换: 但是可以优化 看似不平滑甚至稀疏的奖励功能(不平滑or不可微的期望) 在可微且平稳的概率下的函数

- 由于奖励函数是不平滑的

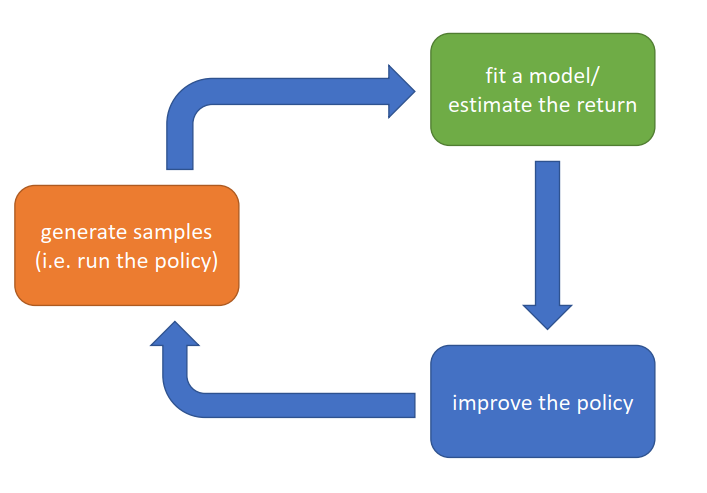

算法

基本过程:

- 生成样本→调整模型/估计回报(评估policy)→提升策略policy→生成样本

- 各部分代价

- 生成样本

Expensive:真实环境进行一次,也许代价会很高,机器人、车、电网等

cheap:模拟环境 - 评估policy

expensive:学习神经网络大量参数

cheap:MC等求均值等 - 提升policy

expensive:反向传播大量参数求导

cheap:回报均值梯度求导更新

- 生成样本

- 生成样本→调整模型/估计回报(评估policy)→提升策略policy→生成样本

Value Functions(基于值的)

- 核心:第二步(评估policy)使用Q-function or value function

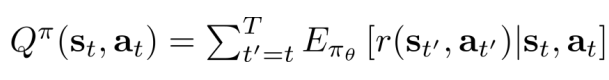

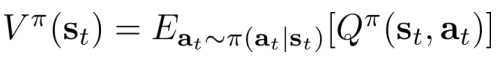

- 定义

- 期望:

- Q-function:

- Value function:

- 关系:

- Idea:

Policy iteration:Policy+Q-function → improve policy

比较QandV,if Q>V, 计算梯度增加动作概率

- 期望:

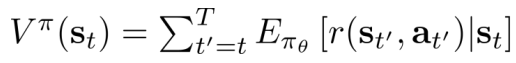

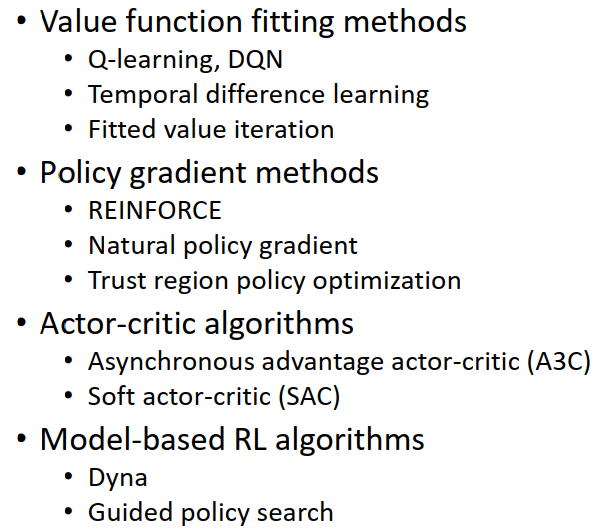

算法类型

- Policy gradients

- Value-based:拟合/评估Q、V

- Actor-critic

- Model-based RL:重点在提升policy上

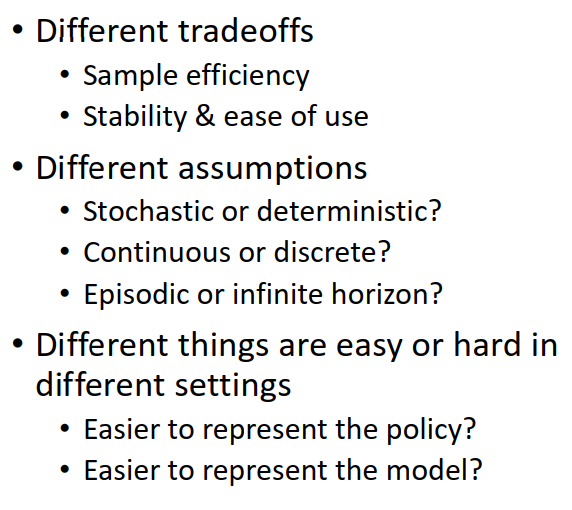

算法的tradeoffs(权衡)→以至于出现如此多算法

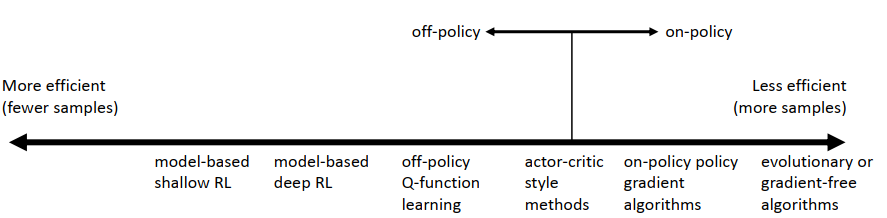

Sample efficiency

Stability and ease of use

- 值函数拟合:定点迭代

- 深度网络不能保证收敛性

- 基于模型的

- 收敛but不能保证model=better policy

- 策略梯度

- 只有一个在真正的目标上执行梯度下降(上升)的

- 值函数拟合:定点迭代

各类算法

Resource:CS285官网资料

版权归原作者 Lee_ing 所有

未经原作者允许不得转载本文内容,否则将视为侵权:转载或者引用本文内容请注明来源及原作者

lec-4-Introduction to Reinforcement Learning的更多相关文章

- Ⅰ Introduction to Reinforcement Learning

Dictum: To spark, often burst in hard stone. -- William Liebknecht 强化学习(Reinforcement Learning)是模仿人 ...

- 强化学习一:Introduction Of Reinforcement Learning

引言: 最近和实验室的老师做项目要用到强化学习的有关内容,就开始学习强化学习的相关内容了.也不想让自己学习的内容荒废掉,所以想在博客里面记载下来,方便后面复习,也方便和大家交流. 一.强化学习是什么? ...

- [转]Introduction to Learning to Trade with Reinforcement Learning

Introduction to Learning to Trade with Reinforcement Learning http://www.wildml.com/2018/02/introduc ...

- Introduction to Learning to Trade with Reinforcement Learning

http://www.wildml.com/2015/12/implementing-a-cnn-for-text-classification-in-tensorflow/ The academic ...

- (转) Deep Learning Research Review Week 2: Reinforcement Learning

Deep Learning Research Review Week 2: Reinforcement Learning 转载自: https://adeshpande3.github.io/ad ...

- (转)Applications of Reinforcement Learning in Real World

Applications of Reinforcement Learning in Real World 2018-08-05 18:58:04 This blog is copied from: h ...

- Training spiking neural networks for reinforcement learning

郑重声明:原文参见标题,如有侵权,请联系作者,将会撤销发布! 原文链接:https://arxiv.org/pdf/2005.05941.pdf Contents: Abstract Introduc ...

- 强化学习 reinforcement learning: An Introduction 第一章, tic-and-toc 代码示例 (结构重建版,注释版)

强化学习入门最经典的数据估计就是那个大名鼎鼎的 reinforcement learning: An Introduction 了, 最近在看这本书,第一章中给出了一个例子用来说明什么是强化学习, ...

- 深度强化学习(Deep Reinforcement Learning)入门:RL base & DQN-DDPG-A3C introduction

转自https://zhuanlan.zhihu.com/p/25239682 过去的一段时间在深度强化学习领域投入了不少精力,工作中也在应用DRL解决业务问题.子曰:温故而知新,在进一步深入研究和应 ...

- Reinforcement Learning: An Introduction读书笔记(3)--finite MDPs

> 目 录 < Agent–Environment Interface Goals and Rewards Returns and Episodes Policies and Val ...

随机推荐

- Android笔记--数据存储之SharedPreferences

SharedPreferences--轻量级存储工具(共享参数) 其采用的存储结构是Key-Value的键值对方式 SharedPreferences用法以及相关的简单案例 记住密码的实现 实现啦! ...

- PatriotCTF 2022 RE

PatriotCTF 2022 RE String Cheese ida 打开 Shift+F12 即可得到flag PCTF{d0nt_string_m3_410ng_b3_my_v413ntin3 ...

- Java面试——专业技能

目录 一.简单讲下 Java 的跨平台原理 二.装箱与拆箱 三.实现一个拷贝文件的工具类使用字节流还是字符流 四.介绍下线程池 五.JSP和 Servlet 有哪些相同点和不同点 六.简单介绍一下关系 ...

- 分布式 WEB应用中Session(会话管理)的变迁之路

一.Session 介绍 Session 一词直译为 "会话",意指有始有终的一系列动作/消息.Session 是 Web 应用蓬勃发展的产物之一.在 Web 应用中隐含有&quo ...

- Mysql 备份方案

一.为什么要备份 [1]容灾恢复:硬件故障.不经意的 Bug 导致数据损坏,或者服务器及其数据由于某些原因不可获取或无法使用等(例如:机房大楼烧毁,恶意的黑客攻击或 Mysql 的 Bug 等).[2 ...

- 安装原版Windows自动安装已经备份的驱动

安装完Windows10后联网会自动更新驱动,除了自动更新.如果不让新安装的Windows系统自动安装驱动以外,还有自己手动安装驱动的方式.如何在安装系统过程中就让系统自己安装好驱动? 重装系统首先要 ...

- Spark基础实验七

今天在做实验七,最开始有许许多多多的错误,最后通过查找.问同学才知道是数据集的格式和存放位置的原因. 就在好不容易解决了上一个错误,下一个错误就立马而来,错误如下: 目前还未找到解决办法,spark实 ...

- Qt连接不上Linux服务器?

目录 1. Qt连接代码 2. 问题分析(按照顺序排除) 2.1 服务器IP是否能被Ping通? 2.2 客户端中的服务器IP和Port是否填写正确? 2.3 Linux的代码处理是否正确? 2.4 ...

- Windows的压缩文件夹(zip/cab)

https://weibo.com/1114096665/DtHXgvnva #windows10# 硬要把zip.cab文件当文件夹,不爽怎么解决? 删除注册表 "HKEY_CLASSES ...

- [ACM]快速排序模板

思路 快排基本思路应该就是二分+递归,从两侧同时(实则先从右往左)往中间找,同时和参变量对比,发现位置颠倒后交换位置,然后通过二分将其一块一块的分割开,直到分割到一个元素位置,即完成了快排. 代码 # ...