Spark学习笔记——键值对操作

键值对 RDD是 Spark 中许多操作所需要的常见数据类型

键值对 RDD 通常用来进行聚合计算。我们一般要先通过一些初始 ETL(抽取、转化、装载)操作来将数据转化为键值对形式。

Spark 为包含键值对类型的 RDD 提供了一些专有的操作。

1.创建Pair RDD

val input = sc.parallelize(List(1, 2, 3, 4))

val pairs = input.map(x => (x+1, x))

for (pair <- pairs){

println(pair)

}

//输出

(2,1)

(3,2)

(4,3)

(5,4)

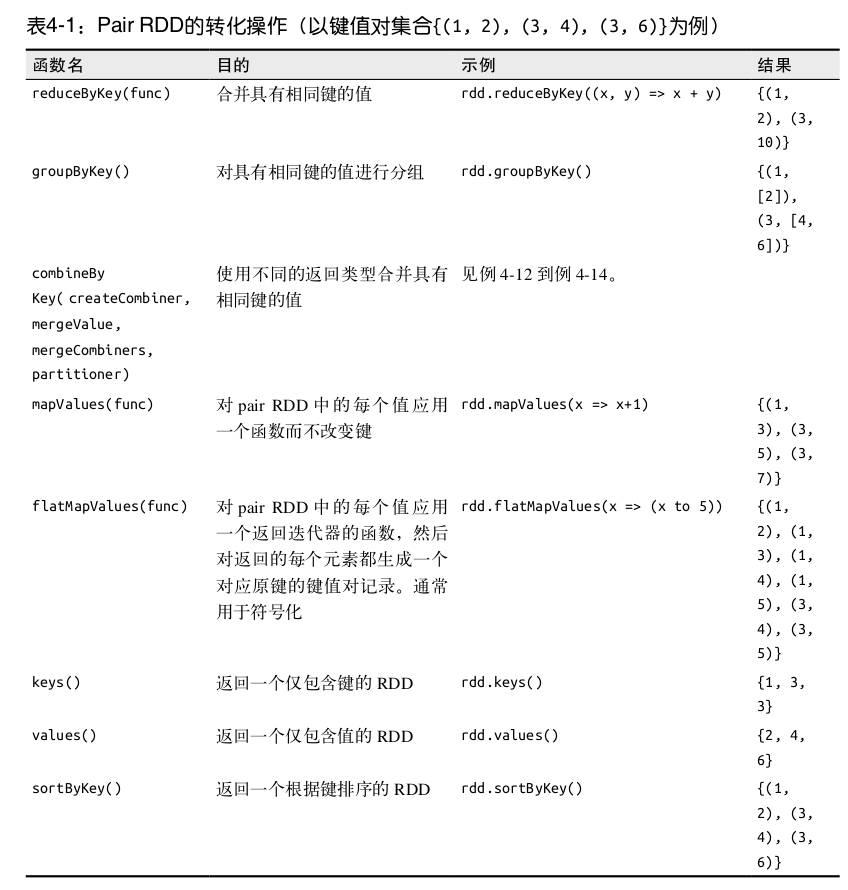

2.Pair RDD的转化操作

Pair RDD 可以使用所有标准 RDD 上的可用的转化操作。

Pair RDD也支持RDD所支持的函数

pairs.filter{case (key, value) => value.length < 20}

3.聚合操作

类似fold() 、 combine() 、 reduce() 等行动操作,这些操作返回 RDD,因此它们是转化操作而不是行动操作。

reduceByKey()函数,接收一个函数,并使用这个函数对值进行合并

val wordCount = textFile.flatMap(line => line.split(" ")).map(word => (word, 1)).reduceByKey((a, b) => a + b) #切分成单词,转换成键值对并计数

或者

input.flatMap(x => x.split(" ")).countByValue()

foldByKey()函数,也是接收一个函数,并使用这个函数对值进行合并,提供初始值

rdd.mapValues(x => (x, 1)).reduceByKey((x, y) => (x._1 + y._1, x._2 + y._2))

countByValue()函数

val textFile = sc.textFile(inputFile)

val result1 = textFile.flatMap(x => x.split(" ")).countByValue()

println(result1)

输出:Map(cc -> 3, aa -> 6, bb -> 3, ee -> 3, ff -> 2, hh -> 1, dd -> 1, gg -> 1)

combineByKey()函数,使用 combineByKey() 求每个键对应的平均值

val data = Seq(("a", 3), ("b", 4), ("a", 1))

val input2 = sc.parallelize(data)

//使用 combineByKey() 求每个键对应的平均值

val result2 = input2.combineByKey(

(v) => (v, 1),

(acc: (Int, Int), v) => (acc._1 + v, acc._2 + 1),

(acc1: (Int, Int), acc2: (Int, Int)) => (acc1._1 + acc2._1, acc1._2 + acc2._2)

).map{ case (key, value) => (key, value._1 / value._2.toFloat) }

result2.collectAsMap().map(println(_))

//输出

(b,4.0)

(a,2.0)

4.数据分组

groupByKey()函数,将数据根据键进行分组

val data = Seq(("a", 3), ("b", 4), ("a", 1))

val input2 = sc.parallelize(data)

val result3 = input2.groupByKey()

for (result <- result3)

println(result)

//输出:

(a,CompactBuffer(3, 1))

(b,CompactBuffer(4))

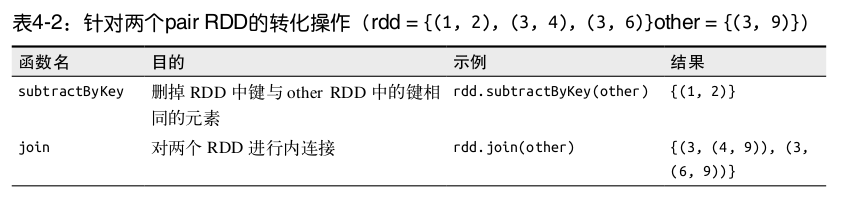

5.连接

join操作符

val input = sc.parallelize(List(1, 2, 3, 4))

val pairs1 = input.map(x => (x+1, x))

//输出(2,1),(3,2),(4,3),(5,4)

val pairs2 = input.map(x => (x+1, 1))

//输出(2,1),(3,1),(4,1),(5,1)

for(pair <- pairs1.join(pairs2)){

println(pair)

}

//输出(4,(3,1)),(3,(2,1)),(5,(4,1)),(2,(1,1))

有时,我们不希望结果中的键必须在两个 RDD 中都存在,join的部分可以不存在

leftOuterJoin(other) 和 rightOuterJoin(other) 都会根据键连接两个 RDD,但是允许结果中存在其中的一个 pair RDD 所 缺失的键。

leftOuterJoin(other)结果

(4,(3,Some(1)))

(3,(2,Some(1)))

(5,(4,Some(1)))

(2,(1,Some(1)))

rightOuterJoin(other)结果

(4,(Some(3),1))

(3,(Some(2),1))

(5,(Some(4),1))

(2,(Some(1),1))

6.数据排序

在 Scala 中以字符串顺序对整数进行自定义排序

val input = sc.parallelize(List(1, 2, 3, 4))

val pairs1 = input.map(x => (x + 1, x))

implicit val sortIntegersByString = new Ordering[Int] {

override def compare(a: Int, b: Int) = b.toString.compare(a.toString)

}

for(pair <- pairs1.sortByKey())

println(pair)

//输出

(5,4)

(4,3)

(3,2)

(2,1)

Spark学习笔记——键值对操作的更多相关文章

- Spark学习之键值对操作总结

键值对 RDD 是 Spark 中许多操作所需要的常见数据类型.键值对 RDD 通常用来进行聚合计算.我们一般要先通过一些初始 ETL(抽取.转化.装载)操作来将数据转化为键值对形式.键值对 RDD ...

- Spark学习之键值对(pair RDD)操作(3)

Spark学习之键值对(pair RDD)操作(3) 1. 我们通常从一个RDD中提取某些字段(如代表事件时间.用户ID或者其他标识符的字段),并使用这些字段为pair RDD操作中的键. 2. 创建 ...

- Spark中的键值对操作-scala

1.PairRDD介绍 Spark为包含键值对类型的RDD提供了一些专有的操作.这些RDD被称为PairRDD.PairRDD提供了并行操作各个键或跨节点重新进行数据分组的操作接口.例如,Pa ...

- Spark中的键值对操作

1.PairRDD介绍 Spark为包含键值对类型的RDD提供了一些专有的操作.这些RDD被称为PairRDD.PairRDD提供了并行操作各个键或跨节点重新进行数据分组的操作接口.例如,Pa ...

- Spark学习笔记3:键值对操作

键值对RDD通常用来进行聚合计算,Spark为包含键值对类型的RDD提供了一些专有的操作.这些RDD被称为pair RDD.pair RDD提供了并行操作各个键或跨节点重新进行数据分组的操作接口. S ...

- spark入门(三)键值对操作

1 简述 Spark为包含键值对类型的RDD提供了一些专有的操作.这些RDD被称为PairRDD. 2 创建PairRDD 2.1 在sprk中,很多存储键值对的数据在读取时直接返回由其键值对数据组成 ...

- Spark基础:(三)Spark 键值对操作

1.pair RDD的简介 Spark为包含键值对类型的RDD提供了一些专有的操作,这些RDD就被称为pair RDD 那么如何创建pair RDD呢? 在不同的语言中有着不同的创建方式 在pytho ...

- Spark学习笔记之SparkRDD

Spark学习笔记之SparkRDD 一. 基本概念 RDD(resilient distributed datasets)弹性分布式数据集. 来自于两方面 ① 内存集合和外部存储系统 ② ...

- Spark学习笔记3——RDD(下)

目录 Spark学习笔记3--RDD(下) 向Spark传递函数 通过匿名内部类 通过具名类传递 通过带参数的 Java 函数类传递 通过 lambda 表达式传递(仅限于 Java 8 及以上) 常 ...

随机推荐

- 工具使用-----Jmeter教程 简单的压力测试

摘抄于http://www.cnblogs.com/TankXiao/p/4059378.html 以下是英文版的,中文版的也差不多的 Jmeter是一个非常好用的压力测试工具. Jmeter用来做 ...

- 2016年3月16日Android学习笔记

1.Jdk1.7以上switch语句中才能用字符串,在Android Studio中我改正了jdk的版本为1.8,但是还是出同样的错误,原来我用的sdk版本是4.4的,改成5的就没有问题了. 2.引入 ...

- webpack总结

1.webpack默认只能引用js文件,通过loader可以引入别的文件(css.image.font等) 2.webpack-dev-server提供了一个web server,通过配置将dist目 ...

- PPPOE

本质上,它是一个允许在以太网广播域中的两个以太网接口间创建点对点隧道的协议. PPPoE(英语:Point-to-Point Protocol Over Ethernet),以太网上的点对点协议,是将 ...

- Intellij IDEA 通过数据库表逆向生成带注释的实体类文件超级详细步骤,附详细解决方案

参考:https://blog.csdn.net/qq_34371461/article/details/80571281 https://blog.csdn.net/mqchenrong/arti ...

- CentOS 7源码安装zabbix

一.Zabbix简介 zabbix是一个基于WEB界面的提供分布式系统监视以及网络监视功能的企业级的开源解决方案.zabbix能监视各种网络参数,保证服务器系统的安全运营:并提供灵活的通知机制以让系统 ...

- Swap 分区的2种方式 详解与例子

安装完Linux系统后,swap分区太小怎么办,怎么可以扩大Swap分区呢?有两个办法,一个是从新建立swap分区,一个是增加swap分区.下面介绍这两种方法: 第一您必须有root权限,过程中一定要 ...

- aaronyang的百度地图API之LBS云与.NET开发 Javascript API 2.0【把数据存到LBS云2/2】

中国的IT 需要无私分享和贡献的人,一起努力 本篇博客来自地址:http://www.cnblogs.com/AaronYang/p/3672898.html,请支持原创,未经允许不许转载 1.新建一 ...

- Easyui datagrid 特殊处理,记录笔记

1. 特殊的单元格样式 columns中 { field: , styler: function (value, row, index) { ') { return 'background-color ...

- 【转】java 读取 excel 2003 或 excel 2007

package com.my.login; import java.io.File; import java.io.FileInputStream; import java.io.IOExceptio ...