tf.nn.conv2d实现卷积的过程

#coding=utf-8 import tensorflow as tf

#case 2

input = tf.Variable(tf.round(10 * tf.random_normal([1,3,3,2])))

filter = tf.Variable(tf.round(5 * tf.random_normal([1,1,2,1])))

op2 = tf.nn.conv2d(input, filter, strides=[1, 1, 1, 1], padding='VALID')

#对于filter,多个输入通道,变成一个输入通道,是对各个通道上的卷积值进行相加

init = tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

print("case 2")

print("input: ", sess.run(input))

print("filter: ", sess.run(filter))

print("conv ", sess.run(op2))

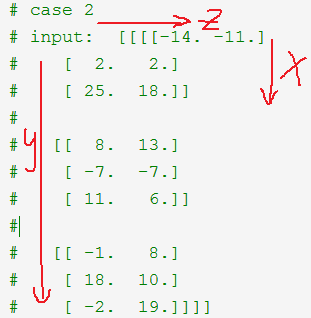

# case 2

# input: [[[[-14. -11.]

# [ 2. 2.]

# [ 25. 18.]]

#

# [[ 8. 13.]

# [ -7. -7.]

# [ 11. 6.]]

#

# [[ -1. 8.]

# [ 18. 10.]

# [ -2. 19.]]]]

# filter: [[[[-3.]

# [ 2.]]]] # conv [[[[ 20.]

# [ -2.]

# [-39.]]

#

# [[ 2.]

# [ 7.]

# [-21.]]

#

# [[ 19.]

# [-34.]

# [ 44.]]]]

#转换:输入为3*3的2通道数据

#通道1:

#[-14 2 25],

#[8 -7 11],

#[-1 18 -2]

#通道2:

#[-11 2 18],

#[13 -7 6],

#[8 10 19]

#conv转换

#[20 -2 -39],

#[2 -7 -21],

#[9 -34 44] #计算过程

#[-14 2 25],

#[8 -7 11], * [-3] +

#[-1 18 -2]

#[-11 2 18],

#[13 -7 6], * [2]

#[8 10 19]

#result

#[20 -2 -39],

#[2 -7 -21],

#[9 -34 44]

tf.nn.conv2d实现卷积的过程的更多相关文章

- tf.nn.conv2d。卷积函数

tf.nn.conv2d是TensorFlow里面实现卷积的函数,参考文档对它的介绍并不是很详细,实际上这是搭建卷积神经网络比较核心的一个方法,非常重要 tf.nn.conv2d(input, fil ...

- 深度学习原理与框架-Tensorflow卷积神经网络-卷积神经网络mnist分类 1.tf.nn.conv2d(卷积操作) 2.tf.nn.max_pool(最大池化操作) 3.tf.nn.dropout(执行dropout操作) 4.tf.nn.softmax_cross_entropy_with_logits(交叉熵损失) 5.tf.truncated_normal(两个标准差内的正态分布)

1. tf.nn.conv2d(x, w, strides=[1, 1, 1, 1], padding='SAME') # 对数据进行卷积操作 参数说明:x表示输入数据,w表示卷积核, stride ...

- tf.nn.conv2d卷积函数之图片轮廓提取

一.tensorflow中二维卷积函数的参数含义:def conv2d(input, filter, strides, padding, use_cudnn_on_gpu=True, data_for ...

- tf入门-tf.nn.conv2d是怎样实现卷积的?

转自:https://blog.csdn.net/mao_xiao_feng/article/details/78004522 实验环境:tensorflow版本1.2.0,python2.7 介绍 ...

- 【TensorFlow】tf.nn.conv2d是怎样实现卷积的?

tf.nn.conv2d是TensorFlow里面实现卷积的函数,参考文档对它的介绍并不是很详细,实际上这是搭建卷积神经网络比较核心的一个方法,非常重要 tf.nn.conv2d(input, fil ...

- tf.nn.conv2d 卷积

tf.nn.conv2d(input, filter, strides, padding, use_cudnn_on_gpu=None, name=None) 第一个参数input:指需要做卷积的输入 ...

- 深度学习原理与框架-图像补全(原理与代码) 1.tf.nn.moments(求平均值和标准差) 2.tf.control_dependencies(先执行内部操作) 3.tf.cond(判别执行前或后函数) 4.tf.nn.atrous_conv2d 5.tf.nn.conv2d_transpose(反卷积) 7.tf.train.get_checkpoint_state(判断sess是否存在

1. tf.nn.moments(x, axes=[0, 1, 2]) # 对前三个维度求平均值和标准差,结果为最后一个维度,即对每个feature_map求平均值和标准差 参数说明:x为输入的fe ...

- TensorFlow使用记录 (二): 理解tf.nn.conv2d方法

方法定义 tf.nn.conv2d(input, filter, strides, padding, use_cudnn_on_gpu=True, data_format="NHWC&quo ...

- TF-卷积函数 tf.nn.conv2d 介绍

转自 http://www.cnblogs.com/welhzh/p/6607581.html 下面是这位博主自己的翻译加上测试心得 tf.nn.conv2d是TensorFlow里面实现卷积的函数, ...

随机推荐

- linux中echo的使用方法

1.echo命令我们经常使用的选项有两个,一个是-n,表示输出之后不换行.另外一个是-e,表示对于转义字符按对应的方式处理,假设不加-e那么对于转义字符会按普通字符处理. 2.echo输出时的转义字符 ...

- Linux系统扩容根目录磁盘空间

作者:非法小恋 一.使用背景 Linux根目录磁盘空间不够用了,当修改了虚拟机模版增加磁盘大小或者插入了一块新硬盘,但是发现系统里的大小还是没改变. 产生的原因是没有给磁盘格式化,没有增加分区. 二. ...

- Linux中内存挂载到目录下

[日期:2012-11-14] /dev/shm是linux下的一块共享内存结构.默认大小是真实内存的一半.它用来存储进程间通讯时的一些共享数据结构.在物理内存足够时,会在内存中进行数据交换,如果 ...

- for循环和增强版的for循环

增强的for循环. 缺点: 对于数组.不能方便的訪问下标值. 对于集合,与使用Interator相比.不能方便的删除集合中的内容(在内部也是调用Interator). 除了简单遍历并读取当中的 ...

- hibernate 中多对多关系对象集合的保存

多对多关系映射和一对多关系映射开发步骤差不多, 例子如下:员工和项目之间的关系,一个员工可以参与多个项目:一个项目可以有多个开发人员参与.因此是多对多的关系. 1 分析数据表 1.1)员工表 CREA ...

- vim中不同模式的帮助信息的查找

vim的模式有多种,比如normal(普通模式),insert(插入模式),command(命令行模式),visual(可视化模式).相同的命令和快捷键在不同的模式下功能是不一样的,因此帮助信息也是分 ...

- mysql远程登录出错的解决方法

mysql远程登录出错的情况,先比很多朋友都有遇到过吧,下面有个不错的解决方法,大家可以参考下. 错误:ERROR 2003 (HY000): Can't connect to MySQL serve ...

- 严重: Dispatcher initialization failed java.lang.RuntimeException: java.lang.reflect.Invoc

错误提示:严重: Dispatcher initialization failed java.lang.RuntimeException: java.lang.reflect.InvocationTa ...

- python中unicode和unicodeescape

在python中,unicode是内存编码集,一般我们将数据存储到文件时,需要将数据先编码为其他编码集,比如utf-8.gbk等. 读取数据的时候再通过同样的编码集进行解码即可. #python3 & ...

- map area 标签的使用

<!DOCTYPE html> <html> <head> <meta charset="utf-8"> <title> ...