LeNet

LeNet

模型特点

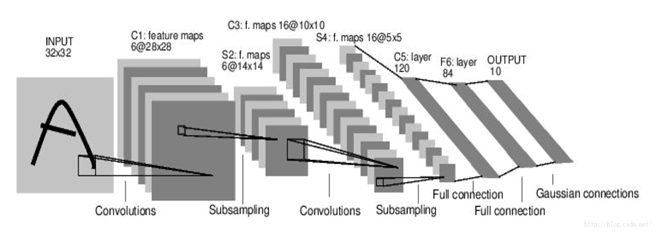

结构模型

图1-1 LeNet结构示意

网络层介绍

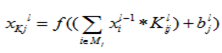

对于卷积层,其计算公式为

其中K表示由L层到L+1层要产生的feature的数量,表示“卷积核”,表示偏置,也就是bias,

令卷积核的大小为5*5,总共就有6*(5*5+1)=156个参数,

对于卷积层C1,每个像素都与前一层的5*5个像素和1个bias有连接,

所以总共有156*28*28=122304个连接(connection)。

对于LeNet5,S2这个pooling层是对C1中的2*2区域内的像素求和再加上一个偏置,

然后将这个结果再做一次映射(sigmoid等函数),所以相当于对S1做了降维,此处共有6*2=12个参数。

S2中的每个像素都与C1中的2*2个像素和1个偏置相连接,所以有6*5*14*14=5880个连接(connection)。

除此外,pooling层还有max-pooling和mean-pooling这两种实现,

max-pooling即取2*2区域内最大的像素,而mean-pooling即取2*2区域内像素的均值。

LeNet5最复杂的就是S2到C3层,其连接如下图所示。

前6个feature map与S2层相连的3个feature map相连接,

后面6个feature map与S2层相连的4个feature map相连接,

后面3个feature map与S2层部分不相连的4个feature map相连接,

最后一个与S2层的所有feature map相连。

卷积核大小依然为5*5,

所以总共有6*(3*5*5+1)+6*(4*5*5+1)+3*(4*5*5+1)+1*(6*5*5+1)=1516个参数。

而图像大小为10*10,所以共有151600个连接。

S4是pooling层,窗口大小仍然是2*2,共计16个feature map,

所以32个参数,16*(25*4+25)=2000个连接。

C5是卷积层,总共120个feature map,每个feature map与S4层所有的feature map相连接,卷积核大小是5*5,

而S4层的feature map的大小也是5*5,所以C5的feature map就变成了1个点,共计有120(25*16+1)=48120个参数。

F6相当于MLP中的隐含层,有84个节点,所以有84*(120+1)=10164个参数。

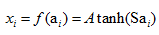

F6层采用了正切函数,计算公式为,

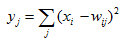

输出层采用了RBF函数,即径向欧式距离函数,计算公式为,

以上就是LeNet5的结构。

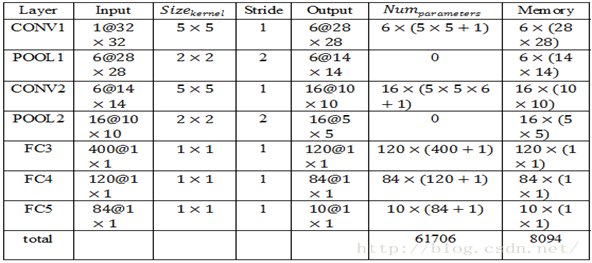

表1 LeNet各层输入输出及资源使用

LeNet的更多相关文章

- 卷积神经网络(CNN)学习算法之----基于LeNet网络的中文验证码识别

由于公司需要进行了中文验证码的图片识别开发,最近一段时间刚忙完上线,好不容易闲下来就继上篇<基于Windows10 x64+visual Studio2013+Python2.7.12环境下的C ...

- caffe_手写数字识别Lenet模型理解

这两天看了Lenet的模型理解,很简单的手写数字CNN网络,90年代美国用它来识别钞票,准确率还是很高的,所以它也是一个很经典的模型.而且学习这个模型也有助于我们理解更大的网络比如Imagenet等等 ...

- #Deep Learning回顾#之LeNet、AlexNet、GoogLeNet、VGG、ResNet

CNN的发展史 上一篇回顾讲的是2006年Hinton他们的Science Paper,当时提到,2006年虽然Deep Learning的概念被提出来了,但是学术界的大家还是表示不服.当时有流传的段 ...

- 基于LeNet网络的中文验证码识别

基于LeNet网络的中文验证码识别 由于公司需要进行了中文验证码的图片识别开发,最近一段时间刚忙完上线,好不容易闲下来就继上篇<基于Windows10 x64+visual Studio2013 ...

- 【Caffe 测试】Training LeNet on MNIST with Caffe

Training LeNet on MNIST with Caffe We will assume that you have Caffe successfully compiled. If not, ...

- CNN网络架构演进:从LeNet到DenseNet

卷积神经网络可谓是现在深度学习领域中大红大紫的网络框架,尤其在计算机视觉领域更是一枝独秀.CNN从90年代的LeNet开始,21世纪初沉寂了10年,直到12年AlexNet开始又再焕发第二春,从ZF ...

- 经典卷积神经网络(LeNet、AlexNet、VGG、GoogleNet、ResNet)的实现(MXNet版本)

卷积神经网络(Convolutional Neural Network, CNN)是一种前馈神经网络,它的人工神经元可以响应一部分覆盖范围内的周围单元,对于大型图像处理有出色表现. 其中 文章 详解卷 ...

- 卷积神经网络的一些经典网络(Lenet,AlexNet,VGG16,ResNet)

LeNet – 5网络 网络结构为: 输入图像是:32x32x1的灰度图像 卷积核:5x5,stride=1 得到Conv1:28x28x6 池化层:2x2,stride=2 (池化之后再经过激活函数 ...

- 卷积神经网络之LeNet

开局一张图,内容全靠编. 上图引用自 [卷积神经网络-进化史]从LeNet到AlexNet. 目前常用的卷积神经网络 深度学习现在是百花齐放,各种网络结构层出不穷,计划梳理下各个常用的卷积神经网络结构 ...

- 深度学习识别CIFAR10:pytorch训练LeNet、AlexNet、VGG19实现及比较(三)

版权声明:本文为博主原创文章,欢迎转载,并请注明出处.联系方式:460356155@qq.com VGGNet在2014年ImageNet图像分类任务竞赛中有出色的表现.网络结构如下图所示: 同样的, ...

随机推荐

- python线程的GIL问题(全局解释器锁)

造成原因: python ---> 支持线程操作 --->IO的同步和互斥 --> 加锁 ----> 超级锁,给解释器加锁--->解释器同一时刻只能解释一个线程 造成的后 ...

- POI2010题解

POI2010题解 我也不知道我为什么就开始刷POI了 有些题目咕掉了所以不完整(我都不知道POI到底有多少题) [BZOJ2079][Poi2010]Guilds (貌似bz跟洛谷上的不是一个题?) ...

- 几种Python执行时间的计算方法

究竟是使用 time.clock() 精度高,还是使用 time.time() 精度更高,要视乎所在的平台来决定.总概来讲,在 Unix 系统中,建议使用 time.time(),在 Windows ...

- 使用docker 部署graylog集群

graylog 相比elk 有比较简单的方面,使用简单,配置简单,可视化工具是一体化的,比较方便 搭建使用docker,多主机部分,结合docker-compose 进行管理 具体docker 配置文 ...

- [原][Java]eclipse 修改自动提示

下载 jar 链接:http://files.cnblogs.com/files/z5337/org.eclipse.jface.text_3.7.2.v20111213-1208.zip 或者这个: ...

- Linux服务器安全之用户密钥认证登录

转自:http://blog.sina.com.cn/s/blog_6561ca8c0102vb0d.html 一. 密钥简介 在Linux下,远程登录系统有两种认证方式:密码认证和密钥认证.密码认证 ...

- struts1的一个简单登陆功能

Login.jsp: <form action="<%= request.getContextPath() %>/login.do" method="p ...

- Web Api HelpPage

为了方面APP开发人员,服务端的接口都应当提供详尽的API说明.但每次有修改,既要维护代码,又要维护文档,一旦开发进度紧张,很容易导致代码与文档不一致. Web API有一个Help Page插件,可 ...

- Spring boot with Apache Hive

5.29.1. Maven <dependency> <groupId>org.springframework.boot</groupId> <artif ...

- 分布式锁实践(二)-ZooKeeper实现总结

写在最前面 前几周写了篇 利用Redis实现分布式锁 ,今天简单总结下ZooKeeper实现分布式锁的过程.其实生产上我只用过Redis或者数据库的方式,之前还真没了解过ZooKeeper怎么实现分布 ...