示例 NetworkWordCount

import org.apache.spark.storage.StorageLevel

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext} /**

* WordCount程序,Spark Streaming消费TCP Server发过来的实时数据的例子:

*

* 1、在master服务器上启动一个Netcat server

* `$ nc -lk 9998` (如果nc命令无效的话,我们可以用yum install -y nc来安装nc)

*

*

*/

object LocalNetworkWordCount {

def main(args: Array[String]) { // StreamingContext 编程入口

//local[2] 启用两个core, 一个线程用于接收数据,一个线程用于处理数据

//Seconds(1) 每隔一秒钟处理一次

val ssc = new StreamingContext("local[2]", "LocalNetworkWordCount", Seconds(1),

System.getenv("SPARK_HOME"), StreamingContext.jarOfClass(this.getClass).toSeq) //数据接收器(Receiver)

//创建一个接收器(ReceiverInputDStream),这个接收器接收一台机器上的某个端口通过socket发送过来的数据并处理

val lines = ssc.socketTextStream("localhost", 9998, StorageLevel.MEMORY_AND_DISK_SER) //数据处理(Process)

//处理的逻辑,就是简单的进行word count

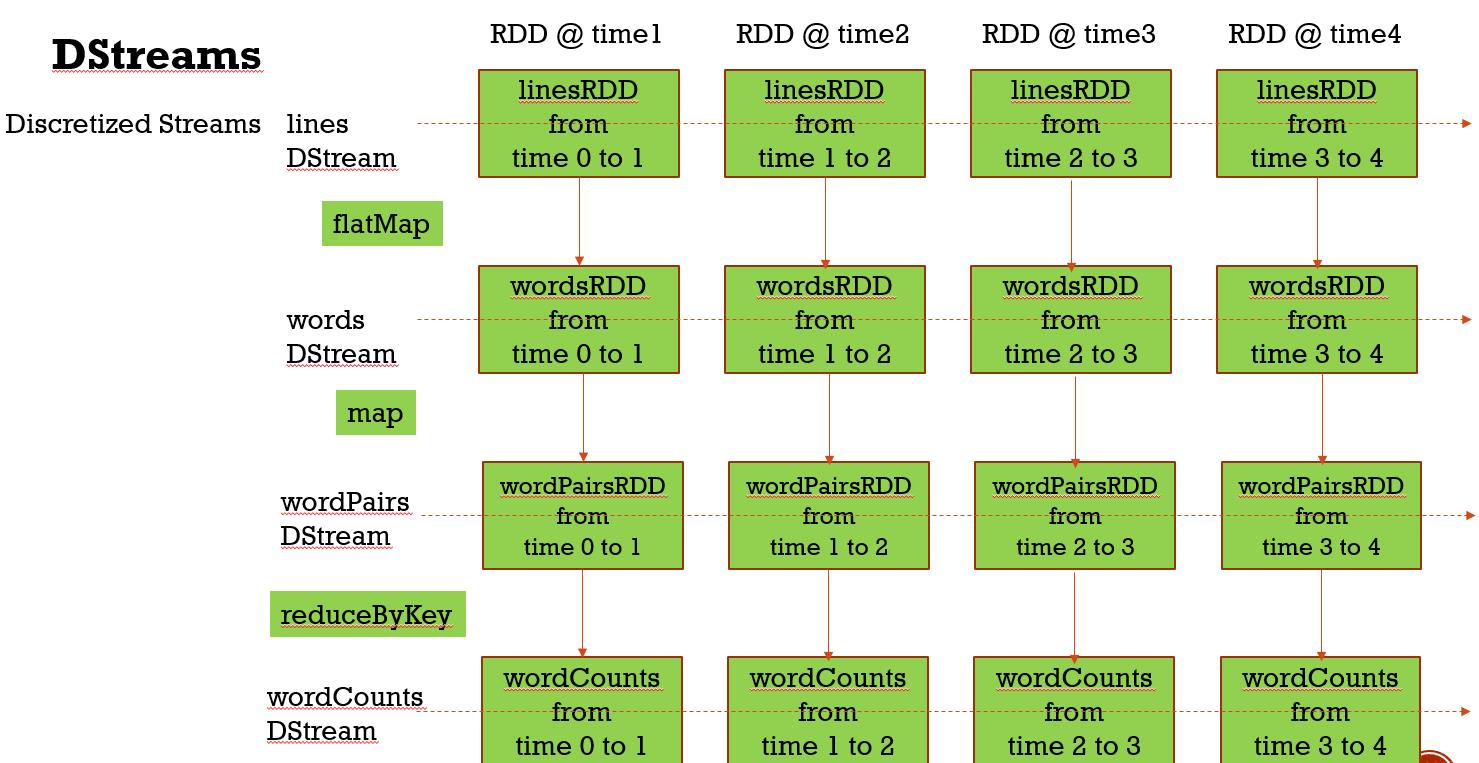

val words = lines.flatMap(_.split(" "))

val wordPairs = words.map(x => (x, 1))

val wordCounts = wordPairs.reduceByKey(_ + _) //结果输出(Output)

//将结果输出到控制台

wordCounts.print() //启动Streaming处理流

ssc.start() //等待Streaming程序终止

// 7 X 24 小时运行,一直等待不会停止

//注释该行代码后,运行一次便终止(必须打开)

ssc.awaitTermination()

}

}

NetworkWordCount

import org.apache.spark.{SparkConf, SparkContext}

import org.apache.spark.storage.StorageLevel

import org.apache.spark.streaming.{Seconds, StreamingContext}

/**

* WordCount程序,Spark Streaming消费TCP Server发过来的实时数据的例子:

*

* 1、在master服务器上启动一个Netcat server

* `$ nc -lk 9998` (如果nc命令无效的话,我们可以用yum install -y nc来安装nc)

*

* 2、用下面的命令在在集群中将Spark Streaming应用跑起来

spark-submit --class com.twq.streaming.NetworkWordCount \

--master spark://master:7077 \

--deploy-mode client \

--driver-memory 512m \

--executor-memory 512m \

--total-executor-cores 4 \

--executor-cores 2 \

/home/hadoop-twq/spark-course/streaming/spark-streaming-basic-1.0-SNAPSHOT.jar

*/

object NetworkWordCount {

def main(args: Array[String]) {

val sparkConf = new SparkConf().setAppName("NetworkWordCount")

val sc = new SparkContext(sparkConf)

// StreamingContext 编程入口

val ssc = new StreamingContext(sc, Seconds(1))

//数据接收器(Receiver)

//创建一个接收器(ReceiverInputDStream),这个接收器接收一台机器上的某个端口通过socket发送过来的数据并处理

// StorageLevel.MEMORY_AND_DISK_SER_2 通过该方式存储在内存中 先放入内存中,内存不够放在磁盘中,以字节的方式储存,储存两份

val lines = ssc.socketTextStream("master", 9998, StorageLevel.MEMORY_AND_DISK_SER_2)

//数据处理(Process)

//处理的逻辑,就是简单的进行word count

val words = lines.flatMap(_.split(" "))

val wordPairs = words.map(x => (x, 1))

val wordCounts = wordPairs.reduceByKey(_ + _)

//结果输出(Output)

//将结果输出到控制台

wordCounts.print()

//启动Streaming处理流

ssc.start()

//等待Streaming程序终止

ssc.awaitTermination()

}

}

import org.apache.spark.storage.StorageLevel

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext} /**

* WordCount程序,Spark Streaming消费TCP Server发过来的实时数据的例子:

*

* 1、在master服务器上启动一个Netcat server

* `$ nc -lk 9998` (如果nc命令无效的话,我们可以用yum install -y nc来安装nc)

*

* 2、用下面的命令在在集群中将Spark Streaming应用跑起来

spark-submit --class com.twq.streaming.NetworkWordCountDetail \

--master spark://master:7077 \

--deploy-mode client \

--driver-memory 512m \

--executor-memory 512m \

--total-executor-cores 4 \

--executor-cores 2 \

/home/hadoop-twq/spark-course/streaming/spark-streaming-basic-1.0-SNAPSHOT.jar

*/

object NetworkWordCountDetail {

def main(args: Array[String]) {

val sparkConf = new SparkConf().setAppName("NetworkWordCount")

val sc = new SparkContext(sparkConf) // Create the context with a 1 second batch size //1、StreamingContext 是 Spark Streaming程序的入口,那么StreamingContext和SparkContext的关系是什么呢?

//1.1、StreamingContext需要持有一个SparkContext的引用

val ssc = new StreamingContext(sc, Seconds(1)) //1.2、如果SparkContext没有启动的话,我们可以用下面的代码启动一个StreamingContext

val ssc2 = new StreamingContext(sparkConf, Seconds(1)) //这行代码会在内部启动一个SparkContext

ssc.sparkContext //可以从StreamingContext中获取到SparkContext

//1.3、对StreamingContext调用stop的话,可能会将SparkContext stop掉,

// 如果不想stop掉SparkContext,我们可以调用

ssc.stop(false) sc.stop() //2:StreamingContext的注意事项:

// 2.1、在同一个时间内,同一个JVM中StreamingContext只能有一个

// 2.2、如果一个StreamingContext启动起来了,

// 那么我们就不能为这个StreamingContext添加任何的新的Streaming计算

// 2.3、如果一个StreamingContext被stop了,那么它不能再次被start

// 2.4、一个SparkContext可以启动多个StreamingContext,

// 前提是前面的StreamingContext被stop掉了,而SparkContext没有被stop掉 //创建一个接收器(ReceiverInputDStream),这个接收器接收一台机器上的某个端口通过socket发送过来的数据并处理

val lines = ssc.socketTextStream("master", 9998, StorageLevel.MEMORY_AND_DISK_SER) //处理的逻辑,就是简单的进行word count

val words = lines.flatMap(_.split(" "))

val wordCounts = words.map(x => (x, 1)).reduceByKey(_ + _) //将结果输出到控制台

wordCounts.print() //启动Streaming处理流

ssc.start() //等待Streaming程序终止

ssc.awaitTermination()

}

}

示例 NetworkWordCount的更多相关文章

- Apache Spark 2.2.0 中文文档 - Spark Streaming 编程指南 | ApacheCN

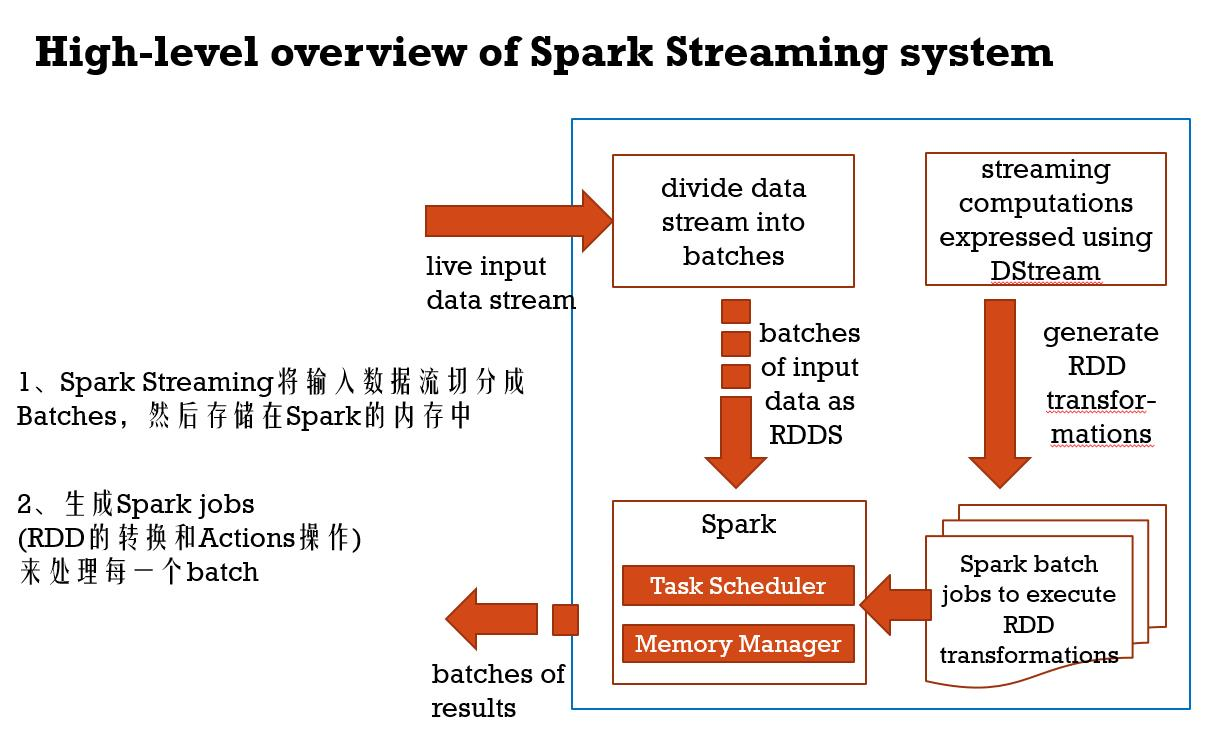

Spark Streaming 编程指南 概述 一个入门示例 基础概念 依赖 初始化 StreamingContext Discretized Streams (DStreams)(离散化流) Inp ...

- Spark Streaming编程指南

Overview A Quick Example Basic Concepts Linking Initializing StreamingContext Discretized Streams (D ...

- Apache Spark 2.2.0 中文文档

Apache Spark 2.2.0 中文文档 - 快速入门 | ApacheCN Geekhoo 关注 2017.09.20 13:55* 字数 2062 阅读 13评论 0喜欢 1 快速入门 使用 ...

- SparkStreaming 编程指南

摘要:学习SparkStreaming从官网的编程指南开始,由于Python编码修改方便不用打包,这里只整理python代码! 一.概述 Spark Streaming 是 Spark Core AP ...

- Apache Spark 2.2.0 中文文档 - Spark Streaming 编程指南

Spark Streaming 编程指南 概述 一个入门示例 基础概念 依赖 初始化 StreamingContext Discretized Streams (DStreams)(离散化流) Inp ...

- Spark Streaming编程示例

近期也有开始研究使用spark streaming来实现流式处理.本文以流式计算word count为例,简单描述如何进行spark streaming编程. 1. 依赖的jar包 参考<分别用 ...

- Swift3.0服务端开发(一) 完整示例概述及Perfect环境搭建与配置(服务端+iOS端)

本篇博客算是一个开头,接下来会持续更新使用Swift3.0开发服务端相关的博客.当然,我们使用目前使用Swift开发服务端较为成熟的框架Perfect来实现.Perfect框架是加拿大一个创业团队开发 ...

- .NET跨平台之旅:将示例站点升级至 ASP.NET Core 1.1

微软今天在 Connect(); // 2016 上发布了 .NET Core 1.1 ,ASP.NET Core 1.1 以及 Entity Framework Core 1.1.紧跟这次发布,我们 ...

- 通过Jexus 部署 dotnetcore版本MusicStore 示例程序

ASPNET Music Store application 是一个展示最新的.NET 平台(包括.NET Core/Mono等)上使用MVC 和Entity Framework的示例程序,本文将展示 ...

随机推荐

- 【面试】C++类中的相关函数【构造,拷贝构造,析构,友元】

构造函数:值的初始化,可带参数,无返回值,可重载,可存在多个 析构函数:释放对象内存空间,无参数,无返回值,不可重载,只能存在一个 拷贝构造函数:拷贝对象,其形参必须是引用 1.空类会默认添加哪些东西 ...

- (一)线性表(linear list)

文章目录 定义 特点 ADT (abstract data type) 定义 摘抄自 维基百科 线性表(英语:Linear List)是由 n(n≥0)个 数据元素(结点)a[0],a[1],a[2] ...

- 前端 html篇

web开发本质: html是一个标准,规定了大家怎么写网页 1.浏览器输入网址回车发生了什么事 1. 浏览器 给服务端 发送了一个消息2. 服务端拿到消息3. 服务端返回消息4. 浏览器展示页面 se ...

- JavaNetty心跳监控

import java.net.InetAddress; import java.net.UnknownHostException; import java.util.Map; import java ...

- Oracle数据库连接超时

关于Oracle数据库的连接失败问题,有N种情况都会导致,这次遇到的是一般开发或者运维人员难以发现的 场景: 有一台机A能够正常连接数据库并正常运行,机器B连接失败 32位WebService程序基于 ...

- Visual Studio 2019 使用.Net Core 3.0 一

一.前言 早在很久之前微软便公布 .NET Core 3.0 将支持开发Winform应用程序等等新特性,现如今 .NET Core 3.0 预览版已经出来第八个预览版了,从 .NET Core 2. ...

- 7 批量查询mget、批量修改bulk

注意:当执行多条数据查询.增删改时,一定要用mget.bulk,提升性能,减少网络传输 mget 回顾:查询单个文档 GET /beauties/my/2 mget 查询多个文档: 不同 ...

- JavaScript:将key和value不带双引号的JSON字符串转换成JSON对象的方法

遇到相关的问题,花了两天的时间来解决,深感来之不易,所以做如下的总结,希望遇到此问题的码农能更快的找到解决办法! var jsonArr= [{col:TO_CHAR(HZRQ,'YYYYMM'),t ...

- Ajax + PHP 的用法以及遇见的问题

由于自己是个php小白,所以新知识点都要自己去不断的试验和摸索. 分享下自己用php + ajax交互的用法和问题. 前端代码: $.ajax({ type: "POST", da ...

- Vue2.0的核心思想

Vue的核心思想为数据驱动和组件化. 一.数据驱动——双向绑定 Vue是一种MVVM框架.而DOM是数据的一个种自然映射.传统的模式是通过Ajax请求从model请求数据,然后手动的触发DOM传入数据 ...