Streaming Principal Component Analysis in Noisy Settings

论文背景:

- 面对来袭的数据,连续样本不一定是不相关的,甚至不是同分布的。

- 当前,大部分在线PCA都只关注准确性,而忽视时效性!

- 噪声?数据缺失,观测有偏,重大异常?

论文内容:

Section 2

Online Settings

Online PCA, 就是在观察到\(x1, x2, x3, \dots, x_{t-1}\)后,“构造”一个\(k-\)维的子空间,通常用投影矩阵\(P^{(t)}\)表示——为了最小化残差\(\|x_t - P^{(t)}\|^2\)

这篇论文重点在于界的分析,考虑下面的“遗憾”(大概就是误差的意思):

\(R(T,P) = \mathop{\sum}\limits_{t=1}^{T}x_t^{\top}Px_t-\mathop{\sum}\limits_{t=1}^{T}x_t^{\top}P^{(t)}x_t\)

其中P为任意的rank-k的正交投影矩阵,T为迭代次数。

\(R(T,P)\)的界是次线性的,所以,我们可以通过\(\frac{1}{T}R(T,P)\)来计算算法到达\(\varepsilon-\)界所需的时间,从而衡量算法的优劣。

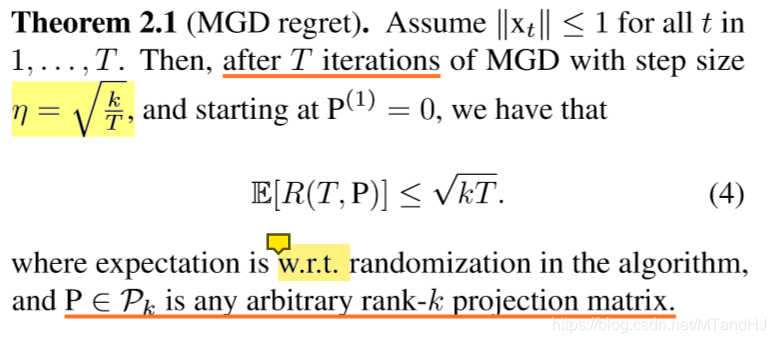

Matrix gradient descent (MGD)

- 将非凸条件放松为凸条件:

\(C =\lbrace P: Tr(P):=k, 0\preceq P \preceq I, P = P^{\top} \rbrace\) - \(P^{t+1} = \prod_F(P^{t} + \eta g_t^{\top})\) Here

- 学习后的\(P\),不一定满足原来的凸条件(投影), 故:

\(\hat{P}^{t} = rounding(P^{t})\)

对于这个算法并不了解,姑且只能这么想了。点这里

下面是关于(遗憾)的一个界:

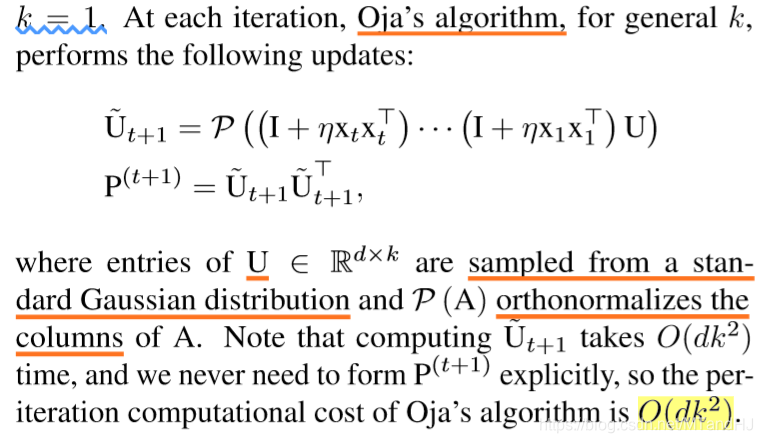

Stochastic Settings

在某些情况下,MGD算法复杂度比较高,所以,在额外的假设下,利用Oja的另外一种算法可能会比较有优势。

The additional assumption that \(x_t\) are sampled i.i.d. from some unknown distribution \(D\) and that \(\|x_t\|\leq1\) almost surely.

最近已经有相关方面的论文指出,在\(k=1\)的条件下,这个算法也可以到达次线性。

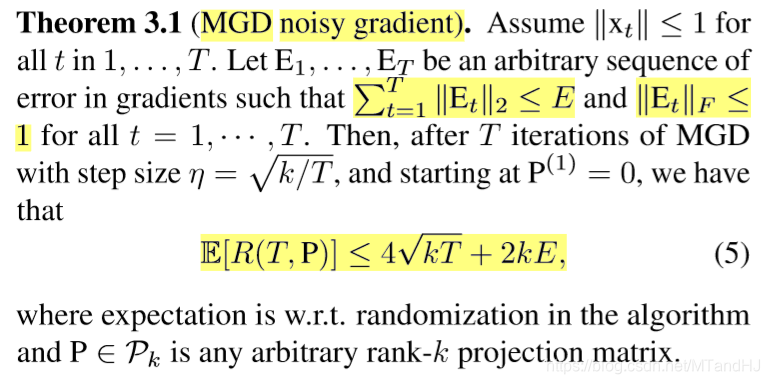

Section 3 corrupted gradients

在这一节,论文讲关于梯度被“污染”的情形。

Online Setting

梯度被污染的原因:

- 对于大数据不正确的运算

- 分布式和并行运算中,异步和噪声通讯导致的误差

此时的学习单位步长为:

\(\hat{\mathrm{g}}_t = x_tx_t^{\top}+E_t\)

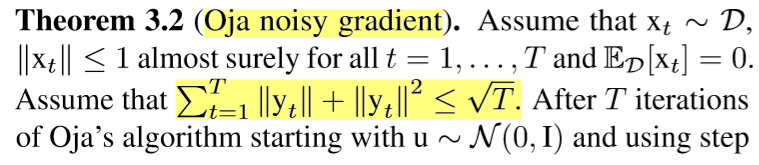

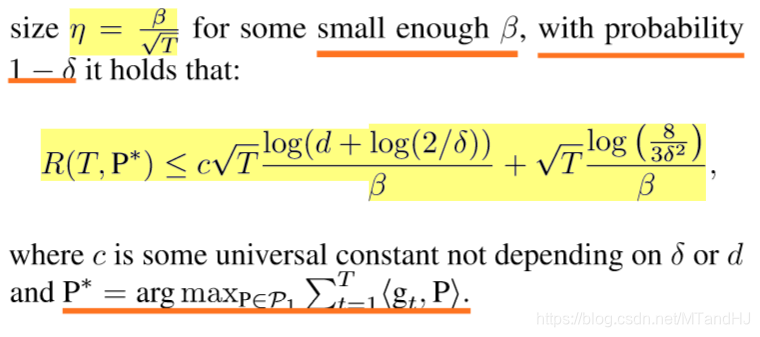

给出了下列定理:

Stochastic Setting

被污染的原因:数据被污染,设噪声向量为\(y_t\),且与\(x_t\)独立。(k=1)

\(\hat{\mathrm{g}}_t = (x_t + y_t)(x_t + y_t)^{\top}\)

Section 4 Missing Entries

这一章,讲矩阵缺失数据的情形。

假设\(x_t\)的每个元素将按照\(q-Brtnoulli\)分布被保留,否则缺失。

Online Setting

此时,学习步长又变为:

\(\hat{\mathrm{g}}_t := \hat{x}_t\hat{x}_t^{\top} - z_tz_t^{\top}\)

论文中为上式取负,但更新\(P\)的时候又取负,所以我直接不变了。

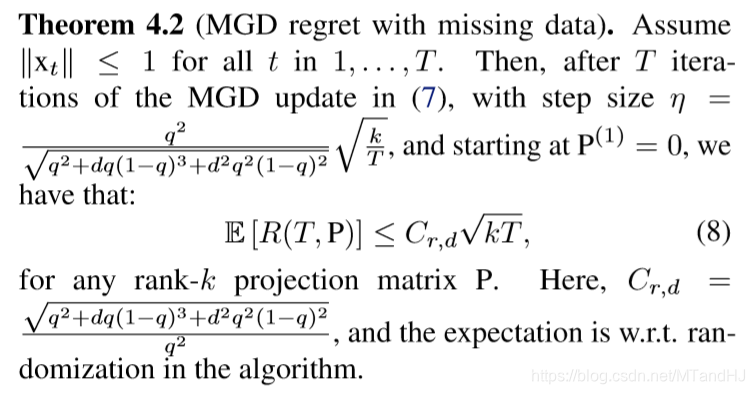

有下面的界:

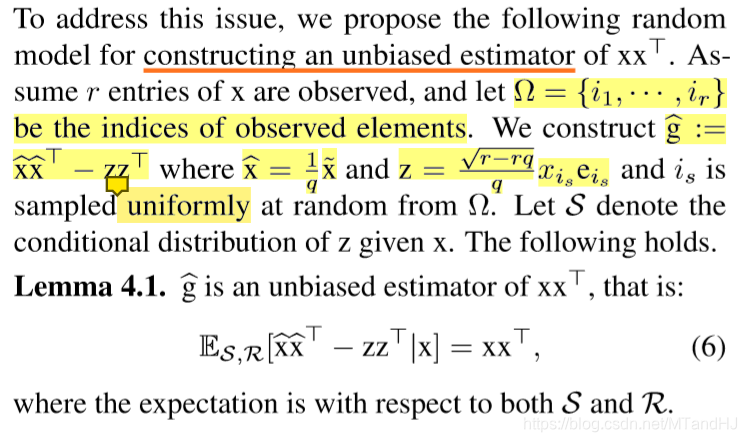

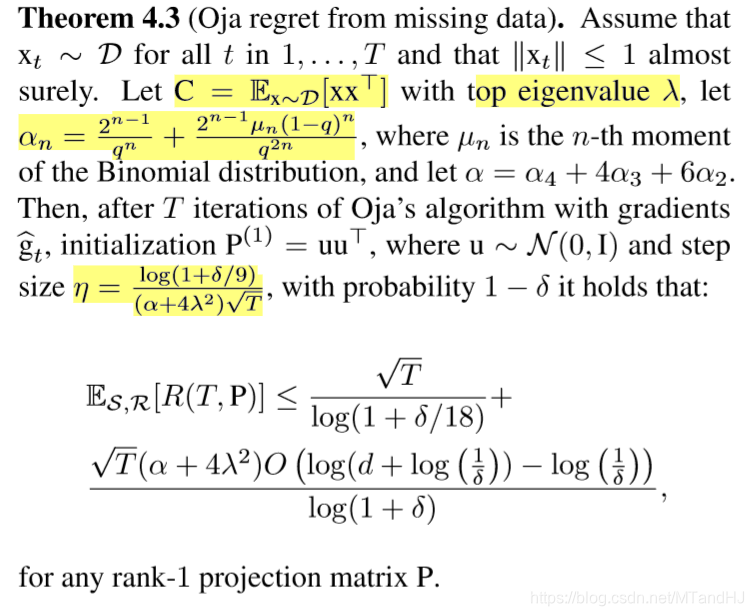

Stochastic Setting

在推导这个界的时候,似乎遇到了麻烦,新的迭代步长不能保证半正定,所以需要进行一个处理(因为证明都没看,所以不懂啊)。

给出了一个定理(k = 1):

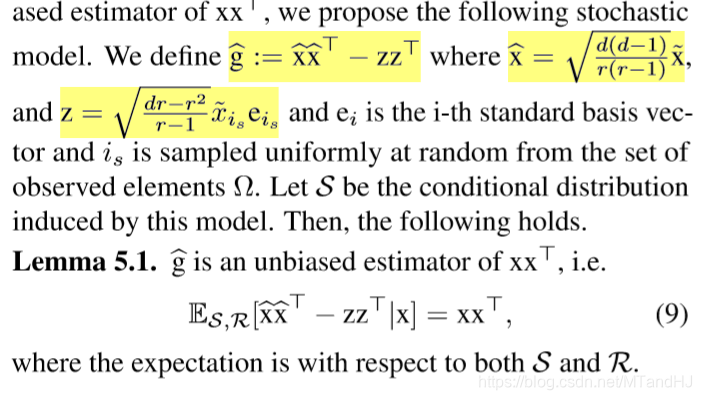

Section 5 Partial Observations

本节是讲观测偏差,\(x_t\)只有\(r<d\)个元素被观测到。

下面是对步长的分析与构造,但是,我对\(z\)的构造存疑,我觉得

\(z = \sqrt{\frac{d^2-dr}{r-1}}\widetilde{x}_{i_s}e_{i_s}\)

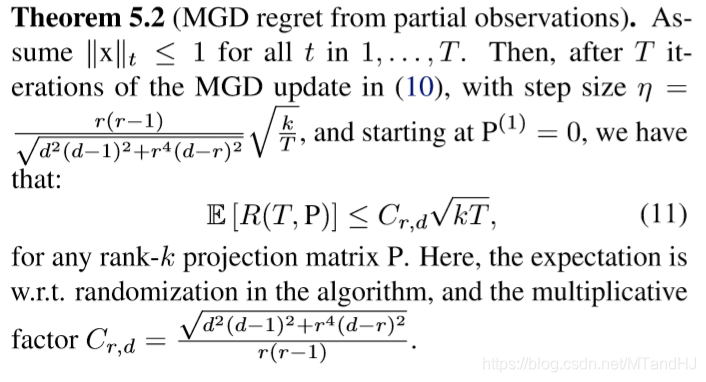

Online Setting

\(\hat{\mathrm{g}}_t\)同上

有下面的界:

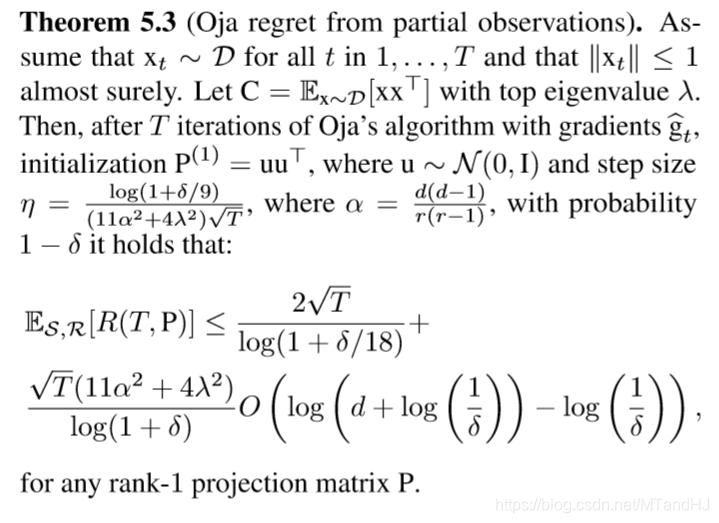

Stochastic Setting

有下面的界(k=1):

Section 6 Robust streaming PCA

针对异常值,探讨如何使得算法变得“健壮”。

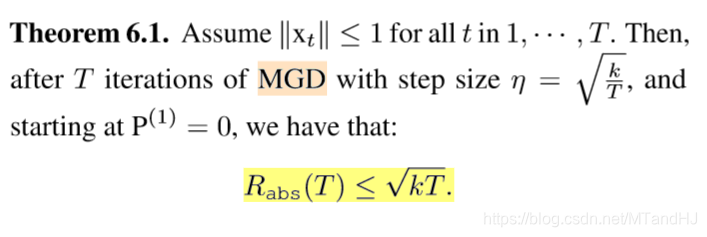

新的regret:

\(R_{abs}(T) = \mathop{\sum}\limits_{t=1}^{T}\|x_t-P^{t}x_t\|_2-\mathop{inf}\limits_{P\in P_k} \mathop{\sum}\limits_{t=1}^{T}\|x_t-Px_t\|_2\)

for any sequence \(x_1,\ldots,x_T \in \mathbb{R}^{d}\).

新的:

\(\mathrm{g}_t=-\frac{x_tx_t^{\top}(I-P^{(t)}) + (I-P^{(t)})x_tx_t^{\top}}{2\|(I-P^{(t)})x_t\|_2}\)

denote:

\(y_t = (I-P^{(t)})x_t\) and \(c_t = \frac{\eta}{2\|y_t\|_2}\)

\(P^(t+1) = \prod_F(P^{t} + c_t(x_ty_t^{\top}+y_tx_t^{\top}))\)

从而有下面定理:

Streaming Principal Component Analysis in Noisy Settings的更多相关文章

- Principal Component Analysis(PCA) algorithm summary

Principal Component Analysis(PCA) algorithm summary mean normalization(ensure every feature has sero ...

- Robust Principal Component Analysis?(PCP)

目录 引 一些微弱的假设: 问题的解决 理论 去随机 Dual Certificates(对偶保证?) Golfing Scheme 数值实验 代码 Candes E J, Li X, Ma Y, e ...

- Sparse Principal Component Analysis via Rotation and Truncation

目录 对以往一些SPCA算法复杂度的总结 Notation 论文概述 原始问题 问题的变种 算法 固定\(X\),计算\(R\) 固定\(R\),求解\(X\) (\(Z =VR^{\mathrm{T ...

- 《principal component analysis based cataract grading and classification》学习笔记

Abstract A cataract is lens opacification caused by protein denaturation which leads to a decrease i ...

- PCA(Principal Component Analysis)主成分分析

PCA的数学原理(非常值得阅读)!!!! PCA(Principal Component Analysis)是一种常用的数据分析方法.PCA通过线性变换将原始数据变换为一组各维度线性无关的表示,可 ...

- Principal Component Analysis(PCA)

Principal Component Analysis(PCA) 概念 去中心化(零均值化): 将输入的特征减去特征的均值, 相当于特征进行了平移, \[x_j - \bar x_j\] 归一化(标 ...

- (4)主成分分析Principal Component Analysis——PCA

主成分分析Principal Component Analysis 降维除了便于计算,另一个作用就是便于可视化. 主成分分析-->降维--> 方差:描述样本整体分布的疏密,方差越大-> ...

- Principal Component Analysis ---- PRML读书笔记

To summarize, principal component analysis involves evaluating the mean x and the covariance matrix ...

- 从矩阵(matrix)角度讨论PCA(Principal Component Analysis 主成分分析)、SVD(Singular Value Decomposition 奇异值分解)相关原理

0. 引言 本文主要的目的在于讨论PAC降维和SVD特征提取原理,围绕这一主题,在文章的开头从涉及的相关矩阵原理切入,逐步深入讨论,希望能够学习这一领域问题的读者朋友有帮助. 这里推荐Mit的Gilb ...

随机推荐

- Linux的notifier机制的应用

在linux内核系统中,各个模块.子系统之间是相互独立的.Linux内核可以通过通知链机制来获取由其它模块或子系统产生的它感兴趣的某些事件. notifier_block结构体在include/lin ...

- JavaScript函数式编程

一段糟糕透顶的海鸥seagulls程序 鸟群合并conjoin则变成了一个更大的鸟群,繁殖breed则增加了鸟群的数量,增加的数量就是它们繁殖出来的海鸥的数量 //Flock 群 var ...

- 【大数据技术】Flink

“下一代大数据处理引擎王者” Apache Flink 它既能保证数据一致性“Exactly Once",又能实时快速的处理海量数据.与生俱来的 Watermark 功能让它能对复杂数据乱序 ...

- vuex最简单的

https://segmentfault.com/a/1190000009404727 "dependencies": { "axios": " ...

- [Java] SpringMVC工作原理之一:DispatcherServlet

一.DispatcherServlet 处理流程 在整个 Spring MVC 框架中,DispatcherServlet 处于核心位置,它负责协调和组织不同组件完成请求处理并返回响应工作.在看 Di ...

- 我使用的Bem的习惯

在基于BEM命名思想的基础上,我整理一些实用的点: BEM,B即block(块),E即element(元素),M即modifier(修饰符) 块:最顶层,可包含块和元素 元素:被块包含,通常为最终被包 ...

- wait和notify

① wait() 与 notify/notifyAll 方法必须在同步代码块中使用 synchronized修饰的同步代码块或方法里面调用wait() 与 notify/notifyAll()方法 ...

- redis 查找附近的人

儿童定位手表,有个交友功能,查找附近的人,用redis的geo来实现比较简单,其实是一个ZSET(有序集合) redis 版本要大于3.2 查看redis 版本 /usr/bin/redis-s ...

- shallow clone

shallow clone 浅克隆经常在一些大型仓库中很有用——不用花费大量时间去clone一个完整的仓库,仅仅checkout出来某个分支(如master)的最新N次递交: git clone -- ...

- Mybatis基础核心类说明

1: org.apache.ibatis.mapping.ParameterMapping 为Mybatis参数的抽象表示,包括Java类型与数据库类型以及类型处理器属性名字等等!! 例如: 其中i ...