Spark Streamming 基本输入流I(-) :File/Hdfs

Spark Streamming 基本输入流I(-):从文件中进行读取

文件读取1:本地文件读取

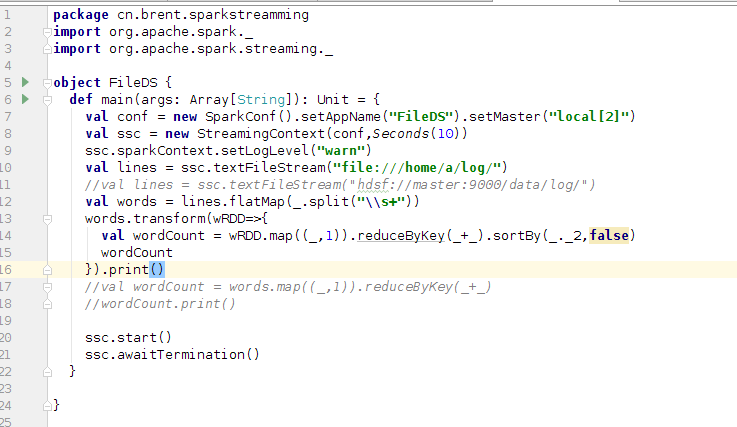

这里我只给出实现代码及操作步骤

1、在本地目录下创建目录,这里我们创建目录为~/log/

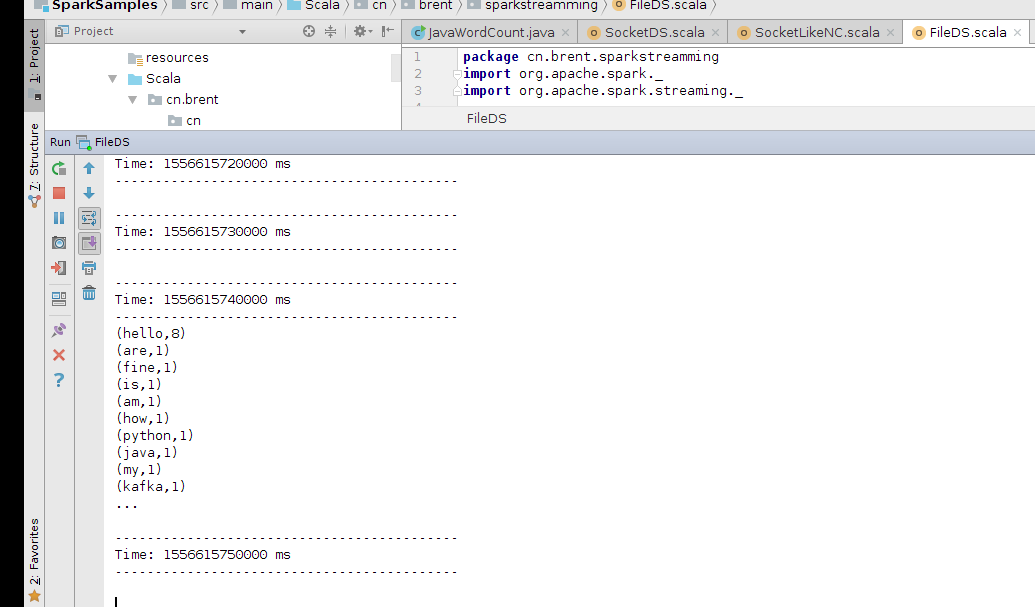

2、然后手动在~/目录下创建两个文件夹。t1.dat ,t2.dat

t1.dat 格式如下:

hello hadoop

hello spark

hello Java

hellp hbase

hello scala

t2.dat格式如下:

My name is Brent,

how are you

nice to meet you

3、编写spark streamming程序,并将其运行起来。

4、使用命令cp ~/t*.dat ./log/ 将t1.dat ,t2.dat移动到~/log目录下,

5、查看spark Streamming程序的运行情况。

文件读取2:HDFS文件读取

HDFS文件读取和本地是相差无几的,

不同之处如下

程序中修改文件引入路径//val lines = ssc.textFileStream("hdsf://master:9000/data/log/")

本地文件t1.dat 和 t2.dat 需要上传到hdfs://master:9000/data/log下

hdfs dfs -mkdir data/log 创建目录。

hdfs dfs -put t*.dat data/log/

注意点:

文件作为输入流容易出错的一点就是,目录下面的文件一定要是cp进来,而不是mv进来了,因为cp进行的文件时间戳是改变的,而mv进来的时间戳没有改变,spark Streamming就不会进行处理。

Spark Streamming 基本输入流I(-) :File/Hdfs的更多相关文章

- Spark Streamming 基本输入流(二) :Socket

Spark Streamming 可以通过socket 进行数据监听. socket的输入方可以通过nc 或者自己开发nc功能的程序. 1.系统自带的nc su root a yum install ...

- Spark2.x(五十五):在spark structured streaming下sink file(parquet,csv等),正常运行一段时间后:清理掉checkpoint,重新启动app,无法sink记录(file)到hdfs。

场景: 在spark structured streaming读取kafka上的topic,然后将统计结果写入到hdfs,hdfs保存目录按照month,day,hour进行分区: 1)程序放到spa ...

- ParquetDecodingException: Can not read value at 0 in block -1 in file hdfs:...

: jdbc:hive2://master01.hadoop.dtmobile.cn:1> select * from cell_random_grid_tmp2 limit 1; INFO : ...

- kettle在本地执行向远程hdfs执行转换错误"Couldn't open file hdfs"

kettle在本地执行向远程hdfs执行转换时,会出现以下错误: ToHDFS.0 - ERROR (version 7.1.0.0-12, build 1 from 2017-05-16 17.18 ...

- ERROR: Found lingering reference file hdfs

Found lingering reference异常 ERROR: Found lingering reference file hdfs://jiujiang1:9000/hbase/month_ ...

- Spark No FileSystem for scheme file 解决方法

在给代码带包成jar后,放到环境中运行出现如下错误: Exception in thread "main" java.io.IOException: No FileSystem f ...

- 通过Spark SQL关联查询两个HDFS上的文件操作

order_created.txt 订单编号 订单创建时间 -- :: -- :: -- :: -- :: -- :: order_picked.txt 订单编号 订单提取时间 -- :: ...

- MapReduce 踩坑 - hadoop No FileSystem for scheme: file/hdfs

一.场景 hadoop-3.0.2 + hbase-2.0.0 一个mapreduce任务,在IDEA下本地提交到hadoop集群可以正常运行. 现在需要将IDEA本地项目通过maven打成jar包, ...

- Spark设置自定义的InputFormat读取HDFS文件

本文通过MetaWeblog自动发布,原文及更新链接:https://extendswind.top/posts/technical/problem_spark_reading_hdfs_serial ...

随机推荐

- yield用法

yield的__next__()和send()的用法,详见代码 def D(): n = 1 while n < 5: m = yield n print("m:",m) p ...

- (转)图解SSH原理

图解SSH原理 原文:https://www.jianshu.com/p/33461b619d53 http://blog.51cto.com/forlinux/1352900---------SSH ...

- 关于跨域登录中获取COOKIES解析BUG

FormsAuthentication.Decrypt 报错 Length of the data to decrypt is invalid. 关于同域名不同服务器之间的登录,加密配置说明 ...

- 案例45-crm练习改写客户列表使用struts2&OGNL

1 修改CustomerAction代码 2 修改jsp/customer/list.jsp代码 <%@ page language="java" contentType=& ...

- Whu 1603——Minimum Sum——————【单个元素贡献、滑窗】

Problem 1603 - Minimum Sum Time Limit: 2000MS Memory Limit: 65536KB Total Submit: 623 Accepted: ...

- CTPN_论文阅读总结

论文全名:Detecting Text in Natural Image with Connectionist Text Proposal Network 1.摘要 (1)本文提出新型网络CTPN,用 ...

- Node.js 框架对比之 Express VS Koa

背景 上图是一个典型的采用 Node.js 开发 web 应用的前后端结构,下面介绍一下 Node 服务层在其中的作用以及使用 Node.js 的一些优劣. Node 服务层作用: 请求代理 传统做法 ...

- Bootstrap组件介绍

一.下拉菜单 用于显示链接列表的可切换.有上下文的菜单.下拉菜单的 JavaScript 插件让它具有了交互性. 1.实例 将下拉菜单触发器和下拉菜单都包裹在 .dropdown 里,或者另一个声明了 ...

- Bootstrap拟态框+支付宝首页

任务没完成,继续来!因为刚才网不好,我辛辛苦苦打了洋洋洒洒一大堆都没了! 我们今天主要是说一个简单的由Bootstrap和HTML5结合而成的小案例: 首先:由标题可得知,这是移动端,所以需要这样一串 ...

- 使用canvas及js简单生成验证码方法

在很多时候都需要用到验证码,前端验证码需要知道Html5中的canvas知识点.验证码生成步骤是:1.生成一张画布canvas 2.生成随机数验证码 3.在画布中生成干扰线 4.把验证码文本填充到 ...