Spark Streamming 基本输入流(二) :Socket

Spark Streamming 可以通过socket 进行数据监听。

socket的输入方可以通过nc 或者自己开发nc功能的程序。

1、系统自带的nc

su root

a

yum install -y nc 安装nc

nc -lk 22222 就代表nc对22222端口进行监听。

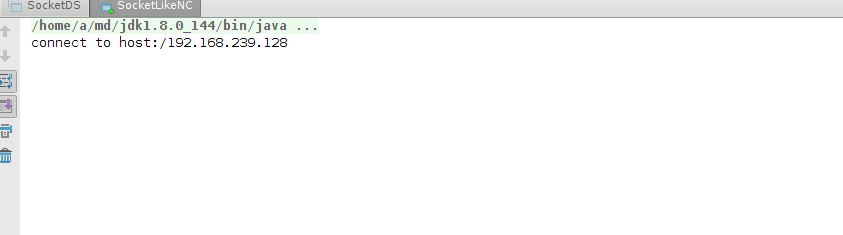

2、自己编写nc程序

下面程序是不停给master 22222 端口写入行数据。

val words = "hello spark storm hive java hadoop hbase hello money scala python".split(" ")

val n = words.size

val ra = new Random()

val hostname = "master"

val port = 22222

val ss = new ServerSocket(port)

val socket = ss.accept()

println("connect to host:" + socket.getInetAddress)

while(true){

val out = new PrintWriter(socket.getOutputStream)

out.println(words(ra.nextInt(n)) + " " + words(ra.nextInt(n)))

out.flush()

Thread.sleep(100)

3、编写spark streamming 处理程序。

object SocketDS {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setAppName("SocketDS").setMaster("local[2]")

val ssc = new StreamingContext(conf,Seconds(10))

ssc.sparkContext.setLogLevel("warn")

val hostname = "master"

val port = 22222

val lines = ssc.socketTextStream(hostname ,port)

val words = lines.flatMap(_.split("\\s+"))

words.transform(wRDD=>{

val wordCount = wRDD.map((_,1)).reduceByKey(_+_).sortBy(_._2,false)

wordCount

}).print()

ssc.start()

ssc.awaitTermination()

}

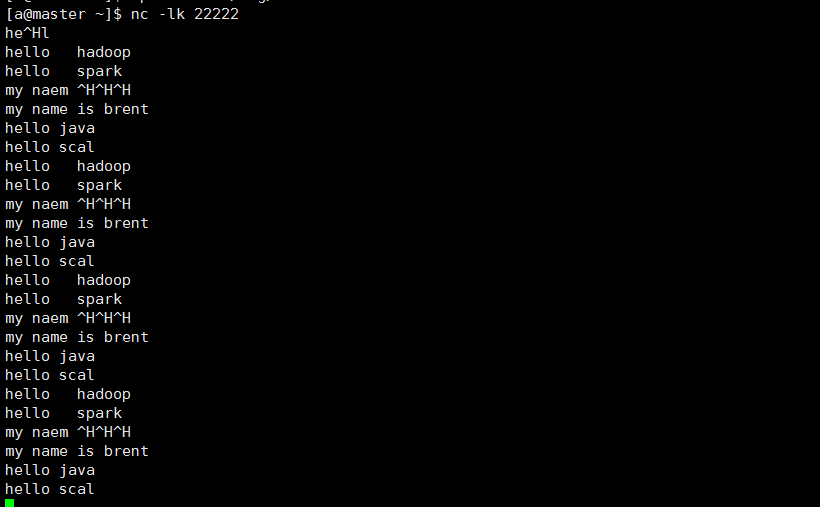

4、nc端 输入socket内容 进行监控

hello spark

hello hadoop

hello socket

hello java

hello scala

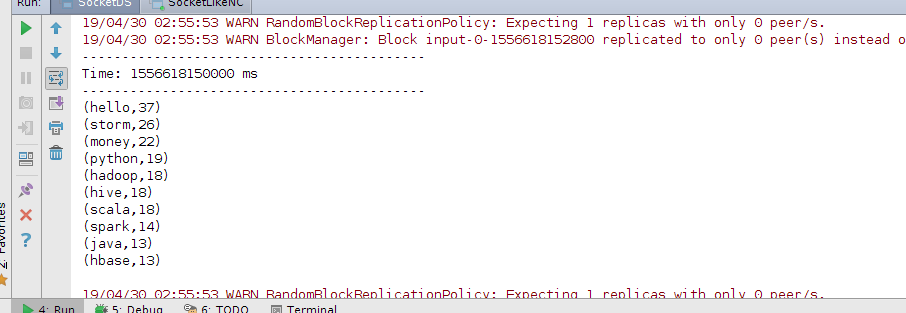

5、先开启spark Streamming处理程序,再开启nc或者ncsocket,运行结果如下。

nc -lk 22222给master 22222发送数据,

通过自己编写的nc socket程序,随机组合给master 22222发送行数据。

spark streamming 程序接收并处理后的结果。

Spark Streamming 基本输入流(二) :Socket的更多相关文章

- Spark Streamming 基本输入流I(-) :File/Hdfs

Spark Streamming 基本输入流I(-):从文件中进行读取 文件读取1:本地文件读取 这里我只给出实现代码及操作步骤 1.在本地目录下创建目录,这里我们创建目录为~/log/ 2.然后手动 ...

- Spark面试题(二)

首发于我的个人博客:Spark面试题(二) 1.Spark有哪两种算子? Transformation(转化)算子和Action(执行)算子. 2.Spark有哪些聚合类的算子,我们应该尽量避免什么类 ...

- linux内核中的文件描述符(二)--socket和文件描述符

http://blog.csdn.net/ce123_zhouwei/article/details/8459730 Linux内核中的文件描述符(二)--socket和文件描述符 Kernel ve ...

- 二. Socket用法

C/S通信架构中,客户端要主动与服务端建立连接,这个链接就是Socket套接字.服务端收到连接请求后,也会开启Socket记录与客户端的链接.C/S两端都要建路Socket才能正常收发数据. 一.构造 ...

- Spark读写Hbase的二种方式对比

作者:Syn良子 出处:http://www.cnblogs.com/cssdongl 转载请注明出处 一.传统方式 这种方式就是常用的TableInputFormat和TableOutputForm ...

- Spark SQL概念学习系列之为什么使用 Spark SQL?(二)

简单地说,Shark 的下一代技术 是Spark SQL. 由于 Shark 底层依赖于 Hive,这个架构的优势是对传统 Hive 用户可以将 Shark 无缝集成进现有系统运行查询负载. 但是也看 ...

- 【Spark篇】---Spark中transformations算子二

一.前述 今天继续整理几个Transformation算子如下: mapPartitionWithIndex repartition coalesce groupByKey zip zipWithIn ...

- spark streaming 整合kafka(二)

转载:https://www.iteblog.com/archives/1326.html 和基于Receiver接收数据不一样,这种方式定期地从Kafka的topic+partition中查询最新的 ...

- Spark 系列(十二)—— Spark SQL JOIN 操作

一. 数据准备 本文主要介绍 Spark SQL 的多表连接,需要预先准备测试数据.分别创建员工和部门的 Datafame,并注册为临时视图,代码如下: val spark = SparkSessio ...

随机推荐

- 点击select下拉框,触发事件

<div class="controls moneycheck floatleft"> <select class="span12 chosen_cat ...

- Node.js学习笔记(四) --- fs模块的使用

目录 . fs.stat 检测是文件还是目录 . fs.mkdir 创建目录 . fs.writeFile 创建写入文件 . fs.appendFile 追加文件 . fs.readFile 读取文件 ...

- 6、springboot之根目录设置

访问的时候用

- SZU 7

A - Megacity sqrtf是个坑 #include <iostream> #include <string> #include <cstring> #in ...

- Effective C++ .10,11 operator=的约定与注意

1. 返回一个reference to *this 返回一个指向自身的引用符合惯例,可以进行如(a=c).modify()类似的操作,即可以形成链式操作,否则修改的只是一个临时对象.这个和Java中常 ...

- nginx关于 error_page指令详解.md

error_page指令解释 nginx指令error_page的作用是当发生错误的时候能够显示一个预定义的uri,比如: error_page 502 503 /50x.html; 这样实际上产生了 ...

- jquery对象与核心函数

原生js入口函数与jQuery入口函数的区别 1.window.onload与document.ready在加载时间上的差异 document.ready会先触发,其次才是window.onload ...

- JavaEE之Http协议和Tomcat服务器

Http协议 什么是Http协议 HTTP,超文本传输协议(HyperText Transfer Protocol)是互联网上应用最为广泛的 一种网络协议.所有的WWW文件都必须遵守这 ...

- class 命名规范

本文是从简书复制的, markdown语法可能有些出入, 想看"正版"和更多内容请关注 简书: 小贤笔记 注: 文章摘自 penggelies07- 简书, super晴天 - C ...

- 【阿里云产品公测】ACE下上传文件永久存储实践

本帖主要内容: ;$,=VB:' 在阿里云的ACE下,我是如何实现让上传的文件永久保存的? ,%"!8T 本文以PHP为例,具体知识点如下: WD# 96V 第一,扩展服务“存储 ...