ClickHouse入门:表引擎-HDFS

前言

插件及服务器版本

服务器:ubuntu 16.04

Hadoop:2.6

ClickHouse:20.9.3.45

文章目录

- 简介

- 引擎配置

- HDFS表引擎的两种使用形式

- 引用

简介

ClickHouse的HDFS引擎可以对接hdfs,这里假设HDFS环境已经配置完成,本文测试使用的HDFS版本为2.6

HDFS引擎定义方法如下:

ENGINE = HDFS(hdfs_uri,format)

参数定义:

- hdfs_uri表示HDFS的文件存储路径

- format表示文件格式(指ClickHouse支持的文件格式,常见有CSV、TSV和JSON等)

HDFS表引擎两种使用方式:

- 即负责读文件也负责写文件

- 只负责读文件,文件写入工作则由外部系统完成

引擎配置

由于hdfs配置了HA,如果不做配置,创建一张只负责读文件的表,并查询数据,会报如下错误:

Code: 210. DB::Exception: Received from localhost:9000.

DB::Exception: Unable to connect to HDFS: InvalidParameter: Cannot parse URI:

hdfs://mycluster, missing port or invalid HA configuration

Caused by: HdfsConfigNotFound: Config key: dfs.ha.namenodes.mycluster not found.

需要做如下配置解决问题

1、拷贝hdfs-site.xml文件至/etc/clickhouse-server,并修改文件名为hdfs-client.xml

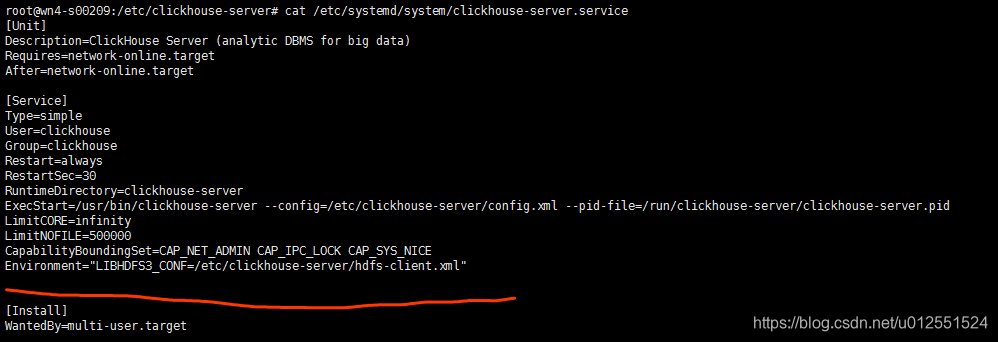

2、修改ClickHouse Server启动文件,添加环境变量Environment=“LIBHDFS3_CONF=/etc/clickhouse-server/hdfs-client.xml”

备注:

这里测试环境为ubuntu环境,启动服务用systemctl启动,所以修改启动文件的路径为:vi /etc/systemd/system/clickhouse-server.service

3、加载并重启clickhouse-serversystemctl daemon-reload

systemctl restart clickhouse-server.service

4、测试

新创建一张只读表,对应的hdfs上已经提前放了一个测试文件 1.txt

CREATE TABLE test_hdfs

(

id Int32

)

ENGINE HDFS('hdfs://mycluster/1.txt','CSV');

查询表里的数据

HDFS表引擎的两种使用形式

即负责读文件,也负责写文件

创建一张新表

CREATE TABLE test_hdfs_read

(

id Int32,

name String

)

ENGINE HDFS('hdfs://mycluster/test','CSV');

插入数据

insert into test_hdfs_read values (1,'tracy');

查询表数据并查看hdfs目录情况

这里可以看到hdfs目录下多了一个test文件

只负责读文件,文件写入工作则由外部系统完成

这种形式类似于hive的外挂表,由其它系统直接将文件直接写入HDFS,通过参数hdsfs_ui和format与HDFS的文件路径、文件格式建立映射,其中hdfs_uri支持以下几种常见的配置方法:

1. 绝对路径:会指定路径上的单个文件,例如hdfs://mycluster/1.txt

2. *通配符:匹配所有字符,例如hdfs://mycluster/ * ,会读取hdfs://mycluster/路径下的所有文件

3. ?通配符:匹配单个字符,例如hdfs://mycluster/test_?.txt会匹配所有test_?.txt的文件,?代表任意字符

4. {M…N}数字区间:匹配指定数字的文件,例如路径hdfs://mycluster/test_{1…3}.txt,则会读取hdfs://mycluster/路径下的文件test_1.txt,test_2.txt,test_3.txt在hdfs新建一个目录,并放3个文件

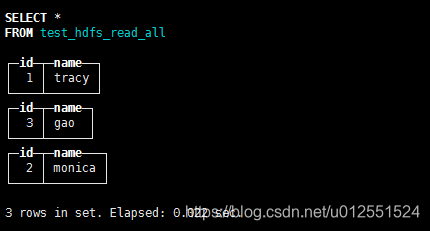

测试*通配符

CREATE TABLE test_hdfs_read_all

(

`id` Int32,

`name` String

)

ENGINE = HDFS('hdfs://mycluster/test_hdfs_read/*', 'CSV')

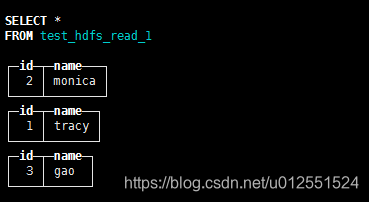

测试?通配符

CREATE TABLE test_hdfs_read_1

(

`id` Int32,

`name` String

)

ENGINE = HDFS('hdfs://mycluster/test_hdfs_read/test_?.csv', 'CSV')

测试数字区间通配符通配符

CREATE TABLE test_hdfs_read_2

(

`id` Int32,

`name` String

)

ENGINE = HDFS('hdfs://mycluster/test_hdfs_read/test_{2..3}.csv', 'CSV')

这里只匹配了test_2和test_3,所以只有两条记录

引用

https://github.com/ClickHouse/ClickHouse/issues/8159

ClickHouse入门:表引擎-HDFS的更多相关文章

- UniqueMergeTree:支持实时更新删除的 ClickHouse 表引擎

UniqueMergeTree 开发的业务背景 首先,我们看一下哪些场景需要用到实时更新. 我们总结了三类场景: 第一类是业务需要对它的交易类数据进行实时分析,需要把数据流同步到 ClickHouse ...

- ClickHouse(10)ClickHouse合并树MergeTree家族表引擎之ReplacingMergeTree详细解析

目录 建表语法 数据处理策略 资料分享 参考文章 MergeTree拥有主键,但是它的主键却没有唯一键的约束.这意味着即便多行数据的主键相同,它们还是能够被正常写入.在某些使用场合,用户并不希望数据表 ...

- clickhouse入门到实战及面试

第一章. clickhouse入门 一.ClickHouse介绍 ClickHouse(开源)是一个面向列的数据库管理系统(DBMS),用于在线分析处理查询(OLAP). 关键词:开源.面向列.联机分 ...

- Clickhouse 入门

clickhouse 简介 ck是一个列式存储的数据库,其针对的场景是OLAP.OLAP的特点是: 数据不经常写,即便写也是批量写.不像OLTP是一条一条写 大多数是读请求 查询并发较少,不适合放置先 ...

- ClickHouse入门笔记

ClickHouse笔记 目录 ClickHouse笔记 第 1 章 ClickHouse 入门 列式储存的好处: 第 2 章 ClickHouse 的安装 第 3 章 数据类型 整型 浮点型 布尔型 ...

- Clickhouse 分布式表&本地表 &ClickHouse实现时序数据管理和挖掘

一.CK 分布式表和本地表 (1)CK是一个纯列式存储的数据库,一个列就是硬盘上的一个或多个文件(多个分区有多个文件),关于列式存储这里就不展开了,总之列存对于分析来讲好处更大,因为每个列单独存储,所 ...

- Clickhouse 分布式表&本地表

CK 分布式表和本地表 ck的表分为两种: 分布式表 一个逻辑上的表, 可以理解为数据库中的视图, 一般查询都查询分布式表. 分布式表引擎会将我们的查询请求路由本地表进行查询, 然后进行汇总最终返回给 ...

- innodb数据库批量转换表引擎为MyISAM

2013.0106 innodb数据库批量转换表引擎为MyISAM 来源:本站原创 PHP, 数据库, 系统技术 超过488名童鞋围观 1条评论 <?php //连接数据库 $host='lo ...

- Mysql MyISAM数据库批量转换表引擎为Innodb

Mysql MyISAM数据库批量转换表引擎为Innodb 最近在做事物处理需要把表结构都改为带有支持事物的Innodb引擎格式, 把里面数据库 用户名.密码 等信息修改为你自己的,放在网站下运行即可 ...

随机推荐

- SpringCloud 的版本问题 (深入)

学过SpringCloud 的 同学 ,就应该知道,SpringCloud是一个生态 . Spring Cloud是一个由众多独立子项目组成的大型综合项目,每个子项目都维护着自己的发布版本号.Spri ...

- 性能监控工具nmon及nmon_analyser的使用

nmon和nmon_analyser下载地址: http://nmon.sourceforge.net/pmwiki.php?n=Site.Download 使用步骤: 1.nmon 根据系统版本 ...

- 实验题目:python面向对象程序设计

1.定义并实现一个矩形类Rectangle,其私有实例成员为矩形的左下角与右上角两个点的坐标,能设置左下角和右上角两个点的位置,能根据左下角与右上角两个点的坐标计算矩形的长.宽.周长和面积,另外根据需 ...

- APP端有原生态的控件,但嵌入了H5页面,怎么定位到H5页面的元素

appium 通常有很多种定位元素方法,例如xpath,driver.find_element_by_accessibility_id等,安卓sdk自带的uiautomatorviewer但是对于H5 ...

- C#中RDLC合并两个列的值

使用 & 符号连接 =Fields!ID.Value & Fields!Name.Value

- 函数进阶· 第3篇《常用内置函数filter()、map()、zip(),怎么用的呢?》

坚持原创输出,点击蓝字关注我吧 作者:清菡 博客:oschina.云+社区.知乎等各大平台都有. 由于微信公众号推送改为了信息流的形式,防止走丢,请给加个星标 ,你就可以第一时间接收到本公众号的推送! ...

- .netcore 微服务快速开发框架 Anno&Viper 注册中心 (服务上线下线预警通知)

1.微服务时代,服务上线先预警通知 在微服务大行其道的今天,相信很多人都用上了微服务或者是微服务的概念也已经有了一个深刻的了解.今天我们不在这里展开阐述,今天我们要说的是微服务伴侣预警通知. 2.注册 ...

- 什么是ZooKeeper?ZooKeeper分布式事务详解

前言 上一章我们了解了zookeeper到底是什么,这一章重点来看zookeeper当初到底面临什么问题? 而zookeeper又是如何解决这些问题的? 实际上zookeeper主要就是解决分布式环境 ...

- easyui中刷新列表

<table class="crud-content-info" id="showProductDialogFormstandrad"> </ ...

- IaaS、PaaS、SaaS、DaaS都是什么?现在怎么样了?终于有人讲明白了

导读:本文将详细科普云计算的概念.云服务的发展现状,并逐一介绍各种云服务模式(IaaS.PaaS.SaaS.DaaS),建议收藏! 作者:阿里云智能-全球技术服务部来源:大数据DT(ID:bigdat ...