win10+pyspark+pycharm+anaconda单机环境搭建

一、工具准备

1. jdk1.8

2. scala

3. anaconda3

4. spark-2.3.1-bin-hadoop2.7

5. hadoop-2.8.3

6. winutils

7. pycharm

二、安装

1. jdk安装

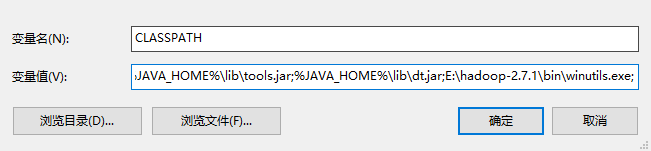

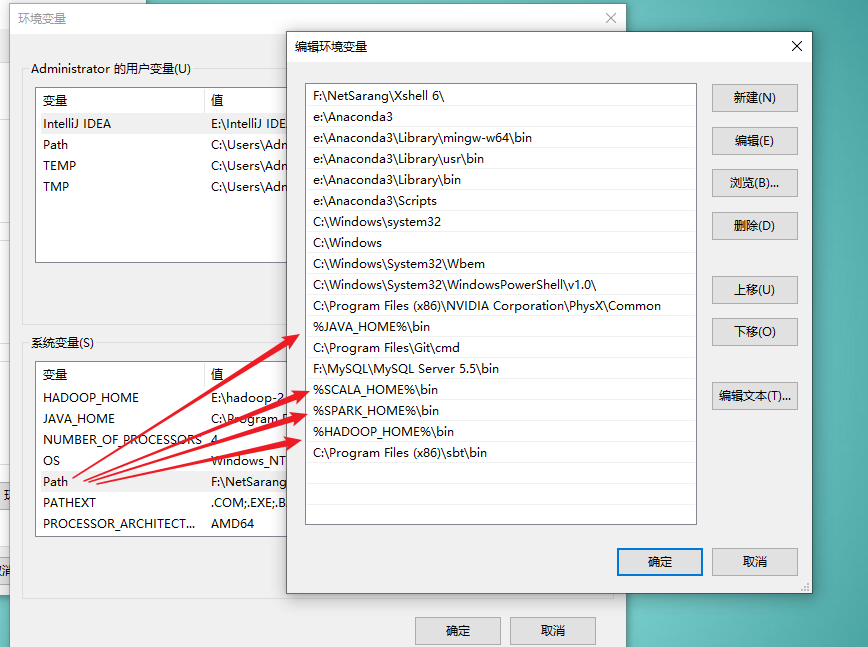

oracle官网下载,安装后配置JAVA_HOME、CLASS_PATH,bin目录追加到PATH,注意:win10环境下PATH最好使用绝对路径!下同!

2. scala安装

官网下载,安装后配置SCALA_HOME,bin目录追加到PATH(上图包含)

3. anaconda3安装

官网下载,安装时注意在“追加到PATH”复选框打钩

4. spark安装

官网下载压缩包,解压缩后配置SPARK_HOME,bin目录追加到PATH(上图包含)

5. hadoop安装

官网下载版本>=spark对应hadoop版本,解压缩后配置HADOOP_HOME,bin目录追加到PATH(上图包含)

6. winutils安装

下载地址:https://github.com/steveloughran/winutils,按hadoop版本对应下载

7. pycharm安装

下载付费版本,使用lanyu注册码激活,注意按照提示添加域名解析到hosts文件

三、处理python相关

- 将pyspark文件夹(在spark-2.3.1-bin-hadoop2.7\python目录)复制到anaconda3\Lib\site-packages目录下

- 将winutils解压缩后用对应版本的bin目录替换hadoop下的bin目录

- conda install py4j

- 进入hadoop\bin目录下,以管理员方式打开cmd,输入命令:winutils.exe chmod 777 c:\tmp\Hive,若提示错误,检查Hive目录是否存在,若不存在,则手动创建,再重新执行命令

四、验证

打开pycharm,使用anaconda中的python作为解释器,输入以下代码并运行:

from pyspark import SparkContext

sc = SparkContext('local')

doc = sc.parallelize([['a', 'b', 'c'], ['b', 'd', 'd']])

words = doc.flatMap(lambda d: d).distinct().collect()

word_dict = {w: i for w, i in zip(words, range(len(words)))}

word_dict_b = sc.broadcast(word_dict)

def wordCountPerDoc(d):

dict = {}

wd = word_dict_b.value

for w in d:

if wd[w] in dict:

dict[wd[w]] += 1

else:

dict[wd[w]] = 1

return dict

print(doc.map(wordCountPerDoc).collect())

print("successful!")

运行结果:

[{0: 1, 1: 1, 2: 1}, {1: 1, 3: 2}]

successful!

本文为win10+pyspark+pycharm+anaconda的单机测试环境搭建。

win10+pyspark+pycharm+anaconda单机环境搭建的更多相关文章

- windows7 spark单机环境搭建及pycharm访问spark

windows7 spark单机环境搭建 follow this link how to run apache spark on windows7 pycharm 访问本机 spark 安装py4j ...

- [转载] Hadoop和Hive单机环境搭建

转载自http://blog.csdn.net/yfkiss/article/details/7715476和http://blog.csdn.net/yfkiss/article/details/7 ...

- win10子系统linux.ubuntu开发环境搭建

移步新博客... win10子系统linux.ubuntu开发环境搭建

- Kafka 0.7.2 单机环境搭建

Kafka 0.7.2 单机环境搭建当下载完Kafka后,进行解压,其目录结构如下: bin config contrib core DISCLAIMER examples lib lib_manag ...

- kafka单机环境搭建及其基本使用

最近在搞kettle整合kafka producer插件,于是自己搭建了一套单机的kafka环境,以便用于测试.现整理如下的笔记,发上来和大家分享.后续还会有kafka的研究笔记,依然会与大家分享! ...

- HBase单机环境搭建

在搭建HBase单机环境之前,首先你要保证你已经搭建好Java环境: $ java -version java version "1.8.0_51" Java(TM) SE Run ...

- Hadoop —— 单机环境搭建

一.前置条件 Hadoop的运行依赖JDK,需要预先安装,安装步骤见: Linux下JDK的安装 二.配置免密登录 Hadoop组件之间需要基于SSH进行通讯. 2.1 配置映射 配置ip地址和主机名 ...

- Solr单机环境搭建及部署

一.定义 官网的定义: Solr是基于Lucene构建的流行,快速,开放源代码的企业搜索平台.它具有高度的可靠性,可伸缩性和容错能力,可提供分布式索引,复制和负载平衡查询,自动故障转移和恢复,集中式配 ...

- hadoop单机环境搭建

[在此处输入文章标题] Hadoop单机搭建 1. 工具准备 1) Hadoop Linux安装包 2) VMware虚拟机 3) Java Linux安装包 4) Window 电脑一台 2. 开始 ...

随机推荐

- 阿里云 商标 SAAS

商标注册-注册商标查询-商标交易平台-阿里云商标https://tm.aliyun.com/#/ 阿里云商标查询入口-云栖社区-阿里云https://yq.aliyun.com/articles/69 ...

- 卸载node和npm

sudo npm uninstall npm -g yum remove nodejs npm -y

- ubuntu设置开机启动后命令行界面

author:headsen chen date: 2019-09-19 14:23:31 在字符界面(即命令行界面)输入命令: 设置为字符界面的命令:sudo systemctl set-defa ...

- ubuntu18设置root账号的开机登录

date: 2019-08-20 17:36:49 author: headsen chen notice :个人原创 1,用普通用户登录. su - root 打开终端 vi /etc/pam.d ...

- 创建WebApi Odata v3 终结点

开放数据协议(OData) 是用于 web 的数据访问协议. OData 提供统一的方法来构造数据. 查询的数据和操作该数据集通过 CRUD 操作 (创建. 读取. 更新和删除). OData 支持 ...

- CentOS7搭建时间服务器-chrony

系统:centos7防火墙:关闭防火墙和selinux软件:chrony centos6我们一直用的ntp时间服务器,虽然到CentOS7上也可以装ntp.但是各种问题.所以建议centos7使用 ...

- Spark累加器(Accumulator)

一.累加器简介 在Spark中如果想在Task计算的时候统计某些事件的数量,使用filter/reduce也可以,但是使用累加器是一种更方便的方式,累加器一个比较经典的应用场景是用来在Spark St ...

- 算法习题---5.8Unix ls命令(Uva400)

一:题目 输入正整数n以及n个文件名,将这n个文件名按照ASCII优先升序排列,按列优先方式左对齐输出. 注意:文件名最长的为M,那么最右列字符串长度为M,其他列的长度为M+2 注意:一列最多允许出现 ...

- prometheus数据格式

注意区分以下两种“数据格式”: 1.自定义exporter的时候所需要遵循的给prometheus提供数据的数据格式: https://yunlzheng.gitbook.io/prometheus- ...

- Activiti之act_ge_property表引发的坑(dbSchemaUpdate)

Activiti之act_ge_property表引发的坑(dbSchemaUpdate) 参考文档: https://blog.csdn.net/lb19921223/article/details ...