爬虫实例系列一(requests)

一 爬虫简介

'''

爬虫:通过编写程序,模拟浏览器上网,让其去互联网上爬取数据的过程 分类:

通用爬虫:爬取全部的页面数据

聚焦爬虫:抓取页面中局部数据

增量式爬虫:爬取网站中更新出的数据 反爬机制:门户网站会通过制定相关的技术手段,组织爬虫程序进行数据获取

反反爬策略:针对反爬机制制定的策略,为了获取数据 第一个反爬机制:

robots.txt协议:防君子不防小人的协议

'''

二 request 入门使用流程

'''

request使用流程:

- 制定url

- 发起请求

- 获取响应回来的页面数据

- 持久化存储

'''

三 实例

1 获取搜狗页面(反反爬机制:防君子不防小人)

import requests #获取搜狗页面数据 #1.指定url

url='https://www.sogo.com/' #2.发起请求

response=requests.get(url=url) #3.获取页面数据

response_text=response.text #4.持久化存储

with open('sogo.html',mode='w',encoding='utf8') as f:

f.write(response_text)

2 获取知乎页面数据(UA伪装)

'''

User-Agent:请求载体的身份标识

反爬机制:UA检测

反反爬策略:UA伪装

'''

#请求知乎 url='https://www.zhihu.com/' #指定请求头,进行UA伪装

headers={

'user-agent': 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.20 Safari/537.36'

}

response=requests.get(url=url,headers=headers) print(response.text)

3 post请求实例(请求百度翻译结果)

#请求百度翻译结果 #经过分析发现,百度翻译发送的请求是ajax请求

import requests url='https://fanyi.baidu.com/sug' #指定请求头,进行UA伪装

headers={

'user-agent': 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.20 Safari/537.36'

} #搜索数据不要写死 kw=input('input a word:')

#构建请求数据

data={

'kw':kw

} response=requests.post(url=url,headers=headers,data=data) print(response.json())

4 post 请求携带更多参数data={}

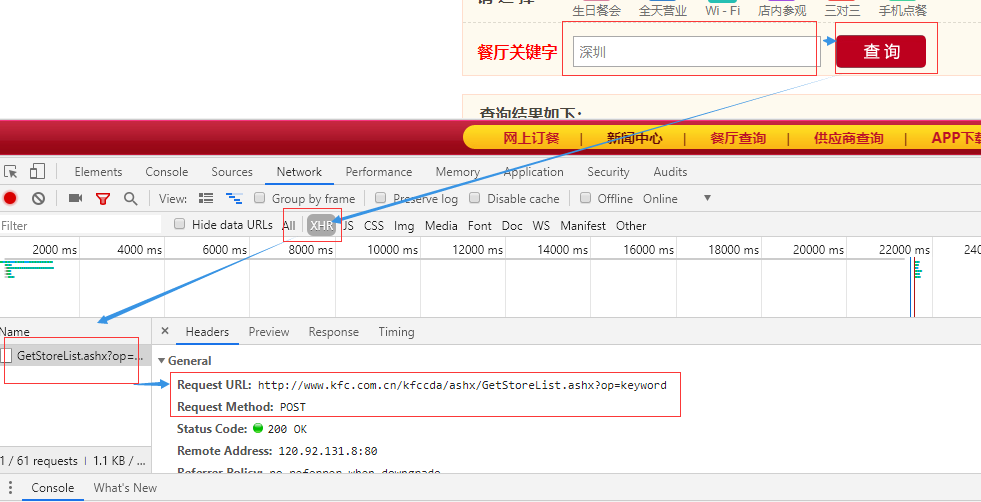

#爬取城市肯德基餐厅的位置信息 http://www.kfc.com.cn/kfccda/storelist/index.aspx '''

抓包获取的数据

Request URL: http://www.kfc.com.cn/kfccda/ashx/GetStoreList.ashx?op=keyword

Request Method: POST

Status Code: 200 OK

Remote Address: 120.92.131.8:80

Referrer Policy: no-referrer-when-downgrade

''' import requests url='http://www.kfc.com.cn/kfccda/ashx/GetStoreList.ashx?op=keyword' headers={

'user-agent': 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.20 Safari/537.36'

} data={

'cname':'',

'pid':'',

'keyword': '深圳',

'pageIndex': 3,

'pageSize': 10,

} response=requests.post(url=url,headers=headers,data=data) print(response.json())

5 爬取豆瓣电影中的详细数据(ajax请求)

import requests

#爬取豆瓣电影中的详细数据(ajax请求)

#'https://movie.douban.com/j/chart/top_list?type=24&interval_id=100%3A90&action=&start=20&limit=20'

url='https://movie.douban.com/j/chart/top_list'

headers={

'user-agent': 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.20 Safari/537.36'

}

#此处参数已经写死,后续项目中在此基础修改

params={

'type': '',

'interval_id': '100:90',

'action':'',

'start':'',

'limit':'',

}

response=requests.get(url=url,headers=headers,params=params)

print(response.json())

爬虫实例系列一(requests)的更多相关文章

- 爬虫实例之使用requests和Beautifusoup爬取糗百热门用户信息

这次主要用requests库和Beautifusoup库来实现对糗百的热门帖子的用户信息的收集,由于糗百的反爬虫不是很严格,也不需要先登录才能获取数据,所以较简单. 思路,先请求首页的热门帖子获得用户 ...

- 爬虫入门系列(二):优雅的HTTP库requests

在系列文章的第一篇中介绍了 HTTP 协议,Python 提供了很多模块来基于 HTTP 协议的网络编程,urllib.urllib2.urllib3.httplib.httplib2,都是和 HTT ...

- 爬虫入门系列(三):用 requests 构建知乎 API

爬虫入门系列目录: 爬虫入门系列(一):快速理解HTTP协议 爬虫入门系列(二):优雅的HTTP库requests 爬虫入门系列(三):用 requests 构建知乎 API 在爬虫系列文章 优雅的H ...

- 爬虫系列(七) requests的基本使用

一.requests 简介 requests 是一个功能强大.简单易用的 HTTP 请求库,可以使用 pip install requests 命令进行安装 下面我们将会介绍 requests 中常用 ...

- python爬虫学习(6) —— 神器 Requests

Requests 是使用 Apache2 Licensed 许可证的 HTTP 库.用 Python 编写,真正的为人类着想. Python 标准库中的 urllib2 模块提供了你所需要的大多数 H ...

- Python爬虫实例:爬取B站《工作细胞》短评——异步加载信息的爬取

很多网页的信息都是通过异步加载的,本文就举例讨论下此类网页的抓取. <工作细胞>最近比较火,bilibili 上目前的短评已经有17000多条. 先看分析下页面 右边 li 标签中的就是短 ...

- Python爬虫实例:爬取猫眼电影——破解字体反爬

字体反爬 字体反爬也就是自定义字体反爬,通过调用自定义的字体文件来渲染网页中的文字,而网页中的文字不再是文字,而是相应的字体编码,通过复制或者简单的采集是无法采集到编码后的文字内容的. 现在貌似不少网 ...

- Python爬虫实例:爬取豆瓣Top250

入门第一个爬虫一般都是爬这个,实在是太简单.用了 requests 和 bs4 库. 1.检查网页元素,提取所需要的信息并保存.这个用 bs4 就可以,前面的文章中已经有详细的用法阐述. 2.找到下一 ...

- [python爬虫]Requests-BeautifulSoup-Re库方案--Requests库介绍

[根据北京理工大学嵩天老师“Python网络爬虫与信息提取”慕课课程编写 文章中部分图片来自老师PPT 慕课链接:https://www.icourse163.org/learn/BIT-10018 ...

随机推荐

- Linux系统打开文件最大数量限制(进程打开的最大文件句柄数设置)

ulimit [-HSTabcdefilmnpqrstuvx [limit]] 利用ulimit命令可以对资源的可用性进行控制. -H选项和-S选项分别表示对给定资源的硬限制(hard limit ...

- Docker实用技巧之更改软件包源提升构建速度

一.开篇 地球,中国,成都市,某小区的阳台上,一青年负手而立,闭目沉思,阵阵的凉风吹得他衣衫呼呼的飘.忽然,他抬起头,刹那间,睁开了双眼,好似一到精光射向星空,只见这夜空......一颗星星都没有.他 ...

- Quartz.NET学习笔记(二) Job和JobDetails

Job和JobDetails的关系 接一篇的例子 ISchedulerFactory schedFact = new StdSchedulerFactory(); IScheduler sched = ...

- 推荐几个Spring Cloud学习资料

研究Spring Cloud也有一段时间了,手头上有一点收集的资料,分享给小伙伴们学习. 博客 1.跟我学Spring Cloud 2.周立|Spring Cloud 3.Spring Cloud基础 ...

- C++STL模板库关联容器之set/multiset

目录 一丶关联容器简介.set/multiset 二丶演示代码. 一丶关联容器简介.set/multiset 我们的序列容器,底层都是线性表构成的. 比如 vector list deque. 关联容 ...

- 微信公众号通过图片选取接口上传到阿里oss

前言 之前写过一篇微信JS-SDK的使用方法,可进行参考 https://www.cnblogs.com/fozero/p/10256862.html 配置并调用公众号接口权限 1.配置权限微信公众号 ...

- 聊天框Demo:DotNetCore+ActiveMQ+Mqttjs 实现前后台消息监听

网上查了查 ActiveMQ + .net core 的例子很少,自己做一个demo 作为记录,另外FineUI Core基础版要来了,出来后我会用FineUI再做一版,为知识星球的引流... 1.安 ...

- Java——多态浅析

前言 在面向对象程序设计语言中,多态是继数据抽象和继承之后的第三种基本特性.多态的含义是什么,有什么作用以及在Java中是怎么实现的?下面将做介绍. 什么是多态 简单点说就是"一个接口,多种 ...

- 服务注册中心之ZooKeeper系列(一)

一.服务注册中心介绍 分布式服务框架部署在多台不同的机器上.例如服务A是订单相关的处理服务,服务B是订单的客户的相关信息服务.此时有个需求需要在服务A中获取订单客户的信息.如下图: 此时就面临以下几个 ...

- Ansible 入门指南 - 安装及 Ad-Hoc 命令使用

安装及配置 ansible Ansilbe 管理员节点和远程主机节点通过 SSH 协议进行通信.所以 Ansible 配置的时候只需要保证从 Ansible 管理节点通过 SSH 能够连接到被管理的远 ...