Python爬虫+数据可视化教学:分析猫咪交易数据

猫猫这么可爱 不会有人不喜欢吧:

猫猫真的很可爱,和我女朋友一样可爱~

你们可以和女朋友一起养一只可爱猫猫

女朋友都有的吧?啊没有的话当我没说…咳咳

网上的数据太多、太杂,而且我也不知道哪个网站的数据比较好。所以,只能找到一个猫咪交易网站的数据来分析了

地址:

http://www.maomijiaoyi.com/

正式开搞!

请求数据

import requests

url = f'http://www.maomijiaoyi.com/index.php?/chanpinliebiao_c_2_1--24.html'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/92.0.4515.131 Safari/537.36'

}

response = requests.get(url=url, headers=headers)

print(response.text)

解析数据

# 把获取到的 html 字符串数据转换成 selector 对象 这样调用

selector = parsel.Selector(response.text)

# css 选择器只要是根据标签属性内容提取数据 编程永远不看过程 只要结果

href = selector.css('.content:nth-child(1) a::attr(href)').getall()

areas = selector.css('.content:nth-child(1) .area .color_333::text').getall()

areas = [i.strip() for i in areas] # 列表推导式

提取标签数据

小熊猫的python第二世界Q裙:660193417

for index in zip(href, areas):

# http://www.maomijiaoyi.com/index.php?/chanpinxiangqing_224383.html

index_url = 'http://www.maomijiaoyi.com' + index[0]

response_1 = requests.get(url=index_url, headers=headers)

selector_1 = parsel.Selector(response_1.text)

area = index[1]

# getall 取所有 get 取一个

title = selector_1.css('.detail_text .title::text').get().strip()

shop = selector_1.css('.dinming::text').get().strip() # 店名

price = selector_1.css('.info1 div:nth-child(1) span.red.size_24::text').get() # 价格

views = selector_1.css('.info1 div:nth-child(1) span:nth-child(4)::text').get() # 浏览次数

# replace() 替换

promise = selector_1.css('.info1 div:nth-child(2) span::text').get().replace('卖家承诺: ', '') # 浏览次数

num = selector_1.css('.info2 div:nth-child(1) div.red::text').get() # 在售只数

age = selector_1.css('.info2 div:nth-child(2) div.red::text').get() # 年龄

kind = selector_1.css('.info2 div:nth-child(3) div.red::text').get() # 品种

prevention = selector_1.css('.info2 div:nth-child(4) div.red::text').get() # 预防

person = selector_1.css('div.detail_text .user_info div:nth-child(1) .c333::text').get() # 联系人

phone = selector_1.css('div.detail_text .user_info div:nth-child(2) .c333::text').get() # 联系方式

postage = selector_1.css('div.detail_text .user_info div:nth-child(3) .c333::text').get().strip() # 包邮

purebred = selector_1.css(

'.xinxi_neirong div:nth-child(1) .item_neirong div:nth-child(1) .c333::text').get().strip() # 是否纯种

sex = selector_1.css(

'.xinxi_neirong div:nth-child(1) .item_neirong div:nth-child(4) .c333::text').get().strip() # 猫咪性别

video = selector_1.css(

'.xinxi_neirong div:nth-child(2) .item_neirong div:nth-child(4) .c333::text').get().strip() # 能否视频

worming = selector_1.css(

'.xinxi_neirong div:nth-child(2) .item_neirong div:nth-child(2) .c333::text').get().strip() # 是否驱虫

dit = {

'地区': area,

'店名': shop,

'标题': title,

'价格': price,

'浏览次数': views,

'卖家承诺': promise,

'在售只数': num,

'年龄': age,

'品种': kind,

'预防': prevention,

'联系人': person,

'联系方式': phone,

'异地运费': postage,

'是否纯种': purebred,

'猫咪性别': sex,

'驱虫情况': worming,

'能否视频': video,

'详情页': index_url,

}

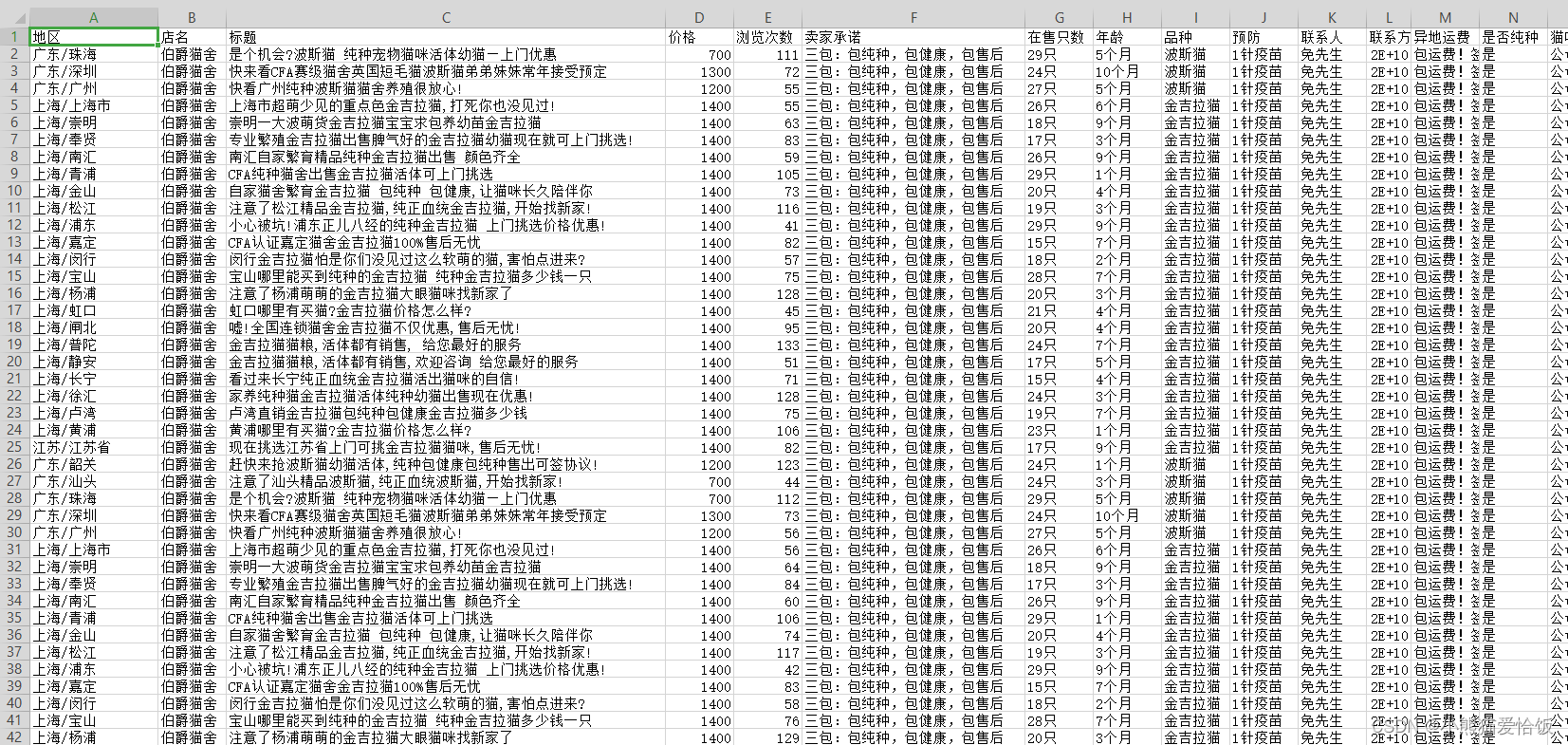

保存数据

import csv # 内置模块

f = open('猫咪1.csv', mode='a', encoding='utf-8', newline='')

csv_writer = csv.DictWriter(f, fieldnames=['地区', '店名', '标题', '价格', '浏览次数', '卖家承诺', '在售只数',

'年龄', '品种', '预防', '联系人', '联系方式', '异地运费', '是否纯种',

'猫咪性别', '驱虫情况', '能否视频', '详情页'])

csv_writer.writeheader() # 写入表头

csv_writer.writerow(dit)

print(title, area, shop, price, views, promise, num, age,

kind, prevention, person, phone, postage, purebred, sex, video, worming, index_url, sep=' | ')

得到数据

数据可视化部分

词云图

from pyecharts import options as opts

from pyecharts.charts import WordCloud

from pyecharts.globals import SymbolType

from pyecharts.globals import ThemeType

words = [(i,1) for i in cat_info['品种'].unique()]

c = (

WordCloud(init_opts=opts.InitOpts(theme=ThemeType.LIGHT))

.add("", words,shape=SymbolType.DIAMOND)

.set_global_opts(title_opts=opts.TitleOpts(title=""))

)

c.render_notebook()

**

交易品种占比图

from pyecharts import options as opts

from pyecharts.charts import TreeMap

pingzhong = cat_info['品种'].value_counts().reset_index()

data = [{'value':i[1],'name':i[0]} for i in zip(list(pingzhong['index']),list(pingzhong['品种']))]

c = (

TreeMap(init_opts=opts.InitOpts(theme=ThemeType.LIGHT))

.add("", data)

.set_global_opts(title_opts=opts.TitleOpts(title=""))

.set_series_opts(label_opts=opts.LabelOpts(position="inside"))

)

c.render_notebook()

均价占比图

from pyecharts import options as opts

from pyecharts.charts import PictorialBar

from pyecharts.globals import SymbolType

location = list(price['品种'])

values = list(price['价格'])

c = (

PictorialBar(init_opts=opts.InitOpts(theme=ThemeType.LIGHT))

.add_xaxis(location)

.add_yaxis(

"",

values,

label_opts=opts.LabelOpts(is_show=False),

symbol_size=18,

symbol_repeat="fixed",

symbol_offset=[0, 0],

is_symbol_clip=True,

symbol=SymbolType.ROUND_RECT,

)

.reversal_axis()

.set_global_opts(

title_opts=opts.TitleOpts(title="均价排名"),

xaxis_opts=opts.AxisOpts(is_show=False),

yaxis_opts=opts.AxisOpts(

axistick_opts=opts.AxisTickOpts(is_show=False),

axisline_opts=opts.AxisLineOpts(

linestyle_opts=opts.LineStyleOpts(opacity=0),

),

),

)

.set_series_opts(

label_opts=opts.LabelOpts(position='insideRight')

)

)

c.render_notebook()

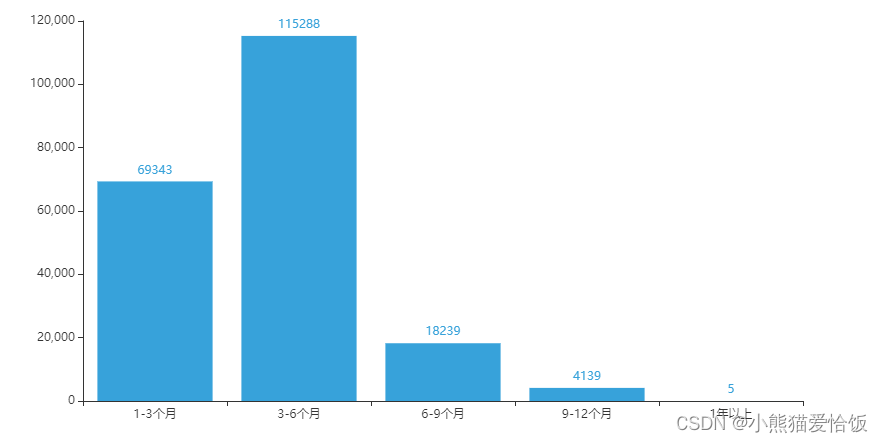

猫龄柱状图

from pyecharts import options as opts

from pyecharts.charts import Bar

from pyecharts.faker import Faker

x = ['1-3个月','3-6个月','6-9个月','9-12个月','1年以上']

y = [69343,115288,18239,4139,5]

c = (

Bar(init_opts=opts.InitOpts(theme=ThemeType.LIGHT))

.add_xaxis(x)

.add_yaxis('', y)

.set_global_opts(title_opts=opts.TitleOpts(title="猫龄分布"))

)

c.render_notebook()

Python爬虫+数据可视化教学:分析猫咪交易数据的更多相关文章

- Python爬虫+可视化教学:爬取分析宠物猫咪交易数据

前言 各位,七夕快到了,想好要送什么礼物了吗? 昨天有朋友私信我,问我能用Python分析下网上小猫咪的数据,是想要送一只给女朋友,当做礼物. Python从零基础入门到实战系统教程.源码.视频 网上 ...

- 【Matplotlib】数据可视化实例分析

数据可视化实例分析 作者:白宁超 2017年7月19日09:09:07 摘要:数据可视化主要旨在借助于图形化手段,清晰有效地传达与沟通信息.但是,这并不就意味着数据可视化就一定因为要实现其功能用途而令 ...

- 利用selenium 爬取豆瓣 武林外传数据并且完成 数据可视化 情绪分析

全文的步骤可以大概分为几步: 一:数据获取,利用selenium+多进程(linux上selenium 多进程可能会有问题)+kafka写数据(linux首选必选耦合)windows直接采用的是写my ...

- Python爬虫:新浪新闻详情页的数据抓取(函数版)

上一篇文章<Python爬虫:抓取新浪新闻数据>详细解说了如何抓取新浪新闻详情页的相关数据,但代码的构建不利于后续扩展,每次抓取新的详情页时都需要重新写一遍,因此,我们需要将其整理成函数, ...

- Python爬虫《爬取get请求的页面数据》

一.urllib库 urllib是Python自带的一个用于爬虫的库,其主要作用就是可以通过代码模拟浏览器发送请求.其常被用到的子模块在Python3中的为urllib.request和urllib. ...

- Python图表数据可视化Seaborn:1. 风格| 分布数据可视化-直方图| 密度图| 散点图

conda install seaborn 是安装到jupyter那个环境的 1. 整体风格设置 对图表整体颜色.比例等进行风格设置,包括颜色色板等调用系统风格进行数据可视化 set() / se ...

- [Python爬虫] 之八:Selenium +phantomjs抓取微博数据

基本思路:在登录状态下,打开首页,利用高级搜索框输入需要查询的条件,点击搜索链接进行搜索.如果数据有多页,每页数据是20条件,读取页数 然后循环页数,对每页数据进行抓取数据. 在实践过程中发现一个问题 ...

- 爱奇艺用券付费VIP电影+python爬虫程序+可视化界面+下载本地

申明:本博客中的工具及源码仅供个人学习使用,请勿用作商业等其他任何违法用途!否则后果自负 直接步入正题吧! 工具开发环境:windows10,python3.6 工具界面设计:基于python 自带的 ...

- 数据可视化之分析篇(二)Power BI 数据分析:客户购买频次分布

https://zhuanlan.zhihu.com/p/100070260 商业数据分析通常都可以简化为对数据进行筛选.分组.汇总的过程,本文通过一个实例来看看PowerBI是如何快速完成整个过程的 ...

随机推荐

- Vue 中 axios 跨域配置 (!!!配置完成需要重新运行,不然也不起作用)

当拿到一个网址如:https://music.163.com/store/api/categorypage/list 获取数据是出现如下: 证明该网址不能非常直观的拿到数据.接下来我们试试跨域拿这个 ...

- python基础练习题(题目 三数排序。)

day40 --------------------------------------------------------------- 实例066:三数排序 题目 输入3个数a,b,c,按大小顺序 ...

- Docker安装 Ubuntu Centos

Ubuntu 安装Dokcer 1. 删除旧版本Docker安装包和依赖项 sudo apt-get remove docker docker-engine docker.io containerd ...

- SQL语言详解

SQL 1. 概述 Structured Query Language 结构化查询语言 结构化查询语言(Structured Query Language)简称SQL,是一种数据库查询和程序设计语言, ...

- Oauth的学习以及开发自助上课签到脚本

附上源码: https://github.com/taka250/auto_checkin_skl_hdu 首先了解学习oauth的知识 ...

- AcWing-3167. 星星还是树 -c++题解(模拟退火)

在二维平面上有 n 个点,第 i 个点的坐标为 (xi,yi).请你找出一个点,使得该点到这 n个点的距离之和最小.该点可以选择在平面中的任意位置,甚至与这 n个点的位置重合. 输入格式 第一行包 ...

- Linux 服务器的性能参数指标总结

关注「开源Linux」,选择"设为星标" 回复「学习」,有我为您特别筛选的学习资料~ 前言 一个基于 Linux 操作系统的服务器运行的同时,也会表征出各种各样参数信息.通常来说运 ...

- MindSpore尝鲜之爱因斯坦求和

技术背景 在前面的博客中,我们介绍过关于numpy中的张量网络的一些应用,同时利用相关的张量网络操作,我们可以实现一些分子动力学模拟中的约束算法,如LINCS等.在最新的nightly版本的MindS ...

- 使用 .net + blazor 做一个 kubernetes 开源文件系统

背景 据我所知,目前 kubernetes 本身或者其它第三方社区都没提供 kubernetes 的文件系统.也就是说要从 kubernetes 的容器中下载或上传文件,需要先进入容器查看目录结构,然 ...

- JavaScript 数据结构与算法3(链表)

学习数据结构的 git 代码地址: https://gitee.com/zhangning187/js-data-structure-study 1.链表 本章学习如何实现和使用链表这种动态的数据结构 ...