《Link Prediction with Personalized Social Influence》论文解读

论文:Huo, Zepeng, Xiao Huang, and Xia Hu. "Link Prediction with Personalized Social Influence." (2018).

1. Motivation

先思考几个问题

- 已知一个微博用户今天的活动记录(转发、评论、点赞等),能否预测其明天的活动情况?

- 假设该用户追星,而且其偶像的每一条微博他都会转发评论,那么对其明天的活动情况的预测是不是会更容易?

- 为什么更容易了?因为该用户的偶像对他有影响,这种影响降低了预测该用户活动的随机性,于是预测就更容易。

- 那么如果给出了所有用户的活动记录,是不是能够反推出用户间的相互影响力,进而更精确地对用户和网络建模表示,从而提高链接预测等应用的精确度。

那么接下来的问题是怎么由活动记录反推影响力。

1.1 由活动记录反推影响力

- 『已知用户 \(u_i\) 的活动记录,预测其明天的活动情况』与『已知用户偶像 \(u_j\) 和该用户 \(u_i\) 的活动记录,预测其明天的活动情况』,两个预测的不确定性之间,相差的就是偶像 \(u_j\) 对该用户 \(u_i\) 的影响。

- 那么怎么衡量这种不确定性?信息熵。熵在信息论中代表随机变量不确定度的度量。下面这个是信息熵的公式。

\[H(\mathbf{X})=-\sum\limits_{x\in \mathcal{X}} p(x)\log p(x)\]

2. 问题定义

现在来定义一下要解决的问题。

令 \(\mathcal{G}=\left\{\mathcal{U},\mathcal{E}\right\}\) 表示网络,其中 \(\mathcal{U}=\{u_1,u_2,\ldots,u_N\}\) 表示 \(N\) 个用户组成的集合,\(\mathcal{E}\subseteq \mathcal{U\times U}\) 为边集合。令 \(\mathcal{A}\) 表示活动时间戳集合,\(\mathcal{A}^{(i)}=\left\{t_{i,1},t_{i,2},\ldots\right\}\) 表示用户 \(u_i\) 的活动时间戳序列。

本文中的链接预测问题为:给定 \(\mathcal{G}\) 和 \(\mathcal{A}\),预测任意用户 \(u_i\) 到用户 \(u_j\) 有边的概率。

本文希望对于每个用户 \(u_i\) 能学习到两个向量 \(S_i\) 和 \(T_i\) ,分别为该用户作为边起点和边终点的表示。作为边起点时,用户对其他用户产生影响;作为终点时,该用户受其他用户的影响。最终,任意用户 \(u_i\) 和 \(u_j\) 有边的概率可通过 \(S_iT_j\) 表示。

3. 社交影响力度量

先解决上面说的度量社交影响力的问题,即借用信息熵由活动记录反推影响力。

3.1 时间序列建模

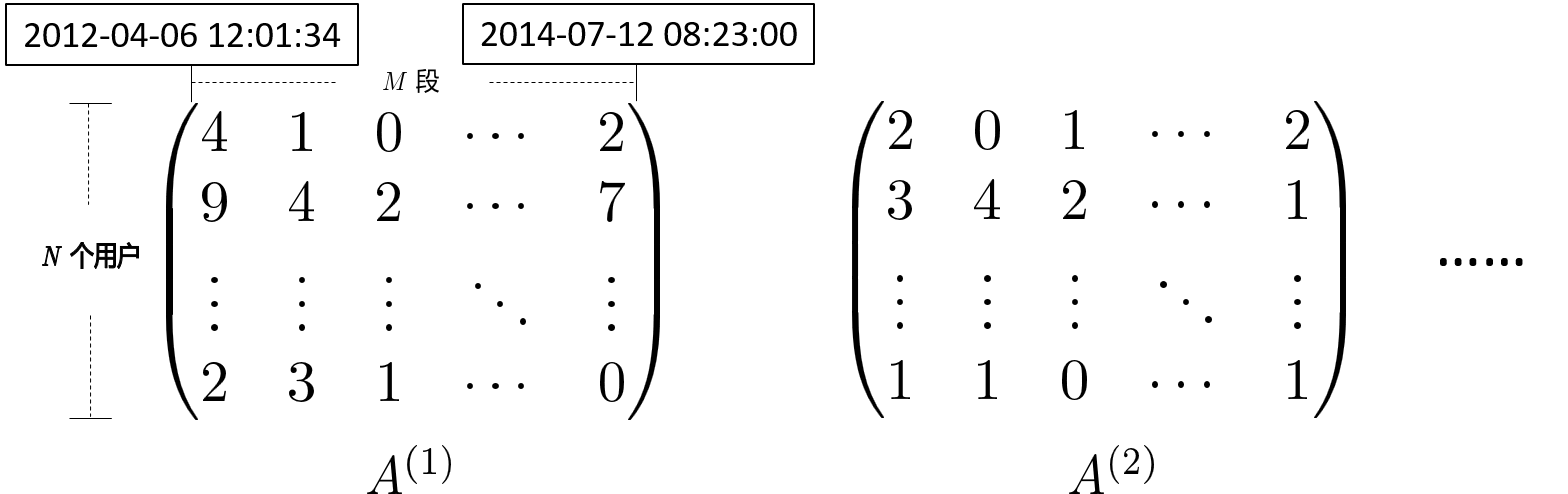

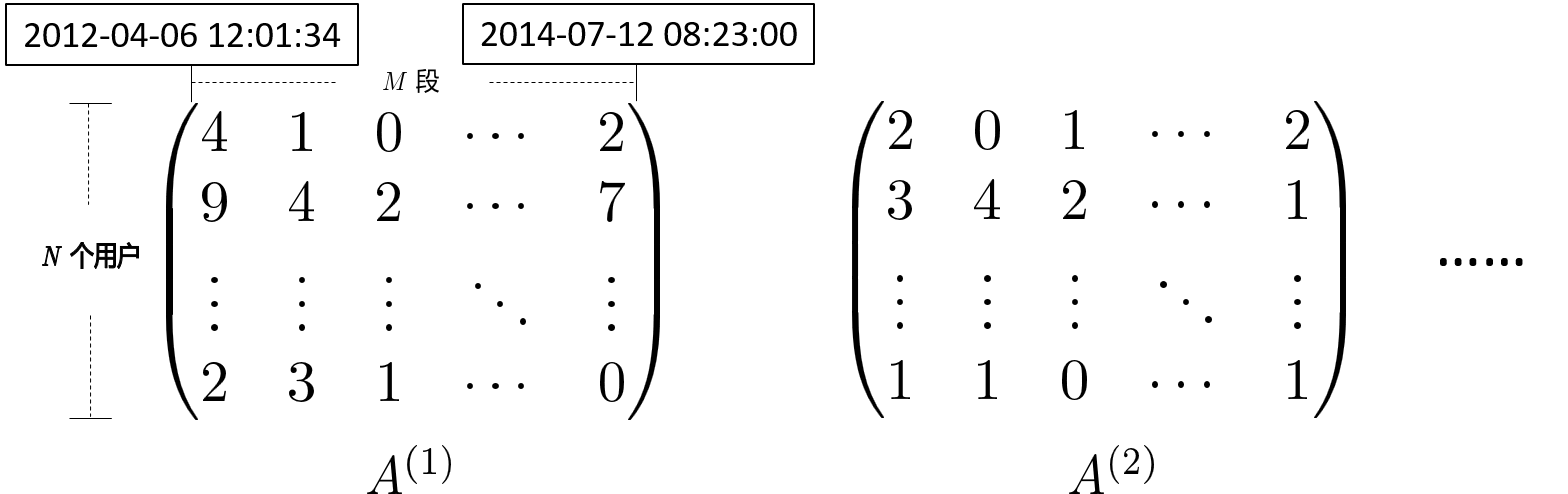

定义用户 \(u_i\) 的时间片大小为 \(\Delta t^i=(t_{max}-t_{min})/M\),从而将用户 \(u_i\) 的活动时间划分为 \(M\) 段。

定义任意用户 \(u_x\) 在第 \(m\) 段的活动频度为 \(A_{x,m}^{(i)}\)。

则对用户 \(u_i\) 来说,时间戳序列集合 \(\mathcal{A}\) 被转化为一个矩阵 \(A^{(i)}\in \mathbb{R}^{N\times M}\)。

于是,我们将有 \(N\) 个不同的矩阵,即 \(\left\{A^{(i)}\right\},\text{for}\ i=1,2,\ldots,N\)

下图为对这 \(N\) 个矩阵的一种具象的表示。

-->

3.2 影响力度量

考虑边 \((i,j)\),用户 \(u_i\) 关注 \(u_j\),则 \(u_j\) 对 \(u_i\) 产生影响。在矩阵 \(A^{(i)}\) 上计算用户 \(u_j\) 对 \(u_i\) 的影响力如下:

- 将 \(A^{(i)}_i\) 视为马尔可夫链,即可由 \(A^{(i)}_{i,m}\) 预测 \(A_{i,m+1}^{(i)}\),则可定义用户 \(u_i\) 在 \(m+1\) 段活跃的概率为

\[P(A_{i,m+1}^{(i)} \neq 0\mid A_{i,m}^{(i)})\]

则可得一个分布

\[p_1=\left\{P(A_{i,m+1}^{(i)} \neq 0\mid A_{i,m}^{(i)})\right\},\text{for}\ m=1,\ldots,M-1\]

该分布表达在不知 \(u_j\) 影响的前提下,对 \(u_i\) 活跃度预测的不确定性。 类似可得分布

\[p_2=\left\{P(A_{i,m+1}^{(i)} \neq 0\mid A_{i,m}^{(i)},A_{j,m}^{(i)})\right\}, \text{for}\ m=1,\ldots,M-1\]

该分布表达在已知 \(u_j\) 活动记录和 \(u_i\) 活动记录前提下,对 \(u_i\) 活跃度预测的不确定性。于是可将两分布的熵之差视作 \(u_j\) 对 \(u_i\) 影响的度量:

\[

\begin{align*}

I_{j\to i} &\triangleq H(p_1)-H(p_2) \\\\

&=-\sum\limits_{m=1}^{M-1} P(A_{i,m+1}^{(i)}\neq 0 \mid A_{i,m}^{(i)}) \log P(A_{i,m+1}^{(i)}\neq 0\mid A_{i,m}^{(i)}) \\\\

&\ \ \ \ +\sum\limits_{m=1}^{M-1}P(A_{i,m+1}^{(i)}\neq 0\mid A_{i,m}^{(i)},A_{j,m}^{(i)})\log P(A_{i,m+1}^{(i)}\neq 0\mid A_{i,m}^{(i)},A_{j,m}^{(i)})\\\\

\end{align*}

\]

3.3 \(p_1\) 和 \(p_2\) 的计算

\(p_1\) 是通过 Logistic 回归计算的:

\[P(A_{i,m+1}^{(i)}\neq 0\mid A_{i,m}^{(i)})={\frac{1}{1+e^{-\alpha_0-\alpha_1f(A_{i,m}^{(i)})}}}\]

其中 \(\alpha_0\) 和 \(\alpha_1\) 是通过学习得到的。

学习过程的输入为 \(\left\{A_{i,1}^{(i)},A_{i,2}^{(i)},\ldots,A_{i,M-1}^{(i)}\right\}\),对应 label 为 \(\left\{\text{sgn}(A_{i,2}^{(i)}),\text{sgn}(A_{i,3}^{(i)}),\ldots,\text{sgn}(A_{i,M}^{(i)})\right\}\)。

其中 \(f(x)=\begin{cases} x,&\text{if}\ x\leq 2,\\ 1+\lceil\log(1+x)\rceil, &o/w. \\ \end{cases}\),是为保证更符合现实情况,如某个用户在短时间内发了大量微博,其他用户并不一定每一条都看到。

类似地,\(p_2\) 可如下计算:

\[P(A_{i,m+1}^{(i)}\neq 0\mid A_{i,m}^{(i)},A_{j,m}^{(i)})=\frac{1}{1+e^{-\alpha_0-\alpha_1 f(A_{i,m}^{(i)})-\alpha_2 f(A_{i,m}^{(i)})}}\]

4. 社交影响力 + 网络结构

如果在保持网络结构的基础上,边的强度与边两端节点的影响力成正比,这样学习到的表示就能够更有效地利用网络中的信息。

定义 \(u_i\) 到 \(u_j\) 有边的概率为

\[\hat{p}(u_j\mid u_i)=I_{j\to i}/d_i^{\text{out}}\]

其中 \(d_i^{\text{out}}=\sum_{(i,n)\in \mathcal{E}}I_{n\to j}\)。

再定义由节点向量表示计算 \(u_i\) 到 \(u_j\) 有边的概率为

\[p(u_j\mid u_i)=\frac{e^{S_i T_j^\top}}{\sum_{n=1}^N e^{S_i T_n^\top}}\]

于是,将目标函数设置为最小化两者的 KL 散度即可:

\[

\begin{align*}

\text{min}\ \mathcal{J}_1&=\sum\limits_{(i,j)\in\hat{\mathcal{E}}} d_i^{out}D_{KL}(\hat{p}(u_j\mid u_i)\lVert p(u_j\mid u_i))\\\\

&=-\sum\limits_{(i,j)\in\hat{\mathcal{E}}}I_{j\to i}\log p(u_j\mid u_i)+\cfrac{I_{j\to i}}{d_i^{out}}\log \cfrac{I_{j\to i}}{d_i^{out}}

\end{align*}

\]

去掉常数项得:

\[\text{max}\ \hat{\mathcal{J}_1}=\sum\limits_{(i,j)\in\hat{\mathcal{E}}} I_{j\to i} \log p(u_j\mid u_i)\]

4.1 负采样

通过定义新的条件概率区别正负样本:

\[p(u_j > u_n\mid u_i)=\sigma(S_iT_j^\top-S_iT_n^\top)\]

则目标函数为:

\[\text{max}\ \ \mathcal{J}_2=\sum\limits_{(i,j)\in\hat{\mathcal{E} } }I_{j\to i} \sum\limits_{u_n\in \mathcal{U}\backslash j} \log\sigma(S_i T_j^\top-S_i T_n^\top )\]

则最终的目标函数为:

\[\text{max}\ \mathcal{J}=\sum_{(i,j)\in\mathcal{E}} I_{j\to i} \sum^K E_{u_n\sim P_n(u)}\log \sigma(S_i T_j^\top -S_i T_n^\top)-\frac{\beta_1}{2} \lVert S \rVert_F^2 -\frac{\beta_2}{2}\lVert T\rVert_F^2\]

之后使用异步随机梯度下降迭代更新参数 \(S\) 和 \(T\) 即可学习到节点的表示。

5. 总结

- 网络结构 + 社交影响力

- 构造分布,使用信息熵度量影响力

- 每个用户有 \(S\) 和 \(T\) 两个向量,表达其不同角色

END

2018.4.9

《Link Prediction with Personalized Social Influence》论文解读的更多相关文章

- 《Population Based Training of Neural Networks》论文解读

很早之前看到这篇文章的时候,觉得这篇文章的思想很朴素,没有让人眼前一亮的东西就没有太在意.之后读到很多Multi-Agent或者并行训练的文章,都会提到这个算法,比如第一视角多人游戏(Quake ...

- ImageNet Classification with Deep Convolutional Neural Networks 论文解读

这个论文应该算是把深度学习应用到图片识别(ILSVRC,ImageNet large-scale Visual Recognition Challenge)上的具有重大意义的一篇文章.因为在之前,人们 ...

- 《Deep Feature Extraction and Classification of Hyperspectral Images Based on Convolutional Neural Networks》论文笔记

论文题目<Deep Feature Extraction and Classification of Hyperspectral Images Based on Convolutional Ne ...

- Quantization aware training 量化背后的技术——Quantization and Training of Neural Networks for Efficient Integer-Arithmetic-Only Inference

1,概述 模型量化属于模型压缩的范畴,模型压缩的目的旨在降低模型的内存大小,加速模型的推断速度(除了压缩之外,一些模型推断框架也可以通过内存,io,计算等优化来加速推断). 常见的模型压缩算法有:量化 ...

- Training Deep Neural Networks

http://handong1587.github.io/deep_learning/2015/10/09/training-dnn.html //转载于 Training Deep Neural ...

- Training (deep) Neural Networks Part: 1

Training (deep) Neural Networks Part: 1 Nowadays training deep learning models have become extremely ...

- [CVPR2015] Is object localization for free? – Weakly-supervised learning with convolutional neural networks论文笔记

p.p1 { margin: 0.0px 0.0px 0.0px 0.0px; font: 13.0px "Helvetica Neue"; color: #323333 } p. ...

- Training spiking neural networks for reinforcement learning

郑重声明:原文参见标题,如有侵权,请联系作者,将会撤销发布! 原文链接:https://arxiv.org/pdf/2005.05941.pdf Contents: Abstract Introduc ...

- CVPR 2018paper: DeepDefense: Training Deep Neural Networks with Improved Robustness第一讲

前言:好久不见了,最近一直瞎忙活,博客好久都没有更新了,表示道歉.希望大家在新的一年中工作顺利,学业进步,共勉! 今天我们介绍深度神经网络的缺点:无论模型有多深,无论是卷积还是RNN,都有的问题:以图 ...

- 论文翻译:BinaryConnect: Training Deep Neural Networks with binary weights during propagations

目录 摘要 1.引言 2.BinaryConnect 2.1 +1 or -1 2.2确定性与随机性二值化 2.3 Propagations vs updates 2.4 Clipping 2.5 A ...

随机推荐

- 所有eclipse版本,主题黑化,代码黑化的简单两步

一.下载两个文件 二.打开eclipse,Import .epf文件 三.把.jar 复制到 eclipse的plugins目录下,重启eclipse 效果如下: 注 以上方法:来自互联网

- 如何保持Redis和MySQL数据一致

原文:https://blog.csdn.net/thousa_ho/article/details/78900563 1. MySQL持久化数据,Redis只读数据 redis在启动之后,从数据库加 ...

- CMake与Make最简单直接的区别 [转]

写程序大体步骤为: 1.用编辑器编写源代码,如.c文件. 2.用编译器编译代码生成目标文件,如.o. 3.用链接器连接目标代码生成可执行文件,如.exe. 但如果源文件太多,一个一个编译时就会特别麻烦 ...

- centos 6.8 设置svn钩子同步至web目录

1.在web目录创建项目目录 mkdir ./opt/wwwroot/项目名称 2.使用svn检出项目文件 svn checkout svn://localhost:/项目名称 3.设置svn库中钩子 ...

- [蓝桥杯]2013蓝桥省赛B组题目及详解

/*——————————————————————————————————————————————————————————— 题目:2013 高斯日记T-1 问题描述: 大数学家高斯有一个好习惯:无论如 ...

- 为什么qt成为c++界面编程的第一选择

为什么qt成为c++界面编程的第一选择 一.前言 为什么现在QT越来越成为界面编程的第一选择,笔者从事qt界面编程已经有接近8年,在这之前我做C++界面都是基于MFC,也做过5年左右.当时为什么会从M ...

- cocos 动画系统

前面的话 cocos 动画系统支持任意组件属性和用户自定义属性的驱动,再加上可任意编辑的时间曲线和移动轨迹编辑功能,就可以制作出各种动态效果 概述 Animation 组件可以以动画方式驱动所在节点和 ...

- Retrofit原理

Retrofit原理解析最简洁的思路 Retrofit 工作原理总结 从架构角度看Retrofit的作用.原理和启示 Retrofit主要是在create方法中采用动态代理模式实现接口方法:这个过程构 ...

- bat脚本基本命令和格式

bat脚本 --莫非 BAT脚本与shell脚本区别 Shell脚本使用Linux/Unix下的命令,一般文件开头以#号来告诉系统这个脚本需要什么解释器来执行(如:#!/bin/bash采用bash而 ...

- Linux下的Locale详解

locale这个单词中文翻译成地区或者地域,其实这个单词包含的意义要宽泛很多.Locale是根据计算机用户所使用的语言,所在国家或者地区,以及当地的文化传统所定义的一个软件运行时的语言环境. loca ...