Hadoop(五):HDFS的JAVA API基本操作

HDFS的JAVA API操作

HDFS在生产应用中主要是客户端的开发,其核心步骤是从HDFS提供的api中构造一个HDFS的访问客户端对象,然后通过该客户端对象操作(增删改查)HDFS上的文件。

主要类

Configuration

其实就是我们Java项目的core-site.xml文件,就像安装Hadoop时要配置core-site.xml文件一样,我们的java项目也要正确配置才能连接Hadoop。

在实例化的时候,Configuration类会自动读取:

core-default.xml(不需要我们增加)

core-site.xml(我们配置)

其实和Hadoop配置一样,core-site没配置的时候,就取默认的core-default.xml里的配置。

Configuration类除了自动读取配置文件以外,还提供了一系列操作配置的方法,可以在程序里修改配置(而不是修改配置文件)。

FileSystem

类似Hadoop shell,对文件操作,通过该类可以对文件进行CRUD。

和Hadoop shell一样,可以对Hadoop支持的文件系统操作。

无参构造器是protected的,一般使用get方法获取该类的对象。

get方法获取对象有4种重写,一般我们只会用两种,见下文。

示例代码

1.建立Maven项目,导入基本依赖

<dependencies>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>3.2.1</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>3.2.1</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>3.2.1</version>

</dependency>

</dependencies>

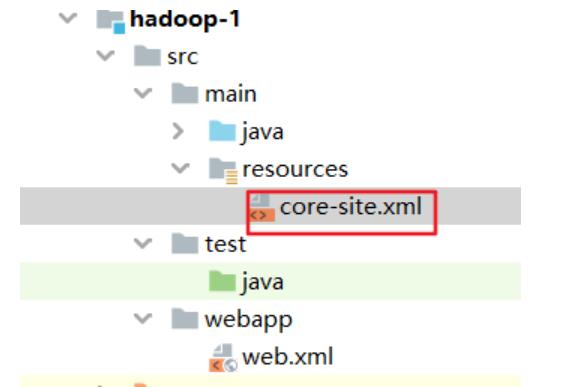

2.在resources文件夹下建立core-site.xml文件

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://192.168.98.129:9000</value>

</property>

</configuration>

备注:Hadoop中似乎已经封装了log4j日志,可以把log4j.properties也添加进去,否则log4j就一直报找不到配置文件。不加也可以。

3.建立测试类

1.基本使用

package com.rzp.hdfs;

//注意导入的包一定要正确

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import java.io.IOException;

import java.net.URI;

import java.net.URISyntaxException;

public class TestHDFSClient {

public static void main(String[] args) throws IOException, URISyntaxException, InterruptedException {

//实例化Configuration

Configuration conf = new Configuration();

//使用root用户登录,如果不写,会用当前程序运行环境的用户登录,比如windows的Administrator用户导致报错

System.setProperty("HADOOP_USER_NAME","root");

//查看core-site.xml文件中fs.defaultFS的值

System.out.println(conf.get("fs.defaultFS"));

//第一种获取FileSystem的对象的方式,通过get(conf)方法,

FileSystem fs1 = FileSystem.get(conf);

//在根目录下增加/helloByJava文件夹

fs1.create(new Path("/helloByJava"));

//关闭连接

fs1.close;

}

}

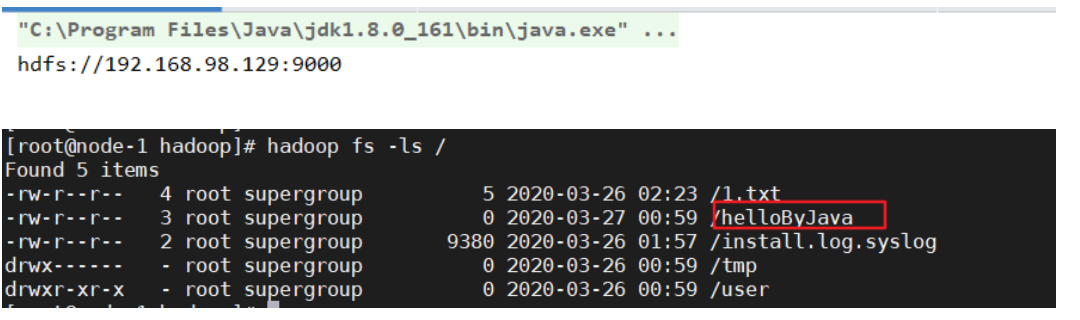

测试结果:输出了配置中的值,Hadoop根目录下也增加对应文件夹,说明连接成功。

2.通过set方法,修改conf的参数

public static void main(String[] args) throws IOException, URISyntaxException, InterruptedException {

Configuration conf = new Configuration();

//set方法,修改conf的参数,可以把core-site.xml文件删除测试

conf.set("fs.defaultFS","hdfs://192.168.98.129:9000");

System.setProperty("HADOOP_USER_NAME","root");

System.out.println(conf.get("fs.defaultFS"));

FileSystem fs1 = FileSystem.get(conf);

fs1.create(new Path("/helloByJava"));

}

3.第二种FileSystem实例化的方法,指定用户的get方法

public void test1() throws URISyntaxException, IOException, InterruptedException {

Configuration conf = new Configuration();

//直接指定操作该对象的用户名

FileSystem fs1 = FileSystem.get(new URI("hdfs://192.168.98.129:9000"),conf,"root");

fs1.create(new Path("/helloByJava"));

//关闭连接

fs1.close;

}

FileSystem的主要方法

copyToLocalFile--下载文件到本地

@Test

public void test2() throws URISyntaxException, IOException, InterruptedException {

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://192.168.98.129:9000"),conf,"root");

//第一个地址是Hadoop路径,第二个地址是本地路径

fs.copyToLocalFile(new Path("/install.log.syslog"),new Path("./log"));

}

copyFromLocalFile 上传文件

static FileSystem fs = null;

public static void init() throws Exception {

Configuration conf = new Configuration();

fs = FileSystem.get(new URI("hdfs://192.168.98.129:9000"), conf, "root");

}

@Test

public void testAddFileToHdfs() throws Exception {

HdfsClient.init();

//第一个地址是本地路径,第二个地址是Hadoop的路径

fs.copyFromLocalFile(new Path("D:\\log.log"), new Path("/")); fs.close();

}

文件CRUD

@Test

public void testMkdirAndDeleteAndRename() throws Exception {

HdfsClient.init(); // 创建目录

fs.mkdirs(new Path("/a1/b1/c1"));

fs.mkdirs(new Path("/d1"));

// 删除文件,如果是非空文件夹,参数2必须给值true

fs.delete(new Path("/a1"), true);

// 重命名文件或文件夹

fs.rename(new Path("/d1"), new Path("/d2"));

fs.close();

}

查看目录(该部分笔者还没梳理完,所以没有注释,梳理完再修改)

/**

* 查看目录信息,只显示文件

*

* @throws IOException

* @throws IllegalArgumentException

* @throws FileNotFoundException

*/

@Test

public void testListFiles() throws Exception {

HdfsClient.init();

RemoteIterator<LocatedFileStatus> listFiles = fs.listFiles(new Path("/"), true);

while (listFiles.hasNext()) {

LocatedFileStatus fileStatus = listFiles.next();

System.out.println(fileStatus.getPath().getName());

System.out.println(fileStatus.getBlockSize());

System.out.println(fileStatus.getPermission());

System.out.println(fileStatus.getLen());

BlockLocation[] blockLocations = fileStatus.getBlockLocations();

for (BlockLocation bl : blockLocations) {

System.out.println("block-length:" + bl.getLength() + "--" + "block-offset:" + bl.getOffset());

String[] hosts = bl.getHosts();

for (String host : hosts) {

System.out.println(host);

}

}

System.out.println("--------------打印的分割线--------------");

}

}

/**

* 查看文件及文件夹信息

*

* @throws IOException

* @throws IllegalArgumentException

* @throws FileNotFoundException

*/

@Test

public void testListAll() throws Exception {

HdfsClient.init();

FileStatus[] listStatus = fs.listStatus(new Path("/"));

String flag = "";

for (FileStatus fstatus : listStatus) {

if (fstatus.isFile()) {

flag = "f-- ";

} else {

flag = "d-- ";

}

System.out.println(flag + fstatus.getPath().getName());

System.out.println(fstatus.getPermission());

}

}

Hadoop(五):HDFS的JAVA API基本操作的更多相关文章

- Hadoop之HDFS(三)HDFS的JAVA API操作

HDFS的JAVA API操作 HDFS 在生产应用中主要是客户端的开发,其核心步骤是从 HDFS 提供的 api中构造一个 HDFS 的访问客户端对象,然后通过该客户端对象操作(增删改查)HDFS ...

- HDFS中JAVA API的使用

HDFS中JAVA API的使用 HDFS是一个分布式文件系统,既然是文件系统,就可以对其文件进行操作,比如说新建文件.删除文件.读取文件内容等操作.下面记录一下使用JAVA API对HDFS中的 ...

- 大数据实操2 - hadoop集群访问——Hadoop客户端访问、Java API访问

上一篇中介绍了hadoop集群搭建方式,本文介绍集群的访问.集群的访问方式有两种:hadoop客户端访问,Java API访问. 一.集群客户端访问 Hadoop采用C/S架构,可以通过客户端对集群进 ...

- HDFS的Java API

HDFS Java API 可以用于任何Java程序与HDFS交互,该API使我们能够从其他Java程序中利用到存储在HDFS中的数据,也能够使用其他非Hadoop的计算框架处理该数据 为了以编程方式 ...

- hadoop学习笔记(五):java api 操作hdfs

HDFS的Java访问接口 1)org.apache.hadoop.fs.FileSystem 是一个通用的文件系统API,提供了不同文件系统的统一访问方式. 2)org.apache.hadoop. ...

- 使用HDFS客户端java api读取hadoop集群上的信息

本文介绍使用hdfs java api的配置方法. 1.先解决依赖,pom <dependency> <groupId>org.apache.hadoop</groupI ...

- hadoop学习(五)----HDFS的java操作

前面我们基本学习了HDFS的原理,hadoop环境的搭建,下面开始正式的实践,语言以java为主.这一节来看一下HDFS的java操作. 1 环境准备 上一篇说了windows下搭建hadoop环境, ...

- [转]HDFS中JAVA API的使用

HDFS是一个分布式文件系统,既然是文件系统,就可以对其文件进行操作,比如说新建文件.删除文件.读取文件内容等操作.下面记录一下使用JAVA API对HDFS中的文件进行操作的过程. 对分HDFS中的 ...

- Sample: Write And Read data from HDFS with java API

HDFS: hadoop distributed file system 它抽象了整个集群的存储资源,可以存放大文件. 文件采用分块存储复制的设计.块的默认大小是64M. 流式数据访问,一次写入(现支 ...

随机推荐

- SpringBoot+AOP构建多数据源的切换实践

针对微服务架构中常用的设计模块,通常我们都会需要使用到druid作为我们的数据连接池,当架构发生扩展的时候 ,通常面对的数据存储服务器也会渐渐增加,从原本的单库架构逐渐扩展为复杂的多库架构. 当在业务 ...

- js中的堆和栈

http://www.jscwwd.com/article/5e533ae2552a8e2bf45d3d69 这里先说两个概念:1.堆(heap)2.栈(stack)堆 是堆内存的简称.栈 是栈内存的 ...

- Python进阶学习之面向对象

目录 面向对象 私有属性 面向对象 python也有面向对象的编程,它与C++中的类有点相似.它也只是运算符重载,继承. class Test: num=0 def __init__(self): ...

- 微信小程序开发工具报错对应的服务器证书无效

提示错误信息:“对应的服务器证书无效.控制台输入 showRequestInfo() 可以获取更详细信息.” 解决方法:详情 -->项目设置 --> 选择“不校验安全域名.TLS版本以及H ...

- javaScript 基础知识汇总(八)

1.Map Set WeakMap 和WeakSet Map 是一个键值对的集合,主要的方法包括: new Map() 创建Map map.set(key,value) 根据键(key)存储值(va ...

- 蓝桥杯vip 字符串对比

蓝桥杯vip 字符串对比 题目如下 给定两个仅由大写字母或小写字母组成的字符串(长度介于1到10之间),它们之间的关系是以下4中情况之一: 1:两个字符串长度不等.比如 Beijing 和 Hebei ...

- Gorm 预加载及输出处理(三)- 自定义时间格式

前言 Gorm 中 time.Time 类型的字段在 JSON 序列化后呈现的格式为 "2020-03-11T18:26:13+08:00",在 Go 标准库文档 - time 的 ...

- JDK14的新特性-Switch新功能

2020年3月17日,Oracle正式发布了JDK14版本,共新增了16项新特性 本文重点写一下关于switch的新功能: switch 表达式扩展了 switch 语句,使其不仅可以作为语句(sta ...

- 运行docker大致流程

平时部署测试环境使用jenkins将代码打包成docker镜像部署在rancher中,闲下来研究了一下docker的大致流程,自己画了一个流程图

- OpenCV-Python 图像阈值 | 十五

目标 在本教程中,您将学习简单阈值,自适应阈值和Otsu阈值. 你将学习函数cv.threshold和cv.adaptiveThreshold. 简单阈值 在这里,问题直截了当.对于每个像素,应用相同 ...