大数据实操2 - hadoop集群访问——Hadoop客户端访问、Java API访问

上一篇中介绍了hadoop集群搭建方式,本文介绍集群的访问。集群的访问方式有两种:hadoop客户端访问,Java API访问。

一、集群客户端访问

Hadoop采用C/S架构,可以通过客户端对集群进行操作,其实在前面搭建的集群环境中,每个集群节点都可以作为一个客户端进行集群访问,但是一般场景下,会将集群服务器作为整体,从外部设置客户端对集群进行访问。

为了能从集群服务器外部访问,需要一台与集群服务器在同一网段的主机(可以与集群节点Ping通),安装hadoop作为客户端机器,并将该机器与集群服务器配置到同一集群内。

1、安装JDK

2、安装Hadoop

与集群搭建中一样,需要安装hadopp

3、客户端机器配置core-site.xml

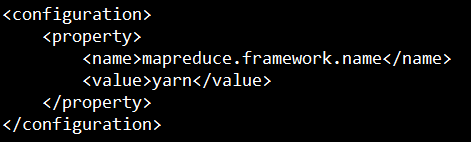

4、客户端机器配置mapred-site.xml

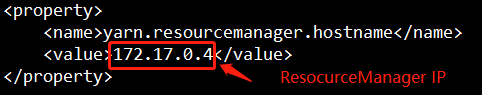

5、客户端机器配置yarn-site.xml

二、网页访问

namenodeIP:50070

sourcemangerIP:8088

三、Java API访问

此种方法通过hadoop提供的API编写客户端程序,从而实现对hadoop的操作。java程序的编写一般是在Windows环境下的,因此需要首先对win环境进行配置。

(一)Win环境配置

1、下载并解压hadoop安装包

这里注意不要放到含有空格的目录下,虽然网上有些解决方案,但是我试了没起作用,放到不含空格的目录下最省事。

2、配置环境变量

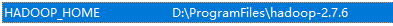

- 增加HADOOP_HOME变量,变量值为你的hadoop目录

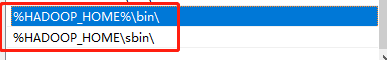

- 配置Path变量,增加内容:

%HADOOP_HOME%\bin\

%HADOOP_HOME\sbin\

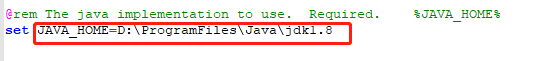

3、配置hadoop中的java home

- 编辑文件,hadoop目录下\etc\hadoop\hadoop-env.cmd

修改其中JAVA_HOME变量,变量值为jdk地址,jdk的地址注意同样不要包含空格,我是把原来的jdk复制一份到了没有空格的目录下。

4、放置文件

下载https://github.com/steveloughran/winutils

其中对应版本bin目录下的winutil.exe放置到你的hadoop目录的bin目录下

hadoop.dll文件放置到C:Windows\System32下

(二)Java程序开发

1、导入jar包

hadoop安装文件夹/share/hadoop路径下为hadoop提供的jar包,按需导入。

2、编程

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.junit.Before;

import org.junit.Test; import java.io.IOException;

import java.net.URI;

import java.net.URISyntaxException; public class HdfsClient { FileSystem fs = null; public static void main(String[] args){

//创建一个配置对象,用于设置集群上的块大小,副本数量等。

Configuration conf = new Configuration();

conf.set("dfs.replication", "2");

conf.set("dfs.blocksize", "64m"); //uri,

//root:指定用户,如果不填写,会默认当前win用户 try {

// 构造一个访问指定HDFS的客户端对象,

// 参数一:HDFS系统的URI,

// 参数二:客户端要配置参数。

// 参数三:客户端用户名

FileSystem fs = FileSystem.get(new URI("hdfs://192.168.1.237:9000/"), conf, "root");

fs.copyFromLocalFile(new Path("I:/[neubt]Friends_搜狐原画版.torrent"), new Path("/home/"));

fs.close(); } catch (URISyntaxException e) {

e.printStackTrace();

} catch (IOException e) {

e.printStackTrace();

} catch (InterruptedException e) {

e.printStackTrace();

} } @Before

public void inint() throws Exception {

URI uri = new URI("hdfs://192.168.1.237:9000/"); Configuration conf = new Configuration();

conf.set("dfs.replication", "2");

conf.set("dfs.blocksize", "64m");

fs = FileSystem.get(new URI("hdfs://192.168.1.237:9000/"), conf, "root"); } /*

从hdfs下载文件

*/

@Test

public void testDownLoad() throws IOException {

Path localPath = new Path("I:/hdfstest/Friends_搜狐原画版.torrent");

System.out.println(localPath); fs.copyToLocalFile(new Path("/home/[neubt]Friends_搜狐原画版.torrent"), localPath);

// fs.copyToLocalFile(new Path("/home/log4j-1.2.17.zip"), new Path("/hdfstest"));

fs.close(); } }

文件的上传未涉及访问本地磁盘,文件下载时则需要调用本地方法来实现对本地磁盘库的访问,本地磁盘库的访问需要调用hadoop提供的C语言库,该库在hadoop的安装文件中提供,因此需要将hadoop安装包中的本地方法添加到环境变量中。

大数据实操2 - hadoop集群访问——Hadoop客户端访问、Java API访问的更多相关文章

- Hadoop集群(四) Hadoop升级

Hadoop前面安装的集群是2.6版本,现在升级到2.7版本. 注意,这个集群上有运行Hbase,所以,升级前后,需要启停Hbase. 更多安装步骤,请参考: Hadoop集群(一) Zookeepe ...

- 在windows远程提交任务给Hadoop集群(Hadoop 2.6)

我使用3台Centos虚拟机搭建了一个Hadoop2.6的集群.希望在windows7上面使用IDEA开发mapreduce程序,然后提交的远程的Hadoop集群上执行.经过不懈的google终于搞定 ...

- hadoop集群启动报错: java.io.IOException: Incompatible clusterIDs

java.io.IOException: Incompatible clusterIDs in /export/hadoop-2.7.5/hadoopDatas/datanodeDatas2: nam ...

- Hadoop集群部署-Hadoop 运行集群后Live Nodes显示0

可以尝试以下步骤解决: 1 ,分别删除:主节点从节点的 /usr/local/hadoop-2.6.2/etc/tmp 下得所有文件; 2: 编辑cd usr/local/hadoop-2.6. ...

- 【hadoop】——window下elicpse连接hadoop集群基础超详细版

1.Hadoop开发环境简介 1.1 Hadoop集群简介 Java版本:jdk-6u31-linux-i586.bin Linux系统:CentOS6.0 Hadoop版本:hadoop-1.0.0 ...

- Ganglia监控Hadoop集群的安装部署[转]

Ganglia监控Hadoop集群的安装部署 一. 安装环境 Ubuntu server 12.04 安装gmetad的机器:192.168.52.105 安装gmond的机 器:192.168.52 ...

- Hadoop集群(第7期)_Eclipse开发环境设置

1.Hadoop开发环境简介 1.1 Hadoop集群简介 Java版本:jdk-6u31-linux-i586.bin Linux系统:CentOS6.0 Hadoop版本:hadoop-1.0.0 ...

- hadoop系列一:hadoop集群安装

转载请在页首明显处注明作者与出处 http://www.cnblogs.com/zhuxiaojie/p/6384393.html 一:说明 此为大数据系列的一些博文,有空的话会陆续更新,包含大数据 ...

- 配置两个Hadoop集群Kerberos认证跨域互信

两个Hadoop集群开启Kerberos验证后,集群间不能够相互访问,需要实现Kerberos之间的互信,使用Hadoop集群A的客户端访问Hadoop集群B的服务(实质上是使用Kerberos Re ...

- Hadoop集群(三) Hbase搭建

前面已经完成Zookeeper和HDFS的安装,本文会详细介绍Hbase的安装步骤.以及安装过程中遇到问题的汇总. 系列文章: Hadoop集群(一) Zookeeper搭建 Hadoop集群(二 ...

随机推荐

- redis 中的key值过期后,触发通知事件

1.创建springboot工程,创建监听类 maven配置 <dependencies> <dependency> <groupId>org.springfram ...

- python之路——26

复习 1.python没有接口类,有抽象类, 通过abc模块 本质是用来做代码规范用的,在子类中实现和父类方法名完全一样的方法2.在java的角度看,是有区别的 java没有多继承,为了接口隔离原则, ...

- 2018.7.3 lnmp一键安装包无人值守版本 php7.2 + nginx1.14.0 + mariadb5.5 + centos7.1(1503) 环境搭建 + Thinkphp5.1.7 配置

给自己练习用的,整个过程追求一个简单粗暴,没有配置虚拟主机,现在记录一下过程. 1. 进入到lnmp解压缩后的文件夹conf/rewrite,把thinkphp.conf复制一份到/usr/local ...

- 生成3位的序列号_仅仅CASE WHEN的简单应用

PNo, , ) AS sn INTO #temp1 FROM tbl_test SELECT ), sn) ), sn) ), sn) END AS sn, PNo FROM #temp1

- Python读取文件内容与存储

Python读取与存储文件内容 一..csv文件 读取: import pandas as pd souce_data = pd.read_csv(File_Path) 其中File_path是文件的 ...

- MapReduce论文学习

MapReduce和区块链有什么相同的地方? 我的天哪,他俩还有相同的地方呢.我书读的少,你别骗我. 他俩还真有相同点,绝不忽悠. 他俩都有一个高大上的名字. 区块链就是一个分布式数据库,并不是什么神 ...

- lucene搜索之高级查询

使用Query子类查询 MatchAllDocsQuery TermQuery NumericRangeQuery BooleanQuery 使用QueryParser QueryParser Mul ...

- (转)Windows下cmd nginx的启动,重启,关闭功能

转自:http://www.cnblogs.com/derekchen/archive/2011/02/17/1957209.html cls @ECHO OFF SET NGINX_PATH=D:\ ...

- Mac 启用NTFS

How to Enable NTFS Write Support in Mac OS X http://osxdaily.com/2013/10/02/enable-ntfs-write-suppor ...

- react 和 seamless-immutable

在 react 中,默认改变组件状态或者属性,是会整个组件全部重新渲染,但是 如果只是修改一个地方,而全部渲染,就会浪费资源,大项目中会造成性能问题 shouldComponentUpdate s ...