Hadoop之简单文件读写

文件简单写操作:

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

public class writeFile {

public static void main(String[] args) {

try{

Configuration conf=new Configuration();

//如果没有把配置文件加入bin文件夹,那么需要加入下面两行

//conf.set("fs.defaultFS","hdfs://localhost:9000" );

//conf.set("fs.hdfs.impl", "org.apache.hadoop.hdfs.DistributedFileSystem");

FileSystem fs =FileSystem.get(conf);

byte[] buffer="Hello world!".getBytes();

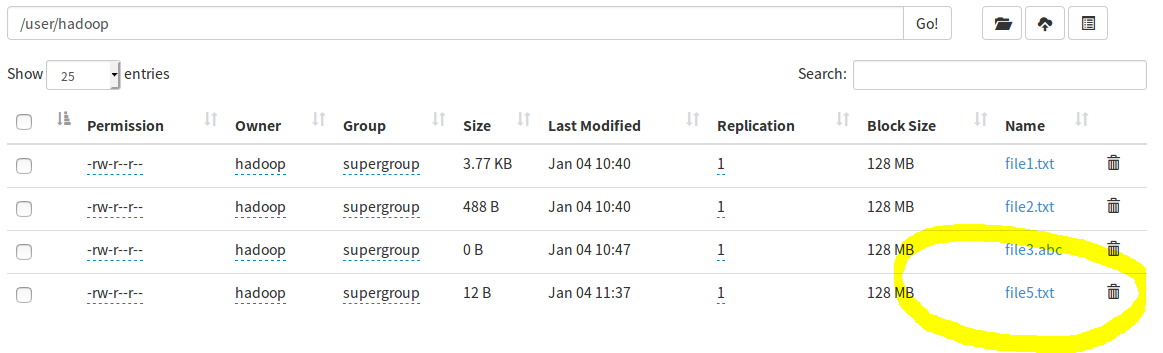

String Filename="hdfs://localhost:9000/user/hadoop/file5.txt"; FSDataOutputStream os=fs.create(new Path(Filename));

os.write(buffer,0,buffer.length); System.out.println("creat "+Filename+" successfully");

os.close();

fs.close();

}

catch(Exception e){

e.printStackTrace();

}

}

}

文件简单读操作:

import java.io.BufferedReader;

import java.io.InputStreamReader; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path; public class readFile {

public static void main(String argsp[]){

try{

Configuration conf = new Configuration();

conf.set("fs.defaultFS","hdfs://localhost:9000" );

conf.set("fs.hdfs.impl", "org.apache.hadoop.hdfs.DistributedFileSystem");

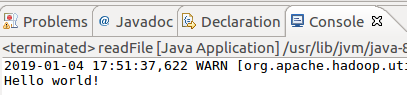

FileSystem fs = FileSystem.get(conf); Path file = new Path("hdfs://localhost:9000/user/hadoop/file5.txt"); FSDataInputStream is = fs.open(file); BufferedReader bd = new BufferedReader(new InputStreamReader(is));

String content = bd.readLine(); System.out.println(content); bd.close();

fs.close();

}

catch(Exception e){

e.printStackTrace();

}

}

}

Hadoop之简单文件读写的更多相关文章

- hadoop笔记-hdfs文件读写

概念 文件系统 磁盘进行读写的最小单位:数据块,文件系统构建于磁盘之上,文件系统的块大小是磁盘块的整数倍. 文件系统块一般为几千字节,磁盘块一般512字节. hdfs的block.pocket.chu ...

- Hadoop之HDFS文件读写过程

一.HDFS读过程 1.1 HDFS API 读文件 Configuration conf = new Configuration(); FileSystem fs = FileSystem.get( ...

- Python——函数,模块,简单文件读写

函数(function)定义原则: 最大化代码重用,最小化代码冗余,流程符合思维逻辑,少用递归; 函数的定义方法: def function_name(param_1, param_2): ..... ...

- Python——函数,模块,简单文件读写(python programming)

函数(function)定义原则: 最大化代码重用,最小化代码冗余,流程符合思维逻辑,少用递归; 函数的定义方法: def function_name(param_1, param_2): ..... ...

- Python简单文件读写

''' 用文件存储账户信息 使用列表存储多个账户信息,每个账户为一个字典对象 ''' users=[] #创建一个空列表 users.append({'id':'admin','pwd':'1235@ ...

- Hadoop的文件读写操作流程

以下主要讲解了Hadoop的文件读写操作流程: 读文件 读文件时内部工作机制参看下图: 客户端通过调用FileSystem对象(对应于HDFS文件系统,调用DistributedFileSystem对 ...

- 大数据【二】HDFS部署及文件读写(包含eclipse hadoop配置)

一 原理阐述 1' DFS 分布式文件系统(即DFS,Distributed File System),指文件系统管理的物理存储资源不一定直接连接在本地节点上,而是通过计算机网络与节点相连.该系统架构 ...

- 【Hadoop】二、HDFS文件读写流程

(二)HDFS数据流 作为一个文件系统,文件的读和写是最基本的需求,这一部分我们来了解客户端是如何与HDFS进行交互的,也就是客户端与HDFS,以及构成HDFS的两类节点(namenode和dat ...

- ios 简单的plist文件读写操作(Document和NSUserDefaults)

最近遇到ios上文件读写操作的有关知识,记录下来,以便以后查阅,同时分享与大家. 一,简单介绍一下常用的plist文件. 全名是:Property List,属性列表文件,它是一种用来存储串行化后的对 ...

随机推荐

- C#在WinForm下使用HttpWebRequest上传文件

转自:http://blog.csdn.net/shihuan10430049/article/details/3734398 这段时间因项目需要,要实现WinForm下的文件上传,个人觉得采用FTP ...

- linux考试题改错

符号链接和硬链接有什么区别? 改:符号链接存储文件路径,可以指向不同分区文件,源文件删除后失效. 改:硬链接指向文件索引节点,仅能指向同一分区文件,源文件删除后可以访问. 请描述文件和目录9位权限位的 ...

- pytorch-MNIST数据模型测试

用pytorch搭建一个DNN网络,主要目的是熟悉pytorch的使用 """ test Function """ import torch ...

- C++11 std::ref使用场景

C++本身有引用(&),为什么C++11又引入了std::ref(或者std::cref)? 主要是考虑函数式编程(如std::bind)在使用时,是对参数直接拷贝,而不是引用.如下例子: # ...

- C++(+类型加强 +加入面向对象)

1.c++中所有变量可以在使用前定义. ; i< ; i++) { ; j< ; j++) { do_sth; } } 2. c++ 中可以获得 register 变量的地址. regis ...

- android 知识汇总

1.assets:不会在R.java文件下生成相应的标记,assets文件夹可以自己创建文件夹,必须使用AssetsManager类进行访问,存放到这里的资源在运行打包的时候都会打入程序安装包中, 2 ...

- (Detected problems with API compatibility(visit g.co/dev/appcompat for more info)

在applicaiton里面加载这么一段代码: private void closeAndroidPDialog(){ try { Class aClass = Class.forName(" ...

- 20165330 2017-2018-2 《Java程序设计》第7周学习总结

课本知识总结 第十一章 JDBC与MySQL数据库 安装XAMPP软件及启动MySQL 下载链接:XAMPP 安装步骤:参考教程xampp新手学习指引(windows示例) 启动MySQL:打开系统c ...

- cocos2dx JS layuot纯代码实现背景颜色渐变

// view._partyBtnClassify.setBackGroundColorType(ccui.Layout.BG_COLOR_GRADIENT);// view._partyBtnCla ...

- Java中 == 和 equals 的问题

== : 它的作用是判断两个对象的地址是不是相等.即,判断两个对象是不是同一个对象.(基本数据类型==比较的是值,引用数据类型==比较的是内存地址) equals() : 它的作用也是判断两个对象是否 ...