Docker部署ELK

这里不采用逐个docker镜像的方式,而是直接使用elk三者聚合在一起的镜像。

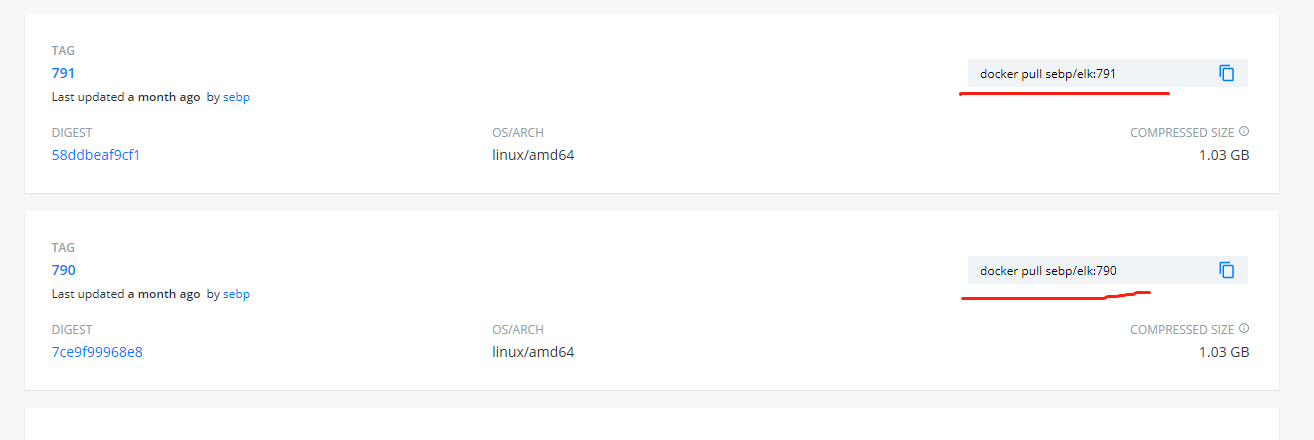

镜像地址:https://hub.docker.com/r/sebp/elk

前提操作:

$ vim /etc/sysctl.conf

vm.max_map_count = 655360

$ sysctl -p

# 拉取镜像

docker pull sebp/elk:792

# 创建挂载目录,用来保存es存储的nodes数据

mkdir -p /opt/elk

# 运行容器

docker run -d -p 5601:5601 -p 9200:9200 -p 5044:5044 -v /opt/elk:/var/lib/elasticsearch -it --name elk sebp/elk:792

# 查看容器

# docker ps root@Test-Linux

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

8b009ec6168d sebp/elk:792 "/usr/local/bin/star…" About a minute ago Up About a minute 0.0.0.0:5044->5044/tcp, 0.0.0.0:5601->5601/tcp, 9300/tcp, 0.0.0.0:9200->9200/tcp, 9600/tcp elk

使用浏览器访问:http://宿主机ip:9200,http://宿主机ip:5601

具体使用:

# 登录进容器中

docker exec -it elk /bin/bash

# 找到elk各组件安装路径

root@8b009ec6168d:~# cd /opt/

root@8b009ec6168d:/opt# ls

elasticsearch kibana logstash

# kibana设置中文界面

root@8b009ec6168d:/# ls /opt/kibana/x-pack/plugins/translations/translations/zh-CN.json

root@8b009ec6168d:/# vim /opt/kibana/config/kibana.yml # 修改或新增配置文件

i18n.locale: "zh-CN"

# 在容器内重启kibana

root@8b009ec6168d:/# service kibana status

* kibana is running

root@8b009ec6168d:/# service kibana restart

* Stopping Kibana5 [ OK ]

* Starting Kibana5

# 参看上一步,其他组件的管理操作

root@8b009ec6168d:/# service elasticsearch status

* elasticsearch is running

root@8b009ec6168d:/# service logstash status

logstash is running

Dockerfile文件

地址:https://hub.docker.com/r/sebp/elk/dockerfile

# Dockerfile for ELK stack

# Elasticsearch, Logstash, Kibana OSS 7.9.2

# Build with:

# docker build -t <repo-user>/elk .

# Run with:

# docker run -p 5601:5601 -p 9200:9200 -p 5044:5044 -it --name elk <repo-user>/elk

# replace with master-arm64 for ARM64

ARG IMAGE=18.04-1.0.0

FROM phusion/baseimage:${IMAGE}

MAINTAINER Sebastien Pujadas http://pujadas.net

ENV \

REFRESHED_AT=2020-06-20

###############################################################################

# INSTALLATION

###############################################################################

### install prerequisites (cURL, gosu, tzdata, JDK for Logstash)

RUN set -x \

&& apt update -qq \

&& apt install -qqy --no-install-recommends ca-certificates curl gosu tzdata openjdk-11-jdk-headless \

&& apt clean \

&& rm -rf /var/lib/apt/lists/* \

&& gosu nobody true \

&& set +x

### set current package version

ARG ELK_VERSION=oss-7.9.2

# replace with aarch64 for ARM64 systems

ARG ARCH=x86_64

### install Elasticsearch

# predefine env vars, as you can't define an env var that references another one in the same block

ENV \

ES_VERSION=${ELK_VERSION} \

ES_HOME=/opt/elasticsearch

ENV \

ES_PACKAGE=elasticsearch-${ES_VERSION}-linux-${ARCH}.tar.gz \

ES_GID=991 \

ES_UID=991 \

ES_PATH_CONF=/etc/elasticsearch \

ES_PATH_BACKUP=/var/backups \

KIBANA_VERSION=${ELK_VERSION}

RUN DEBIAN_FRONTEND=noninteractive \

&& mkdir ${ES_HOME} \

&& curl -O https://artifacts.elastic.co/downloads/elasticsearch/${ES_PACKAGE} \

&& tar xzf ${ES_PACKAGE} -C ${ES_HOME} --strip-components=1 \

&& rm -f ${ES_PACKAGE} \

&& groupadd -r elasticsearch -g ${ES_GID} \

&& useradd -r -s /usr/sbin/nologin -M -c "Elasticsearch service user" -u ${ES_UID} -g elasticsearch elasticsearch \

&& mkdir -p /var/log/elasticsearch ${ES_PATH_CONF} ${ES_PATH_CONF}/scripts /var/lib/elasticsearch ${ES_PATH_BACKUP} \

&& chown -R elasticsearch:elasticsearch ${ES_HOME} /var/log/elasticsearch /var/lib/elasticsearch ${ES_PATH_CONF} ${ES_PATH_BACKUP}

### install Logstash

ENV \

LOGSTASH_VERSION=${ELK_VERSION} \

LOGSTASH_HOME=/opt/logstash

ENV \

LOGSTASH_PACKAGE=logstash-${LOGSTASH_VERSION}.tar.gz \

LOGSTASH_GID=992 \

LOGSTASH_UID=992 \

LOGSTASH_PATH_CONF=/etc/logstash \

LOGSTASH_PATH_SETTINGS=${LOGSTASH_HOME}/config

RUN mkdir ${LOGSTASH_HOME} \

&& curl -O https://artifacts.elastic.co/downloads/logstash/${LOGSTASH_PACKAGE} \

&& tar xzf ${LOGSTASH_PACKAGE} -C ${LOGSTASH_HOME} --strip-components=1 \

&& rm -f ${LOGSTASH_PACKAGE} \

&& groupadd -r logstash -g ${LOGSTASH_GID} \

&& useradd -r -s /usr/sbin/nologin -d ${LOGSTASH_HOME} -c "Logstash service user" -u ${LOGSTASH_UID} -g logstash logstash \

&& mkdir -p /var/log/logstash ${LOGSTASH_PATH_CONF}/conf.d \

&& chown -R logstash:logstash ${LOGSTASH_HOME} /var/log/logstash ${LOGSTASH_PATH_CONF}

### install Kibana

ENV \

KIBANA_HOME=/opt/kibana \

KIBANA_PACKAGE=kibana-${KIBANA_VERSION}-linux-${ARCH}.tar.gz \

KIBANA_GID=993 \

KIBANA_UID=993

RUN mkdir ${KIBANA_HOME} \

&& curl -O https://artifacts.elastic.co/downloads/kibana/${KIBANA_PACKAGE} \

&& tar xzf ${KIBANA_PACKAGE} -C ${KIBANA_HOME} --strip-components=1 \

&& rm -f ${KIBANA_PACKAGE} \

&& groupadd -r kibana -g ${KIBANA_GID} \

&& useradd -r -s /usr/sbin/nologin -d ${KIBANA_HOME} -c "Kibana service user" -u ${KIBANA_UID} -g kibana kibana \

&& mkdir -p /var/log/kibana \

&& chown -R kibana:kibana ${KIBANA_HOME} /var/log/kibana

###############################################################################

# START-UP SCRIPTS

###############################################################################

### Elasticsearch

ADD ./elasticsearch-init /etc/init.d/elasticsearch

RUN sed -i -e 's#^ES_HOME=$#ES_HOME='$ES_HOME'#' /etc/init.d/elasticsearch \

&& chmod +x /etc/init.d/elasticsearch

### Logstash

ADD ./logstash-init /etc/init.d/logstash

RUN sed -i -e 's#^LS_HOME=$#LS_HOME='$LOGSTASH_HOME'#' /etc/init.d/logstash \

&& chmod +x /etc/init.d/logstash

### Kibana

ADD ./kibana-init /etc/init.d/kibana

RUN sed -i -e 's#^KIBANA_HOME=$#KIBANA_HOME='$KIBANA_HOME'#' /etc/init.d/kibana \

&& chmod +x /etc/init.d/kibana

###############################################################################

# CONFIGURATION

###############################################################################

### configure Elasticsearch

ADD ./elasticsearch.yml ${ES_PATH_CONF}/elasticsearch.yml

ADD ./elasticsearch-default /etc/default/elasticsearch

RUN cp ${ES_HOME}/config/log4j2.properties ${ES_HOME}/config/jvm.options \

${ES_PATH_CONF} \

&& chown -R elasticsearch:elasticsearch ${ES_PATH_CONF} \

&& chmod -R +r ${ES_PATH_CONF}

### configure Logstash

# certs/keys for Beats and Lumberjack input

RUN mkdir -p /etc/pki/tls/{certs,private}

ADD ./logstash-beats.crt /etc/pki/tls/certs/logstash-beats.crt

ADD ./logstash-beats.key /etc/pki/tls/private/logstash-beats.key

# pipelines

ADD pipelines.yml ${LOGSTASH_PATH_SETTINGS}/pipelines.yml

# filters

ADD ./logstash-conf/*.conf ${LOGSTASH_PATH_CONF}/conf.d/

# patterns

ADD ./nginx.pattern ${LOGSTASH_HOME}/patterns/nginx

RUN chown -R logstash:logstash ${LOGSTASH_HOME}/patterns

# Fix permissions

RUN chmod -R +r ${LOGSTASH_PATH_CONF} ${LOGSTASH_PATH_SETTINGS} \

&& chown -R logstash:logstash ${LOGSTASH_PATH_SETTINGS}

### configure logrotate

ADD ./elasticsearch-logrotate /etc/logrotate.d/elasticsearch

ADD ./logstash-logrotate /etc/logrotate.d/logstash

ADD ./kibana-logrotate /etc/logrotate.d/kibana

RUN chmod 644 /etc/logrotate.d/elasticsearch \

&& chmod 644 /etc/logrotate.d/logstash \

&& chmod 644 /etc/logrotate.d/kibana

### configure Kibana

ADD ./kibana.yml ${KIBANA_HOME}/config/kibana.yml

###############################################################################

# START

###############################################################################

ADD ./start.sh /usr/local/bin/start.sh

RUN chmod +x /usr/local/bin/start.sh

EXPOSE 5601 9200 9300 9600 5044

VOLUME /var/lib/elasticsearch

CMD [ "/usr/local/bin/start.sh" ]

Docker部署ELK的更多相关文章

- Docker 部署 elk + filebeat

Docker 部署 elk + filebeat kibana 开源的分析与可视化平台logstash 日志收集工具 logstash-forwarder(原名lubmberjack)elastics ...

- Docker 部署ELK之Sentinl日志报警

前篇文章简单介绍了Docker 部署ELK,以及使用filebeat收集java日志.这篇我们介绍下日志报警配置,这里我们使用Sentinl插件. 1.修改kibana参数 进入elk容器,修改对应参 ...

- 利用docker部署elk交换机日志分析

今天我们来聊一下利用docker部署elk日志分析系统,这里解析一下elk是啥东西.elk分别是Elasticsearch,Logstash和Kibana的首字母缩写. Elasticsearch是一 ...

- 被一位读者赶超,手摸手 Docker 部署 ELK Stack

被一位读者赶超,容器化部署 ELK Stack 你好,我是悟空. 被奇幻"催更" 最近有个读者,他叫"老王",外号"茴香豆泡酒",找我崔更 ...

- Docker 部署ELK

1.安装docker前安装pip sudo yum -y install epel-release sudo yum install python-pip 2.安装docker #安装依赖包 yum ...

- Linux实战(20):非docker部署ELK

部署环境: Elasticsearch:7.5.2 Kibana:7.5.2 Logstash:7.5.2 filebeat:7.5.2 redis:最新版 部署方式:rpm+二进制包 使用架构 软件 ...

- Docker部署ELK之部署filebeat7.6.0(3)

1. filebeat介绍 Filebeat是用于转发和集中日志数据的轻量级传送工具.Filebeat监视您指定的日志文件或位置,收集日志事件,并将它们转发到Elasticsearch或 Logsta ...

- docker部署ELK日志处理

docker环境下部署的ELK系统,日志处理,保留最近五个小时的日志 dockerlog.sh #!/bin/bash logs=`find /var/lib/docker/containers/ - ...

- Docker部署ELK 日志归集

ELK ELK是Elasticsearch.Logstash.Kibana的缩写,使用ELK的原因是因为公司使用Spring cloud部署了多个微服务,不同的微服务有不同的日志文件,当生产上出现问题 ...

- Docker部署ELK 7.0.1集群之Logstash安装介绍

1.下载镜像 [root@vanje-dev01 ~]# docker pull logstash: 2.安装部署 2.1 创建宿主映射目录 [root@vanje-dev01 ~]# mkdir ...

随机推荐

- 或许是 WebGIS 下一代的数据规范 - OGC API 系列

目录 1. 前言 1.1. 经典的 OGC 标准回顾 1.2. 共同特点与时代变化 1.3. 免责声明 2. 什么是 OGC API 2.1. OGC API 是一个开放.动态的规范族 2.2. OG ...

- 【学习笔记】带你从0开始学习 01Trie

01Trie Section 1:普通 Trie Section 1.1 什么是 Trie Trie 树,即字典树,是一种树形结构.典型应用是用于统计和排序大量的字符串前缀来减少查询时间,最大限度地减 ...

- 【docker专栏7】容器自启动与守护进程停止后容器保活

本文为大家介绍容器自启动以及docker 守护进程挂掉或者docker升级的情况下,如何保证容器服务的正常运行.主要包含三个部分 一.守护进程开机自启 在我们安装docker的时候,介绍过启动dock ...

- python主动杀死线程

简介 在一些项目中,为了防止影响主进程都会在执行一些耗时动作时采取多线程的方式,但是在开启线程后往往我们会需要快速的停止某个线程的动作,因此就需要进行强杀线程,下面将介绍两种杀死线程的方式. 直接强杀 ...

- qbxt五一数学Day2

目录 1. 判断素数(素性测试) 1. \(O(\sqrt n)\) 试除 2. Miller-Rabin 素性测试 * 欧拉函数 2. 逆元 3. exgcd(扩展欧几里得) 4. 离散对数(BSG ...

- 15分钟搭建RocketMQ源码调试环境

下载源码 下载源码,github页面选择(rocketmq-all-4.7.1)版本压缩包,https://github.com/apache/rocketmq/tags 导入IDEA 1. 使用ID ...

- 2510-Druid监控功能的深入使用与配置-基于SpringBoot-完全使用java config的形式

环境 springboot 1.5.9.RELEASE + JDK1.8 配置步骤 分两步,1 配置数据源 2 配置监控 直接上代码 1 配置数据源 package com.company.proje ...

- 后端Python3+Flask结合Socket.io配合前端Vue2.0实现简单全双工在线客服系统

原文转载自「刘悦的技术博客」https://v3u.cn/a_id_158 在之前的一篇文章中:为美多商城(Django2.0.4)添加基于websocket的实时通信,主动推送,聊天室及客服系统,详 ...

- 说起分布式自增ID只知道UUID?SnowFlake(雪花)算法了解一下(Python3.0实现)

原文转载自「刘悦的技术博客」https://v3u.cn/a_id_155 但凡说起分布式系统,我们肯定会对一些海量级的业务进行分拆,比如:用户表,订单表.因为数据量巨大一张表完全无法支撑,就会对其进 ...

- ARC129E Yet Another Minimization 题解 【网络流笔记】

超神的建模,极其有借鉴意义/cy 注:该建模对应于最小割建模 对于 \(n\) 个数,每个数有 \(m\) 种取值的技巧 \(\forall i=1,2,\dots,n\),令 \(S=V_{i,0} ...