二次排序问题(分别使用Hadoop和Spark实现)

不多说,直接上干货!

这篇博客里的算法部分的内容来自《数据算法:Hadoop/Spark大数据处理技巧》一书,不过书中的代码虽然思路正确,但是代码不完整,并且只有java部分的编程,我在它的基础上又加入scala部分,当然是在使用Spark的时候写的scala。

一、输入、期望输出、思路。

输入为SecondarySort.txt,内容为:

,,,

,,,

,,,-

,,,

,,,-

,,,

,,,-

,,,

,,,

,,,

,,,

,,,

,,,-

意义为:年,月,日,温度

期望输出:

- ,,-

- ,,,,-

- ,-

- ,,-

意义为:

年-月 温度1,温度2,温度3,……

年-月从上之下降序排列,

温度从左到右降序排列

思路:

抛弃不需要的代表日的哪一行数据

将年月作为组合键(key),比较大小,降序排列

将对应年月(key)的温度的值(value)进行降序排列和拼接

二、使用Java编写MapReduce程序实现二次排序

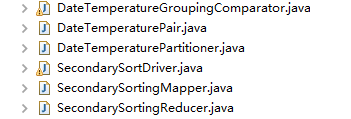

代码要实现的类有:

除了常见的SecondarySortingMapper,SecondarySortingReducer,和SecondarySortDriver以外

这里还多出了两个个插件类(DateTemperatureGroupingComparator和DateTemperaturePartioner)和一个自定义类型(DateTemperaturePair)

以下是实现的代码(注意以下每个文件的代码段我去掉了包名,所以要使用的话自己加上吧):

SecondarySortDriver.java

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.conf.Configured;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.Tool;

import org.apache.hadoop.util.ToolRunner; public class SecondarySortDriver extends Configured implements Tool {

public int run(String[] args) throws Exception {

Configuration configuration = getConf();

Job job = Job.getInstance(configuration, "SecondarySort");

job.setJarByClass(SecondarySortDriver.class);

job.setJobName("SecondarySort"); Path inputPath = new Path(args[]);

Path outputPath = new Path(args[]);

FileInputFormat.setInputPaths(job, inputPath);

FileOutputFormat.setOutputPath(job, outputPath); // 设置map输出key value格式

job.setMapOutputKeyClass(DateTemperaturePair.class);

job.setMapOutputValueClass(IntWritable.class);

// 设置reduce输出key value格式

job.setOutputKeyClass(DateTemperaturePair.class);

job.setOutputValueClass(IntWritable.class); job.setMapperClass(SecondarySortingMapper.class);

job.setReducerClass(SecondarySortingReducer.class);

job.setPartitionerClass(DateTemperaturePartitioner.class);

job.setGroupingComparatorClass(DateTemperatureGroupingComparator.class); boolean status = job.waitForCompletion(true);

return status ? : ;

} public static void main(String[] args) throws Exception {

if (args.length != ) {

throw new IllegalArgumentException(

"!!!!!!!!!!!!!! Usage!!!!!!!!!!!!!!: SecondarySortDriver"

+ "<input-path> <output-path>");

}

int returnStatus = ToolRunner.run(new SecondarySortDriver(), args);

System.exit(returnStatus);

}

}

DateTemperaturePair.java

import org.apache.hadoop.io.Text;

import org.apache.hadoop.io.Writable;

import org.apache.hadoop.io.WritableComparable; import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException; public class DateTemperaturePair implements Writable,

WritableComparable<DateTemperaturePair> {

private String yearMonth;

private String day;

protected Integer temperature; public int compareTo(DateTemperaturePair o) {

int compareValue = this.yearMonth.compareTo(o.getYearMonth());

if (compareValue == ) {

compareValue = temperature.compareTo(o.getTemperature());

}

return - * compareValue;

} public void write(DataOutput dataOutput) throws IOException {

Text.writeString(dataOutput, yearMonth);

dataOutput.writeInt(temperature); } public void readFields(DataInput dataInput) throws IOException {

this.yearMonth = Text.readString(dataInput);

this.temperature = dataInput.readInt(); } @Override

public String toString() {

return yearMonth.toString();

} public String getYearMonth() {

return yearMonth;

} public void setYearMonth(String text) {

this.yearMonth = text;

} public String getDay() {

return day;

} public void setDay(String day) {

this.day = day;

} public Integer getTemperature() {

return temperature;

} public void setTemperature(Integer temperature) {

this.temperature = temperature;

}

}

SecondarySortingMapper.java

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper; import java.io.IOException; public class SecondarySortingMapper extends

Mapper<LongWritable, Text, DateTemperaturePair, IntWritable> {

@Override

protected void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

String[] tokens = value.toString().split(",");

// YYYY = tokens[0]

// MM = tokens[1]

// DD = tokens[2]

// temperature = tokens[3]

String yearMonth = tokens[] + "-" + tokens[];

String day = tokens[];

int temperature = Integer.parseInt(tokens[]); DateTemperaturePair reduceKey = new DateTemperaturePair();

reduceKey.setYearMonth(yearMonth);

reduceKey.setDay(day);

reduceKey.setTemperature(temperature);

context.write(reduceKey, new IntWritable(temperature));

}

}

DateTemperaturePartioner.java

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Partitioner; public class DateTemperaturePartitioner extends

Partitioner<DateTemperaturePair, Text> {

@Override

public int getPartition(DateTemperaturePair dataTemperaturePair, Text text,

int i) {

return Math.abs(dataTemperaturePair.getYearMonth().hashCode() % i);

}

}

DateTemperatureGroupingComparator.java

import org.apache.hadoop.io.WritableComparable;

import org.apache.hadoop.io.WritableComparator; public class DateTemperatureGroupingComparator extends WritableComparator { public DateTemperatureGroupingComparator() {

super(DateTemperaturePair.class, true);

} @Override

public int compare(WritableComparable a, WritableComparable b) {

DateTemperaturePair pair1 = (DateTemperaturePair) a;

DateTemperaturePair pair2 = (DateTemperaturePair) b;

return pair1.getYearMonth().compareTo(pair2.getYearMonth());

}

}

SecondarySortingReducer.java

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer; import java.io.IOException; public class SecondarySortingReducer extends

Reducer<DateTemperaturePair, IntWritable, DateTemperaturePair, Text> { @Override

protected void reduce(DateTemperaturePair key,

Iterable<IntWritable> values, Context context) throws IOException,

InterruptedException {

StringBuilder sortedTemperatureList = new StringBuilder();

for (IntWritable temperature : values) {

sortedTemperatureList.append(temperature);

sortedTemperatureList.append(",");

}

sortedTemperatureList.deleteCharAt(sortedTemperatureList.length()-);

context.write(key, new Text(sortedTemperatureList.toString()));

} }

三、使用scala编写Spark程序实现二次排序

这个代码想必就比较简洁了。如下:

SecondarySort.scala

package spark

import org.apache.spark.{SparkContext, SparkConf}

import org.apache.spark.rdd.RDD.rddToOrderedRDDFunctions

import org.apache.spark.rdd.RDD.rddToPairRDDFunctions object SecondarySort {

def main(args: Array[String]) {

val conf = new SparkConf().setAppName(" Secondary Sort ")

.setMaster("local")

var sc = new SparkContext(conf)

sc.setLogLevel("Warn")

//val file = sc.textFile("hdfs://localhost:9000/Spark/SecondarySort/Input/SecondarySort2.txt")

val file = sc.textFile("e:\\SecondarySort.txt")

val rdd = file.map(line => line.split(","))

.map(x=>((x(),x()),x())).groupByKey().sortByKey(false)

.map(x => (x._1._1+"-"+x._1._2,x._2.toList.sortWith(_>_)))

rdd.foreach(

x=>{

val buf = new StringBuilder()

for(a <- x._2){

buf.append(a)

buf.append(",")

}

buf.deleteCharAt(buf.length()-)

println(x._1+" "+buf.toString())

})

sc.stop()

}

}

二次排序问题(分别使用Hadoop和Spark实现)的更多相关文章

- 数据算法 --hadoop/spark数据处理技巧 --(1.二次排序问题 2. TopN问题)

一.二次排序问题. MR/hadoop两种方案: 1.让reducer读取和缓存给个定键的所有值(例如,缓存到一个数组数据结构中,)然后对这些值完成一个reducer中排序.这种方法不具有可伸缩性,因 ...

- Ubuntu14.04或16.04下Hadoop及Spark的开发配置

对于Hadoop和Spark的开发,最常用的还是Eclipse以及Intellij IDEA. 其中,Eclipse是免费开源的,基于Eclipse集成更多框架配置的还有MyEclipse.Intel ...

- 成都大数据Hadoop与Spark技术培训班

成都大数据Hadoop与Spark技术培训班 中国信息化培训中心特推出了大数据技术架构及应用实战课程培训班,通过专业的大数据Hadoop与Spark技术架构体系与业界真实案例来全面提升大数据工程师 ...

- hadoop+hive+spark搭建(一)

1.准备三台虚拟机 2.hadoop+hive+spark+java软件包 传送门:Hadoop官网 Hive官网 Spark官网 一.修改主机名,hosts文件 主机名修改 hostnam ...

- 剖析Hadoop和Spark的Shuffle过程差异

一.前言 对于基于MapReduce编程范式的分布式计算来说,本质上而言,就是在计算数据的交.并.差.聚合.排序等过程.而分布式计算分而治之的思想,让每个节点只计算部分数据,也就是只处理一个分片,那么 ...

- 学Hadoop还是Spark好?

JS 相信看这篇文章的你们,都和我一样对Hadoop和Apache Spark的选择有一定的疑惑,今天查了不少资料,我们就来谈谈这两种 平台的比较与选择吧,看看对于工作和发展,到底哪个更好. 一.Ha ...

- 剖析Hadoop和Spark的Shuffle过程差异(一)

一.前言 对于基于MapReduce编程范式的分布式计算来说,本质上而言,就是在计算数据的交.并.差.聚合.排序等过程.而分布式计算分而治之的思想,让每个节点只计算部分数据,也就是只处理一个分片,那么 ...

- H01-Linux系统中搭建Hadoop和Spark集群

前言 1.操作系统:Centos7 2.安装时使用的是root用户.也可以用其他非root用户,非root的话要注意操作时的权限问题. 3.安装的Hadoop版本是2.6.5,Spark版本是2.2. ...

- 深度:Hadoop对Spark五大维度正面比拼!

每年,市场上都会出现种种不同的数据管理规模.类型与速度表现的分布式系统.在这些系统中,Spark和hadoop是获得最大关注的两个.然而该怎么判断哪一款适合你? 如果想批处理流量数据,并将其导入HDF ...

- 常见的七种Hadoop和Spark项目案例

常见的七种Hadoop和Spark项目案例 有一句古老的格言是这样说的,如果你向某人提供你的全部支持和金融支持去做一些不同的和创新的事情,他们最终却会做别人正在做的事情.如比较火爆的Hadoop.Sp ...

随机推荐

- dubbo之上下文信息

上下文信息 上下文中存放的是当前调用过程中所需的环境信息.所有配置信息都将转换为 URL 的参数,参见 schema 配置参考手册 中的对应URL参数一列. RpcContext 是一个 Thread ...

- Python 爬虫的代理 IP 设置方法汇总

本文转载自:Python 爬虫的代理 IP 设置方法汇总 https://www.makcyun.top/web_scraping_withpython15.html 需要学习的地方:如何在爬虫中使用 ...

- node源码详解(五)

本作品采用知识共享署名 4.0 国际许可协议进行许可.转载保留声明头部与原文链接https://luzeshu.com/blog/nodesource5 本博客同步在https://cnodejs.o ...

- C++判断质数

using namespace std; bool isPrimeNum(int n) { if(n<2) return true; for(int i=2;i*i<=n;i++) { i ...

- Java代码规范和一些常见问题

本文中的代码规范,是Java标准代码规范中的一小部分,在我看来,是最重要的一部分. 理想目标:不需要写注释,不需要和别人介绍,别人就知道你的项目大致是做什么的,每个类大概实现了什么功能. ...

- dancing links 题集转自夏天的风

POJ3740 Easy Finding [精确覆盖基础题] HUST1017 Exact cover [精确覆盖基础] HDOJ3663 Power Stations [精确覆盖] Z ...

- 小记——Grub Rescue恢复

下面我要讲的是一个悲伤的故事 引子 电脑状况简介:两块硬盘(1HHD.1SSD),SSD上装了LINUX(40G)+WIN10(50G)的双系统,SSD剩余部分在WIN下使用装程序,HHD做仓库.LI ...

- 【ACM】hdu_zs2_1004_Problem D _201308030856

Problem D Time Limit : 2000/1000ms (Java/Other) Memory Limit : 65536/32768K (Java/Other)Total Subm ...

- Java循环遍历中直接修改遍历对象

Java 循环遍历中直接修改遍历对象如下,会报异常: for (ShopBaseInfo sp: sourceList) { if(sp.getId()==5){ sourceList.remove( ...

- 允许远程访问MySQL的设置

允许远程访问MySQL的设置 学习了:http://www.cnblogs.com/hyzhou/archive/2011/12/06/2278236.html Windows版本有workbench ...