PyTorch Tutorials 4 训练一个分类器

%matplotlib inline

训练一个分类器

上一讲中已经看到如何去定义一个神经网络,计算损失值和更新网络的权重。

你现在可能在想下一步。

关于数据?

一般情况下处理图像、文本、音频和视频数据时,可以使用标准的Python包来加载数据到一个numpy数组中。

然后把这个数组转换成 torch.*Tensor。

- 图像可以使用 Pillow, OpenCV

- 音频可以使用 scipy, librosa

- 文本可以使用原始Python和Cython来加载,或者使用 NLTK或

SpaCy 处理

特别的,对于图像任务,我们创建了一个包

torchvision,它包含了处理一些基本图像数据集的方法。这些数据集包括

Imagenet, CIFAR10, MNIST 等。除了数据加载以外,torchvision 还包含了图像转换器,

torchvision.datasets 和 torch.utils.data.DataLoader。

torchvision包不仅提供了巨大的便利,也避免了代码的重复。

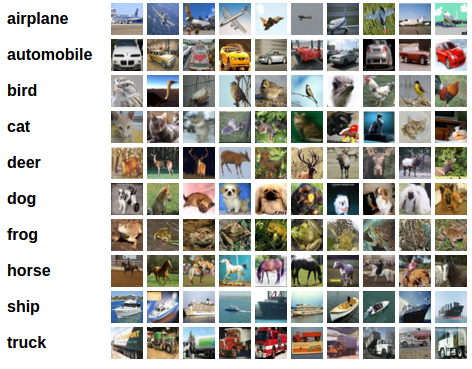

在这个教程中,我们使用CIFAR10数据集,它有如下10个类别

:‘airplane’, ‘automobile’, ‘bird’, ‘cat’, ‘deer’,

‘dog’, ‘frog’, ‘horse’, ‘ship’, ‘truck’。CIFAR-10的图像都是

3x32x32大小的,即,3颜色通道,32x32像素。

训练一个图像分类器

依次按照下列顺序进行:

使用

torchvision加载和归一化CIFAR10训练集和测试集定义一个卷积神经网络

定义损失函数

在训练集上训练网络

在测试集上测试网络

读取和归一化 CIFAR10

使用torchvision可以非常容易地加载CIFAR10。

import torch

import torchvision

import torchvision.transforms as transforms

torchvision的输出是[0,1]的PILImage图像,我们把它转换为归一化范围为[-1, 1]的张量。

transform = transforms.Compose(

[transforms.ToTensor(),

transforms.Normalize((0.5, 0.5, 0.5), (0.5, 0.5, 0.5))])

trainset = torchvision.datasets.CIFAR10(root='./data',

train=True,

download=True,

transform=transform)

trainloader = torch.utils.data.DataLoader(trainset,

batch_size=4,

shuffle=True,

num_workers=2)

testset = torchvision.datasets.CIFAR10(root='./data',

train=False,

download=True,

transform=transform)

testloader = torch.utils.data.DataLoader(testset,

batch_size=4,

shuffle=False,

num_workers=2)

classes = ('plane', 'car', 'bird', 'cat', 'deer', 'dog', 'frog', 'horse', 'ship', 'truck')

Downloading https://www.cs.toronto.edu/~kriz/cifar-10-python.tar.gz to ./data\cifar-10-python.tar.gz

100%|███████████████████████████████████████████████████████████████▉| 170483712/170498071 [30:34<00:00, 144484.30it/s]

Files already downloaded and verified

170500096it [30:50, 144484.30it/s]

我们展示一些训练图像。

import matplotlib.pyplot as plt

import numpy as np

# 展示图像的函数

def imshow(img):

img = img / 2 + 0.5 # unnormalize

npimg = img.numpy()

plt.imshow(np.transpose(npimg, (1, 2, 0)))

# 获取随机数据

dataiter = iter(trainloader)

images, labels = dataiter.next()

# 展示图像

imshow(torchvision.utils.make_grid(images))

# 显示图像标签

print(' '.join('%5s' % classes[labels[j]] for j in range(4)))

ship dog dog plane

- 定义一个卷积神经网络

从之前的神经网络一节复制神经网络代码,并修改为输入3通道图像。

import torch.nn as nn

import torch.nn.functional as F

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.conv1 = nn.Conv2d(3, 6, 5)

self.pool = nn.MaxPool2d(2, 2)

self.conv2 = nn.Conv2d(6, 16, 5)

self.fc1 = nn.Linear(16 * 5 * 5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10)

def forward(self, x):

x = self.pool(F.relu(self.conv1(x)))

x = self.pool(F.relu(self.conv2(x)))

x = x.view(-1, 16 * 5 * 5)

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

x = self.fc3(x)

return x

net = Net()

- 定义损失函数和优化器

我们使用交叉熵作为损失函数,使用带动量的随机梯度下降。

import torch.optim as optim

criterion = nn.CrossEntropyLoss()

optimizer = optim.SGD(net.parameters(), lr=0.001, momentum=0.9)

- 训练网路

有趣的时刻开始了。

我们只需在数据迭代器上循环,将数据输入给网络,并优化。

for epoch in range(2): # 多批次循环

running_loss = 0.0

for i, data in enumerate(trainloader, 0):

# 获取输入

inputs, labels = data

# 梯度置0

optimizer.zero_grad()

# 正向传播,反向传播,优化

outputs = net(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

# 打印状态信息

running_loss += loss.item()

if i % 2000 == 1999: # 每2000批次打印一次

print('[%d, %5d] loss: %.3f' %

(epoch + 1, i + 1, running_loss / 2000))

running_loss = 0.0

print('Finished Training')

[1, 2000] loss: 2.168

[1, 4000] loss: 1.848

[1, 6000] loss: 1.663

[1, 8000] loss: 1.573

[1, 10000] loss: 1.529

[1, 12000] loss: 1.458

[2, 2000] loss: 1.412

[2, 4000] loss: 1.390

[2, 6000] loss: 1.352

[2, 8000] loss: 1.317

[2, 10000] loss: 1.306

[2, 12000] loss: 1.299

Finished Training

- 在测试集上测试网络

我们在整个训练集上进行了2次训练,但是我们需要检查网络是否从数据集中学习到有用的东西。

通过预测神经网络输出的类别标签与实际情况标签进行对比来进行检测。

如果预测正确,我们把该样本添加到正确预测列表。

第一步,显示测试集中的图片并熟悉图片内容。

dataiter = iter(testloader)

images, labels = dataiter.next()

# 显示图片

imshow(torchvision.utils.make_grid(images))

print('GroundTruth: ', ' '.join('%5s' % classes[labels[j]] for j in range(4)))

GroundTruth: cat ship ship plane

让我们看看神经网络认为以上图片是什么。

outputs = net(images)

输出是10个标签的能量。

一个类别的能量越大,神经网络越认为它是这个类别。所以让我们得到最高能量的标签。

_, predicted = torch.max(outputs, 1)

print('Predicted: ', ' '.join('%5s' % classes[predicted[j]]

for j in range(4)))

Predicted: cat ship ship ship

结果看来不错。

接下来让看看网络在整个测试集上的结果如何。

correct = 0

total = 0

with torch.no_grad():

for data in testloader:

images, labels = data

outputs = net(images)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print('Accuracy of the network on the 10000 test images: %d %%' % (

100 * correct / total))

Accuracy of the network on the 10000 test images: 53 %

结果看起来不错,至少比随机选择要好,随机选择的正确率为10%。

似乎网络学习到了一些东西。

在识别哪一个类的时候好,哪一个不好呢?

class_correct = list(0. for i in range(10))

class_total = list(0. for i in range(10))

with torch.no_grad():

for data in testloader:

images, labels = data

outputs = net(images)

_, predicted = torch.max(outputs, 1)

c = (predicted == labels).squeeze()

for i in range(4):

label = labels[i]

class_correct[label] += c[i].item()

class_total[label] += 1

for i in range(10):

print('Accuracy of %5s : %2d %%' % (

classes[i], 100 * class_correct[i] / class_total[i]))

Accuracy of plane : 46 %

Accuracy of car : 61 %

Accuracy of bird : 33 %

Accuracy of cat : 39 %

Accuracy of deer : 43 %

Accuracy of dog : 54 %

Accuracy of frog : 76 %

Accuracy of horse : 47 %

Accuracy of ship : 75 %

Accuracy of truck : 60 %

下一步?

我们如何在GPU上运行神经网络呢?

在GPU上训练

把一个神经网络移动到GPU上训练就像把一个Tensor转换GPU上一样简单。并且这个操作会递归遍历有所模块,并将其参数和缓冲区转换为CUDA张量。

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

# 确认我们的电脑支持CUDA,然后显示CUDA信息:

print(device)

本节的其余部分假定device是CUDA设备。

然后这些方法将递归遍历所有模块并将模块的参数和缓冲区

转换成CUDA张量:

net.to(device)

记住:inputs 和 targets 也要转换。

inputs, labels = inputs.to(device), labels.to(device)

为什么我们没注意到GPU的速度提升很多?那是因为网络非常的小。

实践:

尝试增加你的网络的宽度(第一个nn.Conv2d的第2个参数,第二个nn.Conv2d的第一个参数,它们需要是相同的数字),看看你得到了什么样的加速。

实现的目标:

- 深入了解了PyTorch的张量库和神经网络

- 训练了一个小网络来分类图片

译者注:后面我们教程会训练一个真正的网络,使识别率达到90%以上。

多GPU训练

如果你想使用所有的GPU得到更大的加速,

请查看数据并行处理。

下一步?

- :doc:

训练神经网络玩电子游戏 </intermediate/reinforcement_q_learning> 在ImageNet上训练最好的ResNet使用对抗生成网络来训练一个人脸生成器使用LSTM网络训练一个字符级的语言模型更多示例更多教程在论坛上讨论PyTorchSlack上与其他用户讨论

PyTorch Tutorials 4 训练一个分类器的更多相关文章

- 【PyTorch深度学习60分钟快速入门 】Part4:训练一个分类器

太棒啦!到目前为止,你已经了解了如何定义神经网络.计算损失,以及更新网络权重.不过,现在你可能会思考以下几个方面: 0x01 数据集 通常,当你需要处理图像.文本.音频或视频数据时,你可以使用标准 ...

- 使用weka训练一个分类器

1 训练集数据 1.1 csv格式 5.1,3.5,1.4,0.2,Iris-setosa 4.9,3.0,1.4,0.2,Iris-setosa 4.7,3.2,1.3,0.2,Iris-setos ...

- 训练一个图像分类器demo in PyTorch【学习笔记】

[学习源]Tutorials > Deep Learning with PyTorch: A 60 Minute Blitz > Training a Classifier 本文相当于 ...

- Fine-tuning Convolutional Neural Networks for Biomedical Image Analysis: Actively and Incrementally如何使用尽可能少的标注数据来训练一个效果有潜力的分类器

作者:AI研习社链接:https://www.zhihu.com/question/57523080/answer/236301363来源:知乎著作权归作者所有.商业转载请联系作者获得授权,非商业转载 ...

- 迁移学习算法之TrAdaBoost ——本质上是在用不同分布的训练数据,训练出一个分类器

迁移学习算法之TrAdaBoost from: https://blog.csdn.net/Augster/article/details/53039489 TradaBoost算法由来已久,具体算法 ...

- Pytorch多GPU训练

Pytorch多GPU训练 临近放假, 服务器上的GPU好多空闲, 博主顺便研究了一下如何用多卡同时训练 原理 多卡训练的基本过程 首先把模型加载到一个主设备 把模型只读复制到多个设备 把大的batc ...

- 自己训练SVM分类器进行HOG行人检测

正样本来源是INRIA数据集中的96*160大小的人体图片,使用时上下左右都去掉16个像素,截取中间的64*128大小的人体. 负样本是从不包含人体的图片中随机裁取的,大小同样是64*128(从完全不 ...

- PyTorch Tutorials 3 Neural Networks

%matplotlib inline Neural Networks 使用torch.nn包来构建神经网络. 上一讲已经讲过了autograd,nn包依赖autograd包来定义模型并求导. 一个nn ...

- pytorch 多GPU训练总结(DataParallel的使用)

版权声明:本文为博主原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明.本文链接:https://blog.csdn.net/weixin_40087578/artic ...

随机推荐

- GitHub开源的10个超棒后台管理面板

目录1.AdminLTE 2.vue-Element-Admin 3.tabler 4.Gentelella 5.ng2-admin 6.ant-design-pro 7.blur-admin 8.i ...

- 【OF框架】在Azure DevOps中配置项目持续集成CI服务,推送镜像到Azure容器注册表

准备工作 开通Azure账号,具有开通服务权限,关键是里面要有钱. 开通Azure DevOps,能够创建组织和项目. 具备一定的DevOps知识,了解CICD概念.Docker基本操作. 一.创建& ...

- HDU 6187 Destroy Walls (思维,最大生成树)

HDU 6187 Destroy Walls (思维,最大生成树) Destroy Walls *Time Limit: 8000/4000 MS (Java/Others) Memory Limit ...

- k8s的监控

监控 1.资源指标和资源监控 一个集群系统管理离不开监控,同样的Kubernetes也需要根据数据指标来采集相关数据,从而完成对集群系统的监控状况进行监测.这些指标总体上分为两个组成:监控集群本身和监 ...

- 【邻接矩阵+基础BFS】PAT-L3-008. 喊山

L3-008. 喊山 一个山头呼喊的声音可以被临近的山头同时听到.题目假设每个山头最多有两个能听到它的临近山头.给定任意一个发出原始信号的山头,本题请你找出这个信号最远能传达到的地方.[何为最远?大致 ...

- git 将master分支合到自己的开发分支

背景: 一般开发自己的分支都是从最新的master上拉取,但中间master会有改动,此时需要将最新的master合到自己的分支中 命令: 1. 查看当前的分支,星号标识为当前分支:(如果查询结果有m ...

- 在 windows 上安装 git 2.15

下载 by win 下载地址:https://git-scm.com/download/win 如下图.选择对应的版本下载: 安装 by win 1.双击下载好的git安装包.弹出提示框.如下图: 2 ...

- MVC框架和MTV框架

MVC,全名是Model View Controller,是软件工程中的一种软件架构模式,把软件系统分为三个基本部分:模型(Model).视图(View)和控制器(Controller),具有耦合性低 ...

- keil mdk 菜单 “project” 崩溃问题解决

今天发现我的 Keil MDK5.28z win10系统上面,点击 Project 菜单立即崩溃.网上找到了解决方法 简单粗暴的处理方法:重装keil ,但是依然点击 project 崩溃. 通过搜索 ...

- 2019牛客暑期多校训练营(第十场)Coffee Chicken——递归

题意 $S(1) = "COFFEE", S(2)="CHICKEN"$,$S(n) = S(n-2)+S(n-1)$,请输出 $S(n)$ 中从第 $k$ 个 ...