44.scrapy爬取链家网站二手房信息-2

全面采集二手房数据: 网站二手房总数据量为27650条,但有的参数字段会出现一些问题,因为只给返回100页数据,具体查看就需要去细分请求url参数去请求网站数据。

我这里大概的获取了一下筛选条件参数,一些存在问题也没做细化处理,大致的采集数据量为21096,实际19794条。 看一下执行完成结果:

{'downloader/exception_count': 199,

'downloader/exception_type_count/twisted.internet.error.NoRouteError': 192,

'downloader/exception_type_count/twisted.web._newclient.ResponseNeverReceived': 7,

'downloader/request_bytes': 9878800,

'downloader/request_count': 21096,

'downloader/request_method_count/GET': 21096,

'downloader/response_bytes': 677177525,

'downloader/response_count': 20897,

'downloader/response_status_count/200': 20832,

'downloader/response_status_count/301': 49,

'downloader/response_status_count/302': 11,

'downloader/response_status_count/404': 5,

'dupefilter/filtered': 53,

'finish_reason': 'finished',

'finish_time': datetime.datetime(2018, 11, 12, 8, 49, 42, 371235),

'httperror/response_ignored_count': 5,

'httperror/response_ignored_status_count/404': 5,

'log_count/DEBUG': 21098,

'log_count/ERROR': 298,

'log_count/INFO': 61,

'request_depth_max': 3,

'response_received_count': 20837,

'retry/count': 199,

'retry/reason_count/twisted.internet.error.NoRouteError': 192,

'retry/reason_count/twisted.web._newclient.ResponseNeverReceived': 7,

'scheduler/dequeued': 21096,

'scheduler/dequeued/memory': 21096,

'scheduler/enqueued': 21096,

'scheduler/enqueued/memory': 21096,

'spider_exceptions/TypeError': 298,

'start_time': datetime.datetime(2018, 11, 12, 7, 59, 52, 608383)}

2018-11-12 16:49:42 [scrapy.core.engine] INFO: Spider closed (finished)

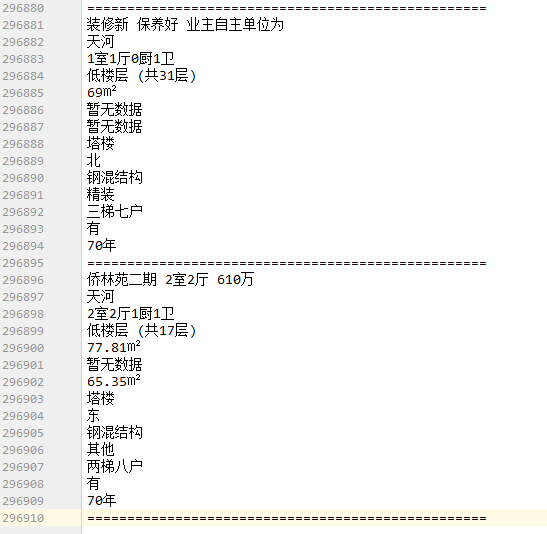

采集数据如图:

num = 296910/15=19794条

2. lianjia.py # -*- coding: utf-8 -*-

import scrapy class LianjiaSpider(scrapy.Spider):

name = 'lianjia'

allowed_domains = ['gz.lianjia.com']

start_urls = ['https://gz.lianjia.com/ershoufang/pg1/']

def parse(self, response):

for i in range(1,8):

for j in range(1,8):

url = 'https://gz.lianjia.com/ershoufang/p{}a{}pg1'.format(i,j)

yield scrapy.Request(url=url,callback=self.parse_detail) def parse_detail(self,response):

# 符合筛选条件的个数

counts = response.xpath("//h2[@class='total fl']/span/text()").extract_first().strip()

# print(counts) if int(counts)%30 >0:

p_num = int(counts)//30+1

# print(p_num)

# 拼接首页url

for k in range(1,p_num+1):

url = response.url

link_url = url.split('pg')[0]+'pg{}/'.format(k)

# print(link_url)

yield scrapy.Request(url=link_url,callback=self.parse_detail2) def parse_detail2(self,response):

#获取当前页面url

link_urls = response.xpath("//div[@class='info clear']/div[@class='title']/a/@href").extract()

for link_url in link_urls:

# print(link_url)

yield scrapy.Request(url=link_url,callback=self.parse_detail3)

# print('*'*100) def parse_detail3(self,response):

title = response.xpath("//div[@class='title']/h1[@class='main']/text()").extract_first()

print('标题: '+ title)

dist = response.xpath("//div[@class='areaName']/span[@class='info']/a/text()").extract_first()

print('所在区域: '+ dist)

contents = response.xpath("//div[@class='introContent']/div[@class='base']")

# print(contents)

house_type = contents.xpath("./div[@class='content']/ul/li[1]/text()").extract_first()

print('房屋户型: '+ house_type)

floor = contents.xpath("./div[@class='content']/ul/li[2]/text()").extract_first()

print('所在楼层: '+ floor)

built_area = contents.xpath("./div[@class='content']/ul/li[3]/text()").extract_first()

print('建筑面积: '+ built_area)

family_structure = contents.xpath("./div[@class='content']/ul/li[4]/text()").extract_first()

print('户型结构: '+ family_structure)

inner_area = contents.xpath("./div[@class='content']/ul/li[5]/text()").extract_first()

print('套内面积: '+ inner_area)

architectural_type = contents.xpath("./div[@class='content']/ul/li[6]/text()").extract_first()

print('建筑类型: '+ architectural_type)

house_orientation = contents.xpath("./div[@class='content']/ul/li[7]/text()").extract_first()

print('房屋朝向: '+ house_orientation)

building_structure = contents.xpath("./div[@class='content']/ul/li[8]/text()").extract_first()

print('建筑结构: '+ building_structure)

decoration_condition = contents.xpath("./div[@class='content']/ul/li[9]/text()").extract_first()

print('装修状况: '+ decoration_condition)

proportion = contents.xpath("./div[@class='content']/ul/li[10]/text()").extract_first()

print('梯户比例: '+ proportion)

elevator = contents.xpath("./div[@class='content']/ul/li[11]/text()").extract_first()

print('配备电梯: '+ elevator)

age_limit =contents.xpath("./div[@class='content']/ul/li[12]/text()").extract_first()

print('产权年限: '+ age_limit)

# try:

# house_label = response.xpath("//div[@class='content']/a/text()").extract_first()

# except:

# house_label = ''

# print('房源标签: ' + house_label)

with open('text2', 'a', encoding='utf-8')as f:

f.write('\n'.join(

[title,dist,house_type,floor,built_area,family_structure,inner_area,architectural_type,house_orientation,building_structure,decoration_condition,proportion,elevator,age_limit]))

f.write('\n' + '=' * 50 + '\n')

print('-'*100)

3.代码还需要细分的话,就多配置url的请求参数,缩小筛选范围,获取页面就更精准,就能避免筛选到过3000的数据类型,可以再去细分。

44.scrapy爬取链家网站二手房信息-2的更多相关文章

- 43.scrapy爬取链家网站二手房信息-1

首先分析:目的:采集链家网站二手房数据1.先分析一下二手房主界面信息,显示情况如下: url = https://gz.lianjia.com/ershoufang/pg1/显示总数据量为27589套 ...

- Python——Scrapy爬取链家网站所有房源信息

用scrapy爬取链家全国以上房源分类的信息: 路径: items.py # -*- coding: utf-8 -*- # Define here the models for your scrap ...

- python - 爬虫入门练习 爬取链家网二手房信息

import requests from bs4 import BeautifulSoup import sqlite3 conn = sqlite3.connect("test.db&qu ...

- python爬虫:利用BeautifulSoup爬取链家深圳二手房首页的详细信息

1.问题描述: 爬取链家深圳二手房的详细信息,并将爬取的数据存储到Excel表 2.思路分析: 发送请求--获取数据--解析数据--存储数据 1.目标网址:https://sz.lianjia.com ...

- Python的scrapy之爬取链家网房价信息并保存到本地

因为有在北京租房的打算,于是上网浏览了一下链家网站的房价,想将他们爬取下来,并保存到本地. 先看链家网的源码..房价信息 都保存在 ul 下的li 里面 爬虫结构: 其中封装了一个数据库处理模 ...

- Python爬取链家二手房源信息

爬取链家网站二手房房源信息,第一次做,仅供参考,要用scrapy. import scrapy,pypinyin,requests import bs4 from ..items import L ...

- python3 爬虫教学之爬取链家二手房(最下面源码) //以更新源码

前言 作为一只小白,刚进入Python爬虫领域,今天尝试一下爬取链家的二手房,之前已经爬取了房天下的了,看看链家有什么不同,马上开始. 一.分析观察爬取网站结构 这里以广州链家二手房为例:http:/ ...

- Scrapy实战篇(一)之爬取链家网成交房源数据(上)

今天,我们就以链家网南京地区为例,来学习爬取链家网的成交房源数据. 这里推荐使用火狐浏览器,并且安装firebug和firepath两款插件,你会发现,这两款插件会给我们后续的数据提取带来很大的方便. ...

- python爬虫:爬取链家深圳全部二手房的详细信息

1.问题描述: 爬取链家深圳全部二手房的详细信息,并将爬取的数据存储到CSV文件中 2.思路分析: (1)目标网址:https://sz.lianjia.com/ershoufang/ (2)代码结构 ...

随机推荐

- MMU实验

内存管理单元 MMU介绍:权限管理:地址映射 权限管理:内核->A->B 地址空间各不相同 地址映射:多任务系统也是分时系统 虚拟地址(地址空间)->MMU->物理地址 SDR ...

- Linux系统构成和基本操作

Linux的优势 Linux的目录结构 Linux目录与文件管理 列出目录内容 创建新目录(文件夹) 创建文件 复制文件或目录 删除文件或目录 移动目录或文件 查看文件属性 文件属性含义 读权限-4 ...

- Java Collection - 003 高效的找出两个List中的不同元素

如题:有List<String> list1和List<String> list2,两个集合各有上万个元素,怎样取出两个集合中不同的元素? 方法1:遍历两个集合 public ...

- CAD二次开发中浮动面板不浮动的问题

CAD二次开发中创建了一个浮动面板,想让它创建出来后以浮动状态显示, 但是DockSides.None设置完后,面板还是不浮动.搞了很久,最后原来是 需要先设置Visible,再设置DockSides ...

- 黄聪:Jquery+DataTables插件,如何在ajax调用服务器数据后,自动给tr添加id属性

http://legacy.datatables.net/usage/callbacks#fnRowCallback 主要通过 fnCreatedRow 事件来实现 var table = $('#t ...

- Hadoop错误集:Could not find the main class: org.apache.hadoop.*

在搭建Hadoop机群的时候,之前遇见了很多次找不到类的错误,因为对Hadoop了解不深,所以就在网上漫无目的的找解决方案,所以这里总结下我用的方法. 解决办法一: 我之前遇到了找不到 org.apa ...

- 使用Selenium模拟浏览器抓取斗鱼直播间信息

获取斗鱼直播间每个房间的名称.观看人数.tag.主播名字 代码: import time from multiprocessing import Pool from selenium import w ...

- java浅析final关键字

谈到final关键字,想必很多人都不陌生,在使用匿名内部类的时候可能会经常用到final关键字.另外,Java中的String类就是一个final类,那么今天我们就来了解final这个关键字的用法. ...

- HTML5绘制饼图示例(一)

原文地址:http://www.2cto.com/kf/201108/100251.html HTML5引入Canvas元素,用于图形的绘制,我们可以仅仅基于HTML和JavaScript就能绘制出原 ...

- SqlServer全表遍历

DECLARE @temp TABLE ( , ) , ) ) DECLARE @tempId INT , ) INSERT INTO @temp VALUES ( 'a' ) INSERT INTO ...