在线学习和在线凸优化(online learning and online convex optimization)—在线分类问题2

紧接上文,我们讲述在线分类问题

令,

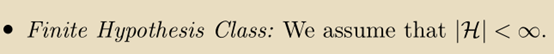

为0-1损失,我们做出如下的简化假设:

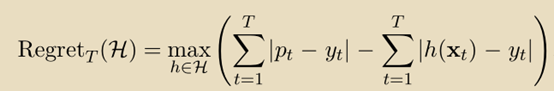

学习者的目标是相对于hypotheses set: H具有low regret,其中H中的每个函数是从到{0,1}的映射,并且regret被定义为:

我们首先证明这是一个不可能完成的任务——如果,没有算法可以获得次线性regret bound。考虑

,

是一个总是返0的函数,

是一个总是返1的函数。通过简单地等待学习者的预测然后提供相反的答案作为真实答案,攻击者可以使任何在线算法的错误数等于T。相反,对于任何真实答案序列,令b为

中的大多数标签,则

的错误数最多为T/2。因此,任何在线算法的regret可能至少是T-T/2 =T/2,这不是T的次线性。

为了回避Cover’s impossibility result,我们进一步限制对抗环境的能力。下面展示两种方法。

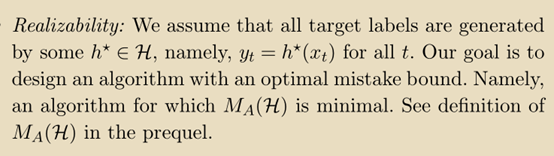

第一种方法是增加额外的一个假设:

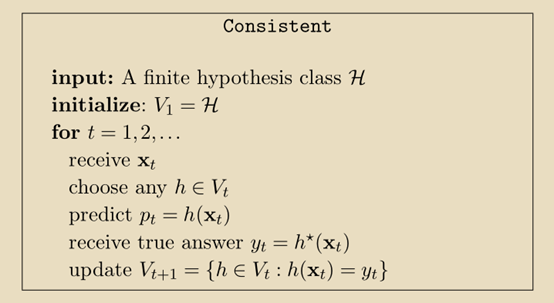

接下来,我们描述和分析在线学习算法,假设有限假设类(Finite Hypothesis Class)和输入序列的可实现性(realizability)。最自然的学习规则是使用(在任何在线回合)任何与过去所有例子一致的假设。

Consistent 算法维持一个与一致的所有假设的集合

。此集合通常称为version space。然后它从中选择任何假设并根据该假设进行预测。

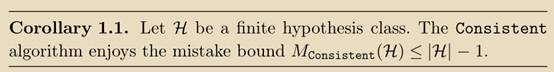

Consistent 算法的mistake bound:

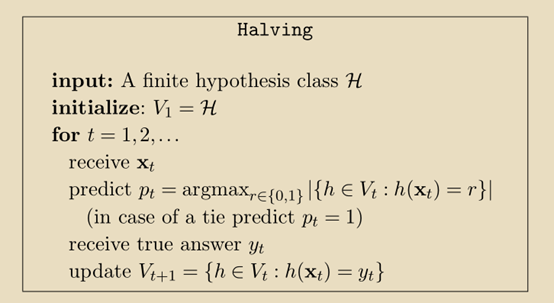

Halving算法:

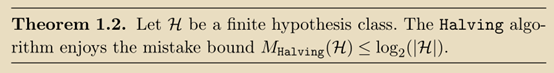

Having算法的mistake bound:

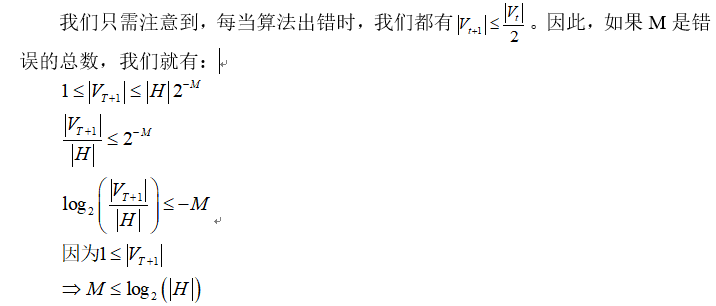

证明:

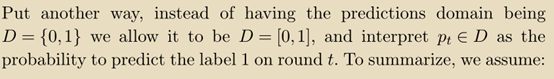

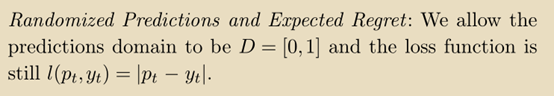

第二种方法是随机化(Randomization):

如果学习机输出 (

(),则它在t回合上的期望损失是:

对predictions domain做改变,此时predictions domain不等于target domain:

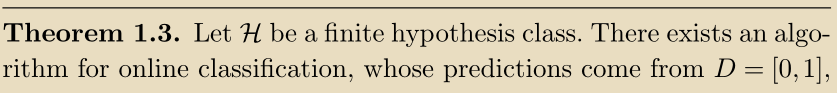

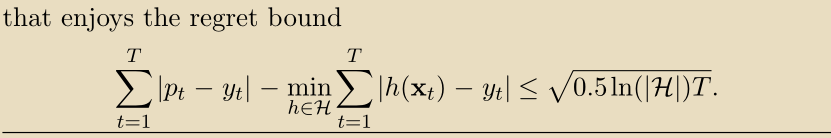

根据这个假设,可以推导出如下定理中所述的low regret算法:

我们已经提出了两种不同的方法来回避Cover’s impossibility result: realizability 和 randomization。这两种方法似乎有些不同。然而,有一个深层的基本概念将它们连接起来。事实上,我们将证明这两种方法都可以解释为凸化技术。凸性是推导在线学习算法的中心主题,我们在下一节中进行研究。

未完,待续。。。。。。

下一节分析在线凸优化技术。

在线学习和在线凸优化(online learning and online convex optimization)—在线分类问题2的更多相关文章

- 在线学习和在线凸优化(online learning and online convex optimization)—FTL算法5

最自然的学习规则是使用任何在过去回合中损失最小的向量. 这与Consistent算法的精神相同,它在在线凸优化中通常被称为Follow-The-Leader,最小化累积损失. 对于任何t: 我们谈到了 ...

- 在线学习和在线凸优化(online learning and online convex optimization)—在线凸优化框架3

近年来,许多有效的在线学习算法的设计受到凸优化工具的影响. 此外,据观察,大多数先前提出的有效算法可以基于以下优雅模型联合分析: 凸集的定义: 一个向量 的Regret定义为: 如前所述,算法相对于竞 ...

- 在线学习和在线凸优化(online learning and online convex optimization)—基础介绍1

开启一个在线学习和在线凸优化框架专题学习: 1.首先介绍在线学习的相关概念 在线学习是在一系列连续的回合(rounds)中进行的: 在回合,学习机(learner)被给一个question:(一个向量 ...

- 在线学习和在线凸优化(online learning and online convex optimization)—凸化方法4

一些在线预测问题可以转化到在线凸优化框架中.下面介绍两种凸化技术: 一些在线预测问题似乎不适合在线凸优化框架.例如,在线分类问题中,预测域(predictions domain)或损失函数不是凸的.我 ...

- 在线学习和在线凸优化(online learning and online convex optimization)—FTRL算法6

- Alink漫谈(十三) :在线学习算法FTRL 之 具体实现

Alink漫谈(十三) :在线学习算法FTRL 之 具体实现 目录 Alink漫谈(十三) :在线学习算法FTRL 之 具体实现 0x00 摘要 0x01 回顾 0x02 在线训练 2.1 预置模型 ...

- K12(在线学习的平台)

项目:K12(在线学习的平台) 一.背景 目的是做一个在线的学习平台,提高学生的课程完成度 K12:大目标是要取代线下班 - 录制专门的视频 - 导师的监管:如果没有主动和那个学生聊天,就扣钱 - 学 ...

- 在线学习--online learning

在线学习 online learning Online learning并不是一种模型,而是模型的训练方法.能够根据线上反馈数据,实时快速的进行模型调优,使得模型能够及时反映线上的变化,提高线上预测的 ...

- 各大公司广泛使用的在线学习算法FTRL详解

各大公司广泛使用的在线学习算法FTRL详解 现在做在线学习和CTR常常会用到逻辑回归( Logistic Regression),而传统的批量(batch)算法无法有效地处理超大规模的数据集和在线数据 ...

随机推荐

- C++中的继承和多继承

一.学习笔记 1.继承 class Student : public Person { ... } 2.继承时权限派生类中可以直接访问父类的protected成员,但是不能访问其private成员,若 ...

- Bat相关的项目应用

原 bat 命令如何启动远程PC上的一个程序? 原 bat 自动解压缩,发布asp.net程序 原 bat 自动更新代码,编译,压缩asp.net程序 原 bat自动备份压缩文件 原 bat命令ora ...

- MySQL 学习资料

MySQL 学习资料: MySQL 学习资料 网址 MySQL 教程(菜鸟教程) http://www.runoob.com/mysql/mysql-tutorial.html MySQL 教程(极客 ...

- 使用 localeCompare 函数对中文进行排序

localeCompare 函数可对中文进行排序. 性能相关 当比较大量字符串时, 比如比较大量数组时, 最好创建一个Intl.Collator 对象并使用compare 属性所提供的函数. mdn介 ...

- sqoop上传数据到hdfs,并用hive管理数据。

sqoop导入mysql数据表到HDFS中sqoop import --connect jdbc:mysql://master:3306/test --username root --password ...

- pycharm加载多个项目

菜单位置:File -> Settings -> Project:xxx -> Project Stucture Project:xxx中xxx一般是已有项目的名称 窗口右侧上点击A ...

- Linux paste命令详解

Linux paste命令 Linux paste命令用于合并文件的列.paste指令会把每个文件以列对列的方式,一列列地加以合并 将每个指定文件里的每一行整合到对应一行里写到标准输出,之间用制表符分 ...

- linux od命令详解

Linux od命令 Linux od命令用于输出文件内容.od指令会读取所给予的文件的内容,并将其内容以八进制字码呈现出来 将指定文件以八进制形式(默认)转储到标准输出.如果指定了多于一个的文件参数 ...

- PageBaseType属性的功用

在web.config中经常能看到如下类似语句:<pages theme="Default" pageBaseType="VS.Facade.PageBase, ...

- tomcat端口号被占用的问题

错误原因:8080端口被其他的应用占用! 在网上查了下解决方案,有些说在任务管理窗口关闭javaw.exe,有些说shutdown一下tomcat,亲测在某些场合下可用. 下面是摘自其它博客园里文章的 ...