Large Margin Softmax Loss for Speaker Verification

【INTERSPEECH 2019接收】

链接:https://arxiv.org/pdf/1904.03479.pdf

这篇文章在会议的speaker session中。本文主要讨论了说话人验证中的损失函数large margin softmax loss(结合了softmax和margins的losses)。

本文从x-vector中提取speaker embedding。

这篇文章在一个公式中统一了多种margin项:

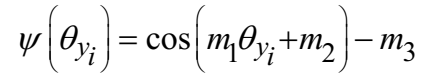

其中N表示训练样本数目,C表示训练集中的说话人数目,s是尺度因子。m1, m2, m3是可以分开使用的margins,则角函数定义为:

并引入两种辅助损失:Ring Loss[1]来约束embedding模值;MHE[2]使weight尽可能在超球面中均匀分布,从而提升类间可分性。

在VoCeleb数据集上运行实验。训练集包括VoxCeleb1 dev part and VoxCeleb2,验证集为VoxCeleb1 test part。训练过程中,特征采用30维的MFCCs(经过谱均值归一化)。采用基于能量的VAD方法。

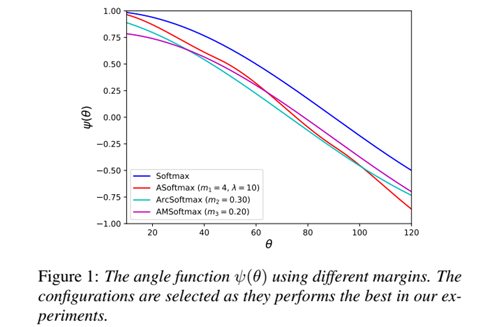

三种margins单独使用,分别得到losses为:angular softmax (ASoftmax), additive angular margin softmax (ArcSoftmax) and additive margin softmax loss (AMSoftmax)。见图1:

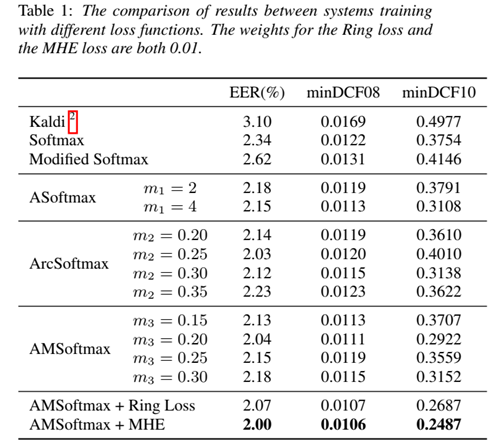

实验表明采用AMSoftmax的性能最佳。见表1,该研究在Kaldi recipe for VoxCeleb的基础上得到了EER 2%的显著性能提升:

深度学习为说话人技术带来了前所未有的机遇,而研究者们在不断拓展新算法的边界的同时,也在回顾传统方法仍然具备的价值。当然说话人技术目前也逐渐暴露出与人脸识别同样的易受攻击的问题。因此,ASVspoof这样的Challenge从2015年起就开始关注声纹反作弊问题。

[1] Ring loss,一种简单的深层网络特征归一化方法,用于增强诸如Softmax之类的标准损失函数。论文(Ring loss: Convex Feature Normalization for Face Recognition)被CVPR 2018接收。

[2] 最小化超球面能量准则(Minimum Hyperspherical Energy

criterion),具体见论文Learning towards Minimum Hyperspherical

Energy(NIPS 2018接收)。

Large Margin Softmax Loss for Speaker Verification的更多相关文章

- 基于Caffe的Large Margin Softmax Loss的实现(中)

小喵的唠叨话:前一篇博客,我们做完了L-Softmax的准备工作.而这一章,我们开始进行前馈的研究. 小喵博客: http://miaoerduo.com 博客原文: http://www.miao ...

- 基于Caffe的Large Margin Softmax Loss的实现(上)

小喵的唠叨话:在写完上一次的博客之后,已经过去了2个月的时间,小喵在此期间,做了大量的实验工作,最终在使用的DeepID2的方法之后,取得了很不错的结果.这次呢,主要讲述一个比较新的论文中的方法,L- ...

- cosface: large margin cosine loss for deep face recognition

目录 概 主要内容 Wang H, Wang Y, Zhou Z, et al. CosFace: Large Margin Cosine Loss for Deep Face Recognition ...

- Generalized end-to-end loss for speaker verification

论文题目:2018_说话人验证的广义端到端损失 论文代码:https://google.github.io/speaker-id/publications/GE2E/ 地址:https://www.c ...

- Large-Margin Softmax Loss for Convolutional Neural Networks

paper url: https://arxiv.org/pdf/1612.02295 year:2017 Introduction 交叉熵损失与softmax一起使用可以说是CNN中最常用的监督组件 ...

- 损失函数 hinge loss vs softmax loss

1. 损失函数 损失函数(Loss function)是用来估量你模型的预测值 f(x) 与真实值 Y 的不一致程度,它是一个非负实值函数,通常用 L(Y,f(x)) 来表示. 损失函数越小,模型的鲁 ...

- Derivative of Softmax Loss Function

Derivative of Softmax Loss Function A softmax classifier: \[ p_j = \frac{\exp{o_j}}{\sum_{k}\exp{o_k ...

- 卷积神经网络系列之softmax,softmax loss和cross entropy的讲解

我们知道卷积神经网络(CNN)在图像领域的应用已经非常广泛了,一般一个CNN网络主要包含卷积层,池化层(pooling),全连接层,损失层等.虽然现在已经开源了很多深度学习框架(比如MxNet,Caf ...

- softmax,softmax loss和cross entropy的区别

版权声明:本文为博主原创文章,未经博主允许不得转载. https://blog.csdn.net/u014380165/article/details/77284921 我们知道卷积神经网络(CNN ...

随机推荐

- JavaScript查找两个数组的相同元素和相差元素

let intersection = a.filter(v => b.includes(v)) 返回交集数组 let difference = a.concat(b).filter(v => ...

- RoadMap:如何创建产品路线图

(1)什么是Roadmap? RoadMap/产品路线图 Roadmap通常翻译为“路线图”或“蓝图”,目前并没有一个公认的定义.在这里,我们认为Roadmap是产品经理进行产品管理的一个中长期规划, ...

- locally weighted regression - CS229

欠拟合和过拟合 看下方的三张图 第一幅拟合为了 y=θ0+θ1xy=θ0+θ1x 的一次函数 第二幅拟合为了y=θ0+θ1x+θ2x2y=θ0+θ1x+θ2x2 的二次函数 第三幅拟合为了 y=∑5j ...

- NimSystem实现

题目 题目比较长,我直接放截图吧 简述 一个比较经典的类与对象的题目,三个类实现了一个比较简单的系统,具体的每个类的要求可以从上面的题目描述中看出(只要你有耐心读完..),不再赘述,代码如下 代码实现 ...

- Oracle 查询(SELECT)语句(一)

Ø 简介 本文介绍 Oracle 中查询(SELECT)语句的使用,在 SQL 中 SELECT 语句是相对内容较多的,也是相对比较复杂一点的,所以这里拿出来单独学习. 首先,我们先来理一下思路,我 ...

- Oracle 原生驱动带来的精度问题的分析与解决

问题 Oracle 官方提供了 dotnet core 驱动,但我们在使用中遇到了精度问题. 复现 以下代码运行数学运算 1/3,无论是 OracleCommand.ExecuteScalar() 还 ...

- Java自学-集合框架 HashMap

Java集合框架 HashMap 示例 1 : HashMap的键值对 HashMap储存数据的方式是-- 键值对 package collection; import java.util.HashM ...

- 解决eclipse打开文件乱码

解决办法 需要设置的几处地方为: Window->Preferences->General ->Content Type->Text->JSP 最下面设置为UTF-8 W ...

- FCC-学习笔记 Sorted Union

FCC-学习笔记 Sorted Union 1>最近在学习和练习FCC的题目.这个真的比较的好,推荐给大家. 2>中文版的地址:https://www.freecodecamp.cn/; ...

- Mysql Join-连接查询(上)

认识 多表连接查询,我感觉应该是关系型数据库最能体现其价值和灵活性的地方吧. 我觉得数据库的作用, 归纳起来无非就是存储和查询. 一言蔽之,数据库就是能灵活地存储和查询数据. 存储上, 也是以文件的方 ...