关于hadoop的运行的一些指标监控(非cdh平台的)

在hadoop-env.sh中添加:

# 在配置namenode和datanode时都会有用到JMX_OPTS的代码,是为了减少重复提取出的公共代码

export JMX_OPTS="-Dcom.sun.management.jmxremote -Dcom.sun.management.jmxremote.authenticate=false -Dcom.sun.management.jmxremote.ssl=false -Dcom.sun.management.jmxremote.port"

# 在源hadoop-env.sh中存在$JMX_OPTS之前的代码,JMX_OPTS=8006表示设置jmx的端口

export HADOOP_NAMENODE_OPTS="-Dhadoop.security.logger=${HADOOP_SECURITY_LOGGER:-INFO,RFAS} -Dhdfs.audit.logger=${HDFS_AUDIT_LOGGER:-INFO,NullAppender} $HADOOP_NAMENODE_OPTS $JMX_OPTS=8006"

export HADOOP_DATANODE_OPTS="-Dhadoop.security.logger=ERROR,RFAS $HADOOP_DATANODE_OPTS $JMX_OPTS=8007"

export HADOOP_SECONDARYNAMENODE_OPTS="-Dhadoop.security.logger=${HADOOP_SECURITY_LOGGER:-INFO,RFAS} -Dhdfs.audit.logger=${HDFS_AUDIT_LOGGER:-INFO,NullAppender} $HADOOP_SECONDARYNAMENODE_OPTS $JMX_OPTS=8060"

在web页面查看只需要:

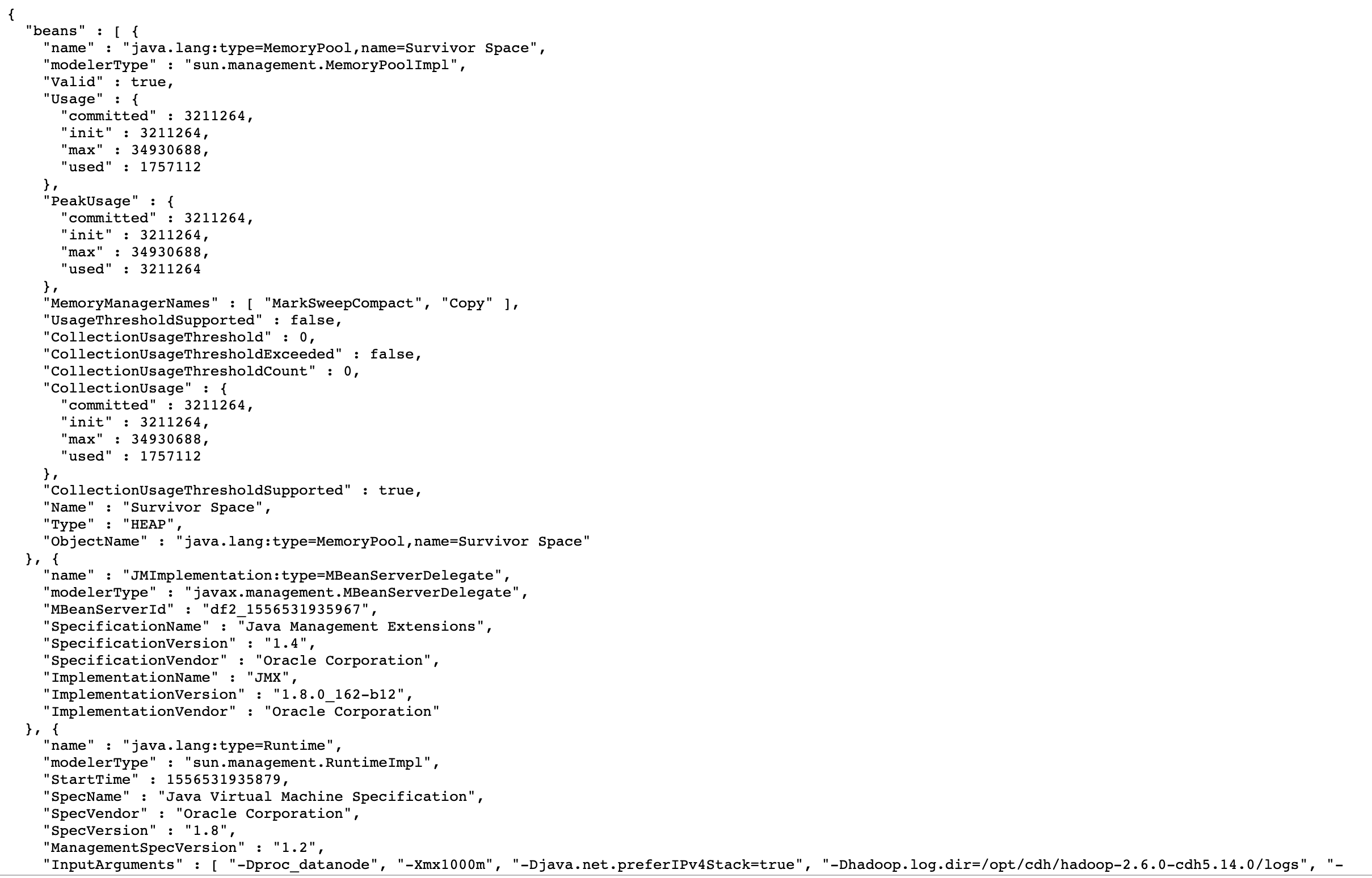

df1:50070/jmx

df2:50075/jmx

df3:50075/jmx

Hadoop监控项

指标信息来源:http://hadoop.apache.org/docs/stable/hadoop-project-dist/hadoop-common/Metrics.html

NameNode

JVM监控项

Hadoop:service=NameNode,name=JvmMetricsJvmMetrics 主要统计的信息包括:内存的使用状态信息; GC 的统计信息;线程的统计信息;以及事件的统计信息。

| 类型 | 指标项 | 说明 |

|---|---|---|

| 内存 | MemNonHeapUsedM | JVM 当前已经使用的 NonHeapMemory 的大小 |

| 内存 | MemNonHeapMaxM | JVM 配置的 NonHeapMemory 的大小 |

| 内存 | MemHeapUsedM | JVM 当前已经使用的 HeapMemory 的大小 |

| 内存 | MemHeapMaxM | JVM 配置的 HeapMemory 的大小 |

| 内存 | MemMaxM | JVM 运行时的可以使用的最大的内存的大小 |

| GC | GcCount | GC次数 |

| 线程 | ThreadsNew | 当前线程的处于 NEW 状态下的线程数量 |

| 线程 | ThreadsRunnable | 当前线程的处于 RUNNABLE 状态下的线程数量 |

| 线程 | ThreadsBlocked | 当前线程的处于 BLOCKED 状态下的线程数量 |

| 线程 | ThreadsWaiting | 当前线程的处于 WAITING 状态下的线程数量 |

| 线程 | ThreadsTimedWaiting | 当前线程的处于 TIMED_WAITING 状态下的线程数量 |

| 线程 | ThreadsTerminated | 当前线程的处于 TERMINATED 状态下的线程数量 |

| 事件 | LogFatal | 固定时间间隔内的 Fatal 的数量 |

| 事件 | LogError | 固定时间间隔内的 Error 的数量 |

| 事件 | LogWarn | 固定时间间隔内的 Warn 的数量 |

| 事件 | LogInfo | 固定时间间隔内的 Info 的数量 |

FSNamesystem

Hadoop:service=NameNode,name=FSNamesystem| 指标项 | 说明 |

|---|---|

| MissingBlocks | 当前遗失的block数量 |

| ExpiredHeartbeats | 失去心跳的总数量 |

| TransactionsSinceLastCheckpoint | 自上次检查点以来的事务总数 |

| TransactionsSinceLastLogRoll | 自上次编辑日志卷以来的事务总数 |

| LastCheckpointTime | 从上一个检查点以来的时间(毫秒) |

| CapacityTotal | 当前数据节点的原始容量(以字节为单位) |

| CapacityUsed | 当前在所有DataNode中使用的容量(以字节为单位) |

| CapacityRemaining | 当前剩余容量(字节) |

| CapacityUsedNonDFS | DataNodes用于非DFS目的的当前空间(以字节为单位) |

| TotalLoad | 当前连接数 |

| SnapshottableDirectories | 可快照目录的当前数量 |

| FilesTotal | 当前文件和目录的数量 |

| PendingDataNodeMessageCount | 待机NameNode中用于以后处理的挂起的与块相关的消息的当前数量 |

| StaleDataNodes | 由于心跳延迟而标记为过期的DataNodes当前数目 |

Hadoop:service=NameNode,name=FSNamesystemState| 指标项 | 说明 |

|---|---|

| BlocksTotal | 系统中当前分配的块数 |

| NumLiveDataNodes | 当前运行的数据节点数量 |

| NumDeadDataNodes | 当前死亡的数据节点数 |

| VolumeFailuresTotal | 所有Datanodes的卷故障总数 |

| EstimatedCapacityLostTotal | 容量故障导致的总容量损失估计 |

RPC

Hadoop:service=NameNode,name=RpcActivityForPort9000(需要进一步确认)| 指标项 | 说明 |

|---|---|

| ReceivedBytes | 接收字节总数 |

| SentBytes | 发送字节总数 |

| RpcQueueTimeNumOps | RPC调用总数 |

| RpcQueueTimeAvgTime | RPC队列平均时间(以毫秒为单位) |

NameNodeActivity

Hadoop:service=NameNode,name=NameNodeActivity| 指标项 | 说明 |

|---|---|

| CreateFileOps | 创建文件的操作总数 |

| FilesRenamed | 重命名操作的总数(不是重命名的文件或目录数量) |

| DeleteFileOps | 删除文件的操作总数 |

DataNode

JVM监控项

Hadoop:service=DataNode,name=JvmMetricsJvmMetrics 主要统计的信息包括:内存的使用状态信息; GC 的统计信息;线程的统计信息;以及事件的统计信息。

| 类型 | 指标项 | 说明 |

|---|---|---|

| 内存 | MemNonHeapUsedM | JVM 当前已经使用的 NonHeapMemory 的大小 |

| 内存 | MemNonHeapMaxM | JVM 配置的 NonHeapMemory 的大小 |

| 内存 | MemHeapUsedM | JVM 当前已经使用的 HeapMemory 的大小 |

| 内存 | MemHeapMaxM | JVM 配置的 HeapMemory 的大小 |

| 内存 | MemMaxM | JVM 运行时的可以使用的最大的内存的大小 |

| GC | GcCount | GC次数 |

| 线程 | ThreadsNew | 当前线程的处于 NEW 状态下的线程数量 |

| 线程 | ThreadsRunnable | 当前线程的处于 RUNNABLE 状态下的线程数量 |

| 线程 | ThreadsBlocked | 当前线程的处于 BLOCKED 状态下的线程数量 |

| 线程 | ThreadsWaiting | 当前线程的处于 WAITING 状态下的线程数量 |

| 线程 | ThreadsTimedWaiting | 当前线程的处于 TIMED_WAITING 状态下的线程数量 |

| 线程 | ThreadsTerminated | 当前线程的处于 TERMINATED 状态下的线程数量 |

| 事件 | LogFatal | 固定时间间隔内的 Fatal 的数量 |

| 事件 | LogError | 固定时间间隔内的 Error 的数量 |

| 事件 | LogWarn | 固定时间间隔内的 Warn 的数量 |

| 事件 | LogInfo | 固定时间间隔内的 Info 的数量 |

DataNodeActivity

Hadoop:service=DataNode,name=DataNodeActivity-dev02-50010(需要进一步确认)| 指标项 | 说明 |

|---|---|

| BytesWritten | 写入DataNode的字节总数 |

| BytesRead | 读取DataNode的字节总数 |

| ReadsFromLocalClient | 从本地客户端读取操作的总数 |

| ReadsFromRemoteClient | 来自远程客户端的读取操作总数 |

| WritesFromLocalClient | 本地客户端的写操作总数 |

| WritesFromRemoteClient | 远程客户端的写操作总数 |

| RemoteBytesRead | 远程客户端读取的字节数 |

| RemoteBytesWritten | 远程客户端写入的字节数 |

| RamDiskBytesWrite | 写入内存的字节总数 |

| VolumeFailures | 发生的卷故障总数 |

| ReadBlockOpNumOps | 读操作总数 |

| WriteBlockOpNumOps | 写操作总数 |

| ReadBlockOpAvgTime | 读操作的平均时间(以毫秒为单位) |

| WriteBlockOpAvgTime | 写操作的平均时间(以毫秒为单位) |

| TotalWriteTime | 写操作花费的总毫秒数 |

| TotalReadTime | 读操作花费的总毫秒数 |

RPC

Hadoop:service=DataNode,name=RpcActivityForPort50020(需要进一步确认)| 指标项 | 说明 |

|---|---|

| ReceivedBytes | 接收字节总数 |

| SentBytes | 发送字节总数 |

| RpcQueueTimeNumOps | RPC调用总数 |

| RpcQueueTimeAvgTime | RPC队列平均时间(以毫秒为单位) |

关于hadoop的运行的一些指标监控(非cdh平台的)的更多相关文章

- Amazon EMR(Elastic MapReduce):亚马逊Hadoop托管服务运行架构&Hadoop云服务之战:微软vs.亚马逊

http://s3tools.org/s3cmd Amazon Elastic MapReduce (Amazon EMR)简介 Amazon Elastic MapReduce (Amazon EM ...

- SpringBoot第十二集:度量指标监控与异步调用(2020最新最易懂)

SpringBoot第十二集:度量指标监控与异步调用(2020最新最易懂) Spring Boot Actuator是spring boot项目一个监控模块,提供了很多原生的端点,包含了对应用系统的自 ...

- 图解JanusGraph系列 - JanusGraph指标监控报警(Monitoring JanusGraph)

大家好,我是洋仔,JanusGraph图解系列文章,实时更新~ 图数据库文章总目录: 整理所有图相关文章,请移步(超链):图数据库系列-文章总目录 源码分析相关可查看github(码文不易,求个sta ...

- 【03】SpringBoot2核心技术-核心功能—数据访问_单元测试_指标监控

3.数据访问(SQL) 3.1 数据库连接池的自动配置-HikariDataSource 1.导入JDBC场景 <dependency> <groupId>org.spring ...

- 业务监控-指标监控(v1)

最近做了指标监控系统的后台,包括需求调研.代码coding.调试调优测试等,穿插其他杂事等前后花了一个月左右. 指标监控指的是用户通过接口上传某些指标信息,并且通过配置阈值公式和告警规则等信息监测自己 ...

- 利用Mahout实现在Hadoop上运行K-Means算法

利用Mahout实现在Hadoop上运行K-Means算法 一.介绍Mahout Mahout是Apache下的开源机器学习软件包,目前实现的机器学习算法主要包含有协同过滤/推荐引擎,聚类和分类三个部 ...

- Hadoop学习总结之五:Hadoop的运行痕迹

Hadoop学习总结之五:Hadoop的运行痕迹 Hadoop 学习总结之一:HDFS简介 Hadoop学习总结之二:HDFS读写过程解析 Hadoop学习总结之三:Map-Reduce入门 Ha ...

- Hadoop的运行痕迹

http://www.cnblogs.com/forfuture1978/archive/2010/11/23/1884967.html 一篇讲的很好的 hadoop 基本运行环境配置信息

- Hadoop源码分析(3): Hadoop的运行痕迹

在使用hadoop的时候,可能遇到各种各样的问题,然而由于hadoop的运行机制比较复杂,因而出现了问题的时候比较难于发现问题. 本文欲通过某种方式跟踪Hadoop的运行痕迹,方便出现问题的时候可以通 ...

随机推荐

- Java基础 -- 深入理解泛型

一般的类和方法,只能使用具体的类型:要么是基本类型,要么是自定义的类.如果要编写可以应用于多种类型的代码,这种刻板的限制对代码的束缚就会很大. 而泛型很好的解决了这个问题,这也是Java SE5的重大 ...

- EF Core系列

一. 二. 三. 系列章节 第一节:EF Core简介和CodeFirst和DBFirst两种映射模式(以SQLite和SQLServer为例) 第X节:XXXXXXXXXXXXXXXXXXXXXXX ...

- ArcGis Python脚本——将细碎小面合并到相邻的面积最大的面

参数: polygon_fc 面要素类 area_limit 给定面积值,小于它的面会被合并 给定两个参数即可,这回没有注释. #polygon_fc 面要素类 #area_limit 给定面积值,小 ...

- iTOP-4418开发板Android 5.1/4.4丨Linux + Qt5.7丨Ubuntu12.04系统

核心板参数 尺寸:50mm*60mm 高度:核心板连接器组合高度1.5mm PCB层数:6层PCB沉金设计 4418 CPU:ARM Cortex-A9 四核 S5P4418处理器 1.4GHz 68 ...

- java使用redis数据库

1.安装 Redis 支持 32 位和 64 位,根据实际情况选择不同的安装版本. 安装完成后打开命令提示窗口,切换到redis安装目录,启动redis客户端, redis-cli命令启动redis客 ...

- JAVA进阶20

1.可视化日历程序(简陋版) package cn.zh.abstrac; import java.text.DateFormat; import java.text.ParseException; ...

- core ML学习

Core ML工具是一个Python包(coremltools),托管在Python包索引(PyPI)上. 从表格中可看出,支持caffe工具. 使用与模型的第三方工具相对应的Core ML转换器转换 ...

- L2-004 这是二叉搜索树吗? (25 分) (树)

链接:https://pintia.cn/problem-sets/994805046380707840/problems/994805070971912192 题目: 一棵二叉搜索树可被递归地定义为 ...

- 关于shell变量的继承总结

结论: 默认,父shell和子shell的变量是隔离的. sh方式运行脚本,会重新开启一个子shell,无法继承父进程的普通变量,能继承父进程export的全局变量. source或者. 方式运行脚本 ...

- 3D Slicer中文教程(七)—图像中值滤波

1.中值滤波概念 中值滤波是对一个滑动窗口内的诸像素灰度值排序,用其中值代替窗口中心象素的原来灰度值,它是一种非线性的图像平滑法,它对脉冲干扰级椒盐噪声的抑制效果好,在抑制随机噪声的同时能有效保护边缘 ...