(python3爬虫实战-第一篇)利用requests+正则抓取猫眼电影热映口碑榜

今天是个值得纪念了日子,我终于在博客园上发表自己的第一篇博文了。作为一名刚刚开始学习python网络爬虫的爱好者,后期本人会定期发布自己学习过程中的经验与心得,

希望各位技术大佬批评指正。以下是我自己做的一个小爬虫,用到了爬虫的基本知识requests库+正则表达式库,最后将爬取到的结果存入日志result.txt,推荐给刚刚开始学习的小白们,

学不可以已,积土成山,风雨兴焉,希望我们共同进步!

1 #author: "xian"

#date: 2018/5/2

import requests #导入requests库

from requests.exceptions import RequestException #导入异常处理模块 具体见官网

import re #导入re模块

import json #导入json模块

#import def get_one_page(url): #获取单个页面,RequestException用来捕获异常

headers = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/66.0.3359.139 Safari/537.36', } #maoyan要求headers

try:

response = requests.get(url,headers = headers)

if response.status_code == 200:

return response.text

else:

return None

except RequestException:

return None def parse_one_page(html): #利用正则解析单个页面

pattern = re.compile('<dd>.*?board-index.*?>(\d+)</i>.*?data-src="(.*?)"'

+'.*?name"><a.*?>(.*?)</a>.*?star">(.*?)</p>.*?releasetime">(.*?)</p>'

+'.*?integer">(.*?)</i>.*?fraction">(\d+)</i>.*?</dd>',re.S) #生成一个正则表达式对象供后面调用 items = re.findall(pattern,html)

for item in items:

yield {

'index':item[0],

'image':item[1],

'title':item[2],

'authors':item[3].strip()[3:],

'time':item[4].strip()[5:],

'rating':item[5] + item[6], }

1 def write_to_file(content):#写入日志result.txt,其中encoding 和 ensure_ascii 解决编码问题,当然你也可以使用codecs模块

with open('result.txt','a',encoding='utf8') as f:

f.write(json.dumps(content,ensure_ascii=False) +'\n')#json.dumps为了将内容转成json字符串

f.close() def main():#主函数

url = 'http://maoyan.com/board'

html = get_one_page(url)

for item in parse_one_page(html):

print(item)

write_to_file(item) if __name__ == '__main__':

main()#解决战斗,妈妈再也不用担心我的学习了!

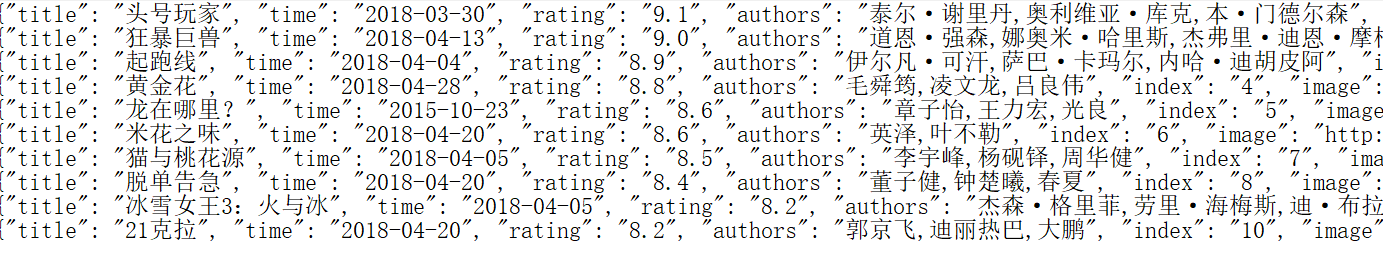

部分运行效果图:

(python3爬虫实战-第一篇)利用requests+正则抓取猫眼电影热映口碑榜的更多相关文章

- PYTHON 爬虫笔记八:利用Requests+正则表达式爬取猫眼电影top100(实战项目一)

利用Requests+正则表达式爬取猫眼电影top100 目标站点分析 流程框架 爬虫实战 使用requests库获取top100首页: import requests def get_one_pag ...

- Python爬虫【三】利用requests和正则抓取猫眼电影网上排名前100的电影

#利用requests和正则抓取猫眼电影网上排名前100的电影 import requests from requests.exceptions import RequestException imp ...

- Python爬虫之requests+正则表达式抓取猫眼电影top100以及瓜子二手网二手车信息(四)

requests+正则表达式抓取猫眼电影top100 一.首先我们先分析下网页结构 可以看到第一页的URL和第二页的URL的区别在于offset的值,第一页为0,第二页为10,以此类推. 二.< ...

- 使用Request+正则抓取猫眼电影(常见问题)

目前使用Request+正则表达式,爬取猫眼电影top100的例子很多,就不再具体阐述过程! 完整代码github:https://github.com/connordb/Top-100 总结一下,容 ...

- requests+正则爬取猫眼电影前100

最近复习功课,日常码农生活. import requests from requests.exceptions import RequestException import re import jso ...

- requests库爬取猫眼电影“最受期待榜”榜单 --网络爬虫

目标站点:https://maoyan.com/board/6 # coding:utf8 import requests, re, json from requests.exceptions imp ...

- Requests+正则表达式抓取猫眼电影TOP100

spider.py # -*- coding:utf-8 -*- import requests import re import json import codecs from requests.e ...

- python学习(23)requests库爬取猫眼电影排行信息

本文介绍如何结合前面讲解的基本知识,采用requests,正则表达式,cookies结合起来,做一次实战,抓取猫眼电影排名信息. 用requests写一个基本的爬虫 排行信息大致如下图 网址链接为ht ...

- 用requests库爬取猫眼电影Top100

这里需要注意一下,在爬取猫眼电影Top100时,网站设置了反爬虫机制,因此需要在requests库的get方法中添加headers,伪装成浏览器进行爬取 import requests from re ...

随机推荐

- javascript之类型转换

JavaScript是一种无类型语言,但同时JavaScript提供了一种灵活的自动类型转换的处理方式.基本规则是,如果某个类型的值用于需要其他类型的值的环境中,JavaScript就自动将这个值转换 ...

- 贪婪算法(Greedy algorithm)-算法学习之旅(一)

我研一下学期选修了网络管理,因为是限选课所以我没有认真上课,今天因为快结课考试了,我才去,然后我发现了一个大秘密...... 原来老师从第三节课已经开始讲算法导论的知识了,我是不是错过了什么... 废 ...

- javaRMI详解

前几天在阿里内推一面的时候,面试官问到了一个关于java中RMI(Remote Method Invocation)的问题,当时感觉自己回答的还比较好,他比较满意,但那是因为他问的比较浅,所以自己看了 ...

- [Mac] mac linux 多线程下载利器 axel

> 之前做过一些文件下载的统计,发现谷歌浏览器chrome和火狐firefox, 一般都是单线程的下载文件,360浏览器却是多线程的下载. 现在切换到了mac上,发现没有360哪个浏览器,就像 ...

- CentOS配置

1.在Vmware中安装好虚拟机. 2.客户机(即虚拟机中的centos)网络连接使用仅主机模式Host-only 3.在主机中网络配置上,配置IP地址 1.使用PieTTY远程连接该虚拟机 2.使用 ...

- CUDA学习,环境配置和简单例子

根据摩尔定律,每18个月,硬件的速度翻一番.纵使CPU的主频会越来越高,但是其核数受到了极大的限制,目前来说,最多只有8个或者9个核.相比之下,GPU具有很大的优势,他有成千上万个核,能完成大规模的并 ...

- 我眼中的Linux设备树(一 概述)

一 概述设备树(Device tree)是一套用来描述硬件属相的规则.ARM Linux采用设备树机制源于2011年3月份Linux创始人Linus Torvalds发的一封邮件,在这封邮件中他提倡A ...

- 【翻译】Ext JS 6早期访问版本发布

早期访问版本是什么 如何参与 都包括什么 Sencha Ext JS 6 Sencha Pivot Grid Sencha Cmd 6 JetBrains IDE插件 反馈 原文:Announcing ...

- Linux信号实践(5) --时间与定时器

三种不同精度的睡眠 1.sleep #include <unistd.h> unsigned int sleep(unsigned int seconds); RETURN VALUE Z ...

- SMEM介绍

SMEM :shared memory,是高通平台各子系统共享信息的一种机制,通过SMEM机制,PBL可以将信息传递给SBL1,SBL1可以将信息传递给RPM.LK.下面分析一个SMEM信息传递的具体 ...