Logstash之Logstash inputs(file和redis插件)、Logstash outputs(elasticsearch 和redis插件)和Filter plugins

前期博客

Logstash安装和设置(图文详解)(多节点的ELK集群安装在一个节点就好)

Filebeat啊,根据input来监控数据,根据output来使用数据!!!

请移步,

Filebeat之input和output(包含Elasticsearch Output 、Logstash Output、 Redis Output、 File Output和 Console Output)

Logstash啊,根据input来监控数据,根据output来使用数据!!!

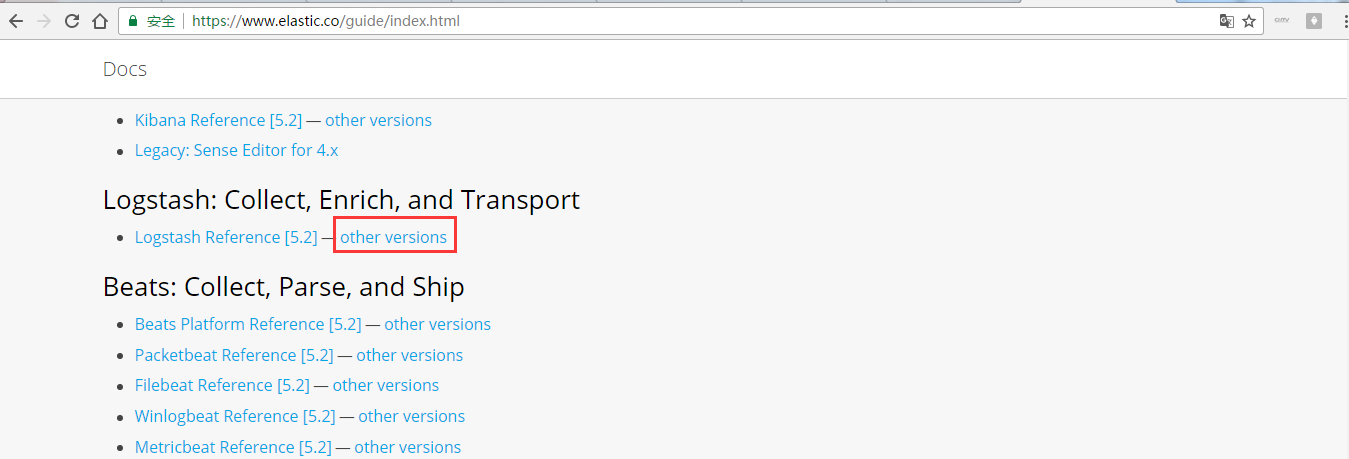

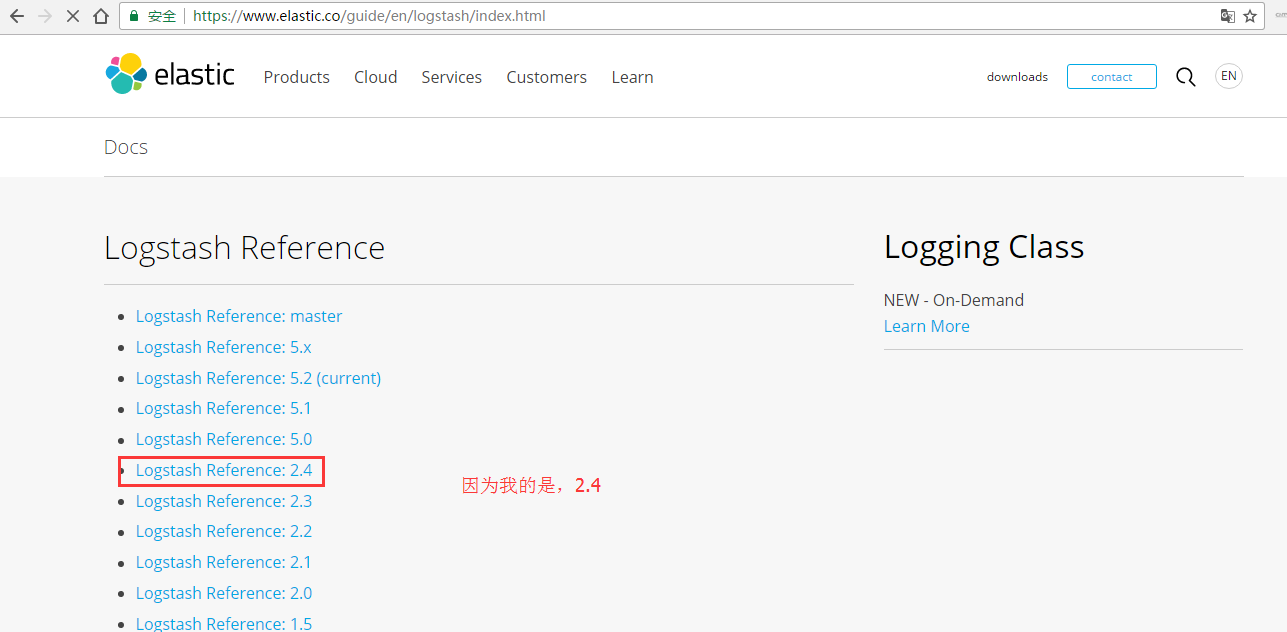

手把手带你看官方文档(Logstash inputs和Logstash outputs)

https://www.elastic.co/guide/index.html

https://www.elastic.co/guide/en/logstash/index.html

https://www.elastic.co/guide/en/logstash/2.4/index.html

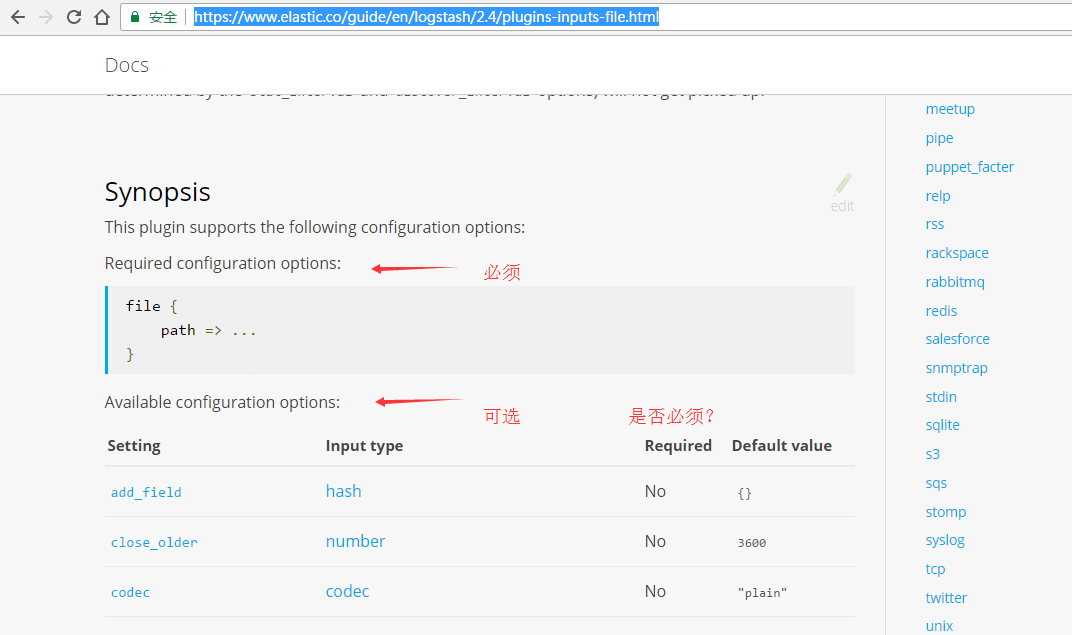

关于 Logstash inputs、Logstash outputs和Filter plugins,很多很多,自行去官网看,我这里不多赘述。仅仅拿下面来示范:

Logstash 的input

file input

最常用的input插件是file。

https://www.elastic.co/guide/en/logstash/2.4/plugins-inputs-file.html

[hadoop@HadoopMaster logstash-2.4.1]$ pwd

/home/hadoop/app/logstash-2.4.1

[hadoop@HadoopMaster logstash-2.4.1]$ ll

total 164

drwxrwxr-x. 2 hadoop hadoop 4096 Mar 27 03:58 bin

-rw-rw-r--. 1 hadoop hadoop 102879 Nov 14 10:04 CHANGELOG.md

-rw-rw-r--. 1 hadoop hadoop 2249 Nov 14 10:04 CONTRIBUTORS

-rw-rw-r--. 1 hadoop hadoop 5084 Nov 14 10:07 Gemfile

-rw-rw-r--. 1 hadoop hadoop 23015 Nov 14 10:04 Gemfile.jruby-1.9.lock

drwxrwxr-x. 4 hadoop hadoop 4096 Mar 27 03:58 lib

-rw-rw-r--. 1 hadoop hadoop 589 Nov 14 10:04 LICENSE

-rw-rw-r--. 1 hadoop hadoop 46 Mar 27 05:30 logstash-simple.conf

-rw-rw-r--. 1 hadoop hadoop 149 Nov 14 10:04 NOTICE.TXT

drwxrwxr-x. 4 hadoop hadoop 4096 Mar 27 03:58 vendor

[hadoop@HadoopMaster logstash-2.4.1]$ vim file_stdout.conf

这个,是可以自定义的。我这里是

path => "/home/hadoop/app.log"

或者

path => [ "/home/hadoop/app", "/home/hadoop/*.log" ]

input {

file {

path => "/home/hadoop/app.log"

}

}

filter {

}

output {

stdout {}

}

我这里是, 监控/home/hadoop/app.log这个文件的变化。

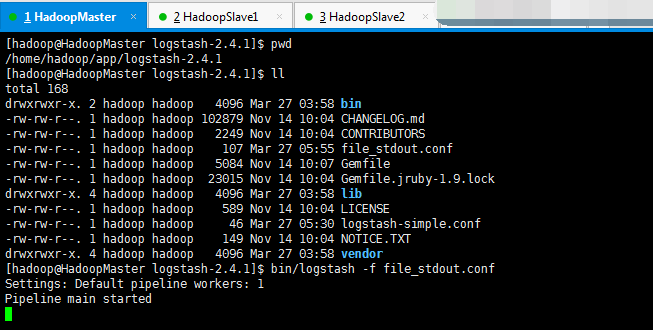

[hadoop@HadoopMaster logstash-2.4.1]$ pwd

/home/hadoop/app/logstash-2.4.1

[hadoop@HadoopMaster logstash-2.4.1]$ ll

total 168

drwxrwxr-x. 2 hadoop hadoop 4096 Mar 27 03:58 bin

-rw-rw-r--. 1 hadoop hadoop 102879 Nov 14 10:04 CHANGELOG.md

-rw-rw-r--. 1 hadoop hadoop 2249 Nov 14 10:04 CONTRIBUTORS

-rw-rw-r--. 1 hadoop hadoop 107 Mar 27 05:55 file_stdout.conf

-rw-rw-r--. 1 hadoop hadoop 5084 Nov 14 10:07 Gemfile

-rw-rw-r--. 1 hadoop hadoop 23015 Nov 14 10:04 Gemfile.jruby-1.9.lock

drwxrwxr-x. 4 hadoop hadoop 4096 Mar 27 03:58 lib

-rw-rw-r--. 1 hadoop hadoop 589 Nov 14 10:04 LICENSE

-rw-rw-r--. 1 hadoop hadoop 46 Mar 27 05:30 logstash-simple.conf

-rw-rw-r--. 1 hadoop hadoop 149 Nov 14 10:04 NOTICE.TXT

drwxrwxr-x. 4 hadoop hadoop 4096 Mar 27 03:58 vendor

[hadoop@HadoopMaster logstash-2.4.1]$ bin/logstash -f file_stdout.conf

Settings: Default pipeline workers: 1

Pipeline main started

重新打开,另外一个HadoopMaster界面。

[hadoop@HadoopMaster ~]$ pwd

/home/hadoop

[hadoop@HadoopMaster ~]$ ll

total 48

drwxrwxr-x. 12 hadoop hadoop 4096 Mar 27 03:59 app

-rw-rw-r--. 1 hadoop hadoop 18 Mar 26 19:59 app.log

drwxrwxr-x. 7 hadoop hadoop 4096 Mar 25 06:34 data

drwxr-xr-x. 2 hadoop hadoop 4096 Oct 31 17:19 Desktop

drwxr-xr-x. 2 hadoop hadoop 4096 Oct 31 17:19 Documents

drwxr-xr-x. 2 hadoop hadoop 4096 Oct 31 17:19 Downloads

drwxr-xr-x. 2 hadoop hadoop 4096 Oct 31 17:19 Music

drwxr-xr-x. 2 hadoop hadoop 4096 Mar 26 20:35 mybeat

drwxr-xr-x. 2 hadoop hadoop 4096 Oct 31 17:19 Pictures

drwxr-xr-x. 2 hadoop hadoop 4096 Oct 31 17:19 Public

drwxr-xr-x. 2 hadoop hadoop 4096 Oct 31 17:19 Templates

drwxr-xr-x. 2 hadoop hadoop 4096 Oct 31 17:19 Videos

[hadoop@HadoopMaster ~]$ echo bbbbbbb >> app.log

[hadoop@HadoopMaster ~]$

[hadoop@HadoopMaster logstash-2.4.1]$ pwd

/home/hadoop/app/logstash-2.4.1

[hadoop@HadoopMaster logstash-2.4.1]$ ll

total 168

drwxrwxr-x. 2 hadoop hadoop 4096 Mar 27 03:58 bin

-rw-rw-r--. 1 hadoop hadoop 102879 Nov 14 10:04 CHANGELOG.md

-rw-rw-r--. 1 hadoop hadoop 2249 Nov 14 10:04 CONTRIBUTORS

-rw-rw-r--. 1 hadoop hadoop 107 Mar 27 05:55 file_stdout.conf

-rw-rw-r--. 1 hadoop hadoop 5084 Nov 14 10:07 Gemfile

-rw-rw-r--. 1 hadoop hadoop 23015 Nov 14 10:04 Gemfile.jruby-1.9.lock

drwxrwxr-x. 4 hadoop hadoop 4096 Mar 27 03:58 lib

-rw-rw-r--. 1 hadoop hadoop 589 Nov 14 10:04 LICENSE

-rw-rw-r--. 1 hadoop hadoop 46 Mar 27 05:30 logstash-simple.conf

-rw-rw-r--. 1 hadoop hadoop 149 Nov 14 10:04 NOTICE.TXT

drwxrwxr-x. 4 hadoop hadoop 4096 Mar 27 03:58 vendor

[hadoop@HadoopMaster logstash-2.4.1]$ bin/logstash -f file_stdout.conf

Settings: Default pipeline workers: 1

Pipeline main started

2017-03-26T22:24:35.897Z HadoopMaster bbbbbbb

其实,这个文件,.sincedb_8f3299d0a5bdb7df6154f681fc150341也会记录。

注意:

第一次读取新文件,不会有.sincedb等这些,默认根据这个start_position去读,若start_position是end,则读最后。若start_position是begin,则读最开始。

若不是第一次读取文件了,重启Logstash,则会有.sincedb文件了,则就转去根据这个.sincedb文件读了。不管start_position是什么,都不起效了。

start_position:指定从什么位置开始读取文件数据,默认是结束位置,也可以指定为从头开始。

注意:start_position仅在该文件从未被监听过的时候起作用,因为logstash在读取文件的时候会记录一个.sincedb文件来跟踪文件的读取位置,当文件被读取过一次之后,下次就会从.sincedb中记录的位置读取,start_position参数就无效了。文件默认在用户目录下。

注意一个坑:ignore_older属性,表示忽略老的数据,值默认为86400,表示忽略24小时以前的数据。如果你新监控一个24小时以上没有被修改过的老文件的话,就算把start_position设置为beginning,也无法获取之前的数据。

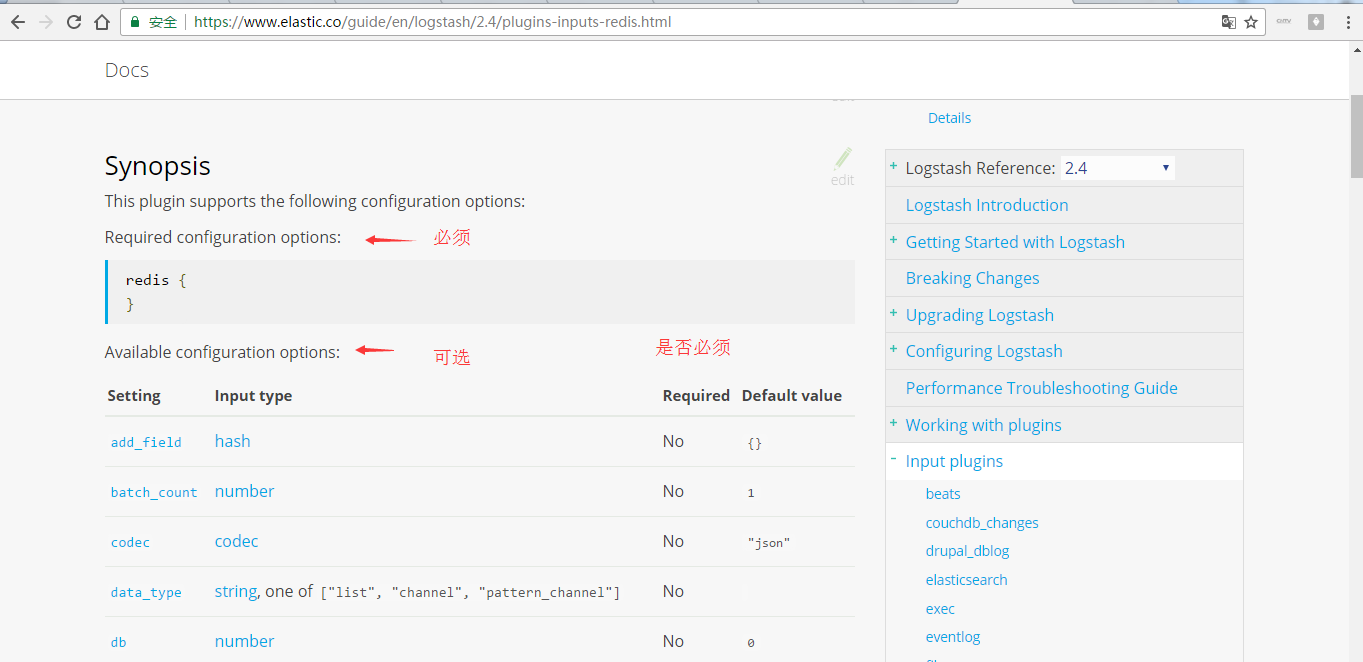

redis input

https://www.elastic.co/guide/en/logstash/2.4/plugins-inputs-redis.html

[hadoop@HadoopMaster logstash-2.4.1]$ pwd

/home/hadoop/app/logstash-2.4.1

[hadoop@HadoopMaster logstash-2.4.1]$ ll

total 168

drwxrwxr-x. 2 hadoop hadoop 4096 Mar 27 03:58 bin

-rw-rw-r--. 1 hadoop hadoop 102879 Nov 14 10:04 CHANGELOG.md

-rw-rw-r--. 1 hadoop hadoop 2249 Nov 14 10:04 CONTRIBUTORS

-rw-rw-r--. 1 hadoop hadoop 107 Mar 27 05:55 file_stdout.conf

-rw-rw-r--. 1 hadoop hadoop 5084 Nov 14 10:07 Gemfile

-rw-rw-r--. 1 hadoop hadoop 23015 Nov 14 10:04 Gemfile.jruby-1.9.lock

drwxrwxr-x. 4 hadoop hadoop 4096 Mar 27 03:58 lib

-rw-rw-r--. 1 hadoop hadoop 589 Nov 14 10:04 LICENSE

-rw-rw-r--. 1 hadoop hadoop 46 Mar 27 05:30 logstash-simple.conf

-rw-rw-r--. 1 hadoop hadoop 149 Nov 14 10:04 NOTICE.TXT

drwxrwxr-x. 4 hadoop hadoop 4096 Mar 27 03:58 vendor

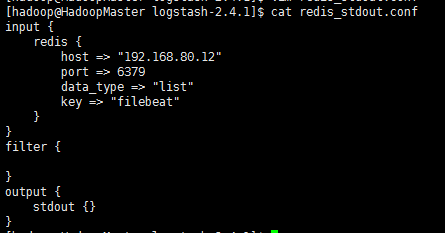

[hadoop@HadoopMaster logstash-2.4.1]$ vim redis_stdout.conf

input {

redis {

host => "192.168.80.12"

port => 6379

data_type => "list"

key => "filebeat"

}

}

filter {

}

output {

stdout {}

}

这里,用到redis,不会用的博友,请移步

redis的安装(图文详解)

这里,等我安装好了之后,再来。

Logstash 的output

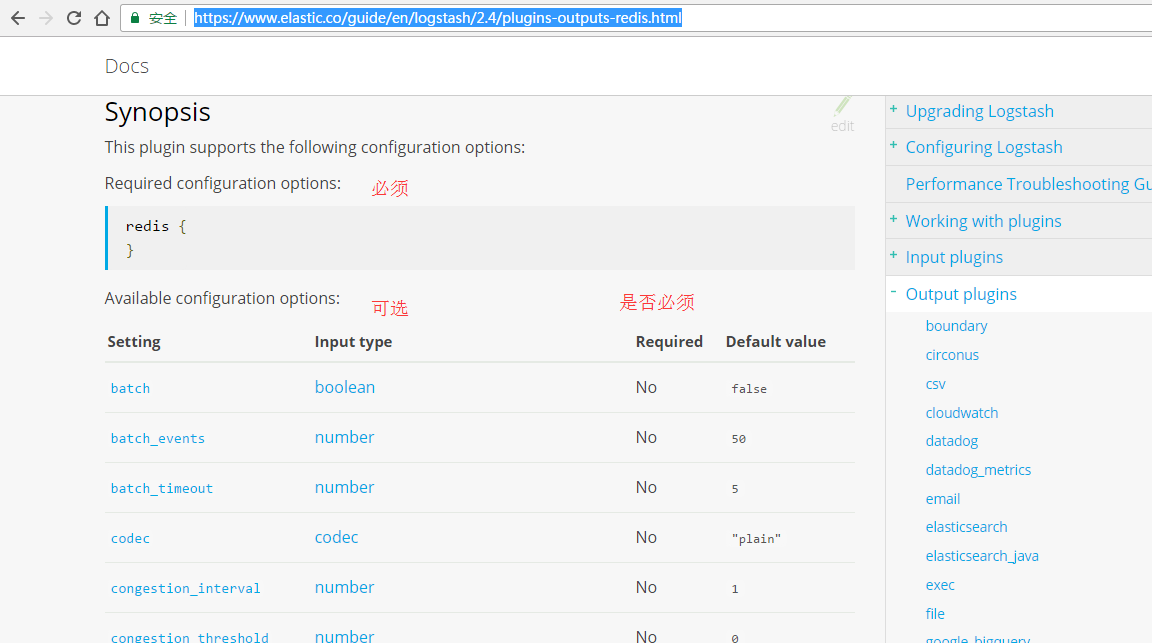

redis output

https://www.elastic.co/guide/en/logstash/2.4/plugins-outputs-redis.html

[hadoop@HadoopMaster logstash-2.4.1]$ pwd

/home/hadoop/app/logstash-2.4.1

[hadoop@HadoopMaster logstash-2.4.1]$ ll

total 172

drwxrwxr-x. 2 hadoop hadoop 4096 Mar 27 03:58 bin

-rw-rw-r--. 1 hadoop hadoop 102879 Nov 14 10:04 CHANGELOG.md

-rw-rw-r--. 1 hadoop hadoop 2249 Nov 14 10:04 CONTRIBUTORS

-rw-rw-r--. 1 hadoop hadoop 107 Mar 27 05:55 file_stdout.conf

-rw-rw-r--. 1 hadoop hadoop 5084 Nov 14 10:07 Gemfile

-rw-rw-r--. 1 hadoop hadoop 23015 Nov 14 10:04 Gemfile.jruby-1.9.lock

drwxrwxr-x. 4 hadoop hadoop 4096 Mar 27 03:58 lib

-rw-rw-r--. 1 hadoop hadoop 589 Nov 14 10:04 LICENSE

-rw-rw-r--. 1 hadoop hadoop 46 Mar 27 05:30 logstash-simple.conf

-rw-rw-r--. 1 hadoop hadoop 149 Nov 14 10:04 NOTICE.TXT

-rw-rw-r--. 1 hadoop hadoop 155 Mar 27 06:43 redis_stdout.conf

drwxrwxr-x. 4 hadoop hadoop 4096 Mar 27 03:58 vendor

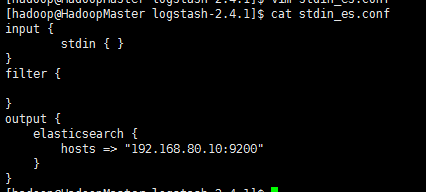

[hadoop@HadoopMaster logstash-2.4.1]$ vim stdin_es.conf

elasticsearch output

即把Logstash里的数据,写到elasticsearch 集群(这台192.168.80.10里)

hosts=>"192.168.80.00" 或

hosts=>["192.168.80.10:9200","192.168.80.11:9200","192.168.80.12:9200"]

1.x中属性名称叫host

默认向es中创建的索引库是logstash-%{+YYYY.MM.dd},可以利用es中的索引模板特性定义索引库的一些基础配置。

input {

stdin { }

}

filter {

}

output {

elasticsearch {

hosts => "192.168.80.10:9200"

}

}

继续

Filter plugins

继续

Logstash之Logstash inputs(file和redis插件)、Logstash outputs(elasticsearch 和redis插件)和Filter plugins的更多相关文章

- php版redis插件,SSDB数据库,增强型的Redis管理api实例

php版redis插件,SSDB数据库,增强型的Redis管理api实例 SSDB是一套基于LevelDB存储引擎的非关系型数据库(NOSQL),可用于取代Redis,更适合海量数据的存储.另外,ro ...

- 解决logstash.outputs.elasticsearch[main] Could not index event to Elasticsearch status 404

现象:lostack启动正常,logstack收集输入redis数据,输出到elasticsearch写入失败 提示:去建索引 的时候elasticsearch返回404 [2019-11-12T11 ...

- Logstash学习之路(五)使用Logstash抽取mysql数据到kakfa

一.Logstash对接kafka测通 说明: 由于我这里kafka是伪分布式,且kafka在伪分布式下,已经集成了zookeeper. 1.先将zk启动,如果是在伪分布式下,kafka已经集成了zk ...

- [logstash.outputs.elasticsearch] retrying failed action with response code: 403

0x00 Event [2019-09-24T19:22:31,655][INFO ][logstash.outputs.elasticsearch] retrying failed action w ...

- 在logstash中启动X-Pack Management功能后配置logstash的情况说明

开启X-Pack Management功能后,启动logstsh的时候就不用再配置logstash.conf文件了,启动的时候也不用再使用-f指定这个文件进行启动了 一旦启动了logstash的集中管 ...

- NoSQL初探之人人都爱Redis:(3)使用Redis作为消息队列服务场景应用案例

一.消息队列场景简介 “消息”是在两台计算机间传送的数据单位.消息可以非常简单,例如只包含文本字符串:也可以更复杂,可能包含嵌入对象.消息被发送到队列中,“消息队列”是在消息的传输过程中保存消息的容器 ...

- 分布式缓存技术redis学习系列(三)——redis高级应用(主从、事务与锁、持久化)

上文<详细讲解redis数据结构(内存模型)以及常用命令>介绍了redis的数据类型以及常用命令,本文我们来学习下redis的一些高级特性. 安全性设置 设置客户端操作秘密 redis安装 ...

- 【转】NoSQL初探之人人都爱Redis:(3)使用Redis作为消息队列服务场景应用案例

一.消息队列场景简介 “消息”是在两台计算机间传送的数据单位.消息可以非常简单,例如只包含文本字符串:也可以更复杂,可能包含嵌入对象.消息被发送到队列中,“消息队列”是在消息的传输过程中保存消息的容器 ...

- ElasticSearch 2 (6) - 插件安装Head、Kopf与Bigdesk

ElasticSearch 2 (6) - 插件安装Head.Kopf与Bigdesk 摘要 安装Elasticsearch插件Head.Kopf与Bigdesk 版本 elasticsearch版本 ...

随机推荐

- DBCP2配置详细说明(中文翻译)

http://blog.csdn.net/kerafan/article/details/50382998 common-dbcp2数据库连接池参数说明 由于commons-dbcp所用的连接池出现版 ...

- ArcGIS api for javascript——渲染-使用分级渲染

描述 本例使用一个分级渲染通过人口密度用符号表示Kansas.代码明确地增加类并为每一个定义颜色.使用ClassBreaksRenderer.addBreak()方法定义类,参数是在类中包含的最大值和 ...

- localStorage 以及UserData[IE6 IE7]使用

说在前头: UserData:属于IE6 IE7的老东西.麻烦且体验差,暂且不表 localStorage 属于HTML5的东西,兼容IE8以及其它W3C标准的主流浏览器.所以尽可能的具体解说 注意: ...

- MySQL自定义函数(四十六)

MySQL自定义函数 一.什么是MYSQL自定义函数? mysql当中的自定义函数,我们简称为UDF,它实际上是一种对MySQL扩展的途径,其用法与内置函数相同. 二.自定义函数应该具备哪些条件? 我 ...

- c# 导出excel格式xlsx

string sb="";//sql字符串 AttachmentConfigSection configSection = ConfigurationManager.GetSect ...

- SQL函数_Floor和Celling

1 floor()函数用于获得小于或者等于数值表达式的最大整数,也就是向下取整;celling()函数用于获得大于或者等于数值表达式的最小整数,也就是向上取整: 2 floor()函数和round函数 ...

- Linux常用Office办公软件

1.WPS Office是由金山软件股份有限公司自主研发的一款办公软件套件,可以实现办公最常用的文字.表格.演示等多种功能.免费提供海量的在线存储空间及文档模板.支持阅读和输出PDF文件.全面兼容Mi ...

- PHP抓取网页内容的几种方法

方法1: 用file_get_contents 以get方式获取内容 <?php $url='http://www.domain.com/?para=123'; $html = file_get ...

- HRBUST 1376 能量项链

能量项链 Time Limit: 1000ms Memory Limit: 32768KB This problem will be judged on HRBUST. Original ID: 13 ...

- 洛谷 P1591 阶乘数码

P1591 阶乘数码 题目描述 求n!中某个数码出现的次数. 输入输出格式 输入格式: 第一行为t(≤10),表示数据组数.接下来t行,每行一个正整数n(≤1000)和数码a. 输出格式: 对于每组数 ...