HDFS的操作SHELL和API

HDFS的shell操作和JavaAPI的使用:

WEB

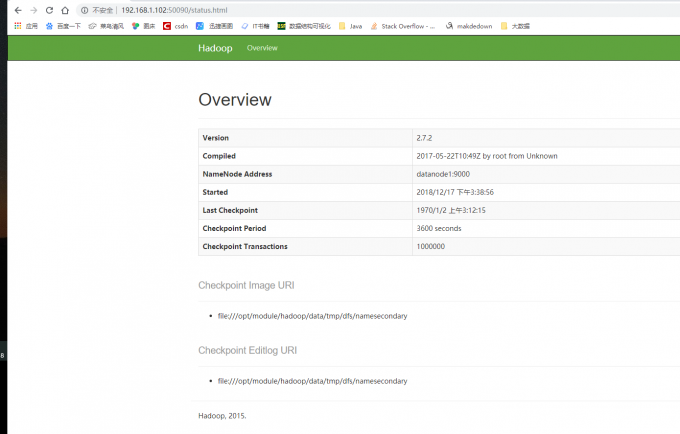

WEB端口50090查看SecondaryNameNode信息。可以查看Hadoop的版本,NameNode的IP,Checkpoint等信息。

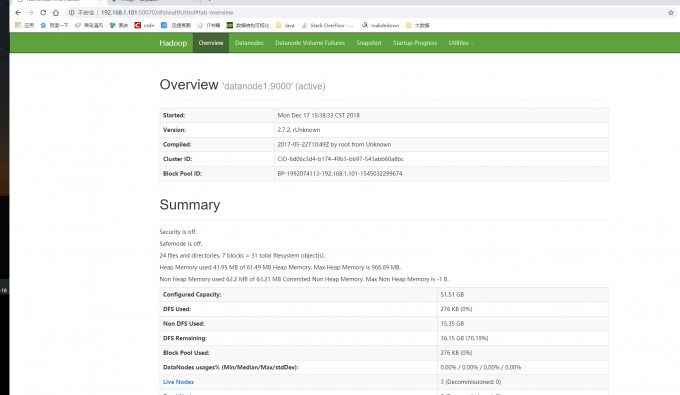

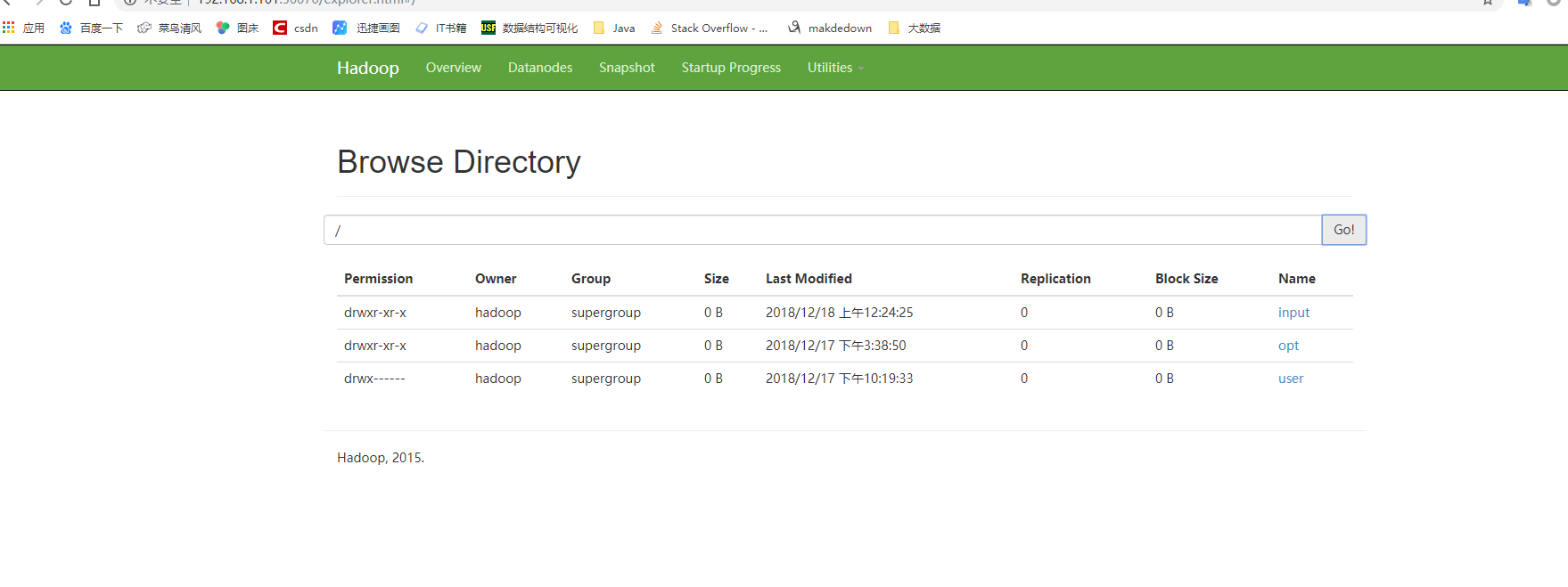

WEB端口50070可以查看HDFS的信息和目录结构

SHELL

查看

hdfs dfs -ls [-d][-h][-R] <paths>

[-d]:返回path

[-h]:按照KMG数据大小单位显示文件大小,默认B

[-R]:级联显示paths下文件

创建文件夹

hdfs dfs -mkdir [-p]<paths>

新建文件

hdfs dfs -touchz<paths>

查看文件

hdfs dfs -cat/[-ignoreCrc] [src]

hdfs dfs -text -ignoreCrc /input/test #忽略校验

hdfs dfs -cat -ignoreCrc /input/test

追写文件

hdfs dfs --appendToFile <localsrc> <dst>

如果localsrc为"-"表示数据来自键盘输入用"Ctrc+C"取消输入

上传下载

hdfs dfs -put [-f][-p]<localsrc> <dst> # 上传到指定目录

hdfs dfs -get [-p]<src> <localhost> # 现在到本地

删除文件

hdfs dfs -rm [-f] [-r] <src>

-f 如果要删除的文件不存在,不显示错误信息

-r/R 级联删除目录下所有文件和子目录文件

磁盘空间

hdfs dfs -du[-s][-h]<path>

[-s]显示指定目录所占空间大小

[-h]按照K M G 数据显示文件大小

JAVA API

步骤

- 实例化Configuration

Configuration封装了客户端或服务器的配置,Confiuration实例会自动加载HDFS的配置文件core-site.xml,从中获取Hadoop集群中的配置信息。因此我们要把集群的配置core-site.xml放在Maven项目的resources目录下。

Configuration conf = new Configuration();

- 实例化FileSystem

FileSystem类是客户端访问文件系统的入口,是一个抽象的文件系统。DistributedFileSystem类是FileSystem的一个具体实现。实例化FileSystem并发挥默认的文件系统代码如下:

FileSystem fs = FileSystem.get(conf);

- 设置目标对象的路径

HDFS API 提供了Path类来封装文件路径。PATH类位于org.apache.hadoop.fs.Path包中,代码如下:

Path path = new Path("/input/write.txt");

执行文件操作

得到Filesystem实例后,就可以使用该实例提供的方法成员执行相应的操作。如果:打开文件,创建文件、重命名文件、删除文件。

FileSystem类常用成员函数

| 方法名称及参数 | 返回值 | 功能 |

|---|---|---|

| create(Path f) | FSDataOutputStream | 创建一个文件 |

| open(Path f) | FSDatatInputStream | 打开指定的文件 |

| delete(Path f) | boolean | 删除指定文件 |

| exsits(Path f) | boolean | 检查文件是否存在 |

| getBlockSize(Path f) | long | 返回指定的数据块的大小 |

| getLength(Path f) | long | 返回文件长度 |

| mkdir(Path f) | boolean | 检查文件是否存在 |

| copyFromLocalFile(Path src, Path dst) | void | 从本地磁盘复制文件到HDFS |

| copyToLocalFile(Path src, Path dst) | void | 从HDFS复制文件到本地磁盘 |

| ……….. | ………. | ……………. |

上传文件

package hdfs; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path; import java.net.URI; public class PutFile {

public static void main(String[] args) throws Exception { Configuration conf = new Configuration(); FileSystem fs = FileSystem.get(URI.create("hdfs://datanode1:9000"),conf,"hadoop"); //本地文件

Path src = new Path("D:\\上传文件.txt"); //HDFS 路径

Path dst = new Path("/input/上传文件.txt"); fs.copyFromLocalFile(src, dst);

fs.close();

System.out.println("文件上传成功");

}

}

创建文件

package hdfs; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path; import java.net.URI; public class CreateFile {

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration(); FileSystem fs = FileSystem.get(URI.create("hdfs://datanode1:9000"), conf, "hadoop");

Path dfs = new Path("/input/上传文件.txt");

FSDataOutputStream newFile = fs.create(dfs, true); //是否覆盖文件 true 覆盖 false 追加

newFile.writeBytes("this is a create file tes");

System.out.println("创建文件成功"); }

}

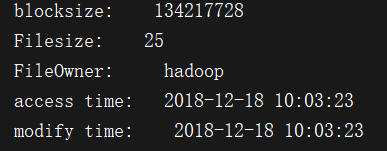

文件详情

package hdfs; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileStatus;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path; import java.net.URI;

import java.text.SimpleDateFormat;

import java.util.Date; public class SeeInfo {

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration(); FileSystem fs = FileSystem.get(URI.create("hdfs://datanode1:9000"), conf, "hadoop"); // HDFS文件

Path fpath = new Path("/input/上传文件.txt"); FileStatus fileLinkStatus = fs.getFileLinkStatus(fpath);

//获得块大小

long blockSize = fileLinkStatus.getBlockSize();

System.out.println("blocksize: " + blockSize); //获得文件大小

long len = fileLinkStatus.getLen();

System.out.println("Filesize: " + len); //获得文件所有者

String owner = fileLinkStatus.getOwner();

System.out.println("FileOwner: " + owner); //获得创建时间

SimpleDateFormat formater = new SimpleDateFormat("yyyy-MM-dd hh:mm:ss");

long accessTime = fileLinkStatus.getAccessTime();

System.out.println("access time: " + formater.format(new Date(accessTime))); //获得修改时间

long modificationTime = fileLinkStatus.getModificationTime();

System.out.println("modify time: " + formater.format(new Date(modificationTime))); }

}

下载文件

package hdfs; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils; import java.io.FileOutputStream;

import java.io.InputStream;

import java.io.OutputStream;

import java.net.URI; public class GetFIle {

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration(); FileSystem fs = FileSystem.get(URI.create("hdfs://datanode1:9000"), conf, "hadoop");

// HDFS 文件

InputStream in = fs.open(new Path("/input/上传文件.txt")); //保存到本地位置

OutputStream out = new FileOutputStream("D://下载文件.txt");

IOUtils.copyBytes(in, out, 4096, true); System.out.println("下载文件成功");

fs.close(); }

}

删除文件

package hdfs; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path; import java.net.URI; public class DeleteFile {

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration(); FileSystem fs = FileSystem.get(URI.create("hdfs://datanode1:9000"), conf, "hadoop"); Path path = new Path("/input/上传文件.txt");

fs.delete(path);

System.out.println("删除成功");

}

}

HDFS的操作SHELL和API的更多相关文章

- HDFS的基本shell操作,hadoop fs操作命令

(1)分布式文件系统 随着数据量越来越多,在一个操作系统管辖的范围存不下了,那么就分配到更多的操作系统管理的磁盘中,但是不方便管理和维护,因此迫切需要一种系统来管理多台机器上的文件,这就是分布式文件管 ...

- JAVA API 实现hdfs文件操作

java api 实现hdfs 文件操作会出现错误提示: Permission denied: user=hp, access=WRITE, inode="/":hdfs:supe ...

- 吴裕雄--天生自然HADOOP操作实验学习笔记:hdfs简单的shell命令

实验目的 了解bin/hadoop脚本的原理 学会使用fs shell脚本进行基本操作 学习使用hadoop shell进行简单的统计计算 实验原理 1.hadoop的shell脚本 当hadoop集 ...

- HDFS简单介绍及用C语言訪问HDFS接口操作实践

一.概述 近年来,大数据技术如火如荼,怎样存储海量数据也成了当今的热点和难点问题,而HDFS分布式文件系统作为Hadoop项目的分布式存储基础,也为HBASE提供数据持久化功能,它在大数据项目中有很广 ...

- Hadoop之HDFS文件操作常有两种方式(转载)

摘要:Hadoop之HDFS文件操作常有两种方式,命令行方式和JavaAPI方式.本文介绍如何利用这两种方式对HDFS文件进行操作. 关键词:HDFS文件 命令行 Java API HD ...

- hadoop的hdfs文件操作实现上传文件到hdfs

这篇文章主要介绍了使用hadoop的API对HDFS上的文件访问,其中包括上传文件到HDFS上.从HDFS上下载文件和删除HDFS上的文件,需要的朋友可以参考下hdfs文件操作操作示例,包括上传文件到 ...

- Hadoop---Java-API对HDFS的操作

Java-API对HDFS的操作 哈哈哈哈,深夜来一波干货哦!!! Java-PAI对hdfs的操作,首先我们建一个maven项目,我主要说,我们可以通过Java代码来对HDFS的具体信息的打印,然后 ...

- Hadoop JAVA HDFS客户端操作

JAVA HDFS客户端操作 通过API操作HDFS org.apache.logging.log4jlog4j-core2.8.2org.apache.hadoophadoop-common${ha ...

- 通过流的方式操作hadoop的API

通过流的方式操作hadoop的API 功能: 可以直接用来操作hadoop的文件系统 可以用在mapreduce的outputformat中设置RecordWrite 参考: 概念理解 http:// ...

随机推荐

- LoadRunner手写脚本、检查点、集合点、事务、思考时间

手写脚本 什么时候要手写? 可以有条件手写脚本的场景有两类: 有接口说明文档 没有借口说明文档,要去录制,录制不了,抓包手写 所需函数 我们这里讲的例子是基于 http 协议的,也是常见的两种请求类型 ...

- 20165308 实验二 Java面向对象程序设计

20165308 实验二 Java面向对象程序设计 实验二 Java面向对象程序设计 一.实验报告封面 课程:Java程序设计 班级:1653班 姓名:张士洋 学号:20165308 指导教师:娄嘉鹏 ...

- C166-变量和函数指定物理地址一

1.函数指定地址 按照http://www.keil.com/support/docs/2215.htm C166: LOCATING PROGRAM SECTIONS TO SPECIAL MEMO ...

- java 标准输入输出System.in与System.out

System.in System.in 是 InputStream 类的实例对象,该对象的创建是由本地(native)方法完成的. public static final InputStream in ...

- JMeter ----与WebDriver安装与测试

JMeter ----与WebDriver安装与测试 主要内容 JMeter安装 WebDriver安装 一个简单的JMeter+WebDriver示例 环境与参考 jvm版本: 1.8.0_65 j ...

- Firedac 数据连接池的应用

procedure TForm2.Button1Click(Sender: TObject); begin if not FDConnection1.Connected then FDConnecti ...

- Spring Cloud(Dalston.SR5)--Eureka 服务提供者

要使微服务应用向注册中心发布自己,首先需要在 pom.xml 配置文件中增加对 spring-boot-starter-eureka 的依赖,然后在主类中增加 @EnableDiscoveryClie ...

- mybatis源码阅读心得

第一天阅读源码及创建时序图.(第一次用prosson画时序图,挺丑..) 1. 调用 SqlSessionFactoryBuilder 对象的 build(inputStream) 方法: 2. ...

- 微信h5支付demo微信H5支付demo非微信浏览器支付demo微信wap支付

服务项目 新手技术咨询 企业技术咨询 定制开发 服务说明 QQ有问必答 QQ.微信.电话 微信开发.php开发,网站开发,系统定制,小程序开发 价格说明 200元/月 1000/月 商议 ...

- 黄聪:WordPress 启用HTTPS设置(转)

HTTPS已经成为网站的一种趋势,得益于数以万计的开发者和百万计的玩家,Wordpress启用HTTPS过程相当简单.下面就把Wordpress启用HTTPS访问的过程记录一下,以供参考. 一. 修改 ...