Hbase数据IO

场景及方案分析

场景1:logs --> HBase

- logs -> flume -> hfile -> import -> HBase (实时)

- csv导入HBase 使用hive 作为临时表csv导入HBase

- tsv导入HBase 直接import 方式1

场景2:RDBMS --> HBase

- RDBMS -> sqoop -> Hfile -> import -> HBase (非实时) 方式1

- RDBMS -> JDBC -> Put API -> HBase (实时较高,纯手写,较常用,因为需要过滤处理) 方式3

- RDBMS -> Stome -> HBase (实时)

- RDBMS -> Spark -> HBase (实时)

场景3:集群性能测试

- 自己写多线程并发程序(),测试读写速度

场景4:HBase -> RDBMS

三种方式

1.Using the HBase Put API

使用Put API import,缺点:数据保存在内存中,大数据量处理速度慢,数据缺少过滤

HADOOP_CLASSPATH=`$HBASE_HOME/bin/hbase mapredcp` \

$HADOOP_HOME/bin/yarn jar \

$HBASE_HOME/lib/hbase-server-1.2.0-cdh5.12.0.jar \

importtsv \

-Dimporttsv.columns=HBASE_ROW_KEY,info:name,info:sex,info:age \

user_from_tsv \

/user/cen/data/hbase_import_user.tsv

2.Using the HBase bulk load tool

使用MapReduce存储成HBase底层文件,优点,减少HBase集群插入压力(不经过插入),降低Job集群时间提高运行速度

# 跟上述命令不用的是,这个导入并不会将数据导入到HBase而是到一个指定的文件夹

# 使用import生成Hfile文件到HDFS,底层通过MapReduce(只有Map)实现

HADOOP_CLASSPATH=`$HBASE_HOME/bin/hbase mapredcp`:${HBASE_HOME}/conf \

$HADOOP_HOME/bin/yarn jar \

$HBASE_HOME/lib/hbase-server-1.2.0-cdh5.12.0.jar \

importtsv \

-Dimporttsv.columns=HBASE_ROW_KEY,info:name,info:sex,info:age \

-Dimporttsv.bulk.output=/user/cen/hbase/hfileoutput \

user_from_tsv_bulk \

/user/cen/data/hbase_import_user.tsv

# 加载数据(非MapReduce),相当于移动数据

HADOOP_CLASSPATH=`$HBASE_HOME/bin/hbase mapredcp`:${HBASE_HOME}/conf \

$HADOOP_HOME/bin/yarn jar \

$HBASE_HOME/lib/hbase-server-1.2.0-cdh5.12.0.jar \

completebulkload \

/user/cen/hbase/hfileoutput \

user_from_tsv_bulk

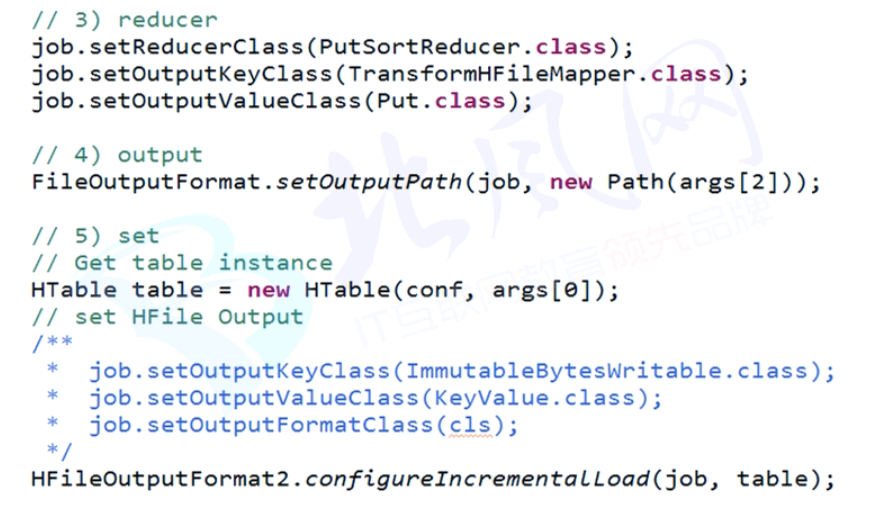

3.Using a customized MapReduce job

自定义 MapReduce Job 优点:前所未有的自由度,缺点:我有一句mmp不知当讲不当讲

a.mapreduce

csv -> hfile

b.bulk load

hfile -> table

Hbase数据IO的更多相关文章

- HBase数据存储格式

好的数据结构,对于检索数据,插入数据的效率就会很高. 常见的数据结构 B+树 根节点和枝节点非常easy,分别记录每一个叶子节点的最小值,并用一个指针指向叶子节点. 叶子节点里每一个键值都指向真正的 ...

- HBase 数据迁移方案介绍

一.前言 HBase数据迁移是很常见的操作,目前业界主要的迁移方式主要分为以下几类: 图1.HBase数据迁移方案 从上面图中可看出,目前的方案主要有四类,Hadoop层有一类,HBase层有三类.下 ...

- HBase 数据迁移方案介绍 (转载)

原文地址:https://www.cnblogs.com/ballwql/p/hbase_data_transfer.html 一.前言 HBase数据迁移是很常见的操作,目前业界主要的迁移方式主要分 ...

- 大数据-05-Spark之读写HBase数据

本文主要来自于 http://dblab.xmu.edu.cn/blog/1316-2/ 谢谢原作者 准备工作一:创建一个HBase表 这里依然是以student表为例进行演示.这里假设你已经成功安装 ...

- 大数据应用之HBase数据插入性能优化实测教程

引言: 大家在使用HBase的过程中,总是面临性能优化的问题,本文从HBase客户端参数设置的角度,研究HBase客户端数据批量插入性能优化的问题.事实胜于雄辩,数据比理论更有说服力,基于此,作者设计 ...

- Hadoop生态圈-使用MapReduce处理HBase数据

Hadoop生态圈-使用MapReduce处理HBase数据 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 一.对HBase表中数据进行单词统计(TableInputFormat) ...

- Bulk Load-HBase数据导入最佳实践

一.概述 HBase本身提供了非常多种数据导入的方式,通常有两种经常使用方式: 1.使用HBase提供的TableOutputFormat,原理是通过一个Mapreduce作业将数据导入HBase 2 ...

- 使用MapReduce读取HBase数据存储到MySQL

Mapper读取HBase数据 package MapReduce; import org.apache.hadoop.hbase.Cell; import org.apache.hadoop.hba ...

- SparkSQL读取HBase数据

这里的SparkSQL是指整合了Hive的spark-sql cli(关于SparkSQL和Hive的整合,见文章后面的参考阅读). 本质上就是通过Hive访问HBase表,具体就是通过hive-hb ...

随机推荐

- SAP HANA Hint简介

我发现Google和百度上关于HANA DB Hint的中文介绍比较少,所以就写了这一篇.本文部分内容来自SAP note 2142945 – FAQ: SAP HANA Hints. 什么是SAP ...

- OC 构造方法

#import <Foundation/Foundation.h> @interface Student : NSObject { int _age; int _no; } - (void ...

- 【洛谷5309】[Ynoi2012] D1T1(分块)

点此看题面 大致题意: 两种操作,区间求和,将形如\(ax+y\)的位置的元素值加\(z\). 分块 这种题目显然就是按照\(x\)与\(\sqrt n\)的大小关系来分块. 对于\(x>\sq ...

- Linux云主机 监控方案浅析

1.为何需要监控 监控是运维工程师的眼睛,它可帮助运维工程师第一时间发现系统的问题. 对于服务器的整个生命周期,都要和监控打交道: 当有服务器上架,都需要加入比如CPU负载.内存.网络.磁盘等基础监控 ...

- ThreadLocal 例子

/** * 一个ThreadLocal代表一个变量,故其中里只能放一个数据,有两个变量都要线程内共享,则要定义两个ThreadLocal. */ public class ThreadLocalTes ...

- 无法解析的外部符号 _WinMain@16,该符号在函数 ___tmainCRTStartup 中被引用

一,问题描述MSVCRTD.lib(crtexew.obj) : error LNK2019: 无法解析的外部符号 _WinMain@16,该符号在函数 ___tmainCRTStartup 中被引用 ...

- AOE网络的关键路径问题

关于AOE网络的基本概念可以参考<数据结构>或者search一下就能找到,这里不做赘述. 寻找AOE网络的关键路径目的是:发现该活动网络中能够缩短工程时长的活动,缩短这些活动的时长,就可以 ...

- response.Close、response.End、response.Flush区别

今天在做文件下载功能用到的是response的方法,首先我们要了解这些方法的作用. 1.response.write():将信息写入http响应输出流. 2.response.Flush:向客户端发送 ...

- 自定义AngularJS中的services服务

<!DOCTYPE html><html><head><meta http-equiv="Content-Type" content=&q ...

- 菜鸟笔记 -- Chapter 4.7 代码注释与编码规范

4.7 代码注释与编码规范 在程序代码中适当的添加注释可以提高程序的可读性和可维护性.好的编码规范可以使程序更易阅读和理解.下面我们将介绍几种代码注释,以及应该注意的编码规范. 4.7.1 代码注释 ...