spark环境安装

源码包下载:

http://archive.apache.org/dist/spark/spark-2.1.1/v

集群环境:

master 192.168.1.99

slave1 192.168.1.100

slave2 192.168.1.101

下载安装包:

# Master

wget http://archive.apache.org/dist/spark/spark-2.1.1/spark-2.1.1-bin-hadoop2.7.tgz -C /usr/local/src

wget https://downloads.lightbend.com/scala/2.11.8/scala-2.11.8.tgz -C /usr/local/src

tar -zxvf spark-2.1.-bin-hadoop2..tgz

tar -zxvf scala-2.11.8.tgz

mv spark-2.1.-bin-hadoop2. /usr/local/spark

mv scala-2.11.8 /usr/local/scala

修改配置文件:

cd /usr/local/spark/conf

vim spark-env.sh

export SCALA_HOME=/usr/local/scala

export JAVA_HOME=/usr/local/jdk1.8.0_181

export HADOOP_HOME=/usr/local/hadoop

export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop

SPARK_MASTER_IP=master

SPARK_LOCAL_DIRS=/usr/local/spark

SPARK_DRIVER_MEMORY=1G

vim slaves

slave1

salve2

配置环境变量:

#Master slave1 slave2

vim ~/.bashrc

SPARK_HOME=/usr/local/spark

PATH=$PATH:$SPARK_HOME/bin #刷新环境变量

source ~/.bashrc

拷贝安装包:

scp -r /usr/local/spark root@slave1:/usr/local/spark

scp -r /usr/local/spark root@slave2:/usr/local/spark scp -r /usr/local/scala root@slave1:/usr/local/scala

scp -r /usr/local/scala root@slave2:/usr/local/scala

启动集群:

/usr/local/spark/sbin/start-all.sh

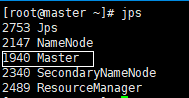

集群状态:

#Master

#slave1

#slave2

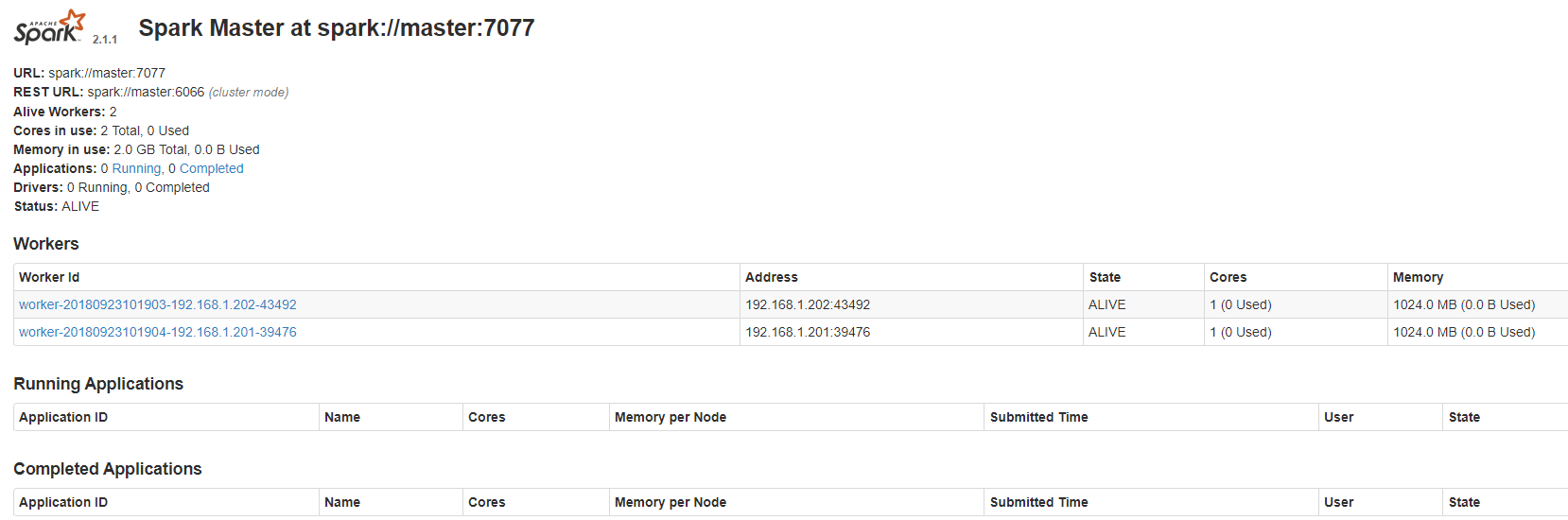

监控网页:

http://master:8080

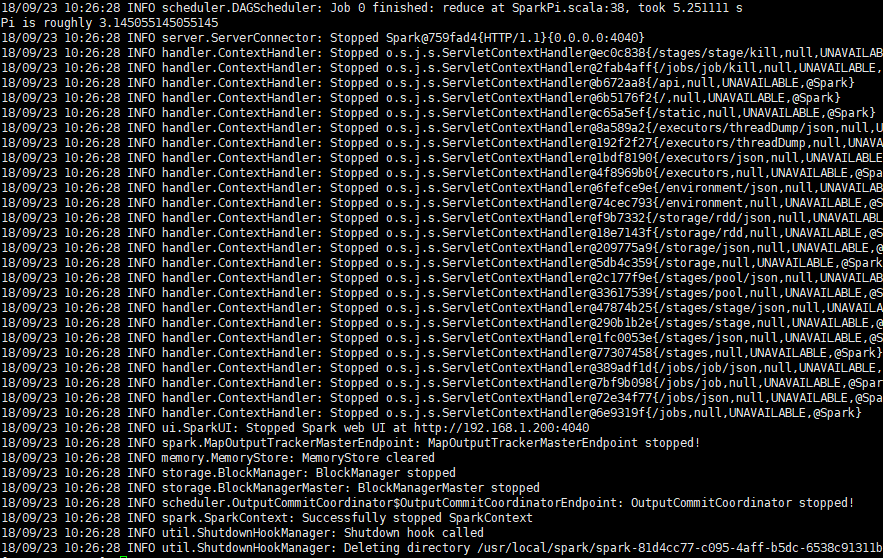

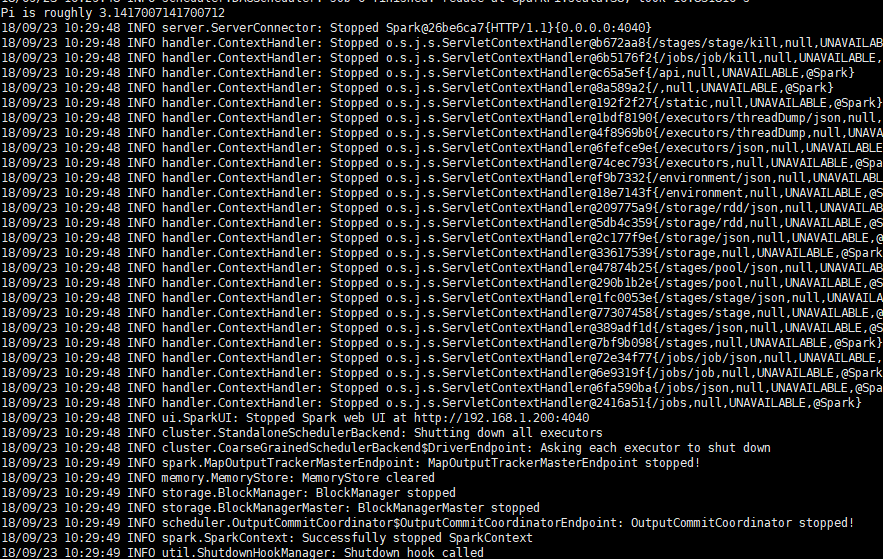

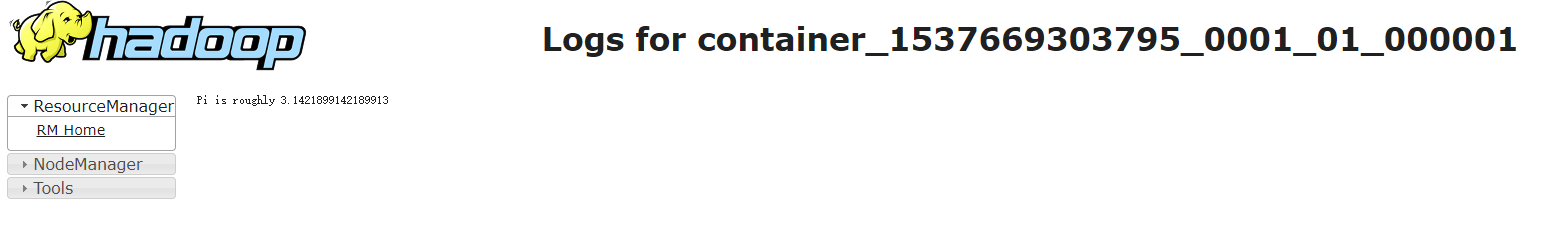

验证:

spark-submit --class org.apache.spark.examples.SparkPi --master yarn-cluster /usr/local/spark/examples/jars/spark-examples_2.11-2.1.1.jar 100

spark环境安装的更多相关文章

- 详解 jupyter notebook 集成 spark 环境安装

来自: 代码大湿 代码大湿 1 相关介绍 jupyter notebook是一个Web应用程序,允许你创建和分享,包含活的代码,方程的文件,可视化和解释性文字.用途包括:数据的清洗和转换.数值模拟.统 ...

- 手工命令行 搭建 hadoop 和 spark 环境

环境准备:3台CentOS7,64位,Hadoop2.7需要64位Linux 192.168.20.161 192.168.20.162 192.168.20.163 三台机器分别叫host01. ...

- Windows下安装Spark环境

根据博客总结 https://blog.csdn.net/nxw_tsp/article/details/78281533 需要的安装软件可以在网盘下载: 链接:https://pan.baidu.c ...

- hadoop环境的安装 和 spark环境的安装

hadoop环境的安装1.前提:安装了java spark环境的安装1.前提:安装了java,python2.直接pip install pyspark就可以安装完成.(pip是python的软件安装 ...

- Mac OSX系统中Hadoop / Hive 与 spark 的安装与配置 环境搭建 记录

Mac OSX系统中Hadoop / Hive 与 spark 的安装与配置 环境搭建 记录 Hadoop 2.6 的安装与配置(伪分布式) 下载并解压缩 配置 .bash_profile : ...

- Spark——Standalone 环境安装及简单使用

Standalone 环境安装 将 spark-3.0.0-bin-hadoop3.2.tgz 文件解压缩在指定位置(/opt/module) tar -zxvf spark-3.0.0-bin-ha ...

- Hive On Spark环境搭建

Spark源码编译与环境搭建 Note that you must have a version of Spark which does not include the Hive jars; Spar ...

- Spark入门实战系列--2.Spark编译与部署(下)--Spark编译安装

[注]该系列文章以及使用到安装包/测试数据 可以在<倾情大奉送--Spark入门实战系列>获取 .编译Spark .时间不一样,SBT是白天编译,Maven是深夜进行的,获取依赖包速度不同 ...

- 在MacOs上配置Hadoop和Spark环境

在MacOs上配置hadoop和spark环境 Setting up Hadoop with Spark on MacOs Instructions 准备环境 如果没有brew,先google怎样安装 ...

随机推荐

- jquery 获取当前时间加180天

<%@ page language="java" contentType="text/html; charset=UTF-8" pageEncoding= ...

- BNU4206:单向行走

给定一个m*n的矩阵,请写一个程序计算一条从左到右走过矩阵且权和最小的路径.一条路径可以从第1列的任意位置出发,到达第n列的任意位置.每一步只能从第i列走到第i+1列的同一行或者相邻行(第一行和最后一 ...

- 注册和删除Apache服务器的方法

Apache服务器的安装和卸载方法 下载Apache安装包 将Apache文件夹存在桌面或其他盘,输入cmd打开命令提示行 安装步骤:进入Apache安装目录下的bin目录: cd C:\Us ...

- android基础---->发送和接收短信

收发短信应该是每个手机最基本的功能之一了,即使是许多年前的老手机也都会具备这项功能,而Android 作为出色的智能手机操作系统,自然也少不了在这方面的支持.今天我们开始自己创建一个简单的发送和接收短 ...

- c# Sockect 通信

1.Server using System; using System.Collections.Generic; using System.Text; //添加Socket类 using System ...

- windows系统常用软件及配置介绍

常用工具 ,,,, 开发工具 ,,, 快捷键 ... 等等 vvv 等等

- Linux系统下 MongoDB安装搭建

1.下载linux的mongodb 2.在目录usr/local下创建文件夹mongodb,把安装包解压到该文件夹中 # mkdir mongodb # tar -zxvf mongodb-3.4.2 ...

- Redis快速起步及Redis常用命令大全

本系列教程内容提要 Java工程师之Redis实战系列教程教程是一个学习教程,是关于Java工程师的Redis知识的实战系列教程,本系列教程均以解决特定问题为目标,使用Redis快速解决在实际生产中的 ...

- hello gradle

首先下载和安装gradle可以参考官网下载地址,建议下载带有源码和文档的,以便后期查阅. 下载完以后打开终端输入gradle -v有如下信息输出,表示安装成功: bogon:gradle scott$ ...

- ZOJ 3469Food Delivery(区间DP)

Food Delivery Time Limit: 2 Seconds Memory Limit: 65536 KB When we are focusing on solving prob ...