python 使用selenium模块实现自动搜索百度百科词条(模拟人工搜索)

目标:模拟人工搜索百度百科词条,爬取相关信息,自动删除上一个关键词,输入新关键词,继续搜索,直到循环结束。

代码:

from selenium import webdriver

from selenium.webdriver.common.keys import Keys

import time

from bs4 import BeautifulSoup univs = ['清华大学', '不知道大学', '北京大学']

AllUnivInfolist = [] browser = webdriver.Firefox() # 创建一个浏览器对象,这里还可以使用chrome等浏览器

try:

browser.get('https://baike.baidu.com/') # 打开百科

for univ in univs:

browser.find_element_by_id('query').send_keys(univ) # 找到输入框输入字段

time.sleep(3)

browser.find_element_by_id('search').send_keys(Keys.ENTER) # 找到搜索按钮模拟点击

time.sleep(3)

html = browser.page_source # 获取html页面

soup = BeautifulSoup(html, 'html.parser') # beautifulsoup库解析html title = soup.find_all('dt', class_="basicInfo-item name") # key

node = soup.find_all('dd', class_="basicInfo-item value") # value allunivinfo = []

titlelist = []

infolist = [] for i in title: # 将所有dt标签内容存入列表

title = i.get_text()

titlelist.append(title)

for i in node: # 将所有dd标签内容存入列表

info = i.get_text()

infolist.append(info)

for i, j in zip(titlelist, infolist): # 多遍历循环,zip()接受一系列可迭代对象作为参数,将对象中对应的元素打包成一个个tuple(元组),然后返回由这些tuples组成的list(列表)。

info = ''.join((str(i) + ':' + str(j)).split())

allunivinfo.append(info)

AllUnivInfolist.append(allunivinfo)

# 模拟ctrl+a 操作 全选输入框内容

browser.find_element_by_id('query').send_keys(Keys.CONTROL, 'a')

time.sleep(3)

# 删除输入框内容 (删除操作 模拟键盘的Backspace)

browser.find_element_by_id('query').send_keys(Keys.BACK_SPACE)

time.sleep(3) finally:

browser.quit() with open("AllUnivInfo.txt", "wt", encoding='utf8') as out_file:

for u in AllUnivInfolist:

out_file.write(str(u)+'\n')

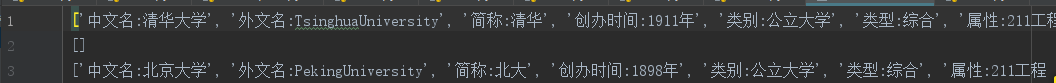

运行结果(部分):

python 使用selenium模块实现自动搜索百度百科词条(模拟人工搜索)的更多相关文章

- python简单爬虫 用beautifulsoup爬取百度百科词条

目标:爬取“湖南大学”百科词条并处理数据 需要获取的数据: 源代码: <div class="basic-info cmn-clearfix"> <dl clas ...

- python使用selenium,webdriver自动下载百度网盘内容

想实现一个自动下载微信公众号分享百度网盘图片链接的爬虫,使用selenium和火狐的webdriver进行完成 1.首先根据自己的浏览器下载相应的webdriver驱动器,python中导入selen ...

- Python学习--Selenium模块学习(2)

Selenium的基本操作 获取浏览器驱动寻找方式 1. 通过手动指定浏览器驱动路径2. 通过 `$PATH`环境变量找寻浏览器驱动 可参考Python学习--Selenium模块简单介绍(1) 控制 ...

- Python学习--Selenium模块

1. Python学习--Selenium模块介绍(1) 2.Python学习--Selenium模块学习(2) 其他: 1. Python学习--打码平台

- Python 爬虫实例(爬百度百科词条)

爬虫是一个自动提取网页的程序,它为搜索引擎从万维网上下载网页,是搜索引擎的重要组成.爬虫从一个或若干初始网页的URL开始,获得初始网页上的URL,在抓取网页的过程中,不断从当前页面上抽取新的URL放入 ...

- python+selenium+chrome实现自动登录百度

#python3.4+selenium3.5+chrome版本 63.0.3239.132+chrome驱动chromedriver.exe #实现自动登录百度 from selenium impor ...

- Python爬虫——selenium模块

selenium模块介绍 selenium最初是一个测试工具,而爬虫中使用它主要是为了解决requests无法直接执行JavaScript代码的问题 selenium本质是通过驱动浏览器,完全模拟浏览 ...

- Python中Selenium模块的使用

目录 Selenium的介绍.配置和调用 Selenium的配置 Selenium的调用 Selenium的使用 定位 定位元素的使用 定位下拉标签元素 在iframe框架之间切换 上传文件 Webd ...

- python 使用selenium模块爬取同一个url下不同页的内容(浏览器模拟人工翻页)

页面翻页,下一页可能是一个新的url 也有可能是用js进行页面跳转,url不变,解决方法是实现浏览器模拟人工翻页 目标:爬取同一个url下不同页的数据(上述第二种情况) url:http://www. ...

随机推荐

- Servlet使用注解配置URl提示404错误

刚接触servlet 3.0,使用注释描述servlet @WebServlet(name="FirstServlet", urlPatterns="/FirstServ ...

- java 反射的简介

https://blog.csdn.net/sinat_38259539/article/details/71799078

- docker入门实例

Docker 是什么? 我们在理解 Docker 之前,首先得先区分清楚两个概念,容器和虚拟机. 每台虚拟机都需要有自己的操作系统,虚拟机一旦被开启,预分配给它的资源将全部被占用. 每一台虚拟机包括应 ...

- suse源

zypper addrepo -f http://mirrors.vbi.vt.edu/mirrors/linux/opensuse/discontinued/distribution/11.4/re ...

- xls文件导入数据库

protected void btn_ok_Click(object sender, EventArgs e) { int num = 0; ...

- java程序可以跨平台运行的原因

java有虚拟机(JVM),JAVA程序不是直接在电脑上运行的,是在虚拟机上进行的,每个系统平台都是有自己的虚拟机(JVM),所以JAVA语言能跨平台. 1, java代码不是直接运行在CPU上,而是 ...

- 【改】利用ALSA库进行音频重采样

转自:http://www.voidcn.com/article/p-snamarwr-p.html 一.ALSA介绍: 1.简介: 高级Linux声音体系(英语:Advanced LinuxSoun ...

- app在admin中显示成我们想要的中文名

在django的开发中,很多时候我们希望app在admin中显示成我们想要的中文名,而不是显示默认的app_label名称. 比如我们有一个blog应用,在我们的blog app目录下面,默认会生成一 ...

- mtcnn

1.widerface样本标签处理 图片名 x1 y1 x2 y2 x11 y11 x22 y22 多人脸框 # -*- coding: utf- -*- ""&qu ...

- Python面向对象 -- 继承和多态、获取对象信息、实例属性和类属性

继承和多态 继承的好处: 1,子类可以使用父类的全部功能 2,多态:当子类和父类都存在相同的方法时,子类的方法会覆盖父类的方法,即调用时会调用子类的方法.这就是继承的另一个好处:多态. 多态: 调用方 ...