卷积神经网络(CNN)的理解与总结

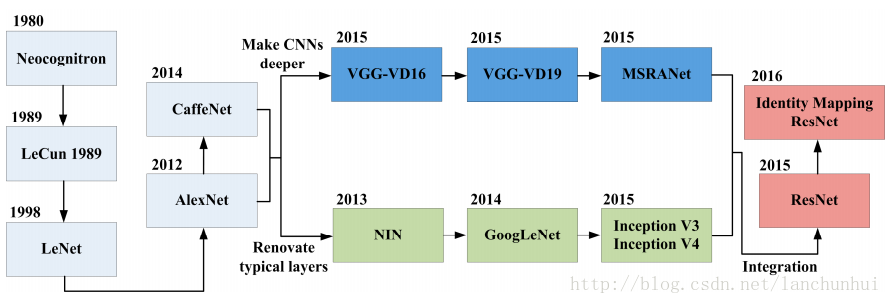

卷积神经网络模型的历史演化:

0. 核心思想

- two main ideas:

- use only local features

- 在不同位置上使用同样的特征;

- 池化层的涵义在于,更高的层次能捕捉图像中更大的范围和区域;

1. feature map

依然是 feature map(特征映射),再次可见,深度神经网络其实就是一种 feature learning 框架。

如何获取一幅图像(输入图像)的特征映射(将原始图像映射到其特征空间中):

- 用一个线性滤波器(linear filter)对输入图像进行卷积,

- 加上一定的 bias

- 将一个非线性函数应用在 卷积+bias 的结果上;

数学的方式描述如下:

将给定层对应的 feature map 记为 h(k)(也即任一层都可能存在多重 feature maps,以便获得更为丰富的特征表示,{h(k),k=0,…,K}),它们(h(k),feature maps)各自对应的滤波器由权值矩阵 W(k) 和 bias b(k) 确定:

2. 卷积操作实战

二维卷积算子接口所在:

- theano.tensor.nnet.conv.conv2d:最常使用;

- theano.tensor.signal.conv2d:只作用在单 channel 的输入上

这两个函数接收两个符号输入:

input:4D 的 tensor,各个维度分别对应于,

- mini-batch

- number of input feature maps,比如一副彩色图像,对应着 3 个色彩通道(RGB)

- image height

- image width

weight Matrix W,其维度为:

- number of feature maps at layer m(后一层)

- number of feature maps at layer m-1(前一层)

- filter height

- filter width

import numpy as np

import theano.tensor as T

from theano.tensor.nnet import conv

rng = np.random.RandomState(23455);

inpt = T.sensor4(name='inpt')

W_shp = (2, 3, 9, 9) # 第一维是 2,表示下一层的 map 数,

# 第二维是 3,表示前一层的 map 是三(也就是 RGB),

W_bound = np.sqrt(3*9*9)

W = theano.shared(

np.asarray(

rng.uniform(

low=-1./W_bound,

high=1./W_bound,

size=W_shp,

)

dtype=theano.config.floatX

), name='W'

)

b_shp = (2, ) # 下一层的 maps 数

b = theano.shared(np.asarray(rng.uniform(low=-.5, high=.5, size=b_shp), dtype=theano.config.floatX), name='b')

conv_out = conv.conv2d(inpt, W)

output = T.nnet.sigmoid(conv_out + b.dimshuffle('x', 0, 'x', 'x')) # b 从 (2, ) ⇒ (1, 2, 1, 1)

f = theano.function([inpt], output)3. maxpooling

max-pooling 本质上是一种非线性的降采样(down-sampling)。Maxpooling 机制将输入图像划分为不重叠的矩形区域,对于每一个子区域,输出其中的最大值。

maxpooling 之所以能在计算机视觉中应用基于以下两个原因:

- 通过排除一些不是最大值的点,降低上一层的计算复杂度;

它提供了一种平移不变性(translation invariance)的变换;

maxpooling 具有平移不变性,指的是,执行 maxpooling 之后得到的 feature map,不会因图像的平移而发生改变,而影响后续的处理结果。

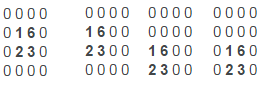

考虑 2*2 的 maxpooling 窗口,对于一个 2*2 的图像子区域,2*2 的图像子区域存在 8 个可行的平移方向(仅移动一个像素),分别是(上下左右,左上右上左下右下),此时针对这 8 种情况下,如下图:

只有右侧的三种情况,会使在原有位置上(中心的 4 个点)执行 maxpooling 后获得的最大值和未发生平移变化之前的是一致的,也即对平移保持不变;

同理对于 3*3 的图像子区域,也是 8 个可以平移的方向,只有其中的 5 个保持平移不变。

卷积神经网络(CNN)的理解与总结的更多相关文章

- 卷积神经网络(CNN)前向传播算法

在卷积神经网络(CNN)模型结构中,我们对CNN的模型结构做了总结,这里我们就在CNN的模型基础上,看看CNN的前向传播算法是什么样子的.重点会和传统的DNN比较讨论. 1. 回顾CNN的结构 在上一 ...

- 【深度学习系列】手写数字识别卷积神经--卷积神经网络CNN原理详解(一)

上篇文章我们给出了用paddlepaddle来做手写数字识别的示例,并对网络结构进行到了调整,提高了识别的精度.有的同学表示不是很理解原理,为什么传统的机器学习算法,简单的神经网络(如多层感知机)都可 ...

- 深度学习之卷积神经网络(CNN)详解与代码实现(一)

卷积神经网络(CNN)详解与代码实现 本文系作者原创,转载请注明出处:https://www.cnblogs.com/further-further-further/p/10430073.html 目 ...

- 【深度学习系列】卷积神经网络CNN原理详解(一)——基本原理

上篇文章我们给出了用paddlepaddle来做手写数字识别的示例,并对网络结构进行到了调整,提高了识别的精度.有的同学表示不是很理解原理,为什么传统的机器学习算法,简单的神经网络(如多层感知机)都可 ...

- 卷积神经网络CNNs的理解与体会

https://blog.csdn.net/shijing_0214/article/details/53143393 孔子说过,温故而知新,时隔俩月再重看CNNs,当时不太了解的地方,又有了新的理解 ...

- 卷积神经网络(CNN)学习笔记1:基础入门

卷积神经网络(CNN)学习笔记1:基础入门 Posted on 2016-03-01 | In Machine Learning | 9 Comments | 14935 Vie ...

- 深度学习方法(五):卷积神经网络CNN经典模型整理Lenet,Alexnet,Googlenet,VGG,Deep Residual Learning

欢迎转载,转载请注明:本文出自Bin的专栏blog.csdn.net/xbinworld. 技术交流QQ群:433250724,欢迎对算法.技术感兴趣的同学加入. 关于卷积神经网络CNN,网络和文献中 ...

- 深度学习之卷积神经网络CNN

转自:https://blog.csdn.net/cxmscb/article/details/71023576 一.CNN的引入 在人工的全连接神经网络中,每相邻两层之间的每个神经元之间都是有边相连 ...

- 深度学习之卷积神经网络CNN及tensorflow代码实例

深度学习之卷积神经网络CNN及tensorflow代码实例 什么是卷积? 卷积的定义 从数学上讲,卷积就是一种运算,是我们学习高等数学之后,新接触的一种运算,因为涉及到积分.级数,所以看起来觉得很复杂 ...

- 深度学习之卷积神经网络CNN及tensorflow代码实现示例

深度学习之卷积神经网络CNN及tensorflow代码实现示例 2017年05月01日 13:28:21 cxmscb 阅读数 151413更多 分类专栏: 机器学习 深度学习 机器学习 版权声明 ...

随机推荐

- Android(Lollipop/5.0) Material Design(四) 创建列表和卡片

Material Design系列 Android(Lollipop/5.0)Material Design(一) 简单介绍 Android(Lollipop/5.0)Material Design( ...

- HDU 1215 七夕节 数学题~

http://acm.hdu.edu.cn/showproblem.php?pid=1215 题目大意: 找对象的题...汗..将你的编号(唯一)的所有因子加起来,所得到的的另一个编号的主人就是你的另 ...

- POJ 3628 Bookshelf 2 0-1背包

传送门:http://poj.org/problem?id=3628 题目看了老半天,牛来叠罗汉- -|||和书架什么关系啊.. 大意是:一群牛来叠罗汉,求超过书架的最小高度. 0-1背包的问题,对于 ...

- LeetCode——Set Matrix Zeroes

Given a m x n matrix, if an element is 0, set its entire row and column to 0. Do it in place. 原题链接:h ...

- swift学习第十二天:类的属性定义

类的属性介绍 Swift中类的属性有多种 存储属性:存储实例的常量和变量 计算属性:通过某种方式计算出来的属性 类属性:与整个类自身相关的属性 存储属性 存储属性是最简单的属性,它作为类实例的一部分, ...

- jquery如何实现动态增加选择框

jquery如何实现动态增加选择框 一.总结 一句话总结:用jquery的clone(true)方法. 1.如何在页面中复制amazeui加了特效的标签? amazeui中的控件带js方法,不知道那部 ...

- object.create(null) 和 {}创建对象的区别

原文 简书原文:https://www.jianshu.com/p/43ce4d7d6151 创建对象的方法 如果要创建一个空的对象,可以使用如下的三种方法 var obj1 = {}; var ob ...

- [CSS] Reduce Ambiguity in Class Names using a Naming Convention

A solid naming convention makes it less likely to run into naming conflicts and helps establish a se ...

- Python 语法细节(Python 2.x 与 Python 3.x 语法差异)

Language differences and workarounds 查询 Python 语言版本: >> import sys >> sys.version '3.5.2 ...

- TF-IDF模型

TF-IDF模型 1. 理论基础 由于数据挖掘所有数据都要以数字形式存在,而文本是以字符串形式存在.所以进行文本挖掘时需要先对字符串进行数字化,从而能够进行计算.TF-IDF就是这样一种技术,能够将字 ...