【深度学习】DNN房价预测

前言

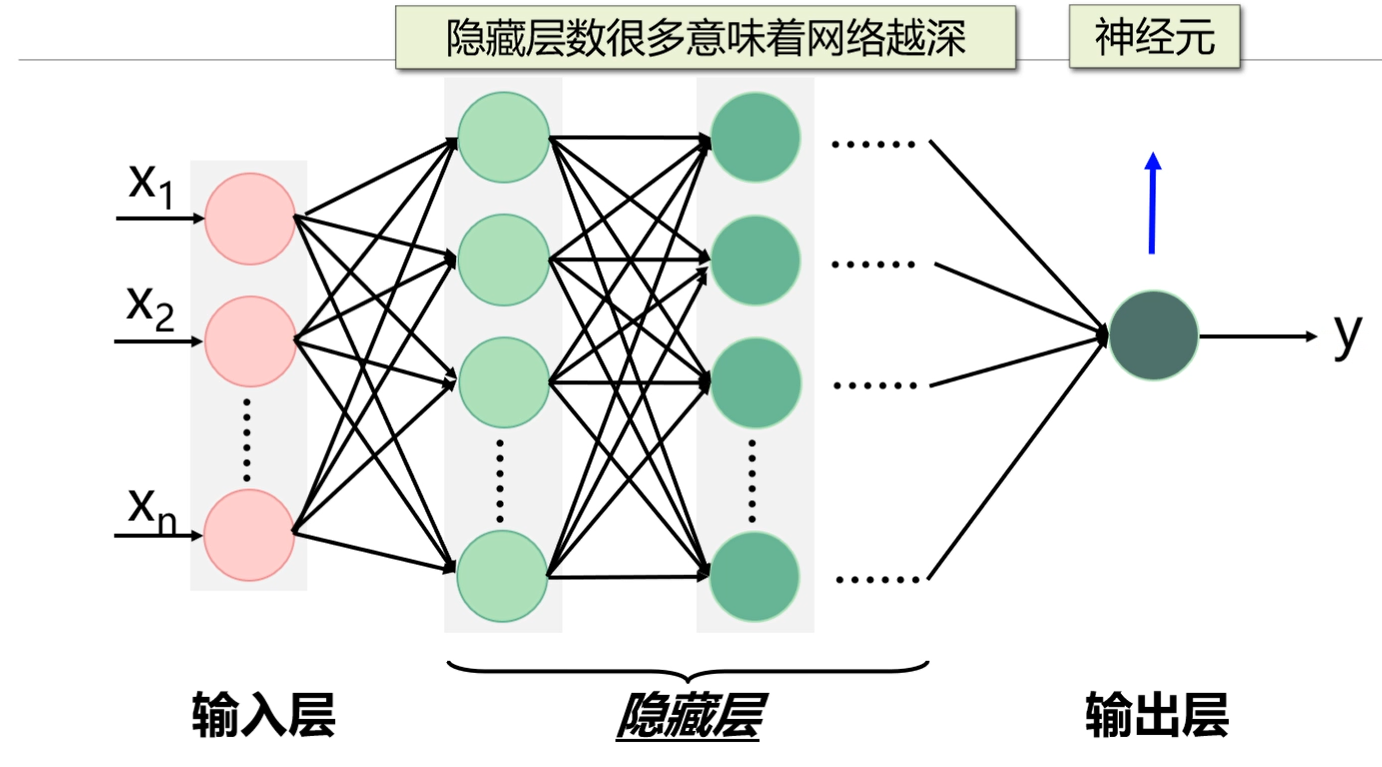

我们使用深度学习网络实现波士顿房价预测,深度学习的目的就是寻找一个合适的函数输出我们想要的结果。深度学习实际上是机器学习领域中一个研究方向,深度学习的目标是让机器能够像人一样具有分析学习的能力,能够识别文字、图像、声音等数据。我认为深度学习与机器学习最主要的区别就是神经元。

深度学习中重要内容

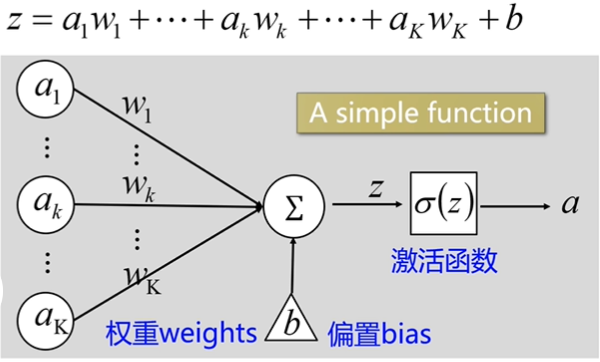

建立模型——神经元

基本构造

- 一个神经元对应一组权重w,a代表输入,我们把输入与权重相乘再相加,再加上偏置b,最后通过激活函得到对应的输出。

- 我们不看激活函数,只看前面的部分会发现其实就是一个线性函数f=kx+b(k表示斜率,b表示截距)

- w和b就是我们需要在训练中需要寻找的,

- 学习网络就是通过很多个这样的神经元组合而成。

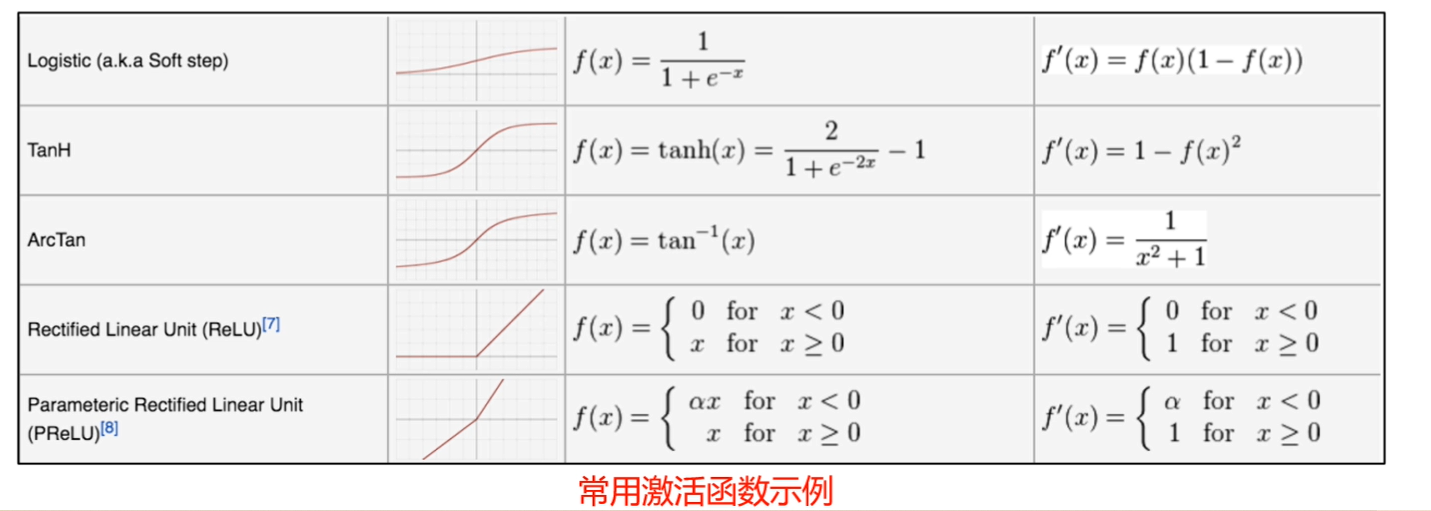

建立模型——激活函数

为什么引入激活函数

- 激活函数是为了增强网络的表达能力,我们需要激活函数来将线性函数转变为非线性函数。

- 非线性的激活函数需要有连续性,因为连续非线性激活函数可导的,所以可以用最优化的方法来求解

激活函数的种类

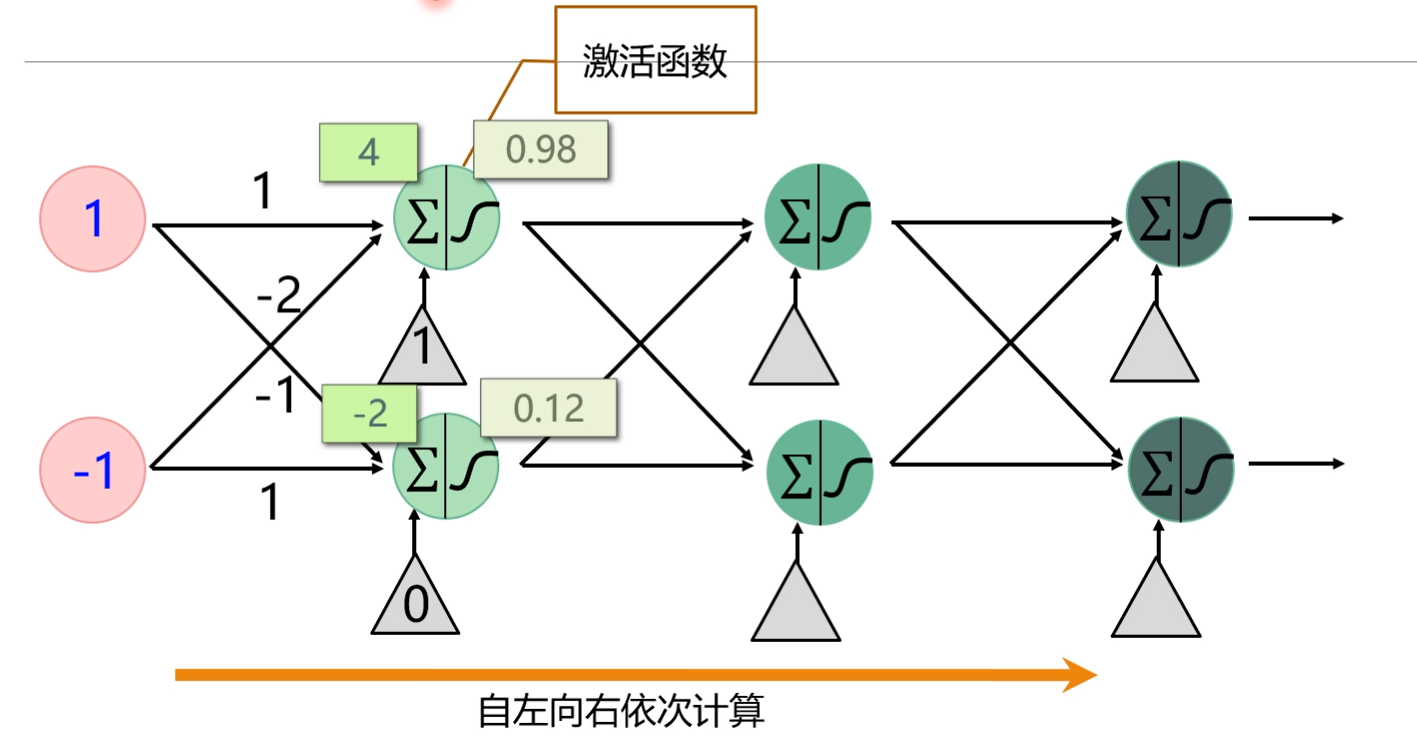

建立模型——前馈神经网络

- 我们输入1和-1分别和每一组的权重相乘相加得到4和-2的结果,然后经过激活函数(激活函数实际上也是一个简单函数,但是具有某些特性,可以用来解决问题的目的,例如激活函数是y=x-1,我们输入4,输出结果就是3。)得到0.98和0.12.依次往后计算就是前馈神经网络。

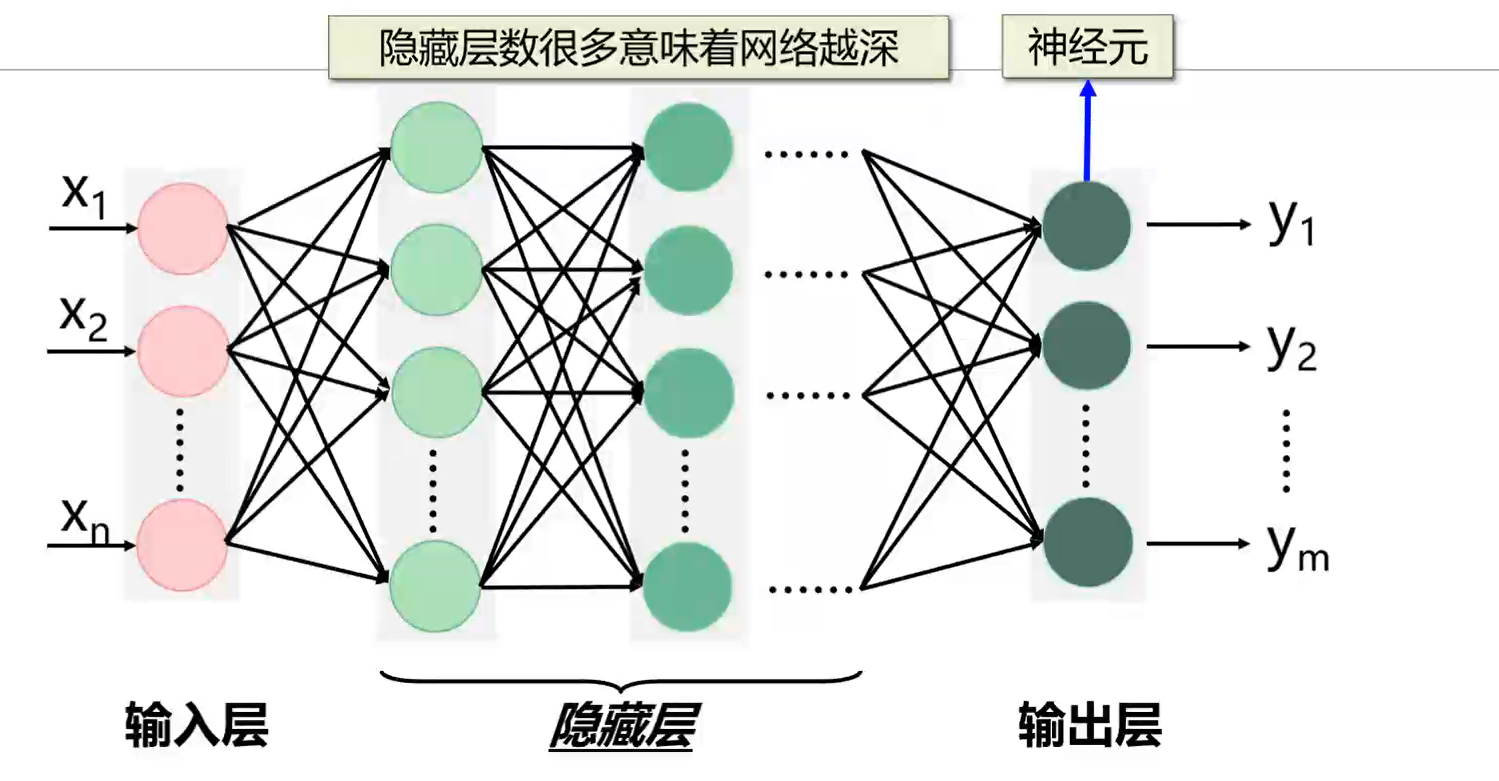

建立模型——深度神经网络

神经网络解决的问题有很多,例如分类、预测、回归等。这里我们给出两个解决类型。

分类

- 输出层就是输入的数据维度,例如我们要分类图形是正方型还是长方形,那我们可以是3维的输入,一个内角,两条临边。就可以判断。也可以是五维的,一个内角,4条边)

- 输出层y就是结果,就上面举例的图形分类,那结果可以有2个,长方形和正方形,例如y1代表长方形,y2代表正方形,输出的结果那个数值大就是那种类型,也可以增加一个都不是的结果)

预测

- 今天的波士顿房价预测就是预测模型,我们通过地段,房屋面积等等,预测房价的多少。

损失函数

- 常用损失函数

平方损失函数、交叉熵损失函数,不同的问题运用不同的损失函数 - 用于衡量我们输入结果和真实结果的差异

- 目的通过损失去修正我们的参数是我们的模型更完美

实践——波士顿房价预测

数据集

使用paddle飞桨波士顿数据集

https://www.paddlepaddle.org.cn/documentation/docs/zh/api/paddle/text/UCIHousing_cn.html

绘图

## 绘图

Batch = 0

Batchs = []

all_train_accs = []

def draw_train_acc(Batchs,train_accs):

title = "training accs"

plt.title(title)

plt.xlabel("batch")

plt.ylabel("acc")

plt.plot(Batchs, train_accs, color = 'green', label = 'training accs')

plt.legend()

plt.grid()

plt.show()

all_train_loss = []

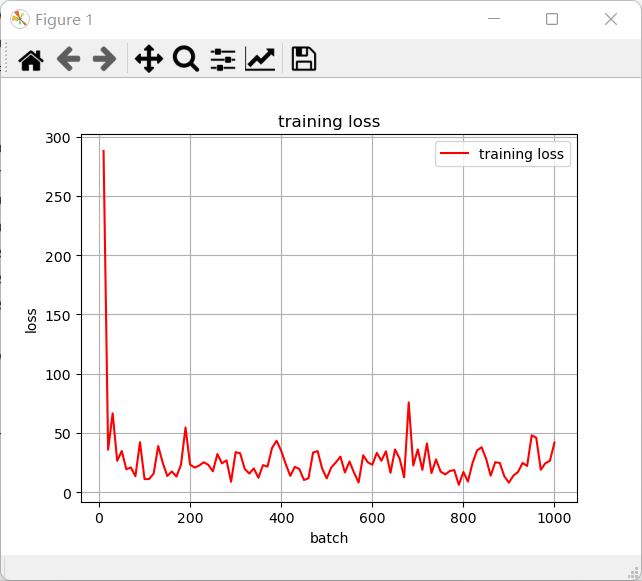

def draw_train_loss(Batchs,train_loss):

title = "training loss"

plt.title(title)

plt.xlabel("batch")

plt.ylabel("loss")

plt.plot(Batchs, train_loss, color = 'red', label = 'training loss')

plt.legend()

plt.grid()

plt.show()

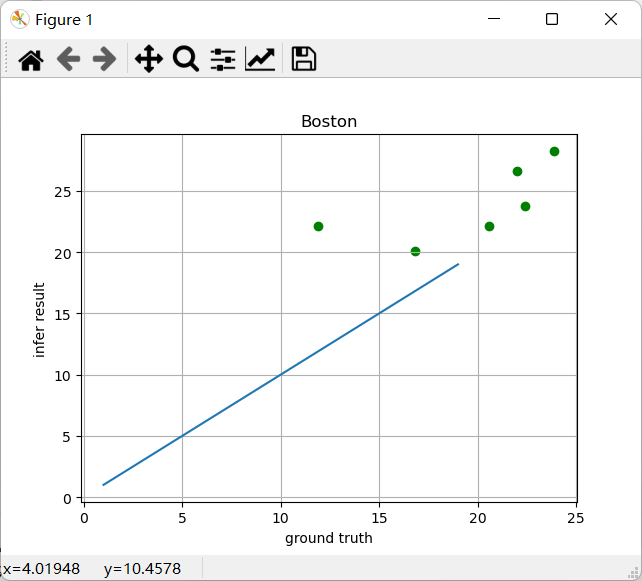

## 绘制真实值与预测值的对比图

def draw_infer_result(groud_truths, infer_results):

title = 'Boston'

plt.title(title)

x = np.arange(1,20)

y = x

plt.plot(x,y);

plt.xlabel("ground truth")

plt.ylabel("infer result")

plt.scatter(groud_truths,infer_results,color='green',label='training cost')

plt.grid()

plt.show()

网络搭建

'''

核心

网络搭建

'''

class MyDNN(paddle.nn.Layer):

def __init__(self):

super(MyDNN, self).__init__()

#self.linear1 = paddle.nn.Linear(13,1,None) #全连接层,paddle.nn.Linear(in_features,out_features,weight)

self.linear1 = paddle.nn.Linear(13, 32, None)

self.linear2 = paddle.nn.Linear(32, 64, None)

self.linear3 = paddle.nn.Linear(64, 32, None)

self.linear4 = paddle.nn.Linear(32, 1, None)

def forward(self, inputs): ## 传播函数

x = self.linear1(inputs)

x = self.linear2(x)

x = self.linear3(x)

x = self.linear4(x)

return x

模型训练与测试

'''

网络训练与测试

'''

## 实例化

model = MyDNN()

model.train()

mse_loss = paddle.nn.MSELoss()

opt = paddle.optimizer.SGD(learning_rate=0.001, parameters=model.parameters())

epochs_num = 100

for epochs in range(epochs_num):

for batch_id,data in enumerate(train_loader()):

feature = data[0]

label = data[1]

predict = model(feature)

loss = mse_loss(predict, label)

loss.backward()

opt.step()

opt.clear_grad()

if batch_id!=0 and batch_id%10 == 0:

Batch = Batch+10

Batchs.append(Batch)

all_train_loss.append(loss.numpy()[0])

print("epoch{},step:{},train_loss:{}".format(epochs,batch_id,loss.numpy()[0]))

paddle.save(model.state_dict(),"UCIHousingDNN")

draw_train_loss(Batchs,all_train_loss)

para_state = paddle.load("UCIHousingDNN")

model = MyDNN()

model.eval()

model.set_state_dict(para_state)

losses = []

for batch_id,data in enumerate(eval_loader()):

feature = data[0]

label = data[1]

predict = model(feature)

loss = mse_loss(predict,label)

losses.append(loss.numpy()[0])

avg_loss = np.mean(losses)

print(avg_loss)

draw_infer_result(label,predict)

代码

## 深度学习框架

import paddle

import numpy as np

import os

import matplotlib.pyplot as plt

## 绘图

Batch = 0

Batchs = []

all_train_accs = []

def draw_train_acc(Batchs,train_accs):

title = "training accs"

plt.title(title)

plt.xlabel("batch")

plt.ylabel("acc")

plt.plot(Batchs, train_accs, color = 'green', label = 'training accs')

plt.legend()

plt.grid()

plt.show()

all_train_loss = []

def draw_train_loss(Batchs,train_loss):

title = "training loss"

plt.title(title)

plt.xlabel("batch")

plt.ylabel("loss")

plt.plot(Batchs, train_loss, color = 'red', label = 'training loss')

plt.legend()

plt.grid()

plt.show()

## 绘制真实值与预测值的对比图

def draw_infer_result(groud_truths, infer_results):

title = 'Boston'

plt.title(title)

x = np.arange(1,20)

y = x

plt.plot(x,y);

plt.xlabel("ground truth")

plt.ylabel("infer result")

plt.scatter(groud_truths,infer_results,color='green',label='training cost')

plt.grid()

plt.show()

'''

数据集加载

'''

train_dataset = paddle.text.datasets.UCIHousing(mode="train")

eval_dataset = paddle.text.datasets.UCIHousing(mode="test")

train_loader = paddle.io.DataLoader(train_dataset,batch_size=32, shuffle=True)

eval_loader = paddle.io.DataLoader(eval_dataset,batch_size=8,shuffle=False)

print(train_dataset[1])

'''

核心

网络搭建

'''

class MyDNN(paddle.nn.Layer):

def __init__(self):

super(MyDNN, self).__init__()

#self.linear1 = paddle.nn.Linear(13,1,None) #全连接层,paddle.nn.Linear(in_features,out_features,weight)

self.linear1 = paddle.nn.Linear(13, 32, None)

self.linear2 = paddle.nn.Linear(32, 64, None)

self.linear3 = paddle.nn.Linear(64, 32, None)

self.linear4 = paddle.nn.Linear(32, 1, None)

def forward(self, inputs): ## 传播函数

x = self.linear1(inputs)

x = self.linear2(x)

x = self.linear3(x)

x = self.linear4(x)

return x

'''

网络训练与测试

'''

## 实例化

model = MyDNN()

model.train()

mse_loss = paddle.nn.MSELoss()

opt = paddle.optimizer.SGD(learning_rate=0.001, parameters=model.parameters())

epochs_num = 100

for epochs in range(epochs_num):

for batch_id,data in enumerate(train_loader()):

feature = data[0]

label = data[1]

predict = model(feature)

loss = mse_loss(predict, label)

loss.backward()

opt.step()

opt.clear_grad()

if batch_id!=0 and batch_id%10 == 0:

Batch = Batch+10

Batchs.append(Batch)

all_train_loss.append(loss.numpy()[0])

print("epoch{},step:{},train_loss:{}".format(epochs,batch_id,loss.numpy()[0]))

paddle.save(model.state_dict(),"UCIHousingDNN")

draw_train_loss(Batchs,all_train_loss)

para_state = paddle.load("UCIHousingDNN")

model = MyDNN()

model.eval()

model.set_state_dict(para_state)

losses = []

for batch_id,data in enumerate(eval_loader()):

feature = data[0]

label = data[1]

predict = model(feature)

loss = mse_loss(predict,label)

losses.append(loss.numpy()[0])

avg_loss = np.mean(losses)

print(avg_loss)

draw_infer_result(label,predict)

结果展示

【深度学习】DNN房价预测的更多相关文章

- 蛋白质组DIA深度学习之谱图预测

目录 1. 简介 2. 近几年发表的主要工具 1.DeepRT 2.Prosit 3. DIANN 4.DeepDIA 1. 简介 基于串联质谱的蛋白质组学大部分是依赖于数据库(database se ...

- 时尚与深度学习系列:Fashion forward: Forecasting visual style in fashion

https://arxiv.org/pdf/1705.06394.pdf 将深度学习与时尚预测联系在一起,是一个很有趣但是估计结果会没什么成效的话题.因为,时尚预测这一领 ...

- 贝叶斯深度学习(bayesian deep learning)

本文简单介绍什么是贝叶斯深度学习(bayesian deep learning),贝叶斯深度学习如何用来预测,贝叶斯深度学习和深度学习有什么区别.对于贝叶斯深度学习如何训练,本文只能大致给个介绍. ...

- ML平台_微博深度学习平台架构和实践

( 转载至: http://www.36dsj.com/archives/98977) 随着人工神经网络算法的成熟.GPU计算能力的提升,深度学习在众多领域都取得了重大突破.本文介绍了微博引入深度学 ...

- 动手学深度学习17-kaggle竞赛实践小项目房价预测

kaggle竞赛 获取和读取数据集 数据预处理 找出所有数值型的特征,然后标准化 处理离散值特征 转化为DNArray后续训练 训练模型 k折交叉验证 预测样本,并提交结果 kaggle竞赛 本节将动 ...

- 用深度学习(DNN)构建推荐系统 - Deep Neural Networks for YouTube Recommendations论文精读

虽然国内必须FQ才能登录YouTube,但想必大家都知道这个网站.基本上算是世界范围内视频领域的最大的网站了,坐拥10亿量级的用户,网站内的视频推荐自然是一个非常重要的功能.本文就focus在YouT ...

- 深度学习——深度神经网络(DNN)反向传播算法

深度神经网络(Deep Neural Networks,简称DNN)是深度学习的基础. 回顾监督学习的一般性问题.假设我们有$m$个训练样本$\{(x_1, y_1), (x_2, y_2), …, ...

- 基于 Keras 用深度学习预测时间序列

目录 基于 Keras 用深度学习预测时间序列 问题描述 多层感知机回归 多层感知机回归结合"窗口法" 改进方向 扩展阅读 本文主要参考了 Jason Brownlee 的博文 T ...

- Deep-learning augmented RNA-seq analysis of transcript splicing | 用深度学习预测可变剪切

可变剪切的预测已经很流行了,目前主要有两个流派: 用DNA序列以及variant来预测可变剪切:GeneSplicer.MaxEntScan.dbscSNV.S-CAP.MMSplice.clinVa ...

随机推荐

- ExtJS 布局-Accordion布局(Accordion layout)

更新记录: 2022年6月2日 开始. 2022年6月3日 发布. 1.说明 accordion(手风琴)布局一次仅显示一个子组件,内置支持 折叠 和 展开.当需要堆叠多个子组件,并每次只显示一次时, ...

- C#.NET中的程序集版本

更新记录 2022年4月16日:本文迁移自Panda666原博客,原发布时间:2021年8月22日. 在Visual Studio中查看程序集版本 在程序运行中获得程序集版本信息 除了在Visual ...

- Python双人五子棋

这篇文章旨在介绍一个双人的五子棋程序.再次重申,本人不擅长对代码的可读性进行优化,所以可能有些杂乱(在所难免). 先瞅一眼效果图: 请注意,这个棋子--是这么圆润立体!本程序不需任何素材图片,完全用代 ...

- opencv-python保存视频

import cv2 class WVideoManager: def __init__(self, write_path: str, width: int, height: int, FPS: in ...

- SAP Smart Form 无法通过程序自定义默认打印机问题解决

*&---------------------------------------------------------------------* *& Form FRM_SET_PRI ...

- archlinux-小米pro15_2020款使用archlinux(MX350显卡驱动安装)

1.官网下载archlinux ISO镜像 https://archlinux.org/download/ 使用磁力链接下载 2.使用软碟通将镜像写入U盘,制作成U盘启动盘 3.进入BIOS 关掉 ...

- SLF4J 日志门面

目录 01.简单介绍 02.日志级别 03.入门案例 03.动态打印 04.异常打印 05.日志集成 06.集成 logback 07.集成 slf4j-nop 08.集成 log4j 09.集成 j ...

- 关于android sdk中monitor.exe报错的问题

今天又是被坑的一上午.来总结一下: 1. 首先是找不到monitor的问题: 这个可能是一开始环境配置错误.所以我将android sdk重装了一下就好了 2. 第二个是找到monitor.bat发现 ...

- JDK9对集合添加的优化of方法和Debug追踪

JDK9对集合添加的优化(of方法) JDK9的新特性: 1.List接口,Set接口,Map接口:里边增加了一个静态的方法of,可以给集合一次性添加多个元素 2.static List of (E- ...

- Identity Server 4资源拥有者密码认证控制访问API

基于上一篇文章中的代码进行继续延伸,只需要小小的改动即可,不明白的地方可以先看看本人上一篇文章及源码: Identity Server 4客户端认证控制访问API 一.QuickStartIdenti ...