mnist识别优化——使用新的fashion mnist进行模型训练

今天通过论坛偶然知道,在mnist之后,还出现了一个旨在代替经典mnist数据集的Fashion MNIST,同mnist一样,它也是被用作深度学习程序的“hello world”,而且也是由70k张28*28的图片组成的,它们也被分为10类,有60k被用作训练,10k被用作测试。唯一的区别就是,fashion mnist的十种类别由手写数字换成了服装。这十种类别如下:

'T-shirt/top', 'Trouser', 'Pullover', 'Dress', 'Coat','Sandal', 'Shirt', 'Sneaker', 'Bag', 'Ankle boot'

设计流程如下:

· 首先获取数据集,tensorflow获取fashion mnist的方法和mnist类似,使用keras.datasets.fashion_mnist.load_data()即可

· 将数据集划分为训练集和测试集

· 由于图片像素值范围是0-255,将数据集进行预处理,把像素值缩放到0到1的范围(即除以255)

· 搭建网络模型 (784→128(relu)→10(softmax)),全连接

· 编译模型,设计损失函数(对数损失)、优化器(adam)以及训练指标(accuracy)

· 训练模型

· 评估准确性(测试数据使用matplotlib进行可视化)

关于Adam优化器的来源和特点请参考:https://www.jianshu.com/p/aebcaf8af76e

关于matplotlib数据可视化请参考:https://blog.csdn.net/xHibiki/article/details/84866887

训练集部分数据可视化如下:

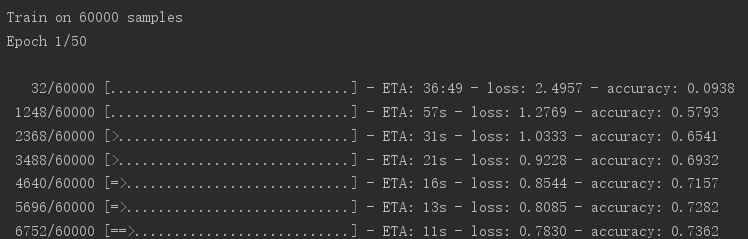

一共做了50轮训练,训练开始时的损失和精度如下:

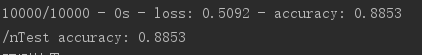

训练完成时的损失和精度如下:

模型在测试集上的表现如下:

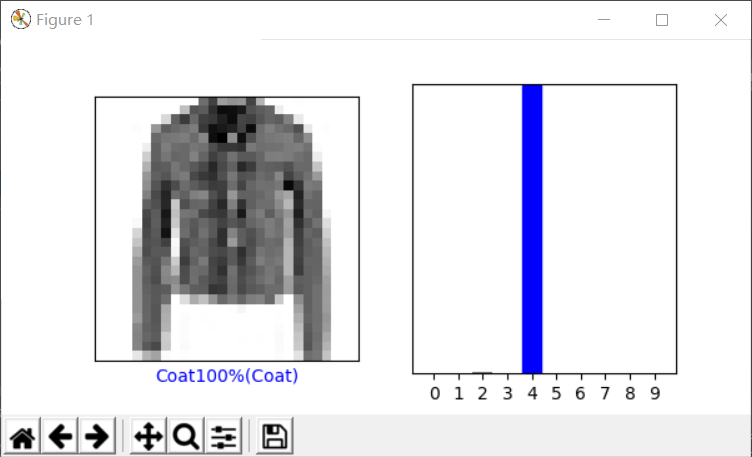

选择测试集某张图片的预测可视化结果如下:

程序代码如下:

import tensorflow as tf

from tensorflow import keras

import numpy as np

import matplotlib.pyplot as plt # 导入fashion mnist数据集

fashion_mnist = keras.datasets.fashion_mnist

(train_images,train_labels),(test_images,test_labels) = fashion_mnist.load_data() # 衣服类别

class_names = ['T-shirt/top','Trouser','Pullover','Dress','Coat','Sandal',

'Shirt','Sneaker','Bag','Ankle boot']

print(train_images.shape,len(train_labels))

print(test_images.shape,len(test_labels)) # 查看图片

plt.figure()

plt.imshow(train_images[0])

plt.colorbar()

plt.grid(False)

plt.show() # 预处理数据,将像素值除以255,使其缩放到0到1的范围

train_images = train_images / 255.0

test_images = test_images / 255.0 # 验证数据格式的正确性,显示训练集前25张图像并注明类别

plt.figure(figsize=(10,10))

for i in range(25):

plt.subplot(5,5,i+1)

plt.xticks([])

plt.yticks([])

plt.grid(False)

plt.imshow(train_images[i],cmap=plt.cm.binary)

plt.xlabel(class_names[train_labels[i]])

plt.show() # 搭建网络结构

model = keras.Sequential([

keras.layers.Flatten(input_shape=(28,28)),

keras.layers.Dense(128,activation='relu'),

keras.layers.Dense(10,activation='softmax')

]) # 设置损失函数、优化器及训练指标

model.compile(

optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy']

) # 训练模型

model.fit(train_images,train_labels,epochs=50) # 模型评估

test_loss,test_acc=model.evaluate(test_images,test_labels,verbose=2)

print('/nTest accuracy:',test_acc) # 选择测试集中的图像进行预测

predictions=model.predict(test_images) # 查看第一个预测

print("预测结果:",np.argmax(predictions[0]))

# 将正确标签打印出来和预测结果对比

print("真实结果:",test_labels[0]) # 以图形方式查看完整的十个类的预测

def plot_image(i,predictions_array,true_label,img):

predictions_array,true_label,img=predictions_array,true_label[i],img[i]

plt.grid(False)

plt.xticks([])

plt.yticks([]) plt.imshow(img,cmap=plt.cm.binary) predicted_label=np.argmax(predictions_array)

if predicted_label==true_label:

color='blue'

else:

color='red' plt.xlabel("{}{:2.0f}%({})".format(class_names[predicted_label],

100*np.max(predictions_array),

class_names[true_label]),

color=color) def plot_value_array(i,predictions_array,true_label):

predictions_array,true_label=predictions_array,true_label[i]

plt.grid(False)

plt.xticks(range(10))

plt.yticks([])

thisplot=plt.bar(range(10),predictions_array,color="#777777")

plt.ylim([0,1])

predicted_label=np.argmax(predictions_array) thisplot[predicted_label].set_color('red')

thisplot[true_label].set_color('blue') i=10

plt.figure(figsize=(6,3))

plt.subplot(1,2,1)

plot_image(i,predictions[i],test_labels,test_images)

plt.subplot(1,2,2)

plot_value_array(i,predictions[i],test_labels)

plt.show()

mnist识别优化——使用新的fashion mnist进行模型训练的更多相关文章

- 人脸检测及识别python实现系列(3)——为模型训练准备人脸数据

人脸检测及识别python实现系列(3)——为模型训练准备人脸数据 机器学习最本质的地方就是基于海量数据统计的学习,说白了,机器学习其实就是在模拟人类儿童的学习行为.举一个简单的例子,成年人并没有主动 ...

- 用标准3层神经网络实现MNIST识别

一.MINIST数据集下载 1.https://pjreddie.com/projects/mnist-in-csv/ 此网站提供了mnist_train.csv和mnist_test.cs ...

- fashion MNIST识别(Tensorflow + Keras + NN)

Fashion MNIST https://www.kaggle.com/zalando-research/fashionmnist Fashion-MNIST is a dataset of Zal ...

- 深度学习常用数据集 API(包括 Fashion MNIST)

基准数据集 深度学习中经常会使用一些基准数据集进行一些测试.其中 MNIST, Cifar 10, cifar100, Fashion-MNIST 数据集常常被人们拿来当作练手的数据集.为了方便,诸如 ...

- NO.3:自学tensorflow之路------MNIST识别,神经网络拓展

引言 最近自学GRU神经网络,感觉真的不简单.为了能够快速跑完程序,给我的渣渣笔记本(GT650M)也安装了一个GPU版的tensorflow.顺便也更新了版本到了tensorflow-gpu 1.7 ...

- 莫烦大大keras学习Mnist识别(4)-----RNN

一.步骤: 导入包以及读取数据 设置参数 数据预处理 构建模型 编译模型 训练以及测试模型 二.代码: 1.导入包以及读取数据 #导入包 import numpy as np np.random.se ...

- TensorFlow+实战Google深度学习框架学习笔记(12)------Mnist识别和卷积神经网络LeNet

一.卷积神经网络的简述 卷积神经网络将一个图像变窄变长.原本[长和宽较大,高较小]变成[长和宽较小,高增加] 卷积过程需要用到卷积核[二维的滑动窗口][过滤器],每个卷积核由n*m(长*宽)个小格组成 ...

- Windows下mnist数据集caffemodel分类模型训练及测试

1. MNIST数据集介绍 MNIST是一个手写数字数据库,样本收集的是美国中学生手写样本,比较符合实际情况,大体上样本是这样的: MNIST数据库有以下特性: 包含了60000个训练样本集和1000 ...

- 吴裕雄 python 神经网络——TensorFlow实现回归模型训练预测MNIST手写数据集

import tensorflow as tf from tensorflow.examples.tutorials.mnist import input_data mnist = input_dat ...

随机推荐

- 关于AR眼镜的小结

根据IDC(International Data Corporation,国际数据公司,IDC是全球著名的信息技术.电信行业和消费科技咨询.顾问和活动服务专业提供商)的报告,2018年AR和VR的产值 ...

- 多用as少用强制类型转换

在 C# 中存在一个名叫静态类型检查的机制,这个机制可以让编译器帮助我们把类型不服的用法找出来,从而使得应用程序在运行期间加少一些类型检查的操作.但是有时候我们还是需要进行运行期类型检查,比如我们在设 ...

- Linux 内存分析工具——free命令

在Linux系统经常被用作服务器系统.当服务器内存吃紧的时候,free命令是我们最常使用的内存分析工具. free使用介绍 free命令可以显示Linux系统中空闲的.已用的物理内存及swap内存,及 ...

- SPH液面重构过程中的问题

使用粒子方法进行流体特效模拟需要进行液面重构,构造出流体的自由表面,液面重构方法也是一个独立的研究方向,针对其的研究已经有了很多成果,包括液面的平滑度.精度和并行效率等. 在这里,主要是记录一下我在液 ...

- Java DTO(data transfer object)的理解

首先明白springboot每层 model层 model层即数据库实体层,也被称为entity层,pojo层. 一般数据库一张表对应一个实体类,类属性同表字段一一对应. Model层是数据层: Ta ...

- Spark RDD基本概念、宽窄依赖、转换行为操作

目录 RDD概述 RDD的内部代码 案例 小总结 转换.行动算子 宽.窄依赖 Reference 本文介绍一下rdd的基本属性概念.rdd的转换/行动操作.rdd的宽/窄依赖. RDD:Resilie ...

- centos6.5安装openLDAP2.3

查看系统版本,内核,定时任务同步时间,关闭防火墙selinux等 [root@ldap-master ~]# cat /etc/redhat-release CentOS release 6.5 (F ...

- 一次压力测试Bug排查-epoll使用避坑指南

Bug复现 使用Webbench对服务器进行压力测试,创建1000个客户端,并发访问服务器10s,正常情况下有接近8万个HTTP请求访问服务器. 结果显示仅有7个请求被成功处理,0个请求处理失败,服务 ...

- iptables详解(8)iptables自定义链

自定义链存在的意义:对链进行分类 target可能是一个“动作“也可能是一个”自定义链” 1.新增自定义链. root@ubuntu:~# iptables -t filter -N IN_WEB#结 ...

- 学习笔记——python(继承)

学习笔记(Python继承) 有几种叫法(父类-子类.基类-派生类)先拿代码演示一下: class father: def work(self): print("work>>&g ...