Class Activation Mapping (CAM)

概

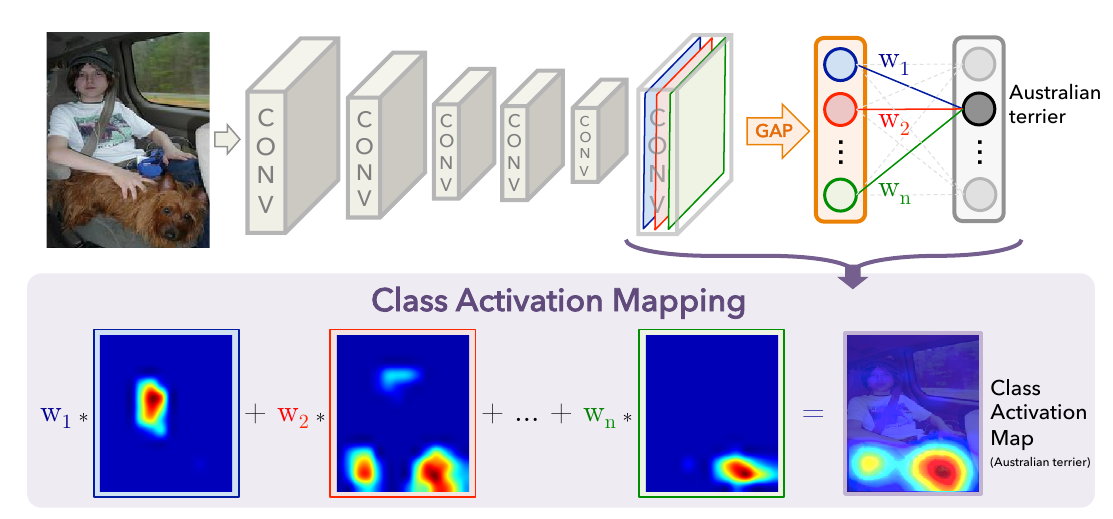

CAM (class activation mapping) 是一种非常实用的可视化方法, 同时在弱监督学习中(如VQA)起了举足轻重的作用.

主要内容

CAM的概念, 用于解释, 为什么神经网络能够这么有效, 而它究竟关注了什么?

| 符号 | 说明 |

|---|---|

| \(f(\cdot)\) | 网络 |

| \(X\) | 网络输入 |

| \(A_l^k\) | 第\(l\)层的第\(k\)张特征图(特指在卷积层中) |

| \(w\) | 权重 |

| \(c\) | 所关心的类别 |

| \(\alpha\) | 用于CAM的权重 |

CAM

最开始的CAM仅用于特殊的CNN: 卷积层 + AvgPool + FC的结构,

设最后一层卷积层的特征图为\(A_L\), 则

\]

进一步可以注意到,

\]

于是可以定义:

\]

这里, \(\alpha = \frac{w}{HW}\).

即

\]

一般, 这种score会最后加个relu:

\]

Grad-CAM

普通的CAM有限制, Grad-CAM在此基础上进行扩展.

\]

\]

注意: \(L \rightarrow l\).

Grad-CAM++

作者认为, Grad-CAM++不能很好应对多个目标的情况, 应该进一步加权:

\]

\]

Score-CAM

作者认为, 利用梯度计算score并不是一个很好的主意.

\]

这里\(X_b\)是一个固定的基准向量, 作者直接取\(f(X_b)=\mathbb{0}\),

\]

为将\(A_l^k\)上采样至和\(X\)相同大小, 并标准化:

\]

使其落于\([0, 1]\).

最后

\(L^c_*\)最后也只是\(H\times W\)的, 需要上采样到和\(X\)一样的大小.

代码

Class Activation Mapping (CAM)的更多相关文章

- pytorch中网络特征图(feture map)、卷积核权重、卷积核最匹配样本、类别激活图(Class Activation Map/CAM)、网络结构的可视化方法

目录 0,可视化的重要性: 1,特征图(feture map) 2,卷积核权重 3,卷积核最匹配样本 4,类别激活图(Class Activation Map/CAM) 5,网络结构的可视化 0,可视 ...

- grad-cam 、cam 和热力图,基于keras的实现

http://bindog.github.io/blog/2018/02/10/model-explanation/ http://www.sohu.com/a/216216094_473283 ht ...

- 在CNN上增加一层CAM告诉你CNN到底关注什么

Cam(Class Activation Mapping)是一个很有意思的算法,他能够将神经网络到底在关注什么可视化的表现出来.但同时它的实现却又如此简介,相比NIN,googLenet这些使用GAP ...

- 凭什么相信你,我的CNN模型

背景 学术界一直困惑的点是"如何让看似黑盒的CNN模型说话",即对它的分类结果给出解释. 这里的解释是指,让模型告诉我们它是通过图片的哪些像素做出判断的,并不是深度学习理论层面的解 ...

- [Kaggle] How to handle big data?

上一篇,[Kaggle] How to kaggle?[方法导论] 这里再做一点进阶学习. 写在前面 "行业特征" 的重要性 Ref: Kaggle2017—1百万美金的肺癌检测竞 ...

- 化繁为简,弱监督目标定位领域的新SOTA - 伪监督目标定位方法(PSOL) | CVPR 2020

论文提出伪监督目标定位方法(PSOL)来解决目前弱监督目标定位方法的问题,该方法将定位与分类分开成两个独立的网络,然后在训练集上使用Deep descriptor transformation(DDT ...

- 卷积网络可解释性复现 | Grad-CAM | ICCV | 2017

觉得本文不错的可以点个赞.有问题联系作者微信cyx645016617,之后主要转战公众号,不在博客园和CSDN更新. 论文名称:"Grad-CAM: Visual Explanations ...

- Grad-CAM:Visual Explanations from Deep Networks via Gradient-based Localization

目录 Grad-CAM:Visual Explanations from Deep Networks via Gradient-based Localization 1.Abstract 2.Intr ...

- Res2net:多尺度骨干网络结构

<Res2Net: A New Multi-scale Backbone Architecture> 来自:南开大学程明明组 论文:https://arxiv.org/abs/1904.0 ...

随机推荐

- C语言大小端判定

要判定大小端?需要弄清以下几个问题: 1.当一个变量占多个字节时,变量的指针指向的是低地址 2.什么是大小端? 大端模式:是指数据的高字节保存在内存的低地址中,而数据的低字节保存在内存的高地址中. 小 ...

- echarts饼图样式

1.中间标题字体大小不一致(可分为一个title一个graphic) 2.labelLine与饼图分离(两个饼图,其中一个显示一个隐藏) function setmyChartJsgxzq(arr,d ...

- 容器之分类与各种测试(三)——list部分用法

list是一个双向链表 例程 #include<stdexcept> #include<memory.h> #include<string> #include< ...

- C++之无子数

题目如下: 1 #include <iostream> 2 3 using namespace std; 4 5 6 bool isThisNumhaveChild(int num); 7 ...

- linux安装redis报错

问题:You need tcl 8.5 or newer in order to run the Redis test 解决办法: wget http://downloads.sourceforge. ...

- ps精修

1.磨皮方法: a,, 添加高斯模糊后,按住alt键新建图层蒙版,设置前景色为白色,用画笔在脸上雀斑的位置涂抹,注意脸轮廓位置不要涂抹.最后添加曲线提亮 b. 添加蒙尘和划痕后,后面上面的一样

- Java Jar包压缩、解压使用

什么是jar包JAR(Java Archive)是Java的归档文件,它是一种与平台无关的文件格式,它允许将许多文件组合成一个压缩文件. 如何打/解包使用jdk/bin/jar.exe工具,配置完环境 ...

- Java中的变量,数据类型和运算符

变量,数据类型和运算符 1.变量是一个数据存储空间的表示,它是储存数据的基本单元. 如何理解这句话,下面用一个表格可以形象的表达: 变量与房间之间的对应关系 房间名称 变量名 房间类型 变量类型 入住 ...

- Mysql配置文件 binlog和慢日志

目录 binlog binlog_format log_slave_updates log-bin|log-bin-index expire_logs_days relay-log|relay-log ...

- 攻击科普:ARP攻击

目录 一.介绍 二.解决办法 一.介绍 ARP攻击的局限性 ARP攻击仅能在以太网(局域网如:机房.内网.公司网络等)进行. 无法对外网(互联网.非本区域内的局域网)进行攻击. ARP攻击就是通过伪造 ...