大数据笔记(十六)——Hive的客户端及自定义函数

一.Hive的Java客户端

JDBC工具类:JDBCUtils.java

package demo.jdbc; import java.sql.DriverManager;

import java.sql.ResultSet;

import java.sql.SQLException;

import java.sql.Statement; //工具类:(1)获取数据库的链接 (2)释放数据库资源

public class JDBCUtils { //Hive驱动

private static String driver = "org.apache.hive.jdbc.HiveDriver"; //Hive的位置

private static String url = "jdbc:hive2://192.168.153.11:10000/default"; //注册数据库的驱动:Java的反射

static{

try {

Class.forName(driver);

} catch (ClassNotFoundException e) {

throw new ExceptionInInitializerError(e);

}

} //获取数据库链接

public static java.sql.Connection getConnection(){

try {

return DriverManager.getConnection(url);

} catch (SQLException e) {

e.printStackTrace();

}

return null;

} //释放资源

public static void release(java.sql.Connection conn,Statement st,ResultSet rs){

if(rs != null){

try {

rs.close();

} catch (SQLException e) {

e.printStackTrace();

}finally{

rs = null;

}

} if(st != null){

try {

st.close();

} catch (SQLException e) {

e.printStackTrace();

}finally{

st = null;

}

} if(conn != null){

try {

conn.close();

} catch (SQLException e) {

e.printStackTrace();

}finally{

conn = null;

}

}

}

}

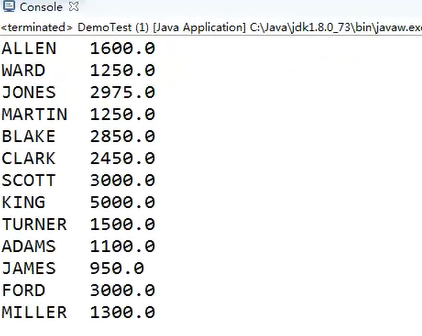

DemoTest.java

package demo.jdbc; import java.sql.ResultSet;

import java.sql.Statement; public class DemoTest { public static void main(String[] args) {

String sql = "select * from emp1"; java.sql.Connection conn = null;

Statement st = null;

ResultSet rs = null;

try {

conn = JDBCUtils.getConnection();

//得到SQL的运行环境

st = conn.createStatement();

//ִ执行SQL

rs = st.executeQuery(sql); while (rs.next()) {

//姓名 薪水

String name = rs.getString("ename");

double sal = rs.getDouble("sal");

System.out.println(name + "\t" +sal);

}

}catch(Exception e){

e.printStackTrace();

}finally {

JDBCUtils.release(conn, st, rs);

}

}

}

启动HiveServer:hiveserver2,会报错:

java.lang.RuntimeException: org.apache.hadoop.ipc.RemoteException:User:

root is not allowed to impersonate anonymous

在老版本的Hive中,是没有这个问题的

解决:

把Hadoop HDFS的访问用户(代理用户) ---> *

core-site.xml

<property>

<name>hadoop.proxyuser.root.hosts</name>

<value>*</value>

</property> <property>

<name>hadoop.proxyuser.root.groups</name>

<value>*</value>

</property>

二.Hive的自定义函数

例子:

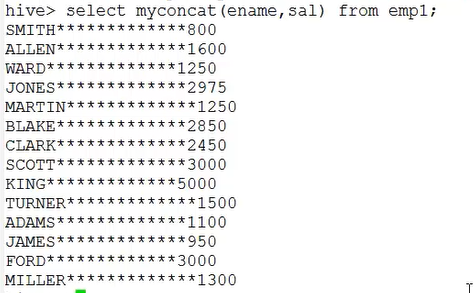

1.concat 拼加两个字符串

package udf; import org.apache.hadoop.hive.ql.exec.UDF; /**

* 实现关系型数据库中的concat函数:拼加字符串

* 需要继承的类:UDF

*

*/

public class MyConcatString extends UDF{ //必须重写一个方法,方法名叫: evaluate

public String evaluate(String a,String b){

return a + "*************"+b;

}

}

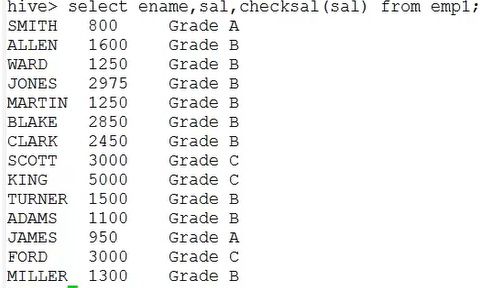

2.判断员工工资的级别

package udf; import org.apache.hadoop.hive.ql.exec.UDF; /**

* 根据员工薪水判断级别

*

*/

public class CheckSalaryGrade extends UDF{

public String evaluate(String salary){

int sal = Integer.parseInt(salary); if (sal<1000) {

return "Grade A";

}else if (sal>=1000 && sal<3000) {

return "Grade B";

}else {

return "Grade C";

}

}

}

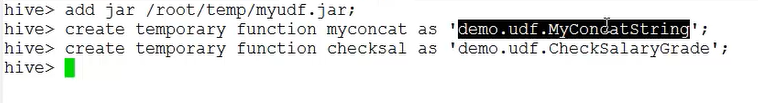

3、打包

将jar包加入hive的classpath

在hive命令行执行:add jar /root/temp/myudf.jar;

创建别名(函数名称)

create temporary function myconcat as 'demo.udf.MyConcatString';

create temporary function checksal as 'demo.udf.CheckSalaryGrade';

结果:

大数据笔记(十六)——Hive的客户端及自定义函数的更多相关文章

- 大数据笔记(六)——HDFS的底层原理:JAVA动态代理和RPC

一.Java的动态代理对象 实现代码如下: 1.接口类MyService package hdfs.proxy; public interface MyService { public void me ...

- 大数据工具篇之Hive与MySQL整合完整教程

大数据工具篇之Hive与MySQL整合完整教程 一.引言 Hive元数据存储可以放到RDBMS数据库中,本文以Hive与MySQL数据库的整合为目标,详细说明Hive与MySQL的整合方法. 二.安装 ...

- 跟上节奏 大数据时代十大必备IT技能

跟上节奏 大数据时代十大必备IT技能 新的想法诞生新的技术,从而造出许多新词,云计算.大数据.BYOD.社交媒体……在互联网时代,各种新词层出不穷,让人应接不暇.这些新的技术,这些新兴应用和对应的IT ...

- 大数据工具篇之Hive与HBase整合完整教程

大数据工具篇之Hive与HBase整合完整教程 一.引言 最近的一次培训,用户特意提到Hadoop环境下HDFS中存储的文件如何才能导入到HBase,关于这部分基于HBase Java API的写入方 ...

- 大数据应用之Windows平台Hbase客户端Eclipse开发环境搭建

大数据应用之Windows平台Hbase客户端Eclipse开发环境搭建 大数据应用之Windows平台Hbase客户端Eclipse环境搭建-Java版 作者:张子良 版权所有,转载请注明出处 引子 ...

- 大数据系列之数据仓库Hive安装

Hive系列博文,持续更新~~~ 大数据系列之数据仓库Hive原理 大数据系列之数据仓库Hive安装 大数据系列之数据仓库Hive中分区Partition如何使用 大数据系列之数据仓库Hive命令使用 ...

- CentOS6安装各种大数据软件 第六章:HBase分布式集群的配置

相关文章链接 CentOS6安装各种大数据软件 第一章:各个软件版本介绍 CentOS6安装各种大数据软件 第二章:Linux各个软件启动命令 CentOS6安装各种大数据软件 第三章:Linux基础 ...

- 大数据系列之数据仓库Hive命令使用及JDBC连接

Hive系列博文,持续更新~~~ 大数据系列之数据仓库Hive原理 大数据系列之数据仓库Hive安装 大数据系列之数据仓库Hive中分区Partition如何使用 大数据系列之数据仓库Hive命令使用 ...

- python3.4学习笔记(十六) windows下面安装easy_install和pip教程

python3.4学习笔记(十六) windows下面安装easy_install和pip教程 easy_install和pip都是用来下载安装Python一个公共资源库PyPI的相关资源包的 首先安 ...

随机推荐

- GraphQL入门有这一篇就足够了

GraphQL入门有这一篇就足够了:https://blog.csdn.net/qq_41882147/article/details/82966783 版权声明:本文为博主原创文章,遵循 CC 4. ...

- Redis 内存满了怎么办……

我们知道Redis是基于内存的key-value数据库,因为系统的内存大小有限,所以我们在使用Redis的时候可以配置Redis能使用的最大的内存大小. 1.通过配置文件配置 通过在Redis安装目录 ...

- linux通信之信号

一. 信号介绍 1.1. 什么是信号 1.1.1. 信号是内容受限的一种异步通信机制 a. 之所以称之为受限是因为通信内容在OS已经规定,内容简单,单一(signal.h文件中定义好) b. 信号本质 ...

- c++ const 用法

1. 修饰一般变量,const int a = 10; 表示此变量不能被修改,简单易懂,不多说 2. 修饰指针,主要是下面三种 const int *cp1 = &a; // ...

- j网络爬虫之WebMagic

WebMagic官网:http://webmagic.io/ 注意: 1.在自定义PageProcessor中使用System.out.println(“str”),Spider.create(new ...

- Label显示时间

package 第十一章; import java.awt.Button; import java.awt.Color; import java.awt.Font; import java.awt.F ...

- 原生js格式化json和格式化xml的方法

在工作中一直看各位前辈的博客解决各种问题,对我的帮助很大,非常感谢! 之前一直比较忙没有写博客,终于过年有了点空闲时间,可以把自己积累的东西分享下,笔记中的部分函数不是自己写的,都是工作中一点点积累的 ...

- Gcc如何知道文件类型。

Linux系统不区分扩展名,但是GCC编译器通过扩展名区分. GCC是根据扩展名来编译源文件的.

- SQL SERVER BCP导入导出

bcp是SQL Server中负责导入导出数据的一个命令行工具,它是基于DB-Library的,并且能以并行的方式高效地导入导出大批量的数据.bcp可以将数据库的表或视图直接导出,也能通过SELECT ...

- Linux日常之显示文件总结

1. 将文件file1.file2的内容都显示出来,并显示行号 cat -n file1 file2 2. 将文件file1.file2中带有字符'h'的行显示出来 cat -n file1 file ...