python简单爬虫 用lxml解析页面中的表格

目标:爬取湖南大学2018年在各省的录取分数线,存储在txt文件中

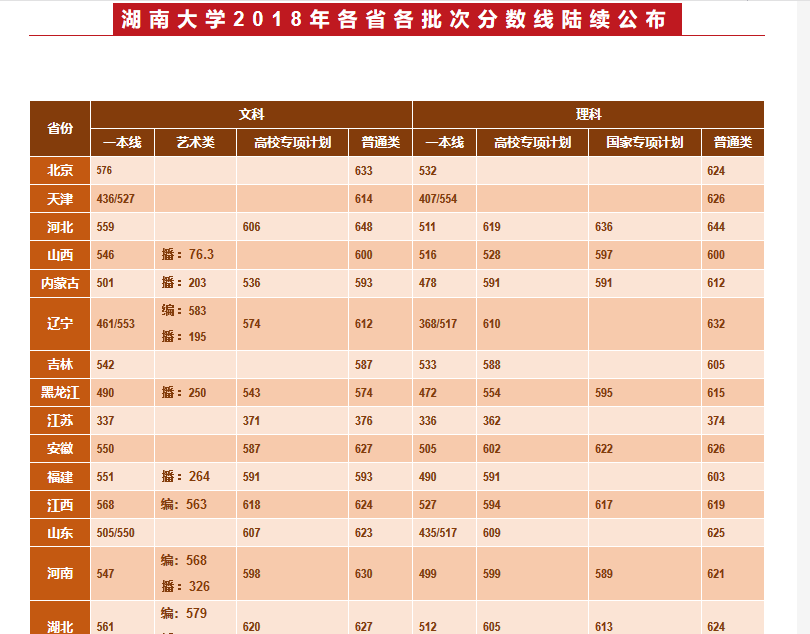

部分表格如图:

部分html代码:

<table cellspacing="0" cellpadding="0" border="1">

<tbody>

<tr class="firstRow" >

<td rowspan="2" ><p ><strong><span >省份</span></strong></p></td>

<td colspan="4" ><p ><strong><span >文科</span></strong></p></td>

<td colspan="4" ><p ><strong><span >理科</span></strong></p></td>

</tr>

<tr >

<td ><p ><strong><span >一本线</span></strong></p></td>

<td ><p ><strong><span >艺术类</span></strong></p></td>

<td ><p ><strong><span >高校专项计划</span></strong></p></td>

<td ><p ><strong><span >普通类</span></strong></p></td>

<td ><p ><strong><span >一本线</span></strong></p></td>

<td ><p ><strong><span >高校专项计划</span></strong></p></td>

<td ><p ><strong><span >国家专项计划</span></strong></p></td>

<td ><p ><strong><span >普通类</span></strong></p></td>

</tr>

<tr >

<td ><p ><strong><span >北京</span></strong></p></td>

<td valign="middle" align="left"><p ><span ><strong><span lang="EN-US">576</span></strong></span></p></td>

<td valign="middle" align="left"><br></td>

<td valign="middle" align="left"><br></td>

<td valign="middle" align="left"><p ><span ><strong><span lang="EN-US">633</span></strong></span></p></td>

<td valign="middle" align="left"><p ><span ><strong><span lang="EN-US">532</span></strong></span></p></td>

<td valign="middle" align="left"><br></td>

<td valign="middle" align="left"><br></td>

<td valign="middle" align="left"><p ><span ><strong><span lang="EN-US">624</span></strong></span></p></td>

</tr>

<tr >

<td ><p ><strong><span >天津</span></strong></p></td>

<td valign="middle" align="left"><p ><span ><strong><span lang="EN-US">436/527</span></strong></span></p></td>

<td valign="middle" align="left"><br></td>

<td valign="middle" align="left"><br></td>

<td valign="middle" align="left"><p ><span ><strong><span lang="EN-US">614</span></strong></span></p></td>

<td valign="middle" align="left"><p ><span ><strong><span lang="EN-US">407/554</span></strong></span></p></td>

<td valign="middle" align="left"><br></td>

<td valign="middle" align="left"><br></td>

<td valign="middle" align="left"><p ><span ><strong><span lang="EN-US">626</span></strong> </span></p></td>

</tr> ...... <tr >

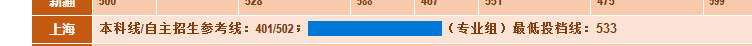

<td ><p ><strong><span >上海</span></strong></p></td>

<td colspan="8" valign="top"><p ><strong><span >本科线</span></strong><strong><span lang="EN-US">/</span></strong><strong><span >自主招生参考线:</span></strong><strong><span lang="EN-US">401/502</span></strong><strong><span >;</span></strong><strong><span lang="EN-US"> </span></strong><strong><span >(专业组)最低投档线:<span >533</span></span></strong></p></td>

</tr>

<tr >

<td ><p ><strong><span >浙江</span></strong></p></td>

<td colspan="8" valign="top"><p ><strong><span >本科线</span></strong><strong><span lang="EN-US">/</span></strong><strong><span >一段线:</span></strong><strong><span lang="EN-US">344/588</span></strong><strong><span >;</span></strong><strong><span lang="EN-US"> </span></strong><strong><span >(专业)最低投档线:639</span></strong></p></td>

</tr>

</tbody>

</table>

代码:

import requests

from lxml import etree # 设置URL地址和请求头

url = 'http://admi.hnu.edu.cn/info/1024/3094.htm'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/69.0.3497.92 Safari/537.36',

'Cookie': 'ASP.NET_SessionId=yolmu555asckw145cetno0um'

} # 发送请求并解析HTML对象

response = requests.get(url, headers=headers)

html = etree.HTML(response.content.decode('utf-8')) # 数据解析

table = html.xpath("//table//tr[position()>2]") # XPath定位到表格,因为页面只有一个表格,所以直接//table,

# 如果有多个表格,如取第二个表格,则写为//table[1] 偏移量为1 。我们不取表头信息,所以从tr[3]开始取,返回一个列表 dep = [] for i in table: # 遍历tr列表

p = ''.join(i.xpath(".//td[1]//text()")) # 获取当前tr标签下的第一个td标签,并用text()方法获取文本内容,赋值给p

sl = ''.join(i.xpath(".//td[6]//text()"))

sc = ''.join(i.xpath(".//td[9]//text()"))

ll = ''.join(i.xpath(".//td[2]//text()"))

lc = ''.join(i.xpath(".//td[5]//text()")) print(p, sl, sc, ll, lc)

data = { # 用数据字典,存储需要的信息

'省份': ''.join(p.split()), # .split()方法在此处作用是除去p中多余的空格 '\xa0'

'理科一本线': ''.join(sl.split()),

'理科投档线': ''.join(sc.split()),

'文科一本线': ''.join(ll.split()),

'文科投档线': ''.join(lc.split())

}

print(data)

dep.append(data) #数据存储

with open('2018enro.txt', 'w', encoding='utf-8') as out_file:

out_file.write("湖南大学:"+"2018年各省录取分数线:\n\n")

for i in dep:

out_file.write(str(i)+'\n')

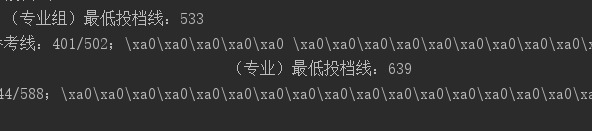

注:原本数据字典是这样写的:

for i in table:

data = { # 用数据字典,存储需要的信息

'省份': ''.join(i.xpath(".//td[1]//text()")),

'理科一本线': ''.join(i.xpath(".//td[6]//text()")),

'理科投档线': ''.join(i.xpath(".//td[9]//text()")),

'文科一本线': ''.join(i.xpath(".//td[2]//text()")),

'文科投档线': ''.join(i.xpath(".//td[5]//text()"))

}

输出结果有很多‘\xa0’,其实就是空格,源网页中就字段里就存在很多空格:

plus:解析表格有更好的方法,比如pandas,一步到位!非常方便。

详情请看我的另一篇文章:

https://www.cnblogs.com/cttcarrotsgarden/p/10769097.html

python简单爬虫 用lxml解析页面中的表格的更多相关文章

- python简单爬虫 用lxml库解析数据

目标:爬取湖南大学2018年本科招生章程 url:http://admi.hnu.edu.cn/info/1026/2993.htm 页面部分图片: 使用工具: Python3.7 火狐浏览器 PyC ...

- python简单爬虫 使用pandas解析表格,不规则表格

url = http://www.hnu.edu.cn/xyxk/xkzy/zylb.htm 部分表格如图: 部分html代码: <table class="MsoNormalTabl ...

- Python简单爬虫入门二

接着上一次爬虫我们继续研究BeautifulSoup Python简单爬虫入门一 上一次我们爬虫我们已经成功的爬下了网页的源代码,那么这一次我们将继续来写怎么抓去具体想要的元素 首先回顾以下我们Bea ...

- GJM : Python简单爬虫入门(二) [转载]

感谢您的阅读.喜欢的.有用的就请大哥大嫂们高抬贵手"推荐一下"吧!你的精神支持是博主强大的写作动力以及转载收藏动力.欢迎转载! 版权声明:本文原创发表于 [请点击连接前往] ,未经 ...

- python简单爬虫一

简单的说,爬虫的意思就是根据url访问请求,然后对返回的数据进行提取,获取对自己有用的信息.然后我们可以将这些有用的信息保存到数据库或者保存到文件中.如果我们手工一个一个访问提取非常慢,所以我们需要编 ...

- Python简单爬虫入门三

我们继续研究BeautifulSoup分类打印输出 Python简单爬虫入门一 Python简单爬虫入门二 前两部主要讲述我们如何用BeautifulSoup怎去抓取网页信息以及获取相应的图片标题等信 ...

- Python 简单爬虫案例

Python 简单爬虫案例 import requests url = "https://www.sogou.com/web" # 封装参数 wd = input('enter a ...

- 【转】一张图解析FastAdmin中的表格列表的功能

一张图解析FastAdmin中的表格列表的功能 功能描述请根据图片上的数字索引查看对应功能说明. 1.时间筛选器如果想在搜索栏使用时间区间进行搜索,则可以在JS中修改修改字段属性,如 {field: ...

- jQuery 中使用 DOM 操作节点,对页面中的表格实现增、删、查、改操作

查看本章节 查看作业目录 需求说明: 在 jQuery 中使用 DOM 操作节点,对页面中的表格实现增.删.查.改操作 点击"增加"超链接时,将表格中的第一条数据添加到表格的末尾 ...

随机推荐

- HackerRank-Python攻城歷程-3.List( Find the Second Largest Number )

if __name__ == '__main__': n = int(input()) arr = map(int, input().split()) print(sorted(list(set(ar ...

- abap 增强查找小程序

*&---------------------------------------------------------------------* *& Report ZEXIT *& ...

- 处理npm publish报错问题

上传项目到npm-->为社会做贡献 首先你得有一个项目 npm init 生成package.json 来设置相信息 注册登录npm:npm adduser 输入你的一些信息 查看当前npm登录 ...

- 使用Python编的猜数字小游戏

import random secret = random.randint(1, 30) guess = 0 tries = 0 print("我叫丁丁,我有一个秘密数字!") p ...

- (完美)华为Mate8 NXT-TL00的USB调试模式在哪里开启的经验

每当我们使用pc通过数据线连接上安卓手机的时候,如果手机没有开启usb调试模式,pc则没法成功检测到我们的手机,在一些情况下,我们使用的一些功能比较强的的软件如以前我们使用的一个软件引号精灵,老版本就 ...

- (23)socket多进程并发

# 对于服务器自己本身,一个程序只能绑定一个端口 # 同一个端口可以多个客户端来连接, # 只要server_ip+ server_port +client_ip + cilent_port 不一样, ...

- Springboot使用alibaba的fastJson,@JSONField不起作用的问题

在Springboot中默认的JSON解析框架是jackson 今天引入alibaba的fastjson,使用@JSONField(serialize=false),让@RestController转 ...

- Linux之redis-cluster(集群配置)

redis-cluster配置 为什么要用redis-cluster 1.并发问题 redis官方声称可以达到 10万/每秒,每秒执行10万条命令假如业务需要每秒100万的命令执行呢? 2.数据量 ...

- fetch请求get方式以及post提交参数为formdata类型的数据

1.请求方式post,请求函数参数 _requestData(callback,_cityDt){ const switchIp = "http://192.168.43.103/api/p ...

- Vue2.0增删改查案例(Vue+Less+LocalStorage)

本人写的小程序,功能还在完善中,欢迎扫一扫提出宝贵意见! Vue+Less+LocalStorage 安装Less:npm install less less-loader --s ...