在 IDEA中运行 WordCount

一、新建一个maven项目

二、pom.xml 中内容

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion> <groupId>1</groupId>

<artifactId>1</artifactId>

<version>1.0-SNAPSHOT</version> <repositories>

<repository>

<id>apache</id>

<url>http://maven.apache.org</url>

</repository>

</repositories> <dependencies>

<!--<dependency>-->

<!--<groupId>org.apache.hadoop</groupId>-->

<!--<artifactId>hadoop-core</artifactId>-->

<!--<version>2.7.2</version>-->

<!--</dependency>-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>2.7.2</version>

</dependency> <dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>2.7.2</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>2.7.2</version>

</dependency> <dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>3.8.1</version>

<scope>test</scope>

</dependency>

</dependencies> <build>

<plugins>

<plugin>

<artifactId>maven-dependency-plugin</artifactId>

<configuration>

<excludeTransitive>false</excludeTransitive>

<stripVersion>true</stripVersion>

<outputDirectory>./lib</outputDirectory>

</configuration> </plugin>

</plugins>

</build>

</project>

三、准备数据文件

注意点:因为Windows当前用户是 Administrator ,所以需要在 hdfs://master:8020/user/ 目录下创建文件夹 Administrator ,以后进行本地测试都使用此文件夹。

文件夹创建好之后,还需要给与写的权限。此处直接给最大权限。

su hdfs

hdfs dfs -mkdir -p /user/Administrator/input

hdfs dfs -chmod -R 777 /user/Administrator

hdfs dfs -put ./wordCountData.txt /user/Administrator/input

exit

四、创建 WordCount.java 文件

注意点: 因为是在 Windows 上提交 mapreduce 任务,需要在 conf 中设置下面内容。

conf.set("mapreduce.app-submission.cross-platform", "true"); // 跨平台,保证在 Windows 下可以提交 mr job

否则报错:/bin/bash: line 0: fg: no job control

package com.zjc.mr; import java.io.IOException;

import java.util.StringTokenizer; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat; public class WordCount { public static class TokenizerMapper extends Mapper<Object, Text, Text, IntWritable> { // 下面的IntWritable 跟 Text 类是hadoop内部类,相当于 java 中的 int 与 String

// MapReduce 程序中互相传递的是这种类型的参数

private final static IntWritable one = new IntWritable(1);

private Text word = new Text(); public void map(Object key, Text value, Context context) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());//java 自带的字符串分割函数

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

/*

*eg map output:

* hello 1

* word 1

* hello 1

* hadoop 1

*/

}

}

} /*

* Reduce 输入:

* key: hello

* value: [1,1]

*

* Hadoop负责将Map产生的<key,value>处理成{具有相同key的value集合},传给Reducer

输入:<key,(listof values)>

输出:<key,value>

reduce函数(必须是这个名字)的参数,(输入key,输入具有相同key的value集合,Context)其中,

输入的key,value必须类型与map的输出<key,value>相同,这一点适用于map,reduce类及函数

*

*/

public static class IntSumReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable(); public void reduce(Text key, Iterable<IntWritable> values, Context context)

throws IOException, InterruptedException {

int sum = 0;

System.out.println("-----------------------------------------");

System.out.println("key: "+key);

for (IntWritable val : values) {

System.out.println("val: "+val);

sum += val.get();

}

result.set(sum);

System.out.println("result: "+result.toString());

context.write(key, result);

}

} public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

conf.set("mapreduce.app-submission.cross-platform", "true"); // 跨平台,保证在 Windows 下可以提交 mr job

Job job = Job.getInstance(conf, "word count"); // 任务名

job.setJarByClass(WordCount.class); // 指定Class

job.setMapperClass(TokenizerMapper.class); // 指定 Mapper Class

job.setCombinerClass(IntSumReducer.class); // 指定 Combiner Class,与 reduce 计算逻辑一样

job.setReducerClass(IntSumReducer.class); // 指定Reucer Class

job.setOutputKeyClass(Text.class); // 指定输出的KEY的格式

job.setOutputValueClass(IntWritable.class); // 指定输出的VALUE的格式

job.setNumReduceTasks(1); //设置Reducer 个数默认1

// Mapper<Object, Text, Text, IntWritable> 输出格式必须与继承类的后两个输出类型一致

String args_0 = "hdfs://master:8020/user/Administrator/input";

String args_1 = "hdfs://master:8020/user/Administrator/output";

FileInputFormat.addInputPath(job, new Path(args_0)); // 输入路径

FileOutputFormat.setOutputPath(job, new Path(args_1)); // 输出路径

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

// 每次运行都需要先删除hdfs中,上一次执行生成的 output 文件夹。 hdfs dfs -rm -R /user/Administrator/output

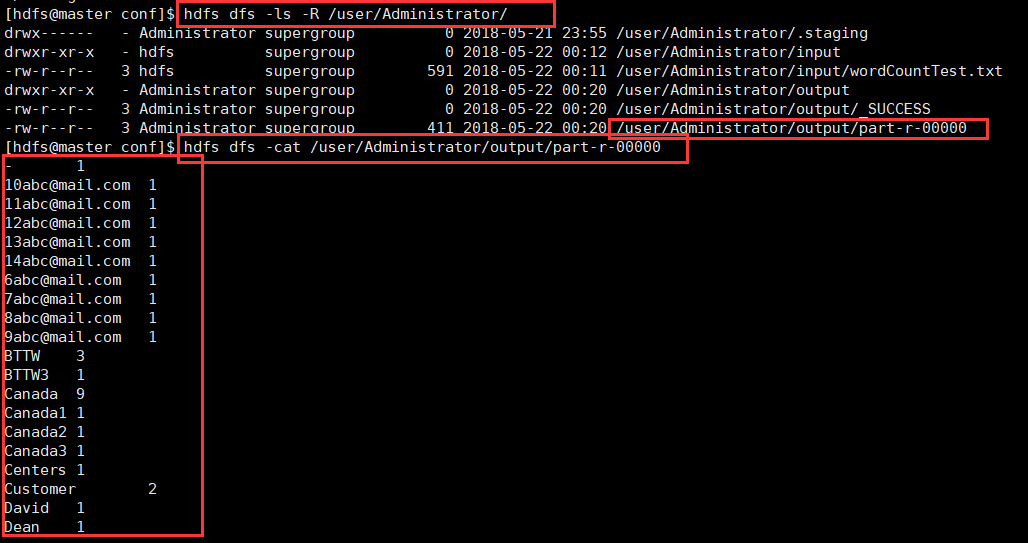

五、查看结果

在 IDEA中运行 WordCount的更多相关文章

- Spark学习笔记——在远程机器中运行WordCount

1.通过realy机器登录relay-shell ssh XXX@XXX 2.登录了跳板机之后,连接可以用的机器 XXXX.bj 3.在本地的idea生成好程序的jar包(word-count_2.1 ...

- CDH quick start VM 中运行wordcount例子

需要注意的事情: 1. 对于wordcount1.0 ,按照http://www.cloudera.com/content/cloudera/en/documentation/HadoopTutori ...

- 在eclipse中运行wordcount,控制台打印log4j警告

log4j:WARN No appenders could be found for logger (org.apache.hadoop.util.Shell).log4j:WARN Please i ...

- Hadoop3 在eclipse中访问hadoop并运行WordCount实例

前言: 毕业两年了,之前的工作一直没有接触过大数据的东西,对hadoop等比较陌生,所以最近开始学习了.对于我这样第一次学的人,过程还是充满了很多疑惑和不解的,不过我采取的策略是还是先让环 ...

- (二)Hadoop例子——运行example中的wordCount例子

Hadoop例子——运行example中的wordCount例子 一. 需求说明 单词计数是最简单也是最能体现MapReduce思想的程序之一,可以称为 MapReduce版"Hello ...

- 021_在Eclipse Indigo中安装插件hadoop-eclipse-plugin-1.2.1.jar,直接运行wordcount程序

1.工具介绍 Eclipse Idigo.JDK1.7-32bit.hadoop1.2.1.hadoop-eclipse-plugin-1.2.1.jar(自己网上下载) 2.插件安装步骤 1)将ha ...

- Spark源码编译并在YARN上运行WordCount实例

在学习一门新语言时,想必我们都是"Hello World"程序开始,类似地,分布式计算框架的一个典型实例就是WordCount程序,接触过Hadoop的人肯定都知道用MapRedu ...

- eclipse运行WordCount

1) 可以完全参考http://www.cnblogs.com/archimedes/p/4539751.html在eclipse下创建MapReduce工程,创建了MR工程,并完成WordCount ...

- 解决在windows的eclipse上面运行WordCount程序出现的一系列问题详解

一.简介 要在Windows下的 Eclipse上调试Hadoop2代码,所以我们在windows下的Eclipse配置hadoop-eclipse-plugin- 2.6.0.jar插件,并在运行H ...

随机推荐

- 人脸检测识别,人脸检测,人脸识别,离线检测,C#源码

百度网盘地址 微云地址 使用虹软人工智能开放平台技术开发完成

- 『Shell编程』学习记录(2)

例1.文件io #include <stdio.h> #include <sys/types.h> #include <sys/stat.h> #include & ...

- SQL Server中将多行数据拼接为一行数据(一个字符串)

表A中id与表B中aid为一对多的关系 例如: 表A: id name a1 tom a2 lily a3 lucy 表B: id aid value b1 a1 B1 b2 a1 B2 b3 a2 ...

- Python 之Web编程

一 .HTML是什么? htyper text markup language 即超文本标记语言 超文本:就是指页面内可以包含图片.链接.甚至音乐.程序等非文字元素 标记语言:标记(标签)构成的语言 ...

- NTFS权限和共享权限的区别

共享权限 共享权限有三种:完全控制.更改.读取 共持本地安全性.换句话说,他在同一台计算机上以不同用户名登录,对硬盘上同一文件夹可以有不同的访问权限. 注意:NTFS权限对从网络访问和本机登录的用户都 ...

- JavaScript中编码函数escape,encodeURI,encodeURIComponent

第一:escape():对字符串进行编码,escape()不编码的字符:@*/+ 第二:encodeURI() 函数可把字符串作为 URI 进行编码.不会进行转义的:;/?:@&=+$,# 第 ...

- Ubuntu下搭建spark2.4环境(单机版)

说明:单机版的Spark的机器上只需要安装JDK即可,其他诸如Hadoop.Zookeeper(甚至是scala)之类的东西可以一概不安装.集群版搭建:Spark2.2集群部署和配置 一.安装JDK1 ...

- Linux SHELL中sh和bash的区别

什么是SHELL? shell的中文意思就是贝壳,其实比较类似于我们内核的壳.简而言之就是只要能够操作应用程序的接口都能够称为SHELL.狭义的shell指的是命令行方面的软件,广义的SHELL则包括 ...

- 私有仓库 gitlab 部署笔记

--------------------------------------------gitlab简介------------------------------------------------ ...

- 浅谈kafka streams

随着数据时代的到来,数据的实时计算也越来越被大家重视.实时计算的一个重要方向就是实时流计算,目前关于流计算的有很多成熟的技术实现方案,比如Storm.Spark Streaming.flink等.我今 ...