jieba库的使用与词频统计

1、词频统计

(1)词频分析是对文章中重要词汇出现的次数进行统计与分析,是文本

挖掘的重要手段。它是文献计量学中传统的和具有代表性的一种内容分析方法,基本原理是通过词出现频次多少的变化,来确定热点及其变化趋势。

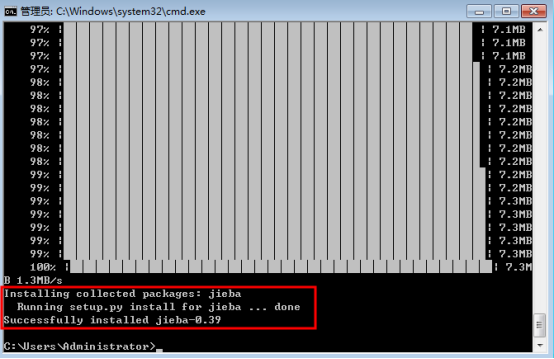

(2)安装jieba库

安装说明

代码对 Python 2/3 均兼容

全自动安装:easy_install jieba 或者 pip install jieba / pip3 install jieba

半自动安装:先下载 http://pypi.python.org/pypi/jieba/ ,解压后运行 python setup.py install

手动安装:将 jieba 目录放置于当前目录或者 site-packages 目录

通过 import jieba 来引用

示例、全自动安装

在命令行下输入指令:

pip install jieba

(2) 安装进程:

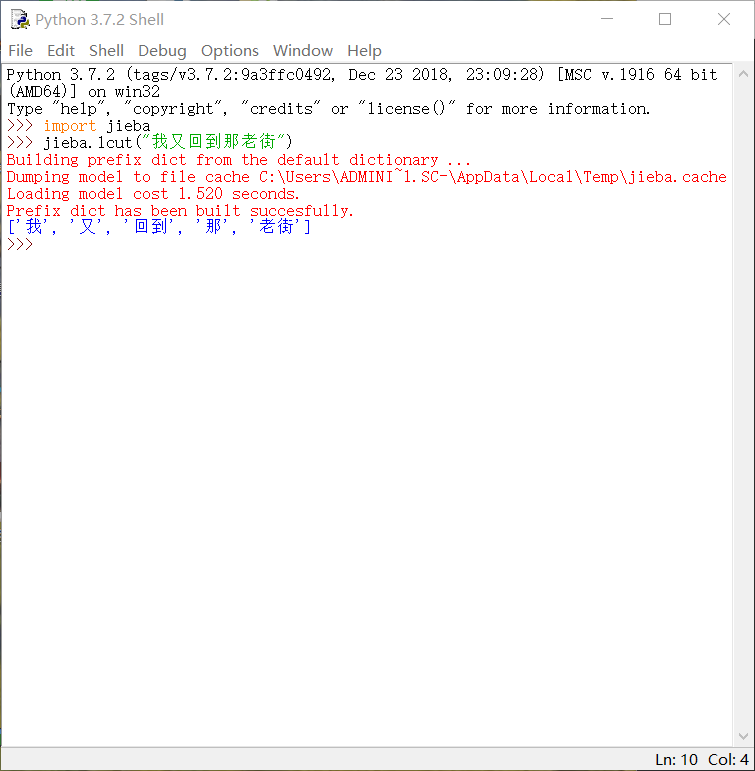

2、调用库函数

1、输入import jieba与使用其中函数

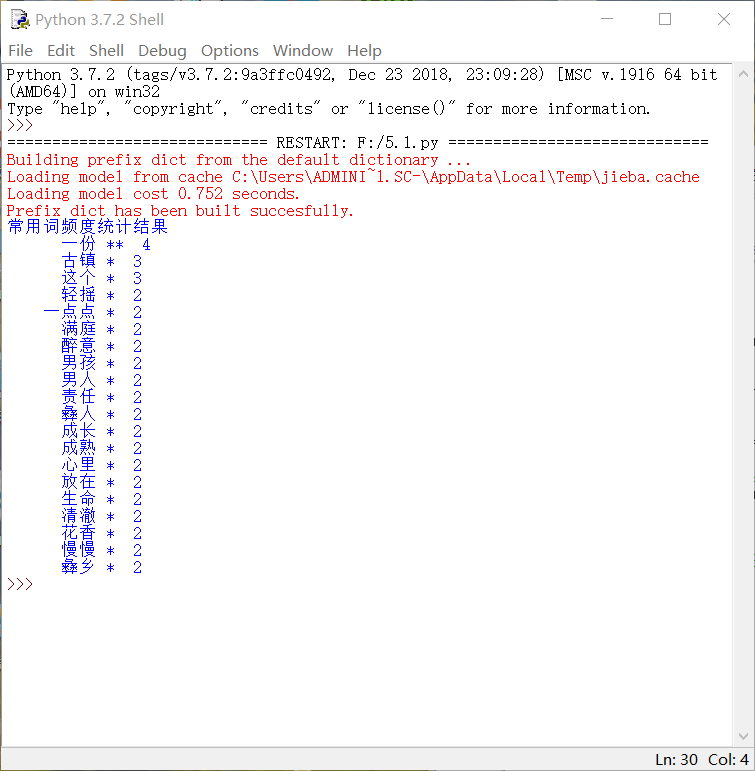

3、python代码

#! python3

# -*- coding: utf- -*-

import os, codecs

import jieba

from collections import Counter def get_words(txt):

seg_list = jieba.cut(txt) #对文本进行分词

c = Counter()

for x in seg_list: #进行词频统计

if len(x)> and x != '\r\n':

c[x] +=

print('常用词频度统计结果')

for (k,v) in c.most_common(): #遍历输出高频词

print('%s%s %s %d' % (' '*(-len(k)), k, '*'*int(v/2), v)) if __name__ == '__main__':

with codecs.open('梦里花落知多少.txt', 'r', 'utf8') as f:

txt = f.read()

get_words(txt)

• •显示效果

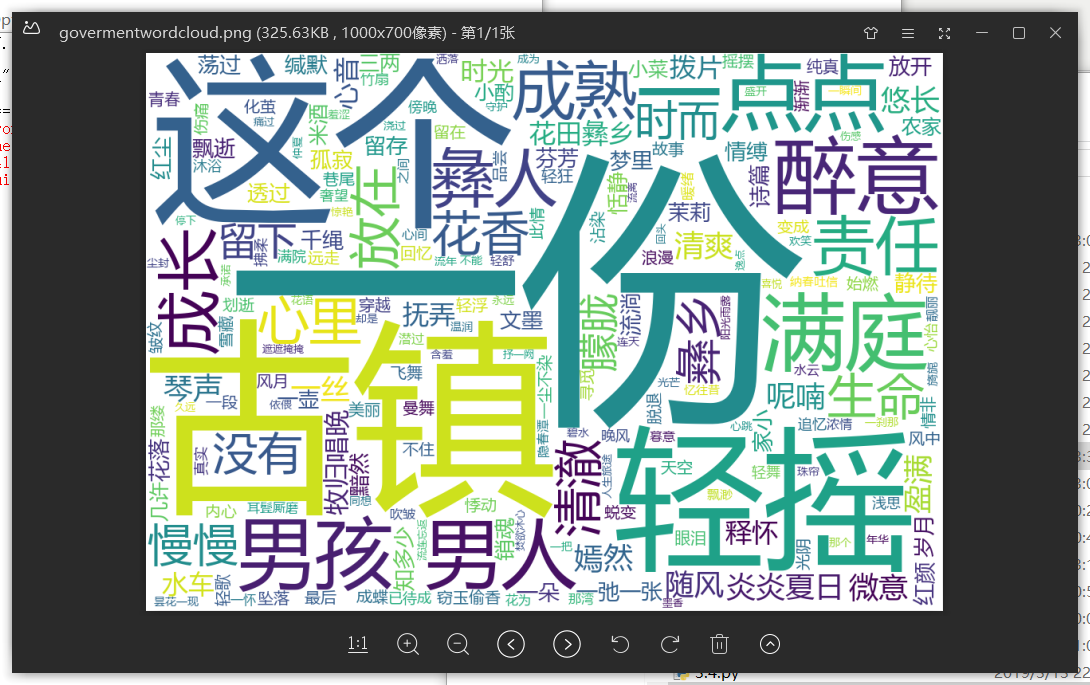

4、词云

import jieba

import wordcloud

f = open("梦里花落知多少.txt","r",encoding = "utf-8") #打开文件

t = f.read() #读取文件,并存好

f.close()

ls = jieba.lcut(t) #对文本分词

txt = " ".join(ls) #对文本进行标点空格化

w = wordcloud.WordCloud(font_path = "msyh.ttc",width = ,height = ,background_color = "white") #设置词云背景,找到字体路径(否则会乱码)

w.generate(txt) #生成词云

w.to_file("govermentwordcloud.png") #保存词云图

• 词云显示

jieba库的使用与词频统计的更多相关文章

- jieba库及wordcloud库的使用

知识内容: 1.jieba库的使用 2.wordcloud库的使用 参考资料: https://github.com/fxsjy/jieba https://blog.csdn.net/fontthr ...

- 用jieba库统计文本词频及云词图的生成

一.安装jieba库 :\>pip install jieba #或者 pip3 install jieba 二.jieba库解析 jieba库主要提供提供分词功能,可以辅助自定义分词词典. j ...

- jieba库词频统计

一.jieba 库简介 (1) jieba 库的分词原理是利用一个中文词库,将待分词的内容与分词词库进行比对,通过图结构和动态规划方法找到最大概率的词组:除此之外,jieba 库还提供了增加自定义中文 ...

- py库: jieba (中文词频统计) 、collections (字频统计)、WordCloud (词云)

先来个最简单的: # 查找列表中出现次数最多的值 ls = [1, 2, 3, 4, 5, 6, 1, 2, 1, 2, 1, 1] ls = ["呵呵", "呵呵&qu ...

- 利用python jieba库统计政府工作报告词频

1.安装jieba库 舍友帮装的,我也不会( ╯□╰ ) 2.上网寻找政府工作报告 3.参照课本三国演义词频统计代码编写 import jieba txt = open("D:\政府工作报告 ...

- Python之利用jieba库做词频统计且制作词云图

一.环境以及注意事项 1.windows10家庭版 python 3.7.1 2.需要使用到的库 wordcloud(词云),jieba(中文分词库),安装过程不展示 3.注意事项:由于wordclo ...

- jieba库词频统计练习

在sypder上运行jieba库的代码: import matplotlib.pyplot as pltfracs = [2,2,1,1,1]labels = 'houqin', 'jiemian', ...

- jieba库分词词频统计

代码已发至github上的python文件 词频统计结果如下(词频为1的词组数量已省略): {'是': 5, '风格': 4, '擅长': 4, '的': 4, '兴趣': 4, '宣言': 4, ' ...

- 使用jieba库与wordcloud库第三方库进行词频统计

一.jieba库与wordcloud库的使用 1.jieba库与wordcloud库的介绍 jieba 库的分词原理是利用一个中文词库,将待分词的内容与分词词库进行比对,通过图结构和动态规划方法找到最 ...

随机推荐

- 创建Git 仓库及 克隆、拉取、和推送操作

打开网址: https://github.com/ 登录上自己创建的 Git账号 一. 创建Git 仓库 start a project---> 输入仓库 ...

- vs2017打包安卓项目简述

1.使用vs2017创建安卓项目 2.选择Release模式编译项目 3.项目存档 4.签名分发 存档完成后,点击分发按钮进入如下界面 按要求输入签名信息 选择apk保存位置 5.分享apk文件 参考 ...

- shell echo/read/printf/流程控制章节笔记

// echo read printf 流程控制 命令 1.read 命令从标准输入中读取一行,并把输入行的每个字段的值指定给 shell 变量 read hello 输入xxx echo $hell ...

- layUI实现可选项 弹框

需求描述:点击插入,会让选择,插入的类型,选择之后,点击确定,执行后续的一些操作.先摆效果图. 代码: //html代码<style> #imp{ display: none; }< ...

- MySQL查看所有连接的客户端ip

) AS host_name,state,count(*) FROM information_schema.processlist GROUP BY state,host_name;

- [原创][Synth 8-2543] port connections cannot be mixed ordered and named ["*_Top.v":1151]

Vivado综合错误: [Synth 8-2543] port connections cannot be mixed ordered and named ["*_Top.v":1 ...

- [原创]..\OBJ\gpio.axf: error: L6002U: Could not open file ..\obj\gpio.o: No such file

可以通过: 可以通过修改用户环境变量路径的方法解决:方法:右键我的电脑\属性\高级系统设置\环境变量\用户环境变量,找到变量TEMP和TMP,将变量值中的“%USERPROFILE%”使用“C:\us ...

- spring-data-rest的魔力 10分钟实现增删改查

目录 创建项目 启动项目 添加person 查看person 及 person 列表 条件查询 分页查询 controller 去哪里了 自定义 spring-data-rest 魔力之外的contr ...

- js中ASCII码和字符互相转换的方法

目录 十进制ASCII码转换成字符 字符转换成十进制ASCII码 十进制ASCII码转换成字符 使用String.fromCodePoint(num1[, ...[, numN]])方法 String ...

- Kilani and the Game-扩散形式的搜索

Kilani and the Game 思路:这种扩散走法的并且有速度.我们需要一层一层的入队, 而且 根据题目要求 按编号处理 例如q1队列中有 1 1 1 2 2 2 2 3 3 3 3 3 3 ...