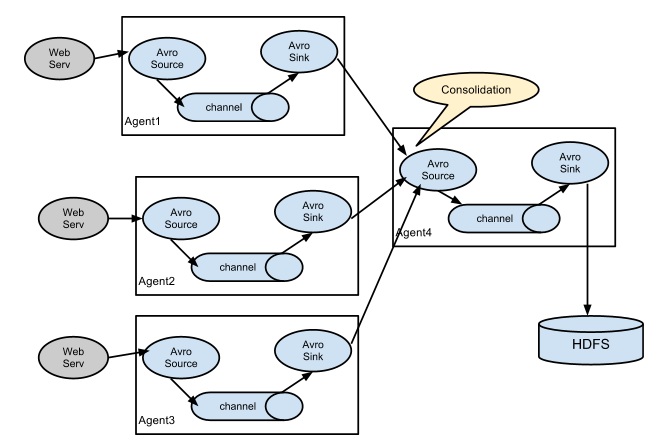

多个子节点收集日志-主节点上传到HDFS

Master:

----------------------

#MasterAgent

MasterAgent.channels = c1

MasterAgent.sources = s1

MasterAgent.sinks = k1

#MasterAgent Avro Source

MasterAgent.sources.s1.type = avro

MasterAgent.sources.s1.bind = 192.168.192.128

MasterAgent.sources.s1.port = 4444

##MasterAgent FileChannel

#MasterAgent.channels.c1.type = file

#MasterAgent.channels.c1.checkpointDir = /home/hadoop/data/spool/checkpoint

#MasterAgent.channels.c1.dataDirs = /home/spool/data

#MasterAgent.channels.c1.capacity = 200000000

#MasterAgent.channels.c1.keep-alive = 30

#MasterAgent.channels.c1.write-timeout = 30

#MasterAgent.channels.c1.checkpoint-timeout=600

#MasterAgent Memory Channel

MasterAgent.channels.c1.type = memory

MasterAgent.channels.c1.capacity = 1000

MasterAgent.channels.c1.transactionCapacity = 100

#MasterAgent.channels.c1.byteCapacityBufferPercentage = 20

#MasterAgent.channels.c1.byteCapacity = 800

# Describe the sink

MasterAgent.sinks.k1.type = hdfs

MasterAgent.sinks.k1.hdfs.path =hdfs://qm1711/flume_data

MasterAgent.sinks.k1.hdfs.filePrefix = %Y_%m_%d

MasterAgent.sinks.k1.hdfs.fileSuffix = .log

MasterAgent.sinks.k1.hdfs.round = true

MasterAgent.sinks.k1.hdfs.roundValue = 1

MasterAgent.sinks.k1.hdfs.roundUnit = minute

MasterAgent.sinks.k1.hdfs.useLocalTimeStamp = true

MasterAgent.sinks.k1.hdfs.fileType=DataStream

MasterAgent.sinks.k1.hdfs.writeFormat=Text

MasterAgent.sinks.k1.hdfs.rollInterval=0

MasterAgent.sinks.k1.hdfs.rollSize=10240

MasterAgent.sinks.k1.hdfs.rollCount=0

MasterAgent.sinks.k1.hdfs.idleTimeout=60

MasterAgent.sinks.k1.hdfs.callTimeout=60000

MasterAgent.sources.s1.channels = c1

MasterAgent.sinks.k1.channel = c1

-------------

Slave:

#SlavesAgent

SlavesAgent.channels = c1

SlavesAgent.sources = s1

SlavesAgent.sinks = k1

#SlavesAgent Spooling Directory Source

SlavesAgent.sources.s1.type = spooldir

SlavesAgent.sources.s1.spoolDir =/home/hadoop/logs/

SlavesAgent.sources.s1.fileHeader = true

SlavesAgent.sources.s1.deletePolicy =immediate

SlavesAgent.sources.s1.batchSize =1000

SlavesAgent.sources.s1.deserializer.maxLineLength =1048576

#SlavesAgent Memory Channel

SlavesAgent.channels.c1.type = memory

SlavesAgent.channels.c1.capacity = 1000

SlavesAgent.channels.c1.transactionCapacity = 100

#SlavesAgent.channels.c1.byteCapacityBufferPercentage = 20

#SlavesAgent.channels.c1.byteCapacity = 800

# SlavesAgent Sinks

SlavesAgent.sinks.k1.type = avro

# connect to CollectorMainAgent

SlavesAgent.sinks.k1.hostname = 192.168.192.128

SlavesAgent.sinks.k1.port = 4444

SlavesAgent.sources.s1.channels =c1

SlavesAgent.sinks.k1.channel = c1

命令:

开启agent:

flume-ng agent -c . -f /home/hadoop/flume-1.7.0/conf/myconf/MasterNode.conf -n MasterAgent -Dflume.root.logger=INFO,console

flume-ng agent -c . -f /home/hadoop/flume-1.7.0/conf/myconf/SlavesNode.conf -n SlavesAgent -Dflume.root.logger=INFO,console

执行要监控的脚本文件

flume-ng avro-client -c . -H localhost -p -F /data.txt

多个子节点收集日志-主节点上传到HDFS的更多相关文章

- Hadoop_13_Hadoop Shell脚本采集日志上传到HDFS

案例1:开发shell采集脚本 1.点击流日志每天都10T,在业务应用服务器上,需要准实时上传至数据仓库(Hadoop HDFS)上 2.一般上传文件都是在凌晨24点操作,由于很多种类的业务数据都要在 ...

- Laravel中的日志与上传

PHP中的框架众多,我自己就接触了好几个.大学那会啥也不懂啥也不会,拿了一个ThinkPHP学了.也许有好多人吐槽TP,但是个人感觉不能说哪个框架好,哪个框架不好,再不好的框架你能把源码读上一遍,框架 ...

- Hadoop生态圈-Azkaban实现文件上传到hdfs并执行MR数据清洗

Hadoop生态圈-Azkaban实现文件上传到hdfs并执行MR数据清洗 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 如果你没有Hadoop集群的话也没有关系,我这里给出当时我 ...

- FTP文件上传到HDFS上

在做测试数据时,往往会有ftp数据上传到hdfs的需求,一般需要手动操作,这样做太费事,于是有了下边代码实现的方式: ftp数据上传到hdfs函数: import java.io.InputStrea ...

- Ubuntu本地文件上传至HDFS文件系统出现的乱码问题及解决方案

1.问题来源及原因 用shell命令上传到HDFS中之后出现中文乱码,在shell命令窗口查看如图: 在eclipse中的文件HDFS查看工具查看如图: 原因:上传至HDFS文件系统的文本文件(这里是 ...

- Android热修复之 - 收集崩溃信息上传服务器

1.概述 大致的流程就是在用户崩溃的时候,我们获取崩溃信息.应用当前的信息和手机信息,然后把它保存到手机内存卡,再找我就直接找出来看看.后来衍生到上线后某些奇葩机型会有部分问题,所以不得不上传到服务器 ...

- logcat保存当前应用程序的日志并上传服务器或指定邮箱

给大家分享一个项目中用到的日志统计并提交服务器的日志工具类.通过过得当前app的PID,采用命令行的方式实用logcat工具过滤日志.代码区: package org.and.util; import ...

- iOS 日志系统 本地日志打包上传到服务器

日志系统主要包含两个部分 1.本地保存 我们知道NSLog打印的日志一般都是直接输出到控制台,开发人员可以在控制台直接看到实时打印的log,既然可以在控制台输出,那么能否将日志输出到其他地方呢,比如说 ...

- 上传到HDFS上的文件遇到乱码问题

1.通过eclipse中的hdfs插件上传文件,上传成功,但是查看是乱码. 查阅文件本身的编码方式,发现是utf-8,同时文件在项目目录下,显示正常,因为我把它的编码格式也设成了utf-8. 2.通过 ...

- 解决从本地文件系统上传到HDFS时的权限问题

当使用 hadoop fs -put localfile /user/xxx 时提示: put: Permission denied: user=root, access=WRITE, inode=& ...

随机推荐

- TCP/IP协议栈及网络基础

TCP/IP协议栈及网络基础 目录 TCP/IP协议栈及网络基础 1. TCP/IP协议栈及网络基础 1.1 OSI网络模型 1.2 TCP/IP网络模型 1.2.1 物理层 1.2.2 数据链路层 ...

- 🔥架构师狂掉1024根头发,总算搞定SSL通配证书

架构师狂掉1024根头发,总算搞定SSL通配证书 经过许多个日日夜夜的持续开发(掉了1024根头发),总算搞定了v1.11.0版本,修复和解决了许多问题,也支持CDN和OSS证书的部署. v1.11. ...

- AIRIOT物联网低代码平台如何配置db-driver驱动?

设备接入能力包括接入驱动类型及接入数据量,性能方面需要考量数据采集的稳定性和驱动的丰富性等多个因素.用户在选择物联网平台时,往往存在一些误区,比如很关注平台支持的驱动数量,越多越好.市场上确有支持上千 ...

- DashVector + DashScope升级多模态检索

本教程在前述教程(DashVector + ModelScope玩转多模态检索)的基础之上,基于DashScope上新推出的ONE-PEACE通用多模态表征模型结合向量检索服务DashVector来对 ...

- QShop商城--项目介绍

QShop商城-项目介绍 QShop商城,是全新推出的一款轻量级.高性能.前后端分离的电商系统,支持微信小程序,前后端源码100%开源,完美支持二次开发,让您快速搭建个性化独立商城. 技术架构:.Ne ...

- 2024盘古石取证比赛(APK)

题目列表 使用软件: Notepad++,火眼证据分析软件,雷电分析app,DB browser for SQLCipher 1. 分析伏季雅的手机检材,手机中诈骗APP的包名是:[答案格式:abc. ...

- zfile 在线云盘、网盘、OneDrive、云存储、私有云、对象存储、h5ai、上传、下载

基于 Java 的在线网盘程序,支持对接 S3.OneDrive.SharePoint.又拍云.本地存储.FTP.SFTP 等存储源,支持在线浏览图片.播放音视频,文本文件.Office.obj(3d ...

- itest(爱测试) 4.5.5 发布,开源BUG 跟踪管理 & 敏捷测试管理&极简项目管理软件

itest 简介 itest 开源敏捷测试管理,testOps 践行者,极简的任务管理,测试管理,缺陷管理,测试环境管理4合1,又有丰富的统计分析.可按测试包分配测试用例执行,也可建测试迭代(含任务, ...

- k8s核心组件详解和分层架构

k8s核心组件 master中的核心组件 api-server(接口服务,基于rest风格开放k8s接口的服务) kube-controller-manager(管理各个类型的控制器,针对k8s中的各 ...

- 查看SO KO 执行程序相关信息命令

1 查看SO 查看so库的方法__臣本布衣_新浪博客 (sina.com.cn) 1.nm -D libxxx.so 打印出符号信息. 一般这样用:nm -D libxxx.so |grep T $ ...