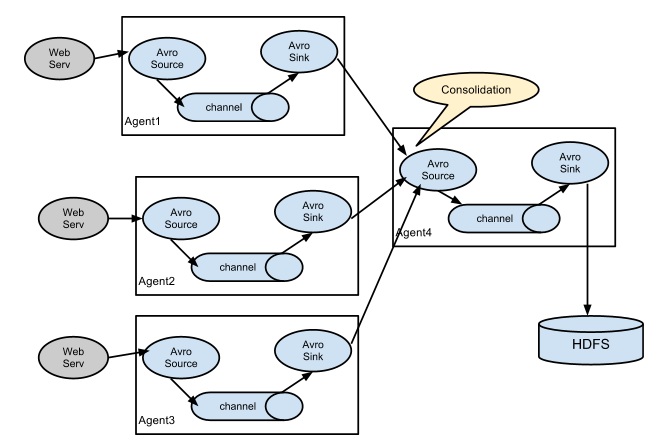

多个子节点收集日志-主节点上传到HDFS

Master:

----------------------

#MasterAgent

MasterAgent.channels = c1

MasterAgent.sources = s1

MasterAgent.sinks = k1

#MasterAgent Avro Source

MasterAgent.sources.s1.type = avro

MasterAgent.sources.s1.bind = 192.168.192.128

MasterAgent.sources.s1.port = 4444

##MasterAgent FileChannel

#MasterAgent.channels.c1.type = file

#MasterAgent.channels.c1.checkpointDir = /home/hadoop/data/spool/checkpoint

#MasterAgent.channels.c1.dataDirs = /home/spool/data

#MasterAgent.channels.c1.capacity = 200000000

#MasterAgent.channels.c1.keep-alive = 30

#MasterAgent.channels.c1.write-timeout = 30

#MasterAgent.channels.c1.checkpoint-timeout=600

#MasterAgent Memory Channel

MasterAgent.channels.c1.type = memory

MasterAgent.channels.c1.capacity = 1000

MasterAgent.channels.c1.transactionCapacity = 100

#MasterAgent.channels.c1.byteCapacityBufferPercentage = 20

#MasterAgent.channels.c1.byteCapacity = 800

# Describe the sink

MasterAgent.sinks.k1.type = hdfs

MasterAgent.sinks.k1.hdfs.path =hdfs://qm1711/flume_data

MasterAgent.sinks.k1.hdfs.filePrefix = %Y_%m_%d

MasterAgent.sinks.k1.hdfs.fileSuffix = .log

MasterAgent.sinks.k1.hdfs.round = true

MasterAgent.sinks.k1.hdfs.roundValue = 1

MasterAgent.sinks.k1.hdfs.roundUnit = minute

MasterAgent.sinks.k1.hdfs.useLocalTimeStamp = true

MasterAgent.sinks.k1.hdfs.fileType=DataStream

MasterAgent.sinks.k1.hdfs.writeFormat=Text

MasterAgent.sinks.k1.hdfs.rollInterval=0

MasterAgent.sinks.k1.hdfs.rollSize=10240

MasterAgent.sinks.k1.hdfs.rollCount=0

MasterAgent.sinks.k1.hdfs.idleTimeout=60

MasterAgent.sinks.k1.hdfs.callTimeout=60000

MasterAgent.sources.s1.channels = c1

MasterAgent.sinks.k1.channel = c1

-------------

Slave:

#SlavesAgent

SlavesAgent.channels = c1

SlavesAgent.sources = s1

SlavesAgent.sinks = k1

#SlavesAgent Spooling Directory Source

SlavesAgent.sources.s1.type = spooldir

SlavesAgent.sources.s1.spoolDir =/home/hadoop/logs/

SlavesAgent.sources.s1.fileHeader = true

SlavesAgent.sources.s1.deletePolicy =immediate

SlavesAgent.sources.s1.batchSize =1000

SlavesAgent.sources.s1.deserializer.maxLineLength =1048576

#SlavesAgent Memory Channel

SlavesAgent.channels.c1.type = memory

SlavesAgent.channels.c1.capacity = 1000

SlavesAgent.channels.c1.transactionCapacity = 100

#SlavesAgent.channels.c1.byteCapacityBufferPercentage = 20

#SlavesAgent.channels.c1.byteCapacity = 800

# SlavesAgent Sinks

SlavesAgent.sinks.k1.type = avro

# connect to CollectorMainAgent

SlavesAgent.sinks.k1.hostname = 192.168.192.128

SlavesAgent.sinks.k1.port = 4444

SlavesAgent.sources.s1.channels =c1

SlavesAgent.sinks.k1.channel = c1

命令:

开启agent:

flume-ng agent -c . -f /home/hadoop/flume-1.7.0/conf/myconf/MasterNode.conf -n MasterAgent -Dflume.root.logger=INFO,console

flume-ng agent -c . -f /home/hadoop/flume-1.7.0/conf/myconf/SlavesNode.conf -n SlavesAgent -Dflume.root.logger=INFO,console

执行要监控的脚本文件

flume-ng avro-client -c . -H localhost -p -F /data.txt

多个子节点收集日志-主节点上传到HDFS的更多相关文章

- Hadoop_13_Hadoop Shell脚本采集日志上传到HDFS

案例1:开发shell采集脚本 1.点击流日志每天都10T,在业务应用服务器上,需要准实时上传至数据仓库(Hadoop HDFS)上 2.一般上传文件都是在凌晨24点操作,由于很多种类的业务数据都要在 ...

- Laravel中的日志与上传

PHP中的框架众多,我自己就接触了好几个.大学那会啥也不懂啥也不会,拿了一个ThinkPHP学了.也许有好多人吐槽TP,但是个人感觉不能说哪个框架好,哪个框架不好,再不好的框架你能把源码读上一遍,框架 ...

- Hadoop生态圈-Azkaban实现文件上传到hdfs并执行MR数据清洗

Hadoop生态圈-Azkaban实现文件上传到hdfs并执行MR数据清洗 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 如果你没有Hadoop集群的话也没有关系,我这里给出当时我 ...

- FTP文件上传到HDFS上

在做测试数据时,往往会有ftp数据上传到hdfs的需求,一般需要手动操作,这样做太费事,于是有了下边代码实现的方式: ftp数据上传到hdfs函数: import java.io.InputStrea ...

- Ubuntu本地文件上传至HDFS文件系统出现的乱码问题及解决方案

1.问题来源及原因 用shell命令上传到HDFS中之后出现中文乱码,在shell命令窗口查看如图: 在eclipse中的文件HDFS查看工具查看如图: 原因:上传至HDFS文件系统的文本文件(这里是 ...

- Android热修复之 - 收集崩溃信息上传服务器

1.概述 大致的流程就是在用户崩溃的时候,我们获取崩溃信息.应用当前的信息和手机信息,然后把它保存到手机内存卡,再找我就直接找出来看看.后来衍生到上线后某些奇葩机型会有部分问题,所以不得不上传到服务器 ...

- logcat保存当前应用程序的日志并上传服务器或指定邮箱

给大家分享一个项目中用到的日志统计并提交服务器的日志工具类.通过过得当前app的PID,采用命令行的方式实用logcat工具过滤日志.代码区: package org.and.util; import ...

- iOS 日志系统 本地日志打包上传到服务器

日志系统主要包含两个部分 1.本地保存 我们知道NSLog打印的日志一般都是直接输出到控制台,开发人员可以在控制台直接看到实时打印的log,既然可以在控制台输出,那么能否将日志输出到其他地方呢,比如说 ...

- 上传到HDFS上的文件遇到乱码问题

1.通过eclipse中的hdfs插件上传文件,上传成功,但是查看是乱码. 查阅文件本身的编码方式,发现是utf-8,同时文件在项目目录下,显示正常,因为我把它的编码格式也设成了utf-8. 2.通过 ...

- 解决从本地文件系统上传到HDFS时的权限问题

当使用 hadoop fs -put localfile /user/xxx 时提示: put: Permission denied: user=root, access=WRITE, inode=& ...

随机推荐

- linux文本三剑客之sed命令详解

linux文本三剑客之sed命令详解 目录 linux文本三剑客之sed命令详解 1.sed命令详解 1.1 地址定界和编辑命令 1.2 搜索替换 1.3 sed高级用法 1.sed命令详解 sed称 ...

- C语言:如何删除在可视化网页中未可见的内容(网页txt)

我这个代码仅仅限制于在chrome浏览器中下载china daliy的网页中实现删除可视化内容,因为每个网页的超链接或者文本主内容分布不一样,但是学会了删除一个网页类型的不可视化内容之后,修改其他网页 ...

- 一键自动化博客发布工具,用过的人都说好(51cto篇)

51cto是一个优秀的博客平台,今天给大家讲解一下blog-auto-publishing-tools如何自动发布博客到51cto上. 当然在实现过程中有可能会遇到各种困难,不过不用担心,我们一个个来 ...

- VSCode:让VSCode终端面板显示到右边

很简单,右击下方终端面板,选中"将视图移动到侧面板": 可以看到终端成功显示到右边了:

- vulnhub靶场 --> JANGOW: 1.0.1

靶机下载地址 JANGOW: 1.0.1 << 点我下载 开始打靶 IP发现 nmap扫描网段发现靶机ip:192.168.111.140 端口发现 对靶机进行常规端口扫描 访问网站 访问 ...

- wpf布局递归

wpf布局递归的调用到底是怎样的顺序?我一直挺模糊. 按照继承顺序. 已知: 1.1.UIElement:声明了Measure 1.2.UIElement:声明了MeasureCore,返回Size( ...

- 更改wsl中系统的安装位置

wsl默认安装位置是C盘,众所周知C盘总是不够用的,所以才有了把wsl的系统迁移到其它位置的需求.官网文档 首先查看所有分发版本 wsl -l --all -v 导出分发版为tar文件到D盘 wsl ...

- 重做贪吃蛇 万向移动型 蛇的移动和吃食部分C# wpf版

之前写了一个贪吃蛇,代码实在太乱了,上一个是用polyline做的,这次这个是用一个个的elipse来渲染蛇的身体,其中一个圆点,就是一个elipse了.蛇的移动是通过定时器来实现的,方向键 A D控 ...

- 记录一次WhatTheFuck经历

起因 很早之前就一直在维护一个git仓库,平时调研什么组件就会在里面新建一个springboot的工程用来编写示例代码. 最一开始使用的是SpringInitializr,后来网站更新之后,只能生成J ...

- mac for docker访问宿主机服务

转载链接 https://blog.csdn.net/weixin_33860528/article/details/91461648