爬虫之cookie与代理

一, 基于requests模块的cookie操作

引言:有些时候,我们在使用爬虫程序去爬取一些用户相关信息的数据(爬取张三“人人网”个人主页数据)时,如果使用之前requests模块常规操作时,往往达不到我们想要的目的,例如:

#!/usr/bin/env python

# -*- coding:utf-8 -*-

import requests

if __name__ == "__main__": #张三人人网个人信息页面的url

url = 'http://www.renren.com/289676607/profile' #伪装UA

headers={

'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_12_0) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/69.0.3497.100 Safari/537.36',

}

#发送请求,获取响应对象

response = requests.get(url=url,headers=headers)

#将响应内容写入文件

with open('./renren.html','w',encoding='utf-8') as fp:

fp.write(response.text)

- 结果发现,写入到文件中的数据,不是张三个人页面的数据,而是人人网登陆的首页面,why?首先我们来回顾下cookie的相关概念及作用:

- cookie概念:当用户通过浏览器首次访问一个域名时,访问的web服务器会给客户端发送数据,以保持web服务器与客户端之间的状态保持,这些数据就是cookie。

- cookie作用:我们在浏览器中,经常涉及到数据的交换,比如你登录邮箱,登录一个页面。我们经常会在此时设置30天内记住我,或者自动登录选项。那么它们是怎么记录信息的呢,答案就是今天的主 角cookie了,Cookie是由HTTP服务器设置的,保存在浏览器中,但HTTP协议是一种无状态协议,在数据交换完毕后,服务器端和客户端的链接就会关闭,每次交换数据都需要建立新的链 接。就像我们去超市买东西,没有积分卡的情况下,我们买完东西之后,超市没有我们的任何消费信息,但我们办了积分卡之后,超市就有了我们的消费信息。cookie就像是积分卡,可以 保存积分,商品就是我们的信息,超市的系统就像服务器后台,http协议就是交易的过程。

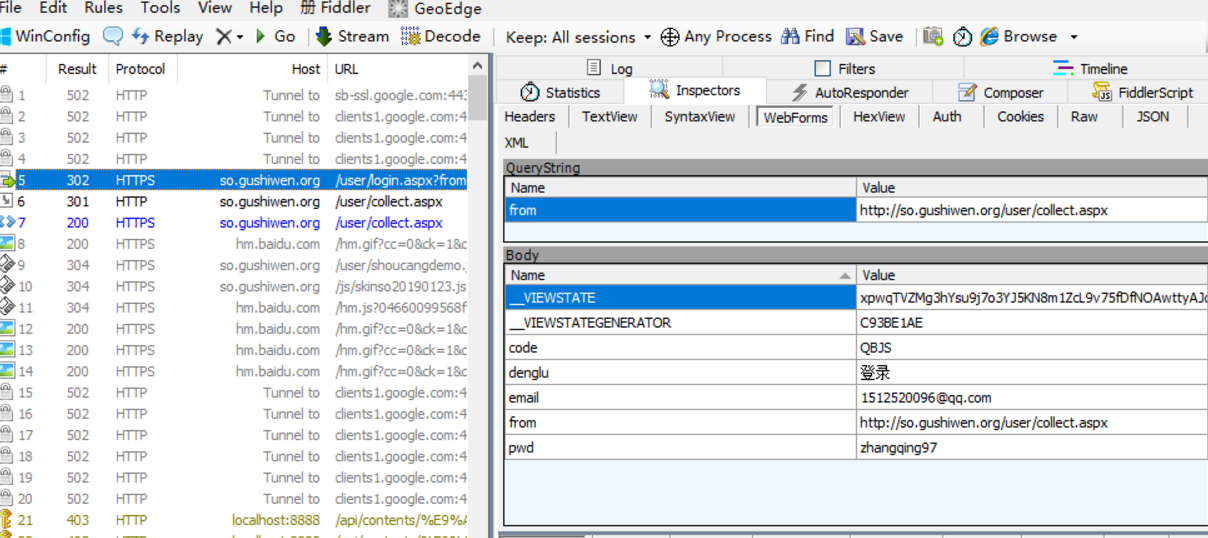

- 经过cookie的相关介绍,其实你已经知道了为什么上述案例中爬取到的不是张三个人信息页,而是登录页面。那应该如何抓取到张三的个人信息页呢?

思路:

1.我们需要使用爬虫程序对人人网的登录时的请求进行一次抓取,获取请求中的cookie数据

2.在使用个人信息页的url进行请求时,该请求需要携带 1 中的cookie,只有携带了cookie后,服务器才可识别这次请求的用户信息,方可响应回指定的用户信息页数据

import requests

from lxml import etree headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/70.0.3538.67 Safari/537.36"

}

# 1.进行登陆操作,服务器就会对当前用户 创建一个cookie对象(存储当前的用户状态信息,以及身份标识)

# 2. 进行个人主页的请求(携带步骤1中创建的cookie), 获取当前用户个人主页的页面数据 # 登陆

#登录请求的url(通过抓包工具获取)

login_url = "http://www.renren.com/ajaxLogin/login?1=1&uniqueTimestamp=2018922053679 "

session = requests.session() # #创建一个session对象,该对象会自动将请求中的cookie进行存储和携带

data = {

"captcha_type":"web_login",

"domain":"renren.com",

"email":"18829037944",

"f":"",

"icode":"",

"key_id":"1",

"origURL":"http://www.renren.com/home",

"password": "30f28dff42c847e99969e7e91f8356bcb80aa2e9993893add81b6ff76c899be3",

"rkey": "f1ace095ea75f09850cbb28b87a04b9e",

}

session.post(url=login_url, data=data, headers=headers) # 使用session发送请求,目的是为了将session保存该次请求中的cookie get_url = "http://www.renren.com/968520666/profile"

# 再次使用session进行请求的发送,该次请求中已经携带了cookie

response = session.get(url=get_url, headers=headers)

#设置响应内容的编码格式

response.encoding = 'utf-8'

page_text = response.text #将响应内容写入文件

with open('./renren01.html','w', encoding="utf-8") as fp:

fp.write(response.text)

print("over")

二, 基于requests模块的代理操作

- 什么是代理

代理就是第三方代替本体处理相关事务。例如:生活中的代理:代购,中介,微商......

爬虫中为什么需要使用代理

一些网站会有相应的反爬虫措施,例如很多网站会检测某一段时间某个IP的访问次数,如果访问频率太快以至于看起来不像正常访客,它可能就会会禁止这个IP的访问。所以我们需要设置一些代理IP,每隔一段时间换一个代理IP,就算IP被禁止,依然可以换个IP继续爬取。

代理的分类:

正向代理:代理客户端获取数据。正向代理是为了保护客户端防止被追究责任。

反向代理:代理服务器提供数据。反向代理是为了保护服务器或负责负载均衡。

免费代理ip提供网站

http://www.goubanjia.com/

西祠代理

快代理

#!/usr/bin/env python

# -*- coding:utf-8 -*-

import requests

import random

if __name__ == "__main__":

#不同浏览器的UA

header_list = [

# 遨游

{"user-agent": "Mozilla/4.0 (compatible; MSIE 7.0; Windows NT 5.1; Maxthon 2.0)"},

# 火狐

{"user-agent": "Mozilla/5.0 (Windows NT 6.1; rv:2.0.1) Gecko/20100101 Firefox/4.0.1"},

# 谷歌

{

"user-agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_7_0) AppleWebKit/535.11 (KHTML, like Gecko) Chrome/17.0.963.56 Safari/535.11"}

]

#不同的代理IP

proxy_list = [

{"http": "112.115.57.20:3128"},

{'http': '121.41.171.223:3128'}

]

#随机获取UA和代理IP

header = random.choice(header_list)

proxy = random.choice(proxy_list) url = 'http://www.baidu.com/s?ie=UTF-8&wd=ip'

#参数3:设置代理

response = requests.get(url=url,headers=header,proxies=proxy)

response.encoding = 'utf-8' with open('daili.html', 'wb') as fp:

fp.write(response.content)

#切换成原来的IP

requests.get(url, proxies={"http": ""})

爬虫之cookie与代理的更多相关文章

- 反爬虫之搭建IP代理池

反爬虫之搭建IP代理池 听说你又被封 ip 了,你要学会伪装好自己,这次说说伪装你的头部.可惜加了header请求头,加了cookie 还是被限制爬取了.这时就得祭出IP代理池!!! 下面就是requ ...

- Py之Crawler:爬虫利用随机选取代理访问服务器的方法实现下载某网址上所有的图片到指定文件夹——Jason niu

#Py之Crawler:爬虫利用随机选取代理访问服务器的方法实现下载某网址上所有的图片到指定文件夹 import urllib.request import os import random def ...

- 爬虫反爬之代理IP

爬虫反爬之代理IP 代理IP其实本就是在requests模块中的参数 定义: 代替原来的IP地址去对接网络的IP地址. 作用: 隐藏自身真实IP,避免被封. 获取代理IP网站 西刺代理.快代理.全网代 ...

- 网络爬虫一定要用代理IP吗

数据采集现在已经成为大数据时代不可以缺少的一部分,在数据采集过程中,很多人都会用到代理ip,那么网络爬虫一定要用代理IP吗?答案虽然不是肯定的,但出现以下情况一定是需要用到代理IP的.1.在爬虫的时候 ...

- 爬虫开发5.requests模块的cookie和代理操作

代理和cookie操作 一.基于requests模块的cookie操作 引言:有些时候,我们在使用爬虫程序去爬取一些用户相关信息的数据(爬取张三“人人网”个人主页数据)时,如果使用之前requests ...

- Python网络爬虫之cookie处理、验证码识别、代理ip、基于线程池的数据爬去

本文概要 session处理cookie proxies参数设置请求代理ip 基于线程池的数据爬取 引入 有些时候,我们在使用爬虫程序去爬取一些用户相关信息的数据(爬取张三“人人网”个人主页数据)时, ...

- 爬虫之proxy(代理)

proxy简介 proxy即为代理,我们爬虫的时候肯定会有频繁访问某一网站的情况,这个时候有些服务器会识别到我们是非正常访问,就会把我们的IP禁掉,这个时候就需要用代理了. 就好比现实生活中,我需要向 ...

- requests模块的cookie和代理操作

一.基于requests模块的cookie操作 引言:有些时候,我们在使用爬虫程序去爬取一些用户相关信息的数据(爬取张三“人人网”个人主页数据)时,如果使用之前requests模块常规操作时,往往达不 ...

- 爬虫入门之反反爬虫机制cookie UA与中间件(十三)

1. 通常防止爬虫被反主要有以下几个策略 (1)动态设置User-Agent(随机切换User-Agent,模拟不同的浏览器) 方法1: 修改setting.py中的User-Agent # Craw ...

随机推荐

- 【IoT】物联网NB-IoT之电信物联网开放平台对接流程浅析

版权声明:本文为博主原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明.本文链接:https://blog.csdn.net/liwei16611/article/de ...

- git用法汇总

使用了一年多的git命令了,昨晚竟然又出现了问题.虽然解决了,不过还是被罚了... 总结下自己常用的git命令和遇到的一些坑. 1)常用的命令 1. 从git远程分支clone代码: git clon ...

- icheck判断是否选中

icheck判断是否选中 1 $("#id").on('ifChanged', function () { 2 if ($(this).is(':checked')) {//就 ...

- kubernetes之secret

Secret解决了密码.token.密钥等敏感数据的配置问题,而不需要把这些敏感数据暴露到镜像或者Pod Spec中.Secret可以以Volume或者环境变量的方式使用. Secret类型: Opa ...

- SLA 99.99%以上!饿了么实时计算平台3年演进历程

作者介绍 倪增光,饿了么BDI-大数据平台研发高级技术经理,曾先后就职于PPTV.唯品会.15年加入饿了么,组建数据架构team,整体负责离线平台.实时平台.平台工具的开发和运维,先后经历了唯品会.饿 ...

- java的特性与优势

java的特性与优势 简单性 面向对象 可移植性 高性能 分布式 动态性 多线程 安全性 健壮性

- Python 获取文件类型后缀

import os path='file.txt' file=os.path.splitext(path) filename,type=file print(filename) print(type)

- LeetCode 187. 重复的DNA序列(Repeated DNA Sequences)

187. 重复的DNA序列 187. Repeated DNA Sequences 题目描述 All DNA is composed of a series of nucleotides abbrev ...

- Response知识点小结

HTTP协议: 1. 响应消息:服务器端发送给客户端的数据 * 数据格式: 1. 响应行 1. 组成:协议/版本 响应状态码 状态码描述 2. 响应状态码:服务器告诉客户端浏览器本次请求和响应的一个状 ...

- quartz2.3.0(九)job任务监听器,监听任务执行前、后、取消手动处理方法

job1任务类 package org.quartz.examples.example9; import java.util.Date; import org.quartz.Job; import o ...